Rewolucja sztucznej inteligencji, od dawna zapowiadana w salach konferencyjnych i laboratoriach badawczych, w końcu zaczyna nabierać realnych kształtów w europejskim krajobrazie biznesowym.

Dane wskazują na bezprecedensowe przyspieszenie, które sugeruje, że firmy na Starym Kontynencie masowo otwierają się na nowe technologie. Jednak pod powierzchnią tych imponujących liczb kryje się znacznie bardziej złożony i zniuansowany obraz.

Kluczowe pytanie brzmi: czy jesteśmy świadkami głębokiej, transformacyjnej fali, która podniesie całą gospodarkę, czy raczej skoncentrowanej fali, która omija większość przedsiębiorstw

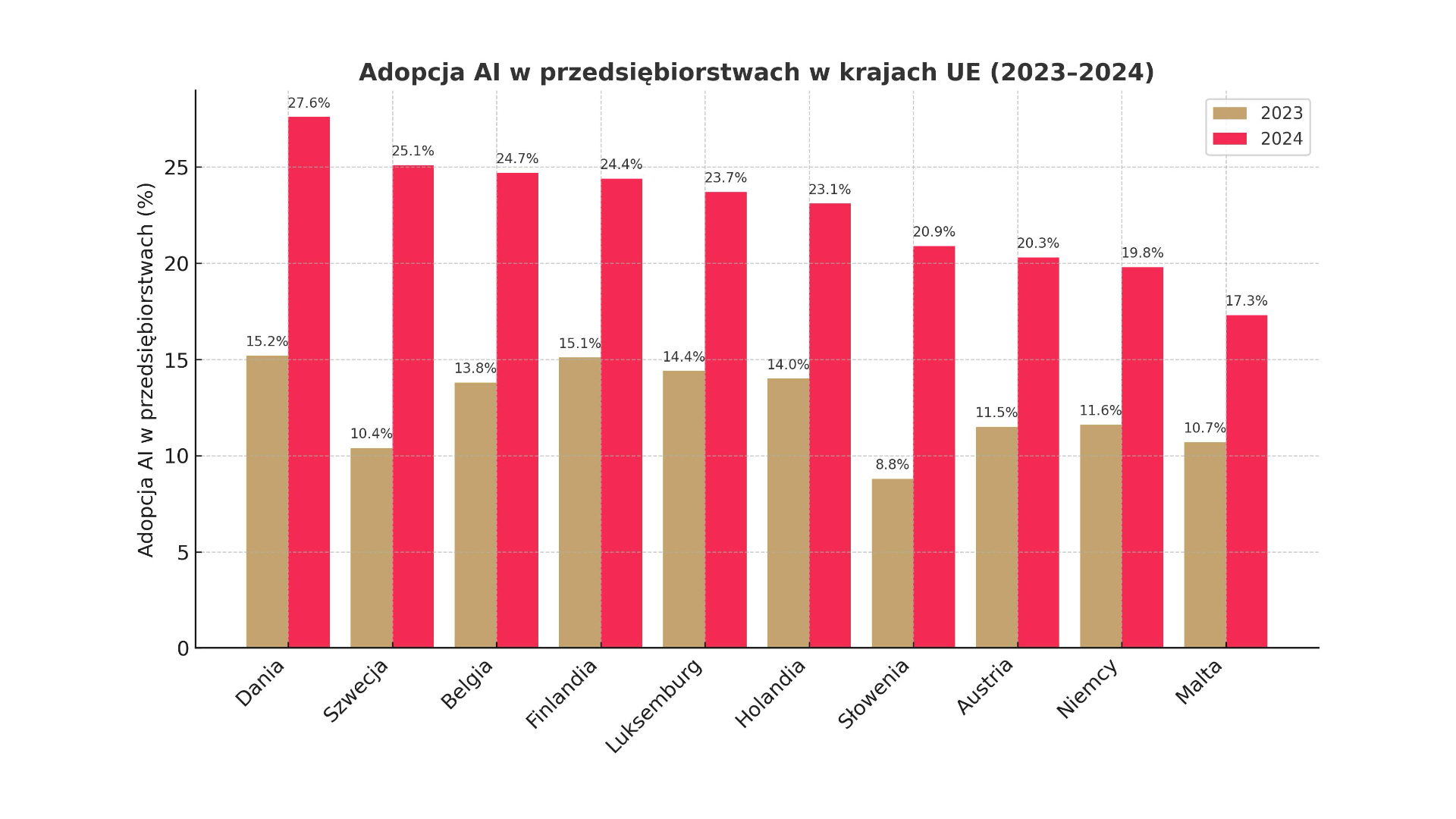

Najnowsze dane Eurostatu stanowią punkt wyjścia dla tej analizy. W 2024 roku 13,5% przedsiębiorstw w Unii Europejskiej (zatrudniających 10 lub więcej pracowników) korzystało z technologii sztucznej inteligencji.

Na pierwszy rzut oka liczba ta może wydawać się skromna, jednak jej prawdziwe znaczenie ujawnia się w porównaniu z rokiem poprzednim. W 2023 roku wskaźnik ten wynosił zaledwie 8,0%.

Oznacza to wzrost o 5,5 punktu procentowego w ciągu zaledwie dwunastu miesięcy – dynamikę, która niemal podwoiła ogólny poziom adopcji AI w całej Unii. Tak gwałtowny skok sygnalizuje, że bariery wejścia maleją, a firmy dostrzegają coraz bardziej namacalne korzyści płynące z wdrożenia inteligentnych systemów.

Jednakże, zanim ogłosimy powszechny triumf AI, należy spojrzeć na drugą stronę medalu. Wskaźnik na poziomie 13,5% oznacza również, że przytłaczająca większość, czyli ponad 86% europejskich firm, nadal nie wykorzystuje sztucznej inteligencji w swojej działalności.

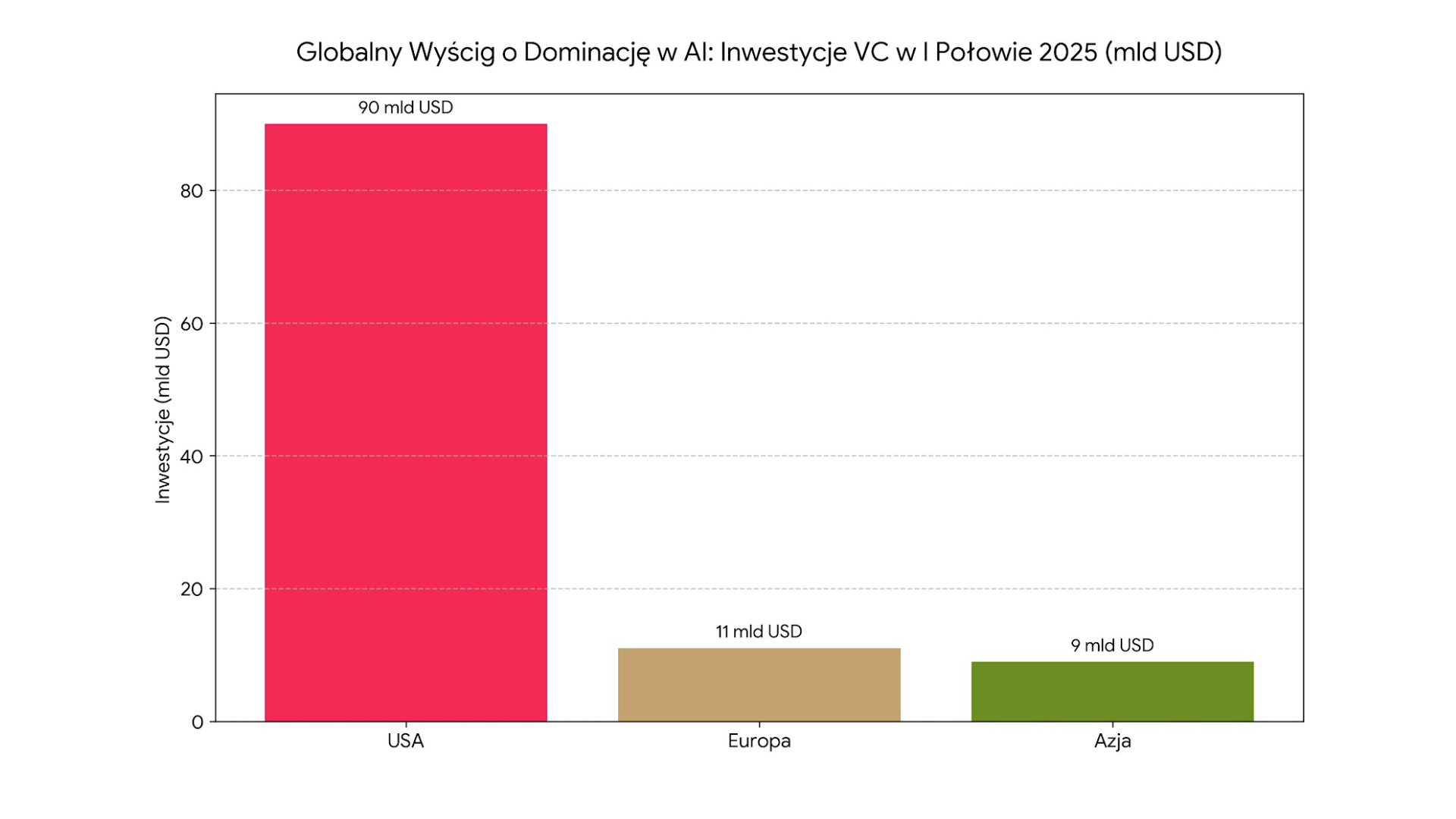

To pokazuje, jak długa droga dzieli nas od powszechnej implementacji. Co więcej, ten wzrost należy umieścić w kontekście globalnym, gdzie Europa jest często postrzegana jako pozostająca w tyle za Stanami Zjednoczonymi i Chinami pod względem zarówno inwestycji, jak i skali wdrożeń AI.

Ta perspektywa dodaje pilności do zrozumienia natury obecnego zrywu. Istnieje realne ryzyko, że Europa, koncentrując się na regulacjach, może przegapić „historyczną falę tworzenia bogactwa”, napędzaną przez szybkie i szerokie wdrażanie AI w innych częściach świata.

Co zatem napędza ten nagły wzrost? Analiza danych sugeruje, że nie jest to przypadek. Gwałtowny skok adopcji między 2023 a 2024 rokiem idealnie koreluje z eksplozją popularności generatywnej sztucznej inteligencji, której symbolem stał się ChatGPT, udostępniony szerokiej publiczności pod koniec 2022 roku.

Dalsze dane pokazują, że największy wzrost odnotowały technologie związane z przetwarzaniem języka, takie jak text mining i generowanie języka naturalnego. To prowadzi do wniosku, że obecna fala adopcji jest w dużej mierze napędzana przez łatwiej dostępne, często gotowe do użycia aplikacje językowe, a nie przez nagłe, powszechne wdrożenie skomplikowanych, głęboko zintegrowanych systemów uczenia maszynowego.

To właśnie tutaj „hype” wokół generatywnej AI przekształca się w pierwsze, realne zastosowania biznesowe, obniżając próg wejścia dla wielu firm, które wcześniej postrzegały AI jako technologię zbyt złożoną i kosztowną.

Europejska mapa AI: kontynent pełen kontrastów

Analiza geograficzna wdrożeń sztucznej inteligencji w Unii Europejskiej ujawnia obraz kontynentu głęboko podzielonego. Zamiast jednolitego frontu technologicznego postępu, widzimy wyraźne skupiska liderów, grupę maruderów oraz kluczowe gospodarki, które zajmują pozycję pośrodku.

Ta mapa kontrastów jest kluczowa dla zrozumienia, gdzie AI jest już rzeczywistością biznesową, a gdzie pozostaje jedynie aspiracją.

Na czele peletonu znajduje się wyraźny blok państw nordyckich i krajów Beneluksu, które wyznaczają tempo dla reszty kontynentu. Dania jest niekwestionowanym liderem w UE, z wskaźnikiem adopcji AI na poziomie 27,6%.

Tuż za nią plasują się Szwecja (25,1%) oraz Belgia (24,7%). W tej czołowej grupie znajdują się również Finlandia (24,4%) i Luksemburg (23,7%). Warto zauważyć, że wskaźniki w tych krajach są ponad dwukrotnie wyższe od średniej unijnej, co świadczy o ich zaawansowaniu i dojrzałości cyfrowej.

Na drugim biegunie znajdują się kraje Europy Wschodniej i Południowej, gdzie adopcja AI postępuje znacznie wolniej. Rumunia zamyka stawkę z najniższym wskaźnikiem w całej Unii, wynoszącym zaledwie 3,1%.

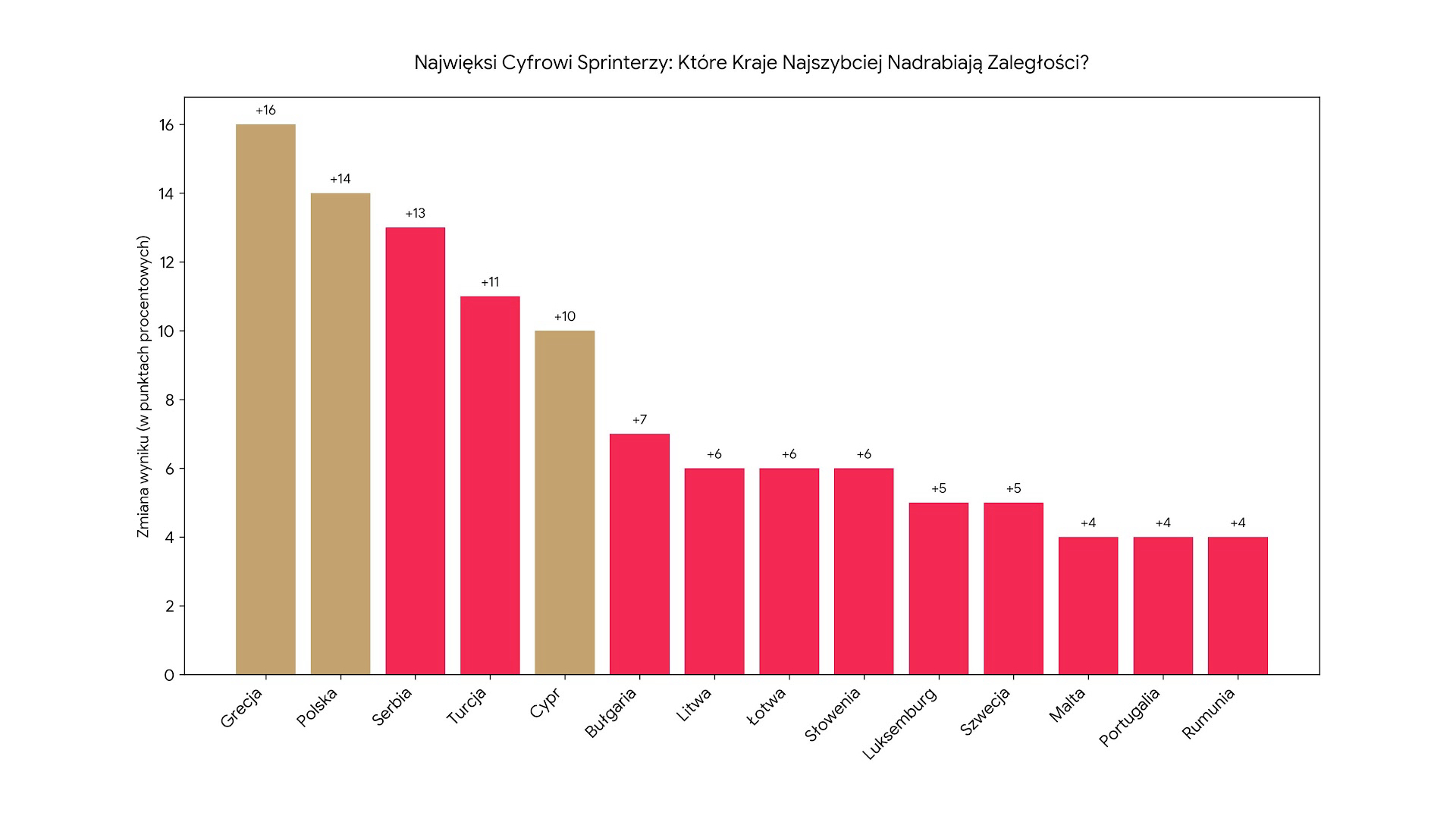

Niewiele lepiej sytuacja wygląda w Polsce (5,9%) i Bułgarii (6,5%), które również znacząco odstają od średniej. Ta przepaść między liderami a maruderami nie jest statyczna – ona się pogłębia. Dynamika wzrostu pokazuje, że liderzy przyspieszają jeszcze bardziej. Szwecja odnotowała największy roczny wzrost (+14,7 p.p.), a tuż za nią Dania (+12,4 p.p.) i Belgia (+10,9 p.p.). W tym samym czasie kraje takie jak Portugalia (+0,8 p.p.) czy Rumunia (+1,6 p.p.) rozwijają się w znacznie wolniejszym tempie, co sprawia, że dystans do czołówki staje się coraz większy.

Największe gospodarki Europy prezentują bardziej zróżnicowany obraz. Niemcy, z wynikiem 19,8%, plasują się znacznie powyżej średniej unijnej. Zaskakujący jest przypadek Francji.

Mimo że jest europejskim liderem w tworzeniu zaawansowanych modeli AI (w 2024 roku z Francji pochodziły 3 wpływowe modele), wskaźnik adopcji AI w tamtejszych przedsiębiorstwach jest jednym z niższych i wynosi zaledwie 9,9%. Hiszpania również notuje skromny wynik na poziomie 11,3%.

Przypadek Francji rzuca światło na kluczowy paradoks: rozbieżność między potencjałem innowacyjnym a rynkowym wdrożeniem. Posiadanie silnych ośrodków badawczo-rozwojowych i zdolności do tworzenia zaawansowanych technologii nie przekłada się automatycznie na ich szerokie zastosowanie w biznesie.

Niski wskaźnik adopcji we Francji sugeruje istnienie barier na rynku wewnętrznym. Mogą to być przeszkody regulacyjne, kultura biznesowa niechętna ryzyku, czy też luka w kompetencjach potrzebnych do wdrażania, a nie tylko tworzenia AI.

To pokazuje, że prężnie działający ekosystem innowacyjny, składający się ze startupów i laboratoriów badawczych, nie gwarantuje, że szerszy ekosystem biznesowy, zwłaszcza małe i średnie przedsiębiorstwa, zintegruje te innowacje.

Droga z laboratorium na halę produkcyjną jest w tym przypadku wyraźnie zwężona. Dla decydentów politycznych płynie z tego ważna lekcja: wspieranie badań i rozwoju to za mało; konieczna jest równoległa strategia na rzecz stymulowania popytu i ułatwiania wdrożeń na rynku.

Wielka przepaść: dlaczego duże firmy wyprzedzają MŚP?

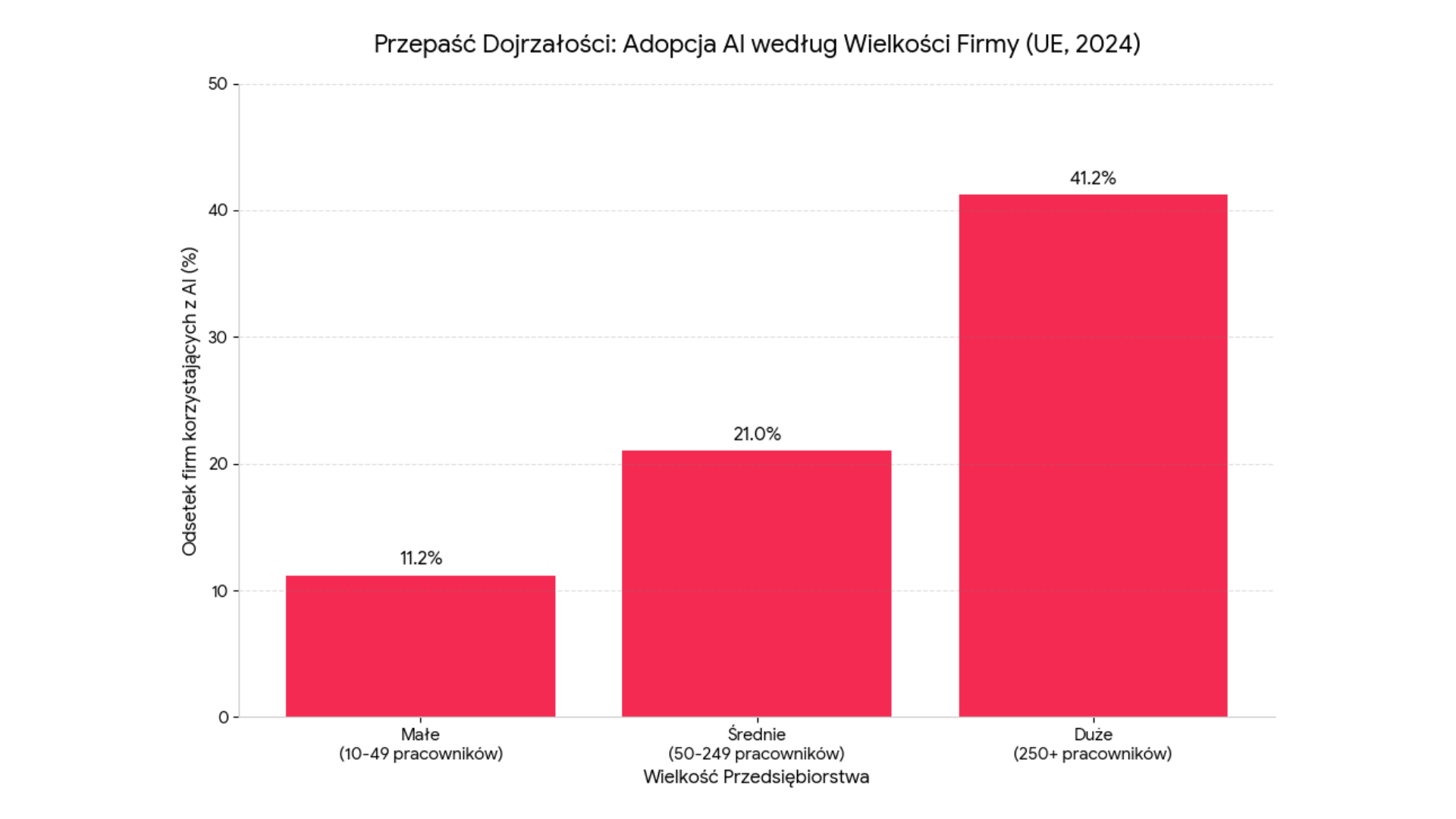

Jednym z najbardziej uderzających wniosków płynących z danych jest ogromna przepaść w adopcji AI między wielkimi korporacjami a sektorem małych i średnich przedsiębiorstw (MŚP).

Ten rozdźwięk jest tak znaczący, że grozi powstaniem dwubiegunowej gospodarki w Europie, w której liderzy technologiczni odrywają się od reszty peletonu, pogłębiając nierówności w produktywności i konkurencyjności.

Liczby mówią same za siebie. Aż 41,2% dużych przedsiębiorstw (zatrudniających 250 lub więcej pracowników) aktywnie korzysta z technologii AI. Wskaźnik ten gwałtownie spada do 20,9% w przypadku firm średniej wielkości i osiąga zaledwie 11,2% w małych firmach (zatrudniających od 10 do 49 pracowników).

Co więcej, tempo wzrostu w dużych firmach jest również wyższe – ich udział w adopcji AI wzrósł o ponad 10 punktów procentowych w ciągu ostatniego roku, co dodatkowo poszerza istniejącą lukę.

Eurostat wskazuje na trzy fundamentalne przyczyny tej dysproporcji: złożoność implementacji, korzyści skali (większe firmy czerpią większe zyski z automatyzacji i optymalizacji) oraz koszty (duże organizacje dysponują znacznie większym kapitałem na inwestycje w nowe technologie).

Te czynniki są wzmacniane przez strategiczne podejście. Firmy posiadające jasno zdefiniowaną i widoczną strategię AI mają dwukrotnie większe szanse na osiągnięcie wzrostu przychodów napędzanego przez sztuczną inteligencję – a zdolność do takiego strategicznego planowania jest znacznie częstsza w dużych korporacjach.

Ta dysproporcja nie ma jednak wyłącznie podłoża finansowego. Duże przedsiębiorstwa posiadają kluczową przewagę strategiczną: ogromne zasoby własnych danych oraz zdolność do przyciągania rzadkich i drogich talentów z dziedziny AI.

Tworzy to samonapędzający się cykl, swoistą „fosę” oddzielającą ich od mniejszej konkurencji. Większa ilość danych pozwala na trenowanie lepszych, bardziej efektywnych modeli AI. Te z kolei generują dalsze dane i przychody, co umożliwia zatrudnianie najlepszych specjalistów.

Małe i średnie firmy często pozostają poza tym pozytywnym cyklem. Systemy AI, zwłaszcza te oparte na uczeniu maszynowym, wymagają ogromnych zbiorów danych do skutecznego działania. Duże firmy w naturalny sposób generują i kontrolują znacznie więcej danych niż MŚP.

Jednocześnie, główną barierą adopcji jest brak umiejętności i wiedzy eksperckiej. Najlepsi specjaliści AI to ograniczony i kosztowny zasób. Duże, rozpoznawalne marki, dysponujące odpowiednimi budżetami i oferujące ambitne projekty, bez trudu przyciągają te talenty, podczas gdy MŚP mają trudności z konkurowaniem o nie.

W rezultacie, luka w adopcji AI przez MŚP nie jest jedynie tymczasowym opóźnieniem, ale strukturalną barierą, zakorzenioną w fundamentalnych wymaganiach technologii AI (dane i talent). Bez ukierunkowanych interwencji politycznych, takich jak inicjatywy na rzecz współdzielenia danych czy programy szkoleniowe dla MŚP, ta przepaść prawdopodobnie będzie się pogłębiać, prowadząc do znaczących różnic w produktywności w całej europejskiej gospodarce.

Sektorowe reflektory: gdzie AI to już codzienność biznesowa

Po zidentyfikowaniu liderów geograficznych i organizacyjnych, analiza przenosi się na poziom sektorowy, odpowiadając na pytanie: w jakich branżach AI zakorzeniła się najgłębiej? Dane jednoznacznie pokazują, że rewolucja AI, przynajmniej na razie, jest zjawiskiem silnie skoncentrowanym w sektorach cyfrowych i opartych na wiedzy.

Dla wielu tradycyjnych gałęzi przemysłu sztuczna inteligencja pozostaje wciąż odległą przyszłością.

Niekwestionowanym liderem jest sektor informacji i komunikacji (ICT), gdzie aż 48,7% przedsiębiorstw aktywnie wykorzystuje technologie AI. Jest to wynik niemal czterokrotnie wyższy od średniej unijnej i pokazuje, że w tej branży AI staje się standardem biznesowym. Na drugim miejscu, ze znaczną stratą, plasuje się sektor działalności profesjonalnej, naukowej i technicznej, z wciąż imponującym wskaźnikiem adopcji na poziomie 30,5%.

Poza tymi dwoma liderami następuje gwałtowny spadek. We wszystkich pozostałych sektorach gospodarki wskaźnik adopcji AI jest poniżej 16%. Tradycyjne branże, takie jak budownictwo, wykazują minimalne zainteresowanie, z wdrożeniami na poziomie zaledwie 6,1%.

Ta polaryzacja jest bezpośrednio związana z naturą samych branż. Sektory ICT i usług profesjonalnych są z natury bogate w dane i cyfrowo dojrzałe. Zastosowania AI do analizy danych, automatyzacji procesów czy generowania treści są w nich oczywiste i stosunkowo łatwe do wdrożenia.

Mapa adopcji AI niemal idealnie pokrywa się z mapą dojrzałości cyfrowej. Sektory, które już przeszły znaczącą transformację cyfrową, stanowią żyzny grunt, na którym teraz zakorzenia się sztuczna inteligencja.

Z tego wynika, że dla tradycyjnych branż, takich jak budownictwo czy produkcja, głównym wyzwaniem może nie być sama technologia AI, ale bardziej fundamentalny brak digitalizacji i infrastruktury danych.

Efektywne wdrożenie AI wymaga solidnej infrastruktury danych, umiejętności zarządzania nimi oraz zdigitalizowanych procesów biznesowych. Tradycyjne sektory często pozostają w tyle pod względem tych podstawowych zdolności cyfrowych.

Dlatego decydenci i firmy z tych branż nie mogą po prostu „wdrożyć AI”. Muszą najpierw zająć się fundamentami digitalizacji. Wyzwanie związane z adopcją AI jest w wielu przypadkach symptomem głębszej luki w dojrzałości cyfrowej. Próba narzucenia rozwiązań AI firmom, które nie posiadają podstawowej infrastruktury danych, jest przepisem na porażkę.

Poza modnymi hasłami: jakich technologii AI faktycznie używają europejskie firmy?

Ta sekcja oddziela marketingowy szum od biznesowej rzeczywistości, analizując, które konkretne narzędzia AI są wdrażane w europejskich firmach. Okazuje się, że obecny boom jest w przeważającej mierze napędzany przez technologie językowe, co odzwierciedla fundamentalną zmianę na rynku i potężny wpływ generatywnej sztucznej inteligencji.

W 2024 roku najczęściej stosowaną technologią AI w UE jest text mining, czyli analiza języka pisanego, wykorzystywana przez 6,9% wszystkich przedsiębiorstw. Tuż za nią plasuje się generowanie języka naturalnego (NLG), z którego korzysta 5,4% firm, oraz rozpoznawanie mowy (4,8%).

Jest to znacząca zmiana w stosunku do 2023 roku, kiedy to najpopularniejszą technologią była automatyzacja przepływu pracy (3%), a z NLG korzystało zaledwie 2,1% firm. W ciągu jednego roku wykorzystanie text miningu i NLG wzrosło ponad dwukrotnie, co jest bezpośrednim dowodem na wpływ rewolucji generatywnej AI.

Do czego firmy wykorzystują te narzędzia? Głównym celem biznesowym wdrożeń AI jest marketing i sprzedaż (34,1% firm korzystających z AI), a na drugim miejscu znajduje się organizacja procesów administracyjnych i zarządzania (27,5%).

Zastosowania te idealnie wpisują się w możliwości modeli językowych, które doskonale radzą sobie z tworzeniem treści marketingowych, komunikacją z klientami (chatboty) oraz podsumowywaniem informacji.

W przeciwieństwie do tego, bardziej złożone zastosowania, takie jak uczenie maszynowe do analizy danych, są wykorzystywane przez mniejszy odsetek firm ogółem, chociaż jest to druga najpopularniejsza technologia w grupie dużych przedsiębiorstw.

Dominacja technologii takich jak text mining i NLG sugeruje, że duża część obecnej fali adopcji reprezentuje „płytką integrację”. Są to często samodzielne narzędzia lub interfejsy API włączane do istniejących procesów – na przykład użycie generatywnej AI do pisania tekstów marketingowych.

Jest to coś zupełnie innego niż „głęboka integracja”, która polegałaby na przebudowie kluczowego procesu produkcyjnego w oparciu o predykcyjny model uczenia maszynowego. Dominujące technologie są oparte na języku i często dostępne jako gotowe oprogramowanie.

Główne obszary zastosowań to funkcje wsparcia, takie jak marketing i administracja, a nie kluczowe operacje w większości branż. Głęboka integracja, na przykład wykorzystanie uczenia maszynowego w procesach produkcyjnych, wymaga znaczących nakładów na inżynierię danych, tworzenie niestandardowych modeli i przeprojektowanie procesów, co jest znacznie bardziej złożone i kosztowne.

Potwierdza to raport Accenture, który wskazuje, że w Europie zaledwie 8% dużych inwestycji w AI, mających na celu transformację operacji biznesowych, zostało wdrożonych na szeroką skalę, a wiele firm utknęło w „fazie pilotażowej”. Wniosek jest jasny: wzrost wskaźnika adopcji do 13,5% jest realny, ale jest on silnie przechylony w stronę łatwiejszych do wdrożenia, płytko zintegrowanych narzędzi. To kluczowe rozróżnienie między szumem a rzeczywistością. Choć wiele firm używa dziś AI, znacznie mniej jest przez nią fundamentalnie transformowanych.

Anatomia lidera: dogłębna analiza strategii AI Danii

Aby zrozumieć, co napędza sukces w dziedzinie adopcji AI, warto przyjrzeć się bliżej niekwestionowanemu liderowi Unii Europejskiej – Danii. Analiza duńskiego przypadku pokazuje, że czołowa pozycja w rankingu nie jest dziełem przypadku, lecz wynikiem proaktywnej, spójnej i dobrze finansowanej narodowej strategii.

To studium przypadku może stanowić wzór dla innych państw dążących do przyspieszenia swojej transformacji cyfrowej.

Wynik mówi sam za siebie: Dania, z wskaźnikiem adopcji AI w przedsiębiorstwach na poziomie 27,6%, zdecydowanie wyprzedza resztę UE. Za tym sukcesem stoi narodowa „Strategia na rzecz Sztucznej Inteligencji”, uruchomiona w 2019 roku i wzmocniona w 2023.

Nie jest to jedynie dokument programowy, ale konkretny plan działania, wsparty dedykowanym finansowaniem w wysokości 200 milionów euro na badania i rozwój.

Strategia Danii opiera się na kilku kluczowych filarach, które razem tworzą spójny ekosystem sprzyjający innowacjom:

- Fundament etyczny i zorientowany na człowieka: Duńska strategia od samego początku kładzie nacisk na stworzenie wspólnych, etycznych ram dla AI. Koncentruje się na zaufaniu, samostanowieniu obywateli i poszanowaniu ludzkiej godności. Takie podejście buduje zaufanie zarówno społeczne, jak i biznesowe, redukując jedną z kluczowych barier adopcji.

- Ukierunkowanie na kluczowe sektory: Zamiast rozpraszać wysiłki, strategia identyfikuje priorytetowe obszary, w których AI może przynieść największe korzyści: opiekę zdrowotną, energetykę, rolnictwo i transport. Pozwala to na koncentrację zasobów i tworzenie wyspecjalizowanych rozwiązań.

- Wsparcie dla biznesu, zwłaszcza MŚP: Strategia zawiera konkretne inicjatywy mające na celu wsparcie firm. Przykładem jest fundusz inwestycyjny Duńskiego Funduszu Wzrostu, skierowany do firm opierających swój model biznesowy na AI, oraz program „Sprint:Digital”, który pomaga MŚP w transformacji cyfrowej.

- Przywództwo sektora publicznego: Jednym z głównych celów jest wykorzystanie AI przez sektor publiczny do oferowania „usług na światowym poziomie”. Tworzy to wewnętrzny popyt na innowacje, promuje najlepsze praktyki i pokazuje korzyści płynące z technologii.

- Nacisk na współpracę: Duńska strategia promuje tworzenie ekosystemu opartego na współpracy, zwłaszcza z dynamicznymi startupami. Podobne podejście widać u innego lidera, Belgii, gdzie aż 90% firm uważa współpracę ze startupami za kluczową dla rozwoju AI.

Sukces Danii sugeruje, że proaktywna, oparta na inwestycjach strategia narodowa, skoncentrowana na budowaniu wspierającego ekosystemu, jest skuteczniejsza w napędzaniu adopcji niż ogólnoeuropejskie podejście, które często stawia regulacje na pierwszym miejscu.

Podczas gdy unijny Akt o AI ma na celu stworzenie jednolitego, godnego zaufania rynku, jego złożoność może w krótkim okresie generować niepewność i spowalniać adopcję. Model duński skupia się na budowaniu zdolności i zaufania od podstaw.

Dania posiada jasną, dobrze finansowaną i holistyczną strategię AI, która wyprzedza pełne wdrożenie unijnych przepisów. Jednocześnie, niektóre źródła wskazują na niepewność prawną i nadmierną regulację jako potencjalne bariery adopcji w szerszym kontekście europejskim.

Przywództwo w dziedzinie adopcji AI nie jest więc przypadkowe. Jest wynikiem świadomej, dobrze realizowanej narodowej polityki przemysłowej. Przypadek Danii dowodzi, że rząd może aktywnie kształtować rynek i tworzyć środowisko sprzyjające sukcesowi, a nie tylko je regulować. To potężna lekcja dla innych państw członkowskich UE.

Blokady na drodze do rewolucji: bariery hamujące Europę

Skoro potencjał sztucznej inteligencji jest tak ogromny, dlaczego wskaźnik adopcji nie sięga 50% lub więcej? Odpowiedź leży w szeregu barier, które hamują szerszą i głębszą integrację AI w europejskiej gospodarce. Analiza tych przeszkód pokazuje, że największym wyzwaniem nie jest technologia sama w sobie, ale czynnik ludzki i otoczenie regulacyjne.

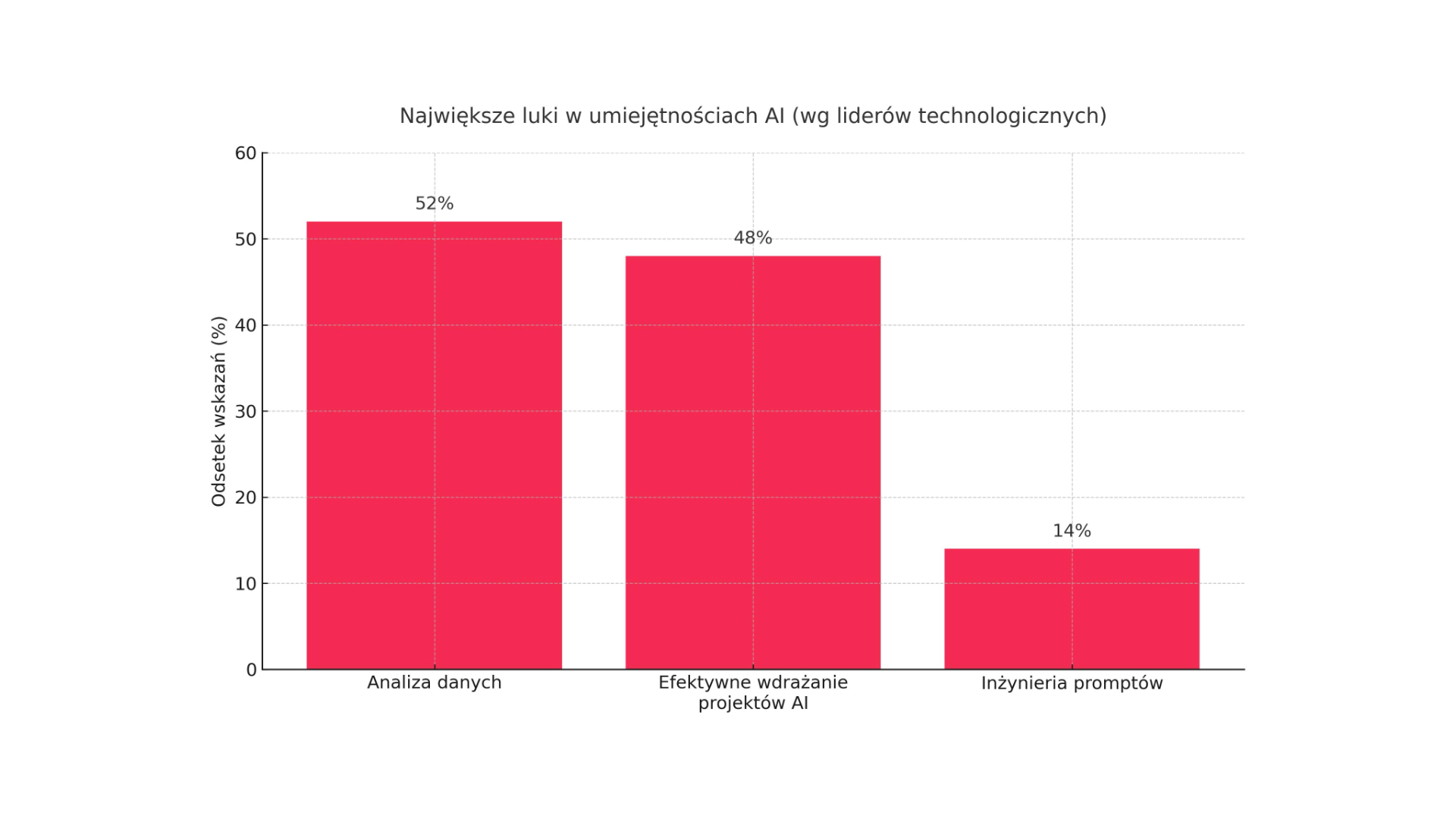

- Główna bariera: brak umiejętności. We wszystkich badaniach i raportach jeden czynnik wysuwa się na pierwszy plan jako największa przeszkoda: brak odpowiednich kompetencji i wiedzy eksperckiej. W jednym z badań z 2024 roku znaczenie tego czynnika wzrosło w percepcji firm w porównaniu z rokiem poprzednim, co pokazuje, że problem narasta. Nie chodzi tu tylko o zatrudnienie naukowców danych; chodzi o posiadanie pracowników, którzy potrafią identyfikować przypadki użycia AI, zarządzać projektami wdrożeniowymi i efektywnie współpracować z inteligentnymi systemami.

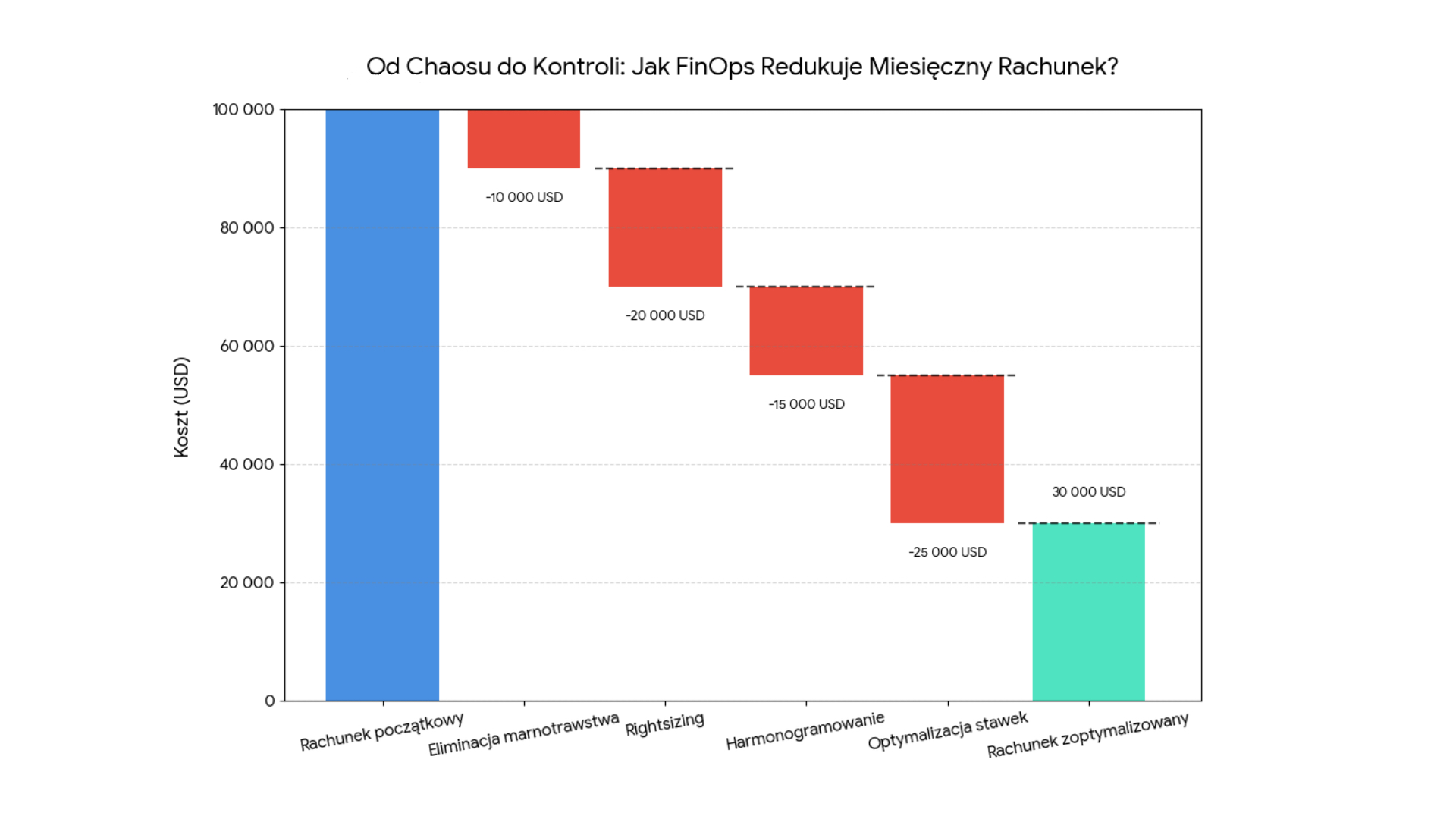

- Koszty i złożoność. Wysokie koszty wdrożenia i skomplikowanie technologii pozostają istotnymi barierami, zwłaszcza dla MŚP. Wskaźniki niepowodzeń projektów AI są wysokie na całym świecie (szacowane na 30-84%) i często wynikają z problemów organizacyjnych, a nie tylko technologicznych.

- Problemy z danymi. Dostępność i jakość danych to kolejna poważna przeszkoda. Wiele firm nie posiada czystych, ustrukturyzowanych i wystarczająco dużych zbiorów danych, niezbędnych do trenowania skutecznych modeli AI.

- Niepewność prawna i regulacyjna. Chociaż unijny Akt o AI ma na celu stworzenie jasnych ram, w krótkim okresie może być również źródłem niepewności. Obawy dotyczące konsekwencji prawnych, ochrony danych i prywatności są wymieniane jako istotne bariery. Niektóre głosy krytykują unijne podejście regulacyjne za potencjalne tłumienie innowacji w porównaniu z bardziej liberalnym podejściem w USA.

- Opór kulturowy. Kultura niechęci do ryzyka i konserwatyzm w podejściu do zmiany procesów biznesowych są wskazywane jako bariery bardziej wyraźne w Europie niż w Stanach Zjednoczonych.

Europa znajduje się w strategicznym paradoksie. Jej flagowa polityka, Akt o AI, ma na celu zbudowanie długoterminowego zaufania, które jest niezbędne dla zrównoważonej adopcji technologii. Zapewnienie bezpieczeństwa i poszanowania praw podstawowych powinno teoretycznie zwiększyć zaufanie firm i społeczeństwa.

Jednak w krótkim okresie, obciążenia związane z zapewnieniem zgodności i niejasności prawne mogą działać jak hamulec dla innowacji i adopcji, zwłaszcza dla mniejszych firm, które nie dysponują rozbudowanymi działami prawnymi.

Firmy wskazują „niejasne regulacje prawne” i „brak klarowności co do konsekwencji prawnych” jako istotne bariery. To kontrastuje z bardziej rynkowym podejściem USA, które sprzyja szybszym innowacjom, ale budzi więcej obaw etycznych.

Europa dokonuje więc strategicznego wyboru: stawia na to, że fundament zaufania ostatecznie doprowadzi do stworzenia bardziej solidnego i zorientowanego na człowieka ekosystemu AI. Ceną za to jest jednak niższa prędkość i zwinność w krótkim okresie.

Nie jest to podejście jednoznacznie dobre lub złe, ale jest to kluczowa decyzja strategiczna, która pomaga wyjaśnić, dlaczego Europa może wydawać się „spóźniona” w surowych wskaźnikach adopcji, jednocześnie próbując przewodzić w dziedzinie odpowiedzialnej implementacji.

Oddzielając hype od rzeczywistości – przyszłość AI w europejskim biznesie

Analiza danych dotyczących adopcji sztucznej inteligencji w Europie prowadzi do jednoznacznych, choć złożonych wniosków. Obraz, który się wyłania, to nie jednolity marsz ku przyszłości, ale raczej mozaika skoncentrowanej doskonałości, dynamicznego, choć płytkiego wzrostu i ogromnego, wciąż niewykorzystanego potencjału.

Liderem jest region, a nie pojedynczy kraj. Prawdziwym liderem adopcji AI w Europie nie jest jedno państwo, ale blok regionalny obejmujący kraje nordyckie i Beneluks. Ich sukces opiera się na solidnym fundamencie wysokiej dojrzałości cyfrowej oraz proaktywnych, skoncentrowanych na ekosystemie strategiach narodowych.

Hype napędza realny, ale „płytki” wzrost. Szum wokół generatywnej AI nie jest pusty; stał się bezpośrednim katalizatorem gwałtownego wzrostu adopcji. Jednakże, jest to w dużej mierze adopcja „płytka” – skoncentrowana na łatwo dostępnych narzędziach językowych, stosowanych w funkcjach wsparcia, takich jak marketing i administracja. Brakuje jeszcze głębokiej, transformacyjnej integracji AI z kluczowymi procesami biznesowymi w większości firm.

Rzeczywistość to Europa dwóch prędkości. Europejski krajobraz AI jest zdefiniowany przez głębokie podziały: między cyfrowo zaawansowaną Północą a Południem i Wschodem; między wielkimi korporacjami a sektorem MŚP; oraz między sektorami cyfrowymi a tradycyjnymi gałęziami przemysłu. Korzyści płynące z rewolucji AI obecnie kumulują się w niewielkim, elitarnym segmencie europejskiej gospodarki.

Głównym wąskim gardłem jest człowiek. Największym wyzwaniem dla Europy nie jest dostęp do technologii, ale powszechny niedobór umiejętności i wiedzy eksperckiej w dziedzinie AI. Pokonanie tej luki talentów jest najważniejszym czynnikiem, który może odblokować szerszą adopcję.