Przez lata relacja między CIO a CFO przypominała małżeństwo z długim stażem, które komunikuje się głównie za pomocą lakonicznych notatek zostawianych na lodówce. Dyrektor ds. technologii prosił o budżet na „rozwiązania, których nikt poza nim nie rozumie”, a dyrektor finansowy odpowiadał pytaniem o optymalizację kosztów, traktując serwerownię jak zło konieczne – kosztowną czarną skrzynkę, którą najlepiej byłoby przenieść w całości do chmury i o niej zapomnieć.

Ten model właśnie przechodzi do historii. Najnowszy raport Deloitte, oparty na badaniu liderów z ponad 500 amerykańskich korporacji, nie pozostawia złudzeń: nadchodzi finansowe tsunami, którego nie da się przeczekać w silosie.

Prognozowane potrojenie budżetów na infrastrukturę AI do 2028 roku to moment krytyczny, w którym technologia staje się zbyt kosztowna, zbyt energochłonna i – co najważniejsze – zbyt strategiczna, by jej nadzór zostawić wyłącznie w rękach inżynierów. Gdy wydatki na moc obliczeniową rosną czterokrotnie w ciągu kilku lat, przestają być problemem działu IT, a stają się kwestią suwerenności i przetrwania całej organizacji.

Zacieranie granic to proces bolesny, ale fascynujący. Arkusz kalkulacyjny CFO i schemat architektury hybrydowej CIO przestają być dwoma różnymi dokumentami. Czas porzucić tłumaczy i dyplomatyczne protokoły – liderzy jutra muszą stać się dwujęzyczni, ponieważ błąd w komunikacji między „piętrem zarządu” a „serwerownią” może kosztować fortunę.

Finansowy szok kulturowy

Przez ostatnią dekadę mantrą dyrektorów finansowych było „OpEx ponad wszystko”. Chmura publiczna miała być lekiem na całe zło – elastycznym kosztem, który można skalować w górę lub w dół, unikając kosztownego utrzymywania własnych „mieszkań dla serwerów”. Jednak sztuczna inteligencja, ze swoim nienasyconym apetytem na moc obliczeniową, brutalnie weryfikuje ten optymizm.

Z raportu Deloitte płynie jasny wniosek: tradycyjny model wydatków na IT, oparty na jednorazowych zrywach modernizacyjnych, odchodzi do lamusa. Zamiast cyklicznych projektów „wymiany floty”, działy IT przechodzą na model stałych, wysokich i rosnących wydatków rocznych. AI nie jest bowiem sprintem, po którym można odpocząć; to wyścig zbrojeń, w którym paliwo – czyli moc obliczeniowa – drożeje wraz z każdym nowym wdrożeniem.

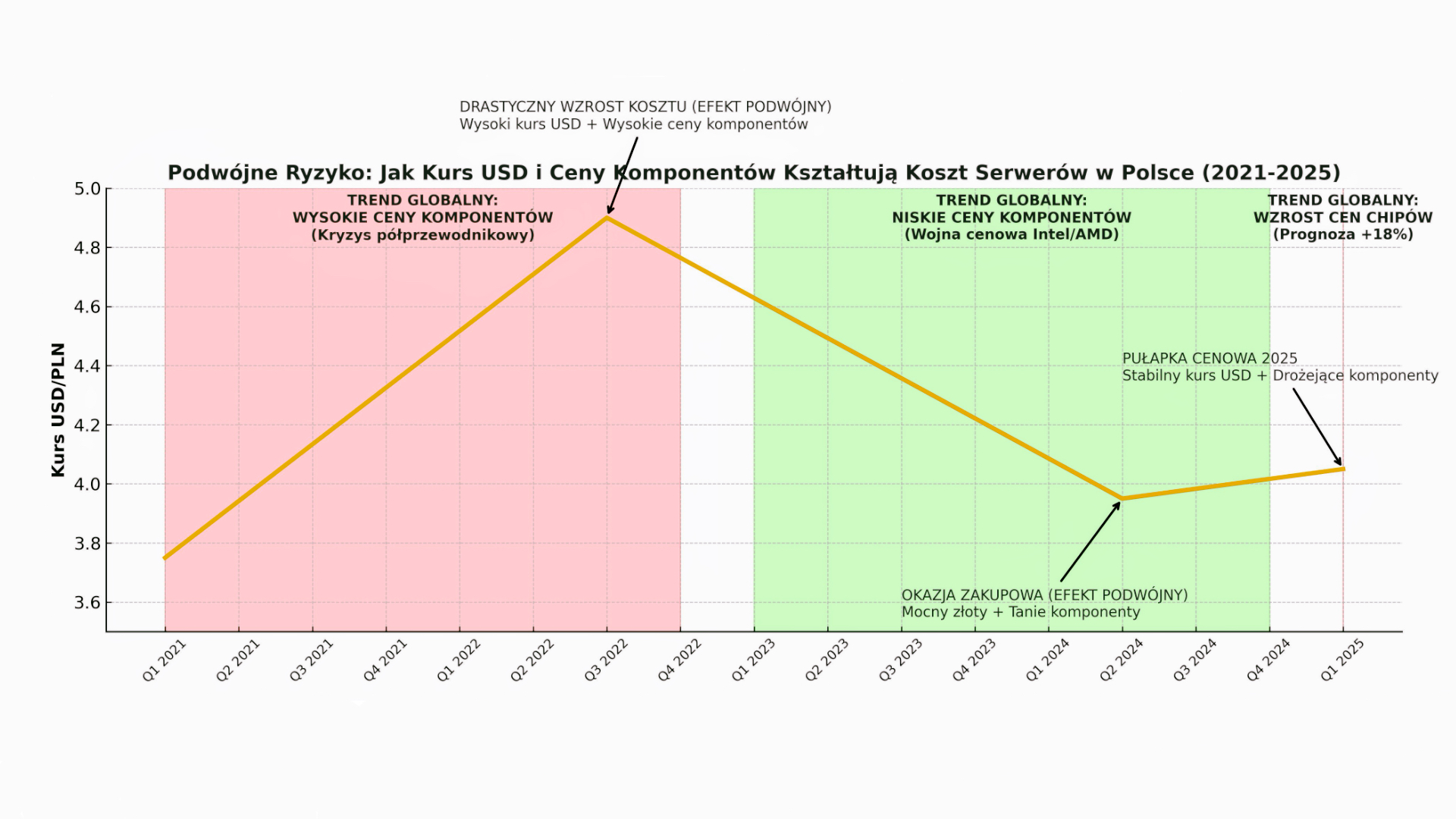

Co ciekawe, obserwujemy fascynujący zwrot akcji: powrót do łask modelu CapEx. Przedsiębiorstwa, które jeszcze niedawno dążyły do całkowitej „bezsprzętowości”, dziś ustawiają się w kolejce po własne procesory GPU i TPU. Dlaczego? Ponieważ przy skali, o której mówi Deloitte – gdzie ilość przetwarzanych tokenów podwaja się co rok – wynajmowanie „mocy” w chmurze staje się po prostu nieefektywne ekonomicznie.

Dla CFO to prawdziwy szok kulturowy. Muszą oni zaakceptować fakt, że posiadanie własnej, fizycznej infrastruktury AI staje się strategicznym aktywem, a nie tylko balastem operacyjnym. Własna serwerownia hybrydowa staje się polisą ubezpieczeniową na przyszłość. Firmy przestają pytać „ile nas to będzie kosztować w tym miesiącu”, a zaczynają kalkulować, ile mocy obliczeniowej muszą posiadać na własność, by ich modele nie utknęły w kolejce u hiperskalerów.

Pułapka „30 pilotów”, czyli gdzie uciekają pieniądze

Liczba „30 projektów pilotażowych” brzmi imponująco w raporcie rocznym i świetnie prezentuje się na slajdach dla akcjonariuszy. Jednak dla duetu CIO-CFO ta statystyka to przede wszystkim sygnał ostrzegawczy. Deloitte wskazuje, że do 2028 roku niemal 70% firm będzie prowadzić tak szeroko zakrojone testy AI. Problem w tym, że przy gwałtownie rosnących kosztach infrastruktury, rozproszenie środków na trzydzieści różnych frontów to prosta droga do uprawiania tzw. „teatru innowacji”.

W tym modelu dużo się dzieje, powstają dziesiątki prototypów, ale żaden z nich nie wychodzi poza fazę eksperymentu, by realnie zasilić rachunek zysków i strat. Skoro giganci tacy jak Anthropic rezerwują gigawaty mocy na lata do przodu, mniejsi gracze muszą wykazać się wręcz chirurgiczną precyzją w alokacji zasobów.

Tu właśnie objawia się nowa rola zarządu: CIO i CFO muszą wspólnie pełnić funkcję „strażników krzemu”. Ich zadaniem nie jest już tylko sprawdzanie, czy budżet się domyka, ale budowanie bezwzględnej hierarchii ważności. Każdy z 30 pilotów powinien przejść przez sito twardej analizy ROI: czy ten model realnie optymalizuje proces, czy jest tylko technologiczną ciekawostką?

Każda decyzja o przydzieleniu zasobów do konkretnego projektu jest de facto decyzją o tym, w którym obszarze firma chce zdobyć przewagę konkurencyjną, a który odpuszcza. Prawdziwa sztuka zarządzania w 2028 roku nie będzie polegała na tym, jak wiele projektów AI uda się uruchomić, ale na tym, ile z nich uda się zabić wystarczająco wcześnie, by te najbardziej obiecujące miały na czym pracować.

Nowa gramatyka biznesu: Tokeny zamiast roboczogodzin

„Granica między biznesem a technologią nie tylko się zaciera – ona przestaje istnieć” – te słowa Chrisa Thomasa z Deloitte powinny być wyryte nad wejściem do każdej współczesnej sali konferencyjnej. Tradycyjna gramatyka biznesu, oparta na roboczogodzinach, licencjach na użytkownika czy liczbie „miejsc” w systemie CRM, ustępuje miejsca nowej walucie: tokenom.

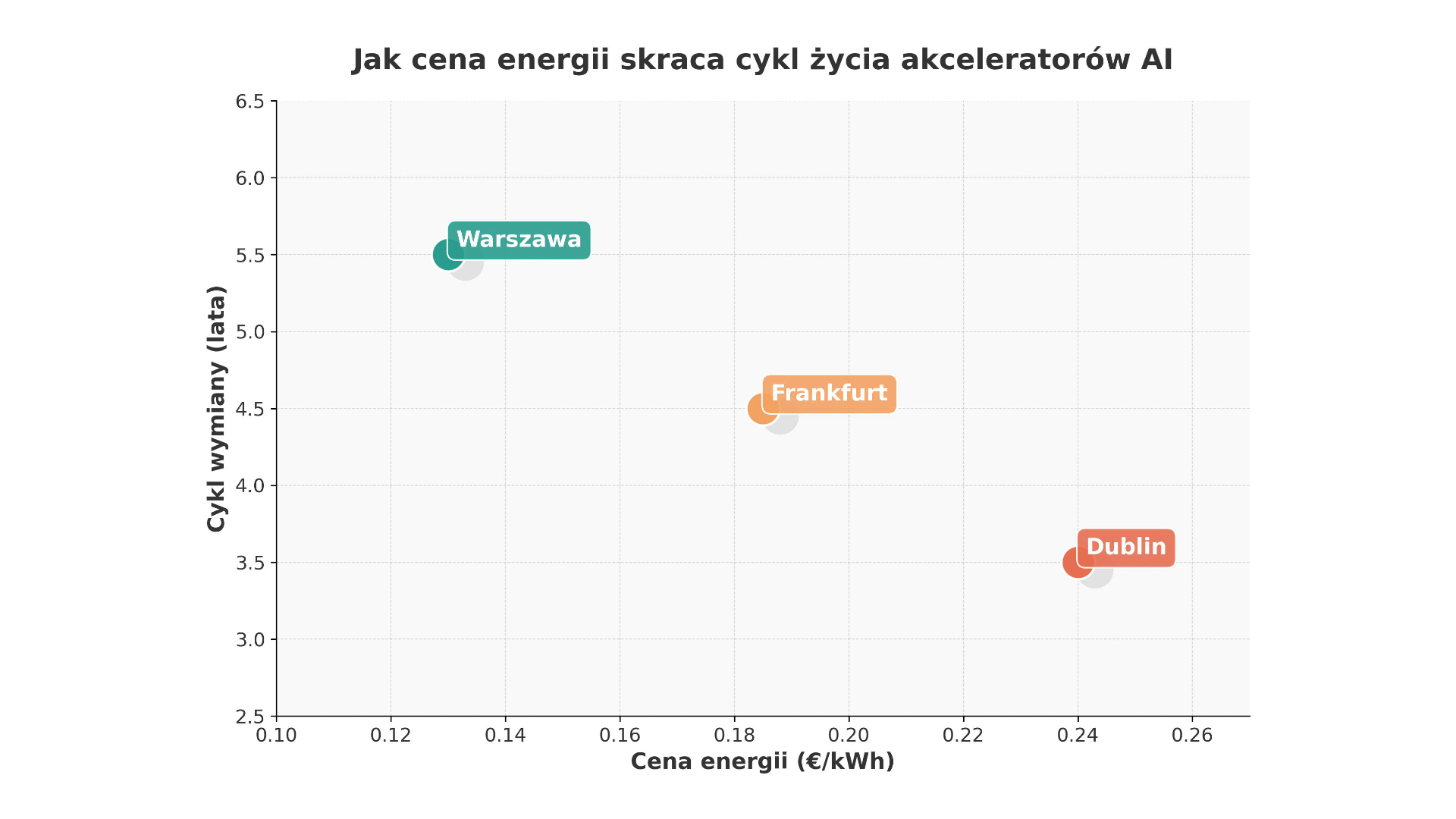

Dla CFO zrozumienie, czym jest token i jak wpływa on na bilans, staje się równie krytyczne, co analiza marży operacyjnej. Tokeny to krew w żyłach modeli AI, a ich wolumen bezpośrednio przekłada się na zapotrzebowanie na moc obliczeniową. Jeśli, jak przewiduje raport, ich ilość w procesach korporacyjnych ma się podwoić lub potroić w ciągu najbliższych trzech lat, to dyskusja o infrastrukturze przestaje być debatą o „zakupie sprzętu”. To debata o przepustowości całego przedsiębiorstwa i jego zdolności do generowania wartości.

W tym nowym rozdaniu infrastruktura AI awansuje z roli cichego zaplecza do roli głównego aktora na froncie walki o klienta. Firmy, które potrafią efektywnie zarządzać własnym „portfelem obliczeniowym” – umiejętnie łącząc modele zamknięte, otwarte i autorskie rozwiązania on-premise – zyskują elastyczność, o której konkurencja polegająca wyłącznie na gotowych usługach SaaS może tylko pomarzyć.

Strategiczna przewaga w 2028 roku nie będzie wynikać z posiadania najlepszych haseł marketingowych, ale z optymalizacji kosztu wygenerowania pojedynczej inteligentnej operacji. Infrastruktura staje się fundamentem innowacji: to ona określa, jak szybko firma może wdrażać nowe funkcje i jak głęboko może zautomatyzować swoje struktury. Ten, kto kontroluje dostęp do procesorów i optymalizuje ich wykorzystanie, de facto kontroluje tempo, w jakim jego biznes może rosnąć. To nowa ekonomia skali, w której hardware staje się najtwardszą z twardych walut biznesu.