Na Uniwersytecie Stanowym Karoliny Północnej robotyczne ramiona precyzyjnie mieszają chemikalia, a strumienie danych przepływają przez systemy w czasie rzeczywistym. To „samonapędzające się laboratorium”, platforma napędzana sztuczną inteligencją, odkrywa nowe materiały dla czystej energii i elektroniki nie w ciągu lat, ale dni.

Zbierając dane 10 razy szybciej niż tradycyjne metody, obserwuje reakcje chemiczne niczym pełnometrażowy film, a nie pojedynczą migawkę. To nie jest science fiction; to nowa rzeczywistość odkryć naukowych.

Ten niewiarygodny skok napędzany jest przez nowy rodzaj silnika obliczeniowego: wyspecjalizowane układy akceleratorów AI. To „krzemowe mózgi” rewolucji. Prawo Moore’a, stary paradygmat podwajania mocy obliczeniowej w układach ogólnego przeznaczenia, ustąpiło miejsca nowemu prawu postępu wykładniczego, napędzanemu przez masowe przetwarzanie równoległe.

Sedno tej historii jest jednak bardziej złożone. O ile algorytmy AI są oprogramowaniem nowej ery naukowej, o tyle fizyczny sprzęt – chipy AI – stał się fundamentalnym czynnikiem umożliwiającym postęp, a paradoksalnie, również jego największym wąskim gardłem.

Zdolność do odkrycia nowego leku ratującego życie lub zaprojektowania wydajniejszego ogniwa słonecznego jest dziś nierozerwalnie związana z hiperkonkurencyjnym, wielomiliardowym wyścigiem zbrojeń korporacyjnych oraz kruchym krajobrazem geopolitycznym, w którym dostęp do tych chipów jest narzędziem globalnej potęgi.

Anatomia boomu: kto buduje krzemowe mózgi?

Boom na generatywną sztuczną inteligencję stworzył nienasycony popyt na moc obliczeniową. Nie chodzi tu tylko o chatboty, ale o modele fundamentalne, które stanowią podstawę nowej fali badań naukowych. Ten popyt przekształcił niszowy rynek w globalne pole bitwy o dominację.

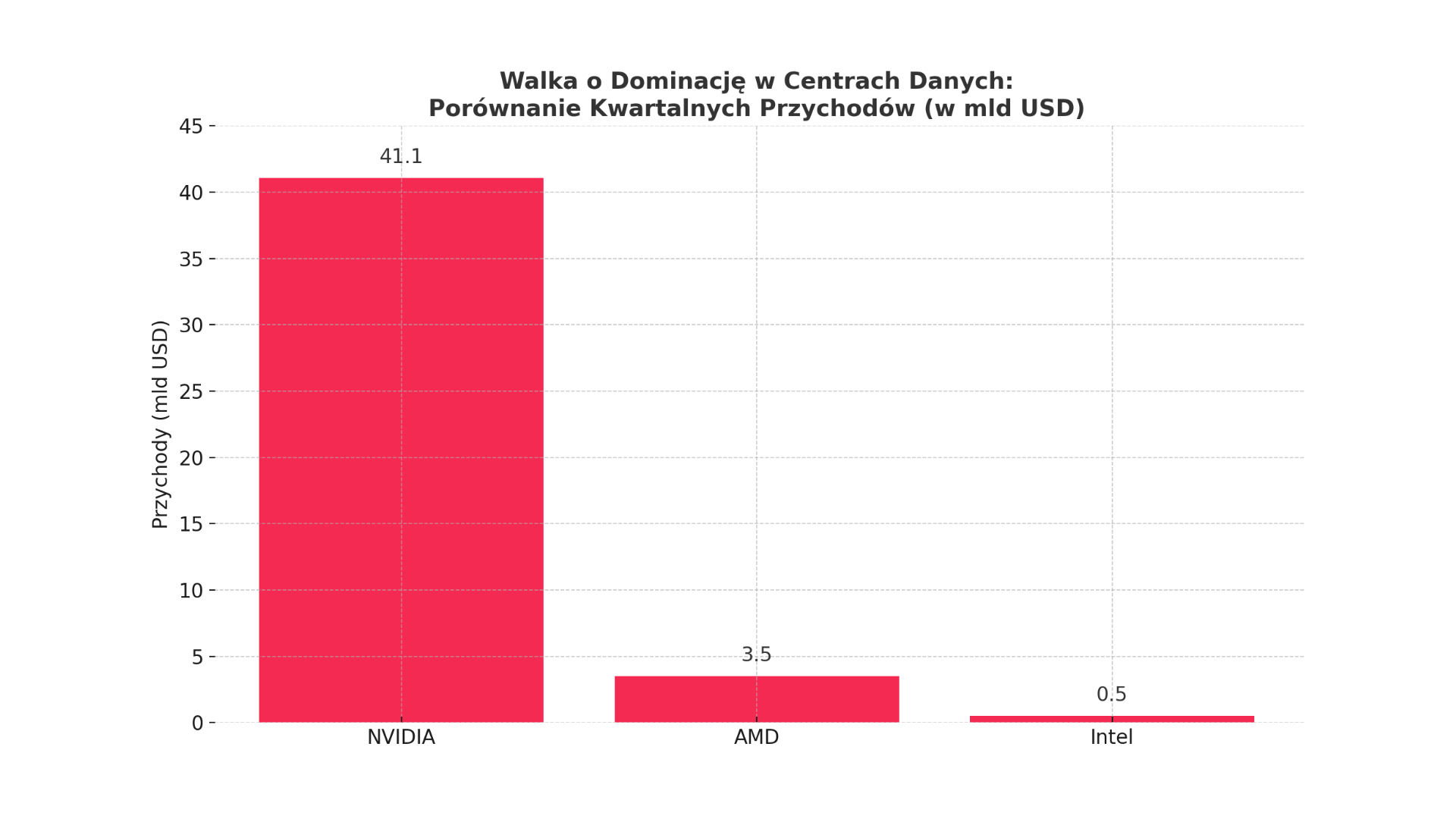

Panujący mistrz: NVIDIA

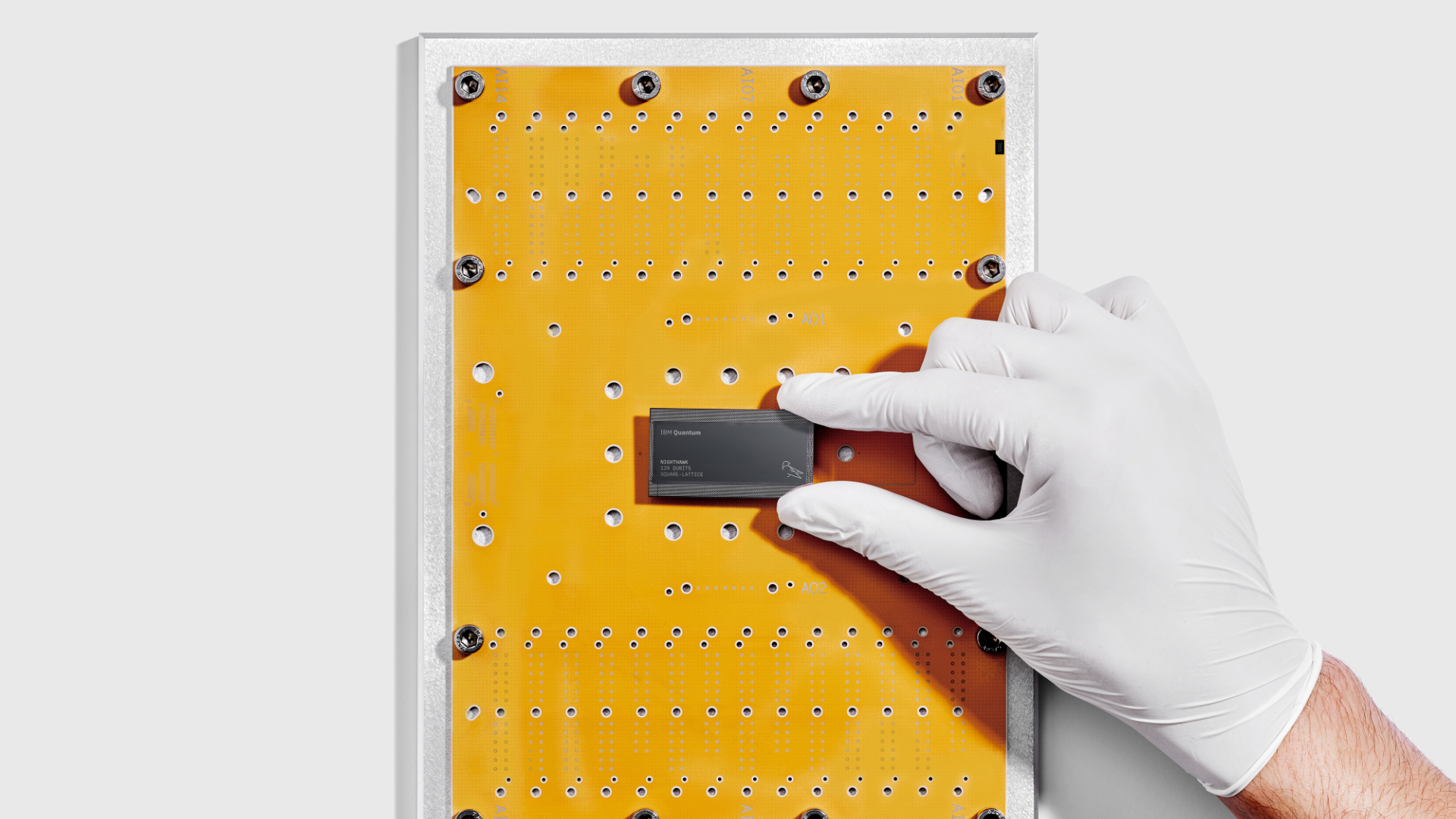

NVIDIA ugruntowała swoją pozycję głównego architekta rewolucji AI, co potwierdzają jej oszałamiające wyniki finansowe. Dział centrów danych, serce biznesu AI firmy, odnotował w jednym kwartale przychody w wysokości 41,1 mld USD, co stanowi wzrost o 56% rok do roku.

Dominacja ta opiera się na kolejnych generacjach potężnych architektur, takich jak Hopper, a teraz Blackwell, które są podstawowym sprzętem dla gigantów technologicznych, takich jak Microsoft, Meta i OpenAI .

Energiczny pretendent: AMD

AMD pozycjonuje się nie jako odległy numer dwa, ale jako poważny i szybko rosnący konkurent. Firma odnotowała rekordowe przychody z centrów danych w wysokości 3,5 mld USD w trzecim kwartale 2024 roku, co oznacza ogromny wzrost o 122% rok do roku, napędzany silnym przyjęciem akceleratorów GPU z serii Instinct.

Co istotne, główni dostawcy usług chmurowych oraz firmy takie jak Microsoft i Meta aktywnie wdrażają akceleratory MI300X od AMD, co sygnalizuje chęć posiadania realnej alternatywy dla NVIDII. Firma prognozuje, że jej przychody z GPU dla centrów danych przekroczą 5 mld USD w 2024 roku.

Gambit historycznego giganta: Intel

Sytuacja Intela stanowi strategiczne wyzwanie. Mimo że firma twierdzi, iż jej akceleratory Gaudi 3 oferują lepszy stosunek ceny do wydajności w porównaniu z H100 NVIDII , ma trudności ze zdobyciem udziału w rynku.

Intel nie osiągnął swojego celu przychodów w wysokości 500 mln USD dla Gaudi w 2024 roku, wskazując na wolniejszą niż oczekiwano adopcję z powodu problemów z przejściem między generacjami produktów oraz, co kluczowe, wyzwań związanych z „łatwością użycia oprogramowania”.

Analiza tych danych ujawnia głębsze trendy. Po pierwsze, rynek sprzętu AI to nie tylko wyścig na komponenty, ale wojna platform. Trudności Intela z oprogramowaniem wskazują na prawdziwe pole bitwy: ekosystem. Platforma CUDA firmy NVIDIA ma ponad dekadę przewagi, tworząc głęboką „fosę” narzędzi deweloperskich, bibliotek i wiedzy eksperckiej.

Konkurenci nie sprzedają tylko krzemu; muszą przekonać cały świat nauki i rozwoju do nauki nowego języka programowania. Po drugie, boom na AI prowadzi do pionowej integracji centrum danych.

NVIDIA nie tylko dominuje na rynku GPU, ale po przejęciu firmy sieciowej Mellanox w 2020 roku stała się również liderem w dziedzinie przełączników Ethernet, notując wzrost sprzedaży o 7,5x rok do roku.

NVIDIA nie sprzedaje już tylko chipów; sprzedaje kompletny, zoptymalizowany projekt „fabryki AI”, tworząc jeszcze silniejszy efekt „lock-in”.

Od laboratorium do rzeczywistości: przełomy naukowe napędzane krzemem

Ta bezprecedensowa moc obliczeniowa jest paliwem dla rewolucji w sposobie, w jaki prowadzimy badania naukowe, co prowadzi do przełomów, które jeszcze kilka lat temu wydawały się niemożliwe.

Medycyna jutra

Tradycyjny, trwający od 10 do 15 lat proces odkrywania leków ulega radykalnemu skróceniu. CEO DeepMind, Demis Hassabis, przewiduje, że AI skróci ten czas do „kwestii miesięcy”.

Isomorphic Labs, spółka zależna DeepMind, wykorzystuje AI do modelowania złożonych systemów biologicznych i przewidywania interakcji między lekami a białkami. Naukowcy z Virginia Tech opracowali narzędzie AI o nazwie ProRNA3D-single, które tworzy modele 3D interakcji białko-RNA – kluczowe dla zrozumienia wirusów i chorób neurologicznych, takich jak Alzheimer.

Co więcej, nowe narzędzie z Harvardu, PDGrapher, wykracza poza model „jeden cel, jeden lek”. Wykorzystuje grafową sieć neuronową do mapowania całego złożonego systemu chorej komórki i przewiduje kombinacje terapii, które mogą przywrócić ją do zdrowia.

Klimat w wysokiej rozdzielczości

Dawniej dokładne modelowanie klimatu wymagało superkomputera. Dziś modele AI, takie jak NeuralGCM od Google, mogą działać na pojedynczym laptopie . Ten model, wytrenowany na dziesięcioleciach danych pogodowych, pomógł przewidzieć nadejście monsunu w Indiach z miesięcznym wyprzedzeniem, dostarczając kluczowe prognozy 38 milionom rolników.

Nowy model AI z Uniwersytetu Waszyngtońskiego jest w stanie zasymulować 1000 lat klimatu Ziemi w zaledwie jeden dzień na jednym procesorze – zadanie, które superkomputerowi zajęłoby 90 dni.

Firmy takie jak Google DeepMind (WeatherNext), NVIDIA (Earth-2) i uniwersytety jak Cambridge (Aardvark Weather) budują w pełni napędzane przez AI systemy, które są szybsze, wydajniejsze i często dokładniejsze niż tradycyjne modele.

Alchemia XXI Wieku

Jak wspomniano na początku, AI tworzy autonomiczne laboratoria, które przyspieszają odkrywanie materiałów dziesięciokrotnie lub bardziej. Paradygmat zmienia się z przeszukiwania istniejących materiałów na generowanie zupełnie nowych.

Modele AI, takie jak MatterGen od Microsoftu, potrafią od podstaw projektować nowe materiały nieorganiczne o pożądanych właściwościach. Ta zdolność do „projektowania odwrotnego”, gdzie naukowcy określają potrzebę, a AI proponuje rozwiązanie, była świętym Graalem materiałoznawstwa.

Te przykłady ilustrują fundamentalną zmianę w samej metodzie naukowej. Komputer przestał być tylko narzędziem do analizy; stał się aktywnym uczestnikiem w generowaniu hipotez. Rola naukowca ewoluuje w kierunku kuratora potężnych systemów generatywnych.

To przyspiesza cykl odkryć w sposób wykładniczy i pozwala naukowcom badać znacznie większą „przestrzeń problemową”, niż było to kiedykolwiek możliwe dla człowieka.

Geopolityczna burza i nowy podział świata

W miarę jak rośnie znaczenie tych krzemowych mózgów, stają się one najcenniejszym zasobem strategicznym XXI wieku – nową ropą naftową, kluczową dla konkurencyjności gospodarczej i przywództwa naukowego.

Strategia USA: „mały ogródek, wysoki płot”

Stany Zjednoczone wdrożyły strategię „małego ogródka, wysokiego płotu”, wprowadzając kontrole eksportowe mające na celu spowolnienie zdolności Chin do rozwijania zaawansowanej AI. Ograniczenia te dotyczą nie tylko samych chipów (jak H100 NVIDII), ale także sprzętu niezbędnego do ich produkcji (od firm takich jak holenderska ASML).

W krótkim okresie uderzyło to w chiński przemysł półprzewodnikowy, powodując niedobory sprzętu i „okaleczając” jego zdolności produkcyjne.

Zdeterminowana odpowiedź Chin

Reakcja Chin była wielotorowa: ogromne inwestycje w krajowy przemysł półprzewodnikowy oraz wykorzystanie własnej dźwigni ekonomicznej poprzez ograniczenie eksportu kluczowych metali ziem rzadkich. Studium przypadku stanowi Huawei.

Mimo że firma została sparaliżowana przez sankcje, opracowała własną linię chipów AI Ascend (910B/C/D), które są obecnie postrzegane jako realna alternatywa dla produktów NVIDII w Chinach.

W odpowiedzi rząd USA zaostrzył stanowisko, oświadczając, że używanie tych chipów gdziekolwiek na świecie narusza amerykańskie kontrole eksportowe, co eskaluje podział technologiczny.

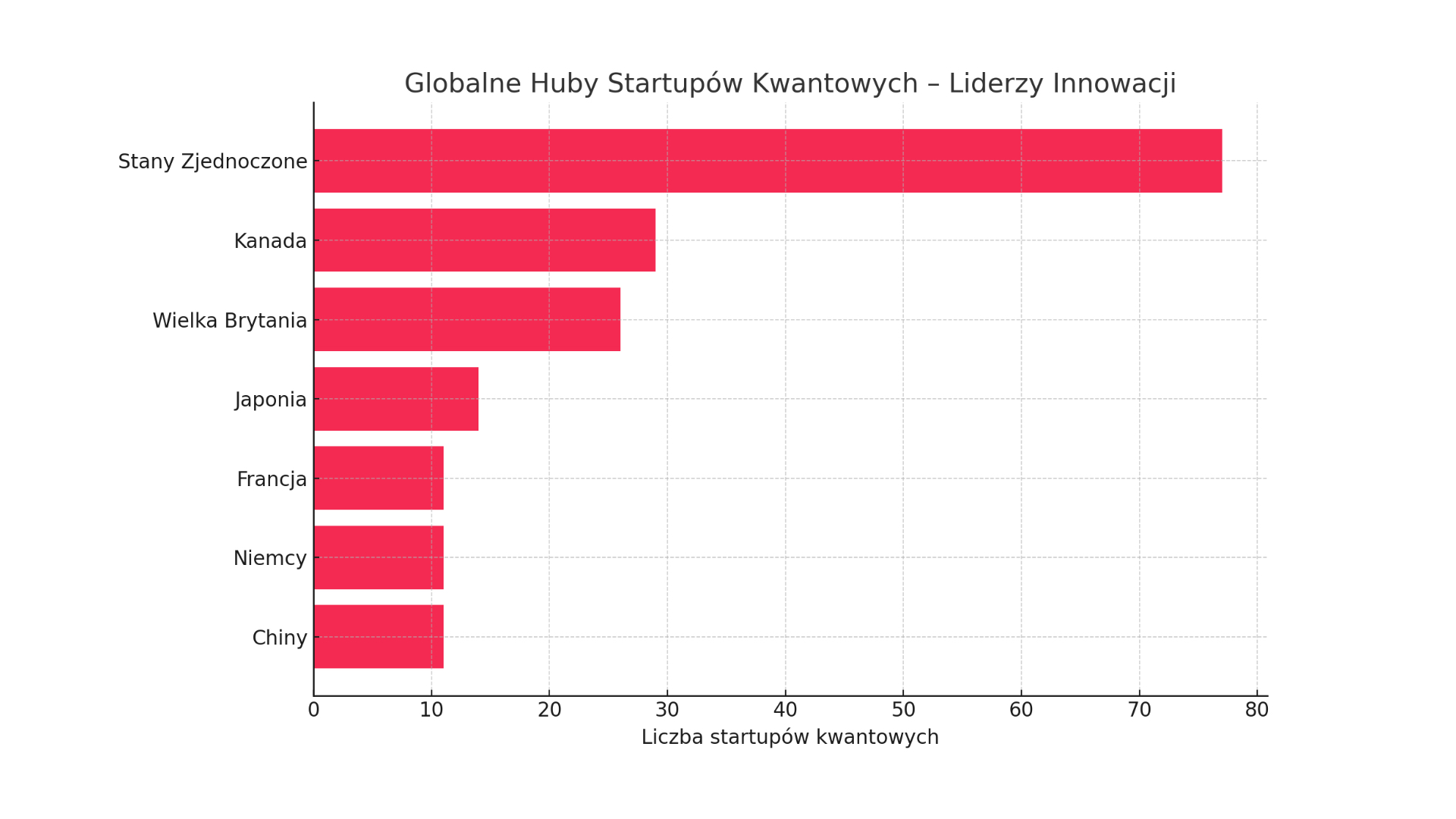

Badanie przeprowadzone przez Uniwersytet Oksfordzki ujawnia surową rzeczywistość: zaawansowane procesory graficzne są silnie skoncentrowane w zaledwie kilku krajach, głównie w USA i Chinach. Stany Zjednoczone przodują w dostępie do najnowocześniejszych chipów, podczas gdy znaczna część świata znajduje się na „obliczeniowych pustyniach”.

Ta sytuacja prowadzi do niezamierzonych konsekwencji. Amerykańskie kontrole eksportowe, mające na celu spowolnienie Chin, stały się dla nich „nieumyślnym akceleratorem innowacji”, zmuszając Pekin do zbudowania całkowicie niezależnego stosu technologicznego.

Za dekadę świat może mieć dwa całkowicie oddzielne, niekompatybilne stosy AI, co fundamentalnie podzieli globalne badania.

Chmura jako wielki równoważnik?

Istnieje potężna kontrargumentacja: chmura obliczeniowa demokratyzuje dostęp do elitarnej AI. Platformy takie jak Amazon Web Services (AWS), Microsoft Azure i Google Cloud oferują AI-as-a-Service (AIaaS), pozwalając uniwersytetowi lub startupowi wynająć te same potężne procesory graficzne, których używa OpenAI.

Giganci chmurowi oferują bogate ekosystemy. AWS udostępnia usługi takie jak SageMaker do budowy modeli i Bedrock do dostępu do wiodących modeli fundamentalnych. Google Cloud promuje demokratyzację za pomocą narzędzi takich jak Vertex AI, zaprojektowanych z myślą o minimalnej złożoności.

Microsoft Azure ściśle integruje AI ze swoim ekosystemem za pomocą Azure AI Foundry, oferując dostęp do ponad 1700 modeli i prowadząc dedykowane laboratoria badawcze „AI for Science”.

Obietnicę dostępu należy jednak zestawić z surową rzeczywistością kosztów. Trenowanie najnowocześniejszego modelu jest zaporowo drogie, a szacunki sięgają 78 mln USD dla GPT-4 i 191 mln USD dla Gemini Ultra. To prowadzi do powstania „dwupoziomowej demokracji” w badaniach nad AI.

Z jednej strony, każdy badacz z grantem może uzyskać dostęp do światowej klasy narzędzi AI. Jest to demokratyzacja zastosowania . Z drugiej strony, zdolność do trenowania nowego, wielkoskalowego modelu fundamentalnego od podstaw pozostaje wyłączną domeną garstki podmiotów: samych dostawców chmury i ich kluczowych partnerów.

To jest centralizacja tworzenia. Chmura „demokratyzuje” AI w taki sam sposób, w jaki biblioteka publiczna demokratyzuje dostęp do książek. Każdy może je czytać, ale tylko nieliczni mają zasoby, by je pisać i wydawać.

Przyszłość pisana w krzemie

Zapierające dech w piersiach tempo odkryć naukowych w medycynie, klimatologii i materiałoznawstwie jest bezpośrednią konsekwencją ogromnej mobilizacji przemysłowej i geopolitycznej wokół jednej technologii: akceleratora AI.

Postęp stał się kruchy i głęboko współzależny. Przełom naukowy nie jest już tylko funkcją genialnego umysłu. Zależy teraz również od kwartalnych raportów finansowych NVIDII i AMD, polityki handlowej uchwalanej w Waszyngtonie i Pekinie, stabilności łańcucha dostaw przechodzącego przez Tajwan oraz modeli cenowych AWS, Google i Microsoft.

Wkroczyliśmy w erę, w której przyszłość jest dosłownie pisana w krzemie. Wielkie wyzwania naszych czasów – leczenie chorób, walka ze zmianami klimatu, tworzenie zrównoważonej przyszłości – zostaną rozwiązane za pomocą tych nowych narzędzi.

Ale kto będzie mógł nimi władać i w jakim celu, pozostaje najważniejszym i nierozstrzygniętym pytaniem XXI wieku. Kolejna wielka rewolucja naukowa będzie transmitowana na żywo, ale prawa do jej transmisji są obecnie negocjowane w salach konferencyjnych korporacji i w korytarzach globalnej władzy.