Jeszcze dwa lata temu, u szczytu gorączki AI w 2024 roku, w salach zarządów padało tylko jedno pytanie: „Skąd wziąć procesory Nvidia?”. Dostępność układów scalonych była wąskim gardłem, które dyktowało tempo rozwoju technologicznego. Dziś, w styczniu 2026 roku, sytuacja uległa diametralnej zmianie. Łańcuchy dostaw sprzętu się udrożniły, magazyny dystrybutorów są pełne najnowszych układów Blackwell i Rubin. Mimo to, nowe inwestycje w centra danych stają w miejscu.

Pytanie roku 2026 nie brzmi już „Czy masz sprzęt?”, ale „Gdzie go podłączysz?”. Dostępność mocy przyłączeniowej (Power Availability) zastąpiła dostępność krzemu jako główny czynnik ryzyka operacyjnego. Wchodzimy w erę, w której o sukcesie projektu AI decyduje stara, analogowa infrastruktura energetyczna, a nie cyfrowy kod.

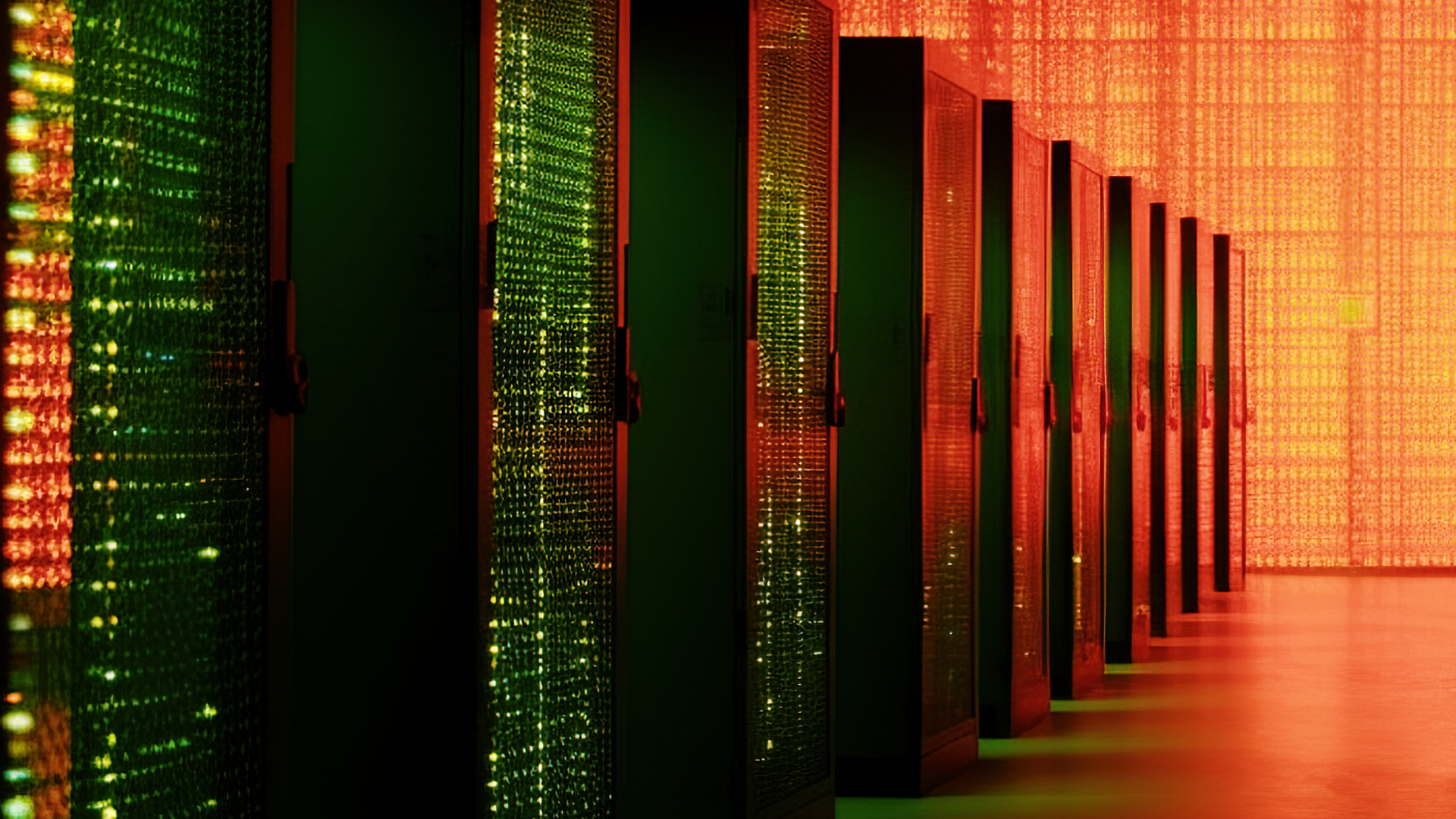

Nowe wąskie gardło. Geopolityka gniazdka

Średni czas oczekiwania na nowe przyłącze energetyczne o mocy powyżej 10 MW w kluczowych hubach Europy wydłużył się z 18 miesięcy w 2023 roku do szokujących 4–5 lat obecnie. Oznacza to, że decyzja o budowie serwerowni podjęta dzisiaj, zmaterializuje się operacyjnie dopiero w okolicach 2030–2031 roku. Dla branży technologicznej to wieczność.

Problem najmocniej uderza w tzw. rynek FLAP-D (Frankfurt, Londyn, Amsterdam, Paryż, Dublin). Te tradycyjne stolice danych są energetycznie nasycone. Operatorzy sieci przesyłowych w Holandii czy Irlandii odmawiają wydawania nowych warunków przyłączenia, wskazując na ryzyko destabilizacji krajowych systemów energetycznych.

W tym krajobrazie Warszawa – wyrastająca w ostatnich latach na kluczowy hub Europy Środkowo-Wschodniej – stała się ofiarą własnego sukcesu. Inwestycje gigantów takich jak Google, Microsoft czy lokalnych operatorów chmurowych, błyskawicznie skonsumowały dostępne rezerwy mocy w aglomeracji warszawskiej. Polskie Sieci Elektroenergetyczne (PSE) stają przed wyzwaniem fizyki: sieci w rejonie stolicy nie są w stanie przyjąć kolejnych gigawatowych obciążeń bez gruntownej modernizacji, która potrwa lata. Efekt? Inwestorzy zmuszeni są szukać lokalizacji alternatywnych – na północy Polski (gdzie łatwiej o energię z offshore wind) lub uciekać na południe Europy, gdzie łatwiej o energię słoneczną.

Fizyka AI: Dlaczego stare serwerownie „topią kable”?

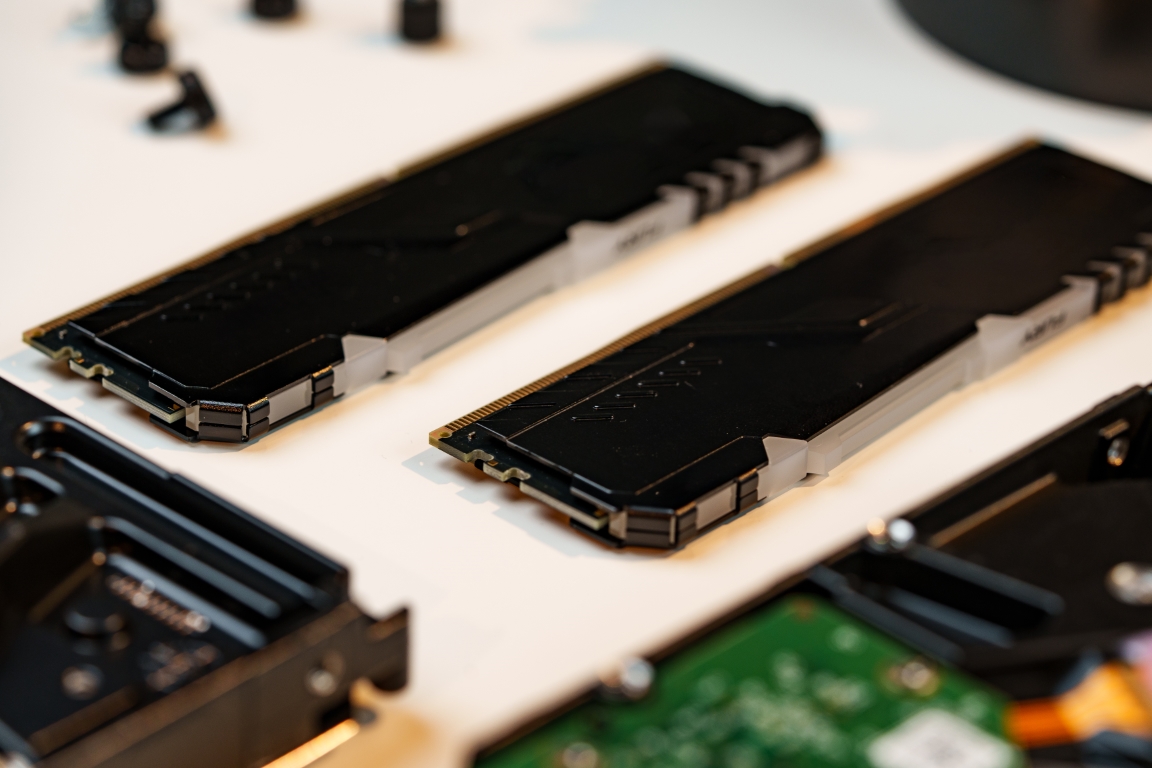

Kryzys energetyczny ma też drugie dno – techniczne. Nawet jeśli firma posiada miejsce w serwerowni wybudowanej w 2020 roku, często nie może tam zainstalować nowoczesnej infrastruktury AI. Wynika to z drastycznej zmiany w tzw. gęstości mocy (Rack Density).

W tradycyjnym IT standardem było 5–8 kW poboru mocy na jedną szafę serwerową (rack). Projektowano pod te wartości systemy zasilania i chłodzenia. Współczesne klastry AI, oparte na architekturze Nvidia Blackwell czy następcach, wymagają od 50 do nawet 100 kW na jedną szafę.

Próba wstawienia takiej infrastruktury do „starego” Data Center (sprzed 5 lat) kończy się fiaskiem. Budynek nie jest w stanie dostarczyć tylu amperów w jedno miejsce, a co ważniejsze – nie jest w stanie odprowadzić wygenerowanego ciepła. Próba chłodzenia szafy o mocy 100 kW tradycyjnym powietrzem (klimatyzacją precyzyjną) przypomina próbę chłodzenia silnika wyścigowego za pomocą biurowego wiatraka. Jest to fizycznie niemożliwe i nieopłacalne.

Rewolucja chłodzenia: Koniec ery powietrza?

W konsekwencji rok 2026 to moment ostatecznego triumfu technologii Liquid Cooling (chłodzenia cieczą). To, co jeszcze niedawno było domeną entuzjastów overclockingu i kopaczy kryptowalut, stało się korporacyjnym standardem.

Każda nowa inwestycja typu Hyperscale oddawana do użytku w tym roku jest projektowana w standardzie hybrydowym lub całkowicie cieczowym. Dominują dwie technologie:

- Direct-to-Chip (DLC): Gdzie ciecz chłodząca doprowadzana jest rurkami bezpośrednio do bloków wodnych na procesorach CPU i GPU. To rozwiązanie stało się wymogiem gwarancyjnym dla najnowszych serwerów.

- Immersion Cooling (Chłodzenie zanurzeniowe): Gdzie całe serwery są „topione” w wannach wypełnionych specjalnym płynem dielektrycznym (nieprzewodzącym prądu).

Zmiana ta jest napędzana nie tylko fizyką, ale i regulacjami unijnymi (EED – Energy Efficiency Directive). Chłodzenie cieczą jest znacznie bardziej efektywne energetycznie, a co więcej – pozwala na odzysk ciepła. Płyn opuszczający serwer ma temperaturę 60-70°C, co pozwala na wpięcie Data Center bezpośrednio do miejskiej sieci ciepłowniczej. W 2026 roku serwerownie stają się de facto cyfrowymi elektrociepłowniami, ogrzewającymi biurowce i osiedla, co jest kluczowe dla uzyskania pozwoleń środowiskowych.

Ekonomia niedoboru: Power Banking i atom

Niedobór mocy wywołał gwałtowny wzrost cen. Stawki za kolokację (wynajem powierzchni pod serwery) w Warszawie i Frankfurcie wzrosły r/r o 30–40%. Klienci nie negocjują już cen; licytują się o to, kto pierwszy podpisze umowę na „zasilone szafy”.

Zmieniła się również strategia deweloperów. Na rynku nieruchomości furorę robi zjawisko „Power Banking”. Fundusze inwestycyjne skupują stare, upadłe fabryki, huty czy zakłady przemysłowe. Nie interesują ich budynki (często przeznaczone do wyburzenia), lecz aktywne, wysokie przydziały mocy energetycznej przypisane do działki. Kupuje się „prawo do prądu”, by w miejscu dawnej odlewni postawić kontenery z serwerami AI.

Na szczycie piramidy inwestycyjnej widzimy zwrot ku energetyce jądrowej. Śladem Microsoftu i Amazona (głośne umowy z 2024/2025 roku), również europejscy gracze szukają możliwości zasilania swoich kampusów z małych reaktorów modułowych (SMR) lub poprzez bezpośrednie linie (PPA) z istniejących elektrowni jądrowych. Branża IT zrozumiała, że OZE (wiatr i słońce) są zbyt niestabilne dla AI, która musi „uczyć się” 24/7 ze stałym obciążeniem.

Nowy wskaźnik sukcesu – Time-to-Power

Dla Dyrektorów IT (CIO) planujących strategie na 2026 i 2027 rok, płynie z tego jedna, kluczowa lekcja: Hardware jest łatwy, prąd jest trudny.

Tradycyjny model, w którym najpierw zamawia się serwery, a potem szuka dla nich miejsca, jest martwy. Dziś proces należy odwrócić. Rezerwacja mocy w Data Center z wyprzedzeniem 12-24 miesięcznym jest koniecznością. Wskaźnik Time-to-Market (czas wdrożenia produktu) został zastąpiony przez Time-to-Power (czas uzyskania zasilania).

Cyfrowa rewolucja zależy dziś w stu procentach od analogowej infrastruktury. Bez masowych inwestycji w sieci przesyłowe i nowe źródła generacji, sztuczna inteligencja w Europie uderzy w szklany sufit – nie z braku danych czy algorytmów, ale z prozaicznego braku gniazdka, do którego można by ją podłączyć.