Decyzja prezydenta Donalda Trumpa o powołaniu Marka Zuckerberga, Jensena Huanga i Larry’ego Ellisona do Prezydenckiej Rady Doradców ds. Nauki i Technologii (PCAST) to sygnał, że administracja rezygnuje z roli surowego arbitra na rzecz partnera biznesowego, a Waszyngton oficjalnie uznaje AI za najważniejsze pole bitwy w strategicznej rywalizacji z Chinami.

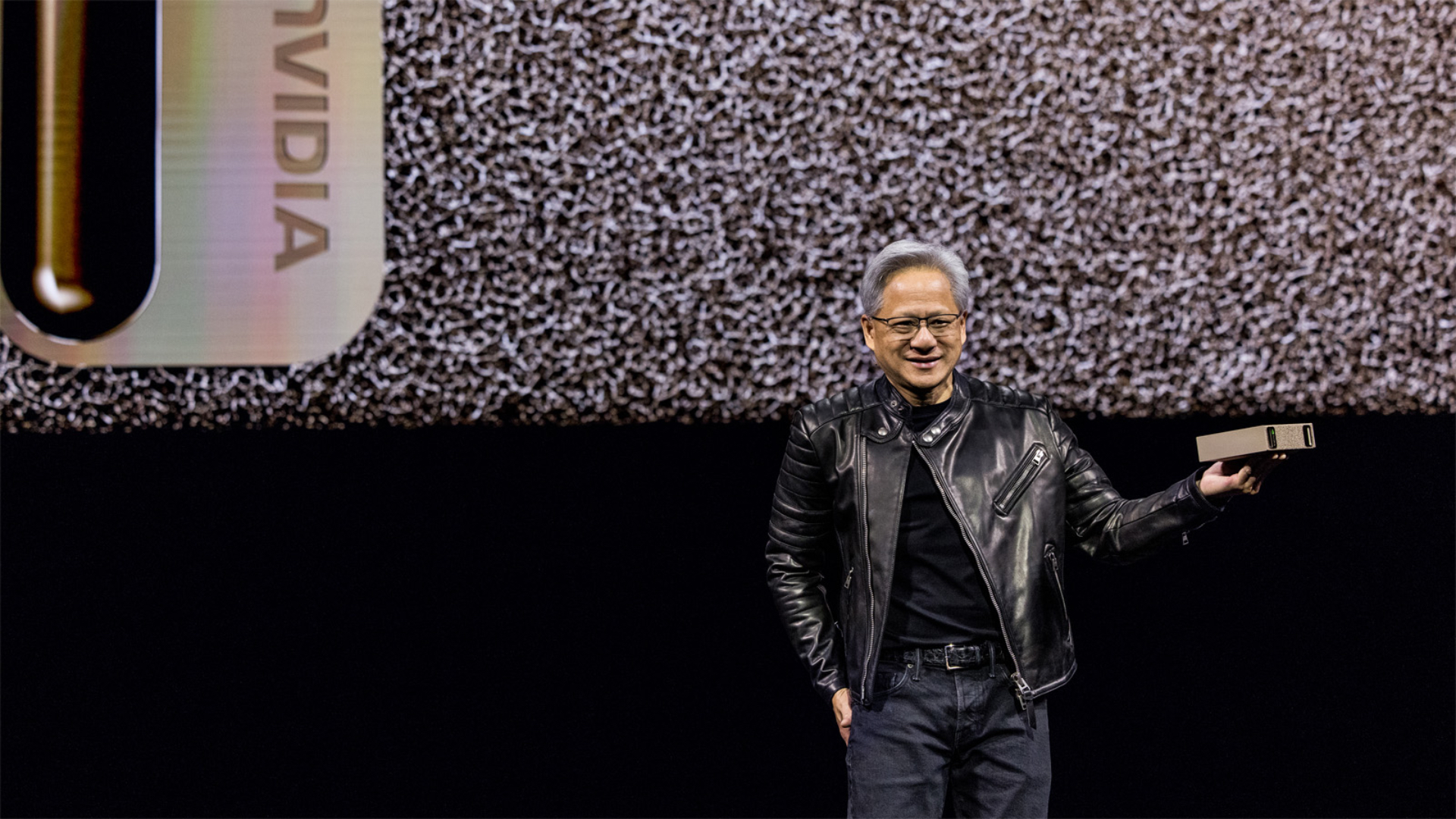

Skład rady przypomina listę gości najbardziej ekskluzywnej konferencji technologicznej świata. Obok liderów Mety, Nvidii i Oracle, w grupie znaleźli się Sergey Brin z Alphabetu oraz Lisa Su z AMD. Obecność tych nazwisk przy jednym stole z Davidem Sacksem, pełniącym funkcję „cara” ds. AI i krypto, sugeruje nową erę pragmatyzmu. Zamiast budować bariery regulacyjne, Biały Dom chce je demontować, co Trump zasygnalizował już w pierwszych dniach urzędowania, zlecając przygotowanie planu przyspieszenia innowacji.

Wybór Boba Mumgaarda z Commonwealth Fusion Systems do tego grona wskazuje dodatkowo, że administracja dostrzega nierozerwalny związek między rozwojem sztucznej inteligencji a koniecznością zapewnienia gigantycznych zasobów czystej energii, niezbędnych do zasilania centrów danych przyszłości.

To partnerstwo niesie jednak ze sobą istotne pytania o przejrzystość i wpływ wielkich korporacji na politykę państwa. Podczas gdy Zuckerberg i Huang publicznie deklarują chęć wzmacniania pozycji USA, inni, jak Oracle czy Alphabet, zachowują na razie powściągliwość. Niemniej, powołanie rady kończy okres niepewności co do kierunku, w którym podąży amerykańska legislacja w obszarze tech.

Kierunek jest jasny: deregulacja, dominacja rynkowa i ścisła symbioza między Doliną Krzemową a Pensylvania Avenue. W wyścigu o prymat w dziedzinie AI, Stany Zjednoczone właśnie postawiły na swoich najsilniejszych graczy, licząc, że ich prywatny interes okaże się tożsamy z interesem narodowym.