Wyobraźmy sobie dwa scenariusze. W pierwszym, jest rok 2003. Właściciel małej firmy produkcyjnej z niepokojem spogląda na milczący serwer, który sparaliżował system zamówień.

W panice dzwoni do swojego „człowieka od IT”, mając nadzieję, że ten znajdzie czas, by przyjechać i zdiagnozować problem. Każda minuta przestoju to wymierne straty.

W drugim scenariusze, jest dziś. Prezes firmy technologicznej otrzymuje powiadomienie na smartfona. To zautomatyzowany raport od jego dostawcy usług zarządzanych (Managed Service Provider, MSP), informujący, że w nocy wykryto i załatano potencjalną lukę w zabezpieczeniach firmowej chmury, zanim cyberprzestępcy zdążyli ją wykorzystać.

Działalność firmy nie została zakłócona nawet na sekundę.

Ten kontrast doskonale ilustruje fundamentalną transformację, jaka zaszła w świecie usług IT. Ewolucja dostawców usług zarządzanych to nie tylko historia adaptacji do nowych technologii.

To opowieść o całkowitej redefinicji modelu biznesowego, napędzanej przez eskalację zagrożeń cybernetycznych, rosnącą złożoność środowisk chmurowych oraz potrzebę automatyzacji.

Nowoczesny MSP przestał być jedynie zewnętrznym działem IT, wzywanym do gaszenia pożarów. Stał się kluczowym partnerem w zarządzaniu ryzykiem, motorem transformacji cyfrowej i strażnikiem ciągłości biznesowej.

Fundamenty przeszłości: era modelu „Break-Fix”

Zanim dostawcy usług IT stali się proaktywnymi partnerami, dominującym modelem działania był tzw. „break-fix”. Jego logika była prosta: gdy coś się psuje, wzywa się specjalistę, który to naprawia.

Proces był czysto transakcyjny: klient doświadczał awarii, technik przyjeżdżał, naprawiał i wystawiał fakturę za poświęcony czas i części.

Największą wadą tego modelu była jego fundamentalna struktura ekonomiczna, która tworzyła nieunikniony konflikt interesów. Dostawca usług IT zarabiał pieniądze tylko wtedy, gdy u klienta występowały problemy.

Im więcej awarii, tym wyższe zyski usługodawcy. Klient dążył do maksymalnej stabilności, podczas gdy model biznesowy dostawcy był uzależniony od niestabilności.

Ta strukturalna wada uniemożliwiała budowanie relacji opartej na zaufaniu i musiała ustąpić, gdy tylko firmy zrozumiały, że ich przetrwanie zależy od niezawodnej technologii.

Przełom proaktywności: narodziny nowoczesnego MSP

Zmierzch ery „break-fix” przyspieszyły technologie, które umożliwiły fundamentalną zmianę. Platformy do zdalnego monitorowania i zarządzania (RMM) oraz automatyzacji usług profesjonalnych (PSA) stały się katalizatorami rewolucji.

Narzędzia RMM pozwoliły dostawcom na ciągłe, zautomatyzowane monitorowanie stanu systemów klienta, umożliwiając identyfikację i rozwiązywanie problemów, zanim doprowadziły one do przestoju.

Najważniejszą innowacją była jednak zmiana modelu biznesowego. MSP odeszli od stawek godzinowych na rzecz stałej, miesięcznej opłaty abonamentowej (Monthly Recurring Revenue, MRR).

Dla klienta oznaczało to przewidywalność kosztów, a dla MSP stabilny strumień przychodów. Wprowadzenie umów o gwarantowanym poziomie świadczenia usług (SLA) dało klientom kontraktowe gwarancje dotyczące czasu reakcji czy dostępności systemów.

Co najważniejsze, ten model zjednoczył interesy obu stron. Rentowność MSP stała się wprost proporcjonalna do stabilności środowiska IT klienta. Każda awaria stanowiła teraz koszt dla dostawcy, a nie okazję do zarobku, motywując go do zapewnienia maksymalnej wydajności.

Imperatyw cyberbezpieczeństwa: od administratora do obrońcy

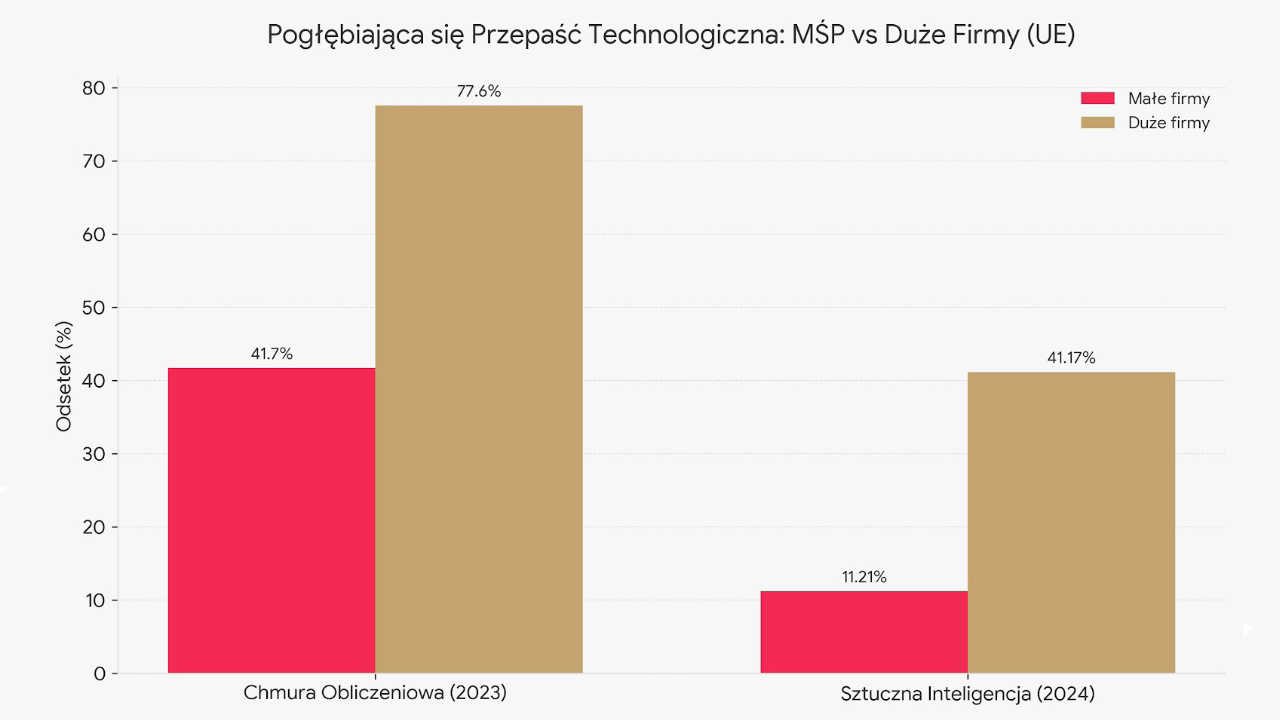

Jeśli proaktywność była iskrą, która zapoczątkowała rewolucję, to eksplozja zagrożeń cybernetycznych stała się paliwem napędzającym dalszą ewolucję. Małe i średnie przedsiębiorstwa (MŚP) stały się głównym celem cyberprzestępców, a strach przed atakiem stał się jednym z najważniejszych priorytetów biznesowych.

Badania z 2024 roku ujawniły, że aż 78% firm z sektora MŚP obawia się, że poważny cyberatak mógłby doprowadzić ich do bankructwa.

W odpowiedzi cyberbezpieczeństwo przestało być dodatkiem, a stało się centralnym elementem oferty MSP i głównym motorem wzrostu przychodów.

Analizy rynkowe wskazują, że 97% MSP osiągających najwyższe dochody oferuje szeroki zakres zarządzanych usług bezpieczeństwa. Klienci nie szukają już tylko narzędzi; 64% z nich oczekuje od swojego MSP strategicznych wskazówek.

To wymusiło na dostawcach ewolucję w kierunku modelu dostawcy zarządzanych usług bezpieczeństwa (MSSP), oferującego zaawansowane rozwiązania, takie jak zarządzane wykrywanie i reagowanie (MDR), zarządzanie informacjami i zdarzeniami bezpieczeństwa (SIEM) oraz szkolenia z zakresu świadomości bezpieczeństwa.

Przyjmując odpowiedzialność za cyberbezpieczeństwo, MSP fundamentalnie zmienił swoją rolę – nie zarządza już tylko technologią, ale ryzykiem biznesowym klienta.

Rewolucja chmury: zarządzanie złożonością hybrydową

Wbrew wczesnym prognozom, rozwój chmur publicznych nie sprawił, że MSP stali się zbędni. Wręcz przeciwnie, masowa adopcja strategii chmury hybrydowej i wielochmurowej (multi-cloud) stworzyła nowy, intensywny poziom złożoności, z którym firmy nie były w stanie sobie samodzielnie poradzić.

To otworzyło przed dojrzałymi MSP ogromną szansę. Przekształcili się oni w strategów chmurowych i integratorów, pomagając klientom w opracowywaniu strategii, realizacji złożonych migracji oraz, co kluczowe, w optymalizacji kosztów chmury (FinOps).

W dobie rosnącej liczby regulacji dotyczących prywatności danych, MSP zaczęli również pełnić funkcję „brokera suwerenności danych”, doradzając, gdzie dane mogą i powinny być przechowywane, aby zachować zgodność z przepisami.

Zdolność do projektowania i zarządzania w pełni spersonalizowanym środowiskiem hybrydowym, łączącym zasoby lokalne z chmurą prywatną i publiczną, umocniła pozycję MSP jako centralnego koordynatora całego ekosystemu IT klienta.

Horyzont innowacji: AIOps i Hhperautomatyzacja

Najbardziej dojrzałe firmy MSP stoją dziś u progu kolejnego ewolucyjnego skoku, którego horyzont wyznacza AIOps (AI for IT Operations) oraz hiperautomatyzacja. AIOps wykorzystuje big data i uczenie maszynowe do automatyzacji i usprawniania operacji IT, przenosząc zarządzanie z proaktywnego w predykcyjne.

Zamiast reagować na znane, potencjalne problemy, AIOps prognozuje i zapobiega im, zanim jakiekolwiek symptomy staną się widoczne.

Praktyczne zastosowania obejmują inteligentną korelację tysięcy alertów w jeden użyteczny incydent, analitykę predykcyjną prognozującą przyszłe zapotrzebowanie na zasoby oraz zautomatyzowaną naprawę (remediation), która rozwiązuje powtarzalne problemy bez interwencji człowieka.

W połączeniu z hiperautomatyzacją, która usprawnia całe procesy biznesowe (np. wdrażanie nowych klientów), technologie te stają się kluczową przewagą konkurencyjną.

AIOps staje się warunkiem koniecznym do zarządzania nowoczesnym, złożonym środowiskiem IT, a dostawcy, którzy z powodzeniem wdrożą te technologie, będą w stanie obsługiwać bardziej wymagających klientów z wyższą wydajnością.

Niezbędny motor transformacji cyfrowej

Ewolucja dostawców usług zarządzanych to historia niezwykłej adaptacji i ciągłego wspinania się w górę łańcucha wartości. Od reaktywnego technika, którego sukces mierzono szybkością naprawy, po predykcyjnego, strategicznego partnera, którego wartość definiuje się poprzez wkład w innowacyjność, odporność i rentowność biznesu klienta.

MSP przyszłości to nie sprzedawca technologii, lecz firma konsultingowa z głęboką ekspertyzą techniczną. Rozwija się w środowisku złożoności, aktywnie zarządza ryzykiem i wykorzystuje inteligentną automatyzację do dostarczania mierzalnych wyników.