Czasy „Air Gap” – fizycznego odcięcia produkcji od Internetu – definitywnie się skończyły. Cyfryzacja zakładów przemysłowych to skokowa poprawa wydajności, ale jednocześnie otwarcie drzwi, które dotychczas były szczelnie zamknięte. Wiele firm popełnia jednak kardynalny błąd: próbują zabezpieczać hale produkcyjne tymi samymi metodami, co działy księgowości. W świecie OT (Operational Technology) stawką nie są jednak tylko dane, ale fizyczne bezpieczeństwo maszyn i ciągłość biznesu.

Współczesny przemysł to system naczyń połączonych. Kiedyś automatyka przemysłowa żyła we własnym, odizolowanym świecie. Dziś sieć zakładów produkcyjnych jest nierozerwalnie spleciona z systemami IT. To konieczność biznesowa, ale z perspektywy cyberbezpieczeństwa – koszmar. Powiększona powierzchnia ataku sprawia, że hakerzy nie muszą forsować murów fabryki. Wystarczy, że znajdą uchylone cyfrowe okno.

Efekt domina: od phishingu do zatrzymania taśmy

Największym zagrożeniem dla dzisiejszego przemysłu jest tzw. lateral movement, czyli ruch boczny. Scenariusz jest zazwyczaj podobny: napastnik uzyskuje dostęp do słabiej zabezpieczonej sieci biurowej (IT) – na przykład poprzez zainfekowany e-mail w dziale HR. W tradycyjnej, płaskiej strukturze sieciowej, droga z biura do hali produkcyjnej stoi otworem.

Skutki takiego „przebicia się” do strefy OT są dewastujące. W przeciwieństwie do IT, gdzie atak oznacza zazwyczaj kradzież danych lub przestój serwerów, w OT konsekwencje są fizyczne. Zatrzymują się linie produkcyjne, psują się surowce, a firma traci zdolność do generowania przychodu w czasie rzeczywistym.

Dobitnym, smutnym przykładem tego mechanizmu jest historia producenta serwetek, firmy Fasana. Atak ransomware, który rozpoczął się w systemach informatycznych, sparaliżował produkcję. Efekt łańcuchowy był bezlitosny: brak produkcji doprowadził do utraty płynności, a finalnie do niewypłacalności przedsiębiorstwa. Ten przypadek powinien być czerwoną lampką dla każdego dyrektora operacyjnego: cyberbezpieczeństwo to dziś fundament stabilności finansowej.

Trzy mity, które usypiają czujność

Wdrażanie zabezpieczeń w przemyśle często rozbija się o niezrozumienie specyfiki OT. Oto trzy najczęstsze mity, które prowadzą do błędnych decyzji inwestycyjnych.

Mit 1: „Mamy Firewalle i VLANy, więc jesteśmy bezpieczni”

To podejście z lat 90. Klasyczna segmentacja IT służy głównie optymalizacji ruchu sieciowego. W przemyśle to za mało. Postawienie zapory ogniowej (firewall) nie wystarczy, jeśli nie rozumiemy specyfiki protokołów przemysłowych. Skuteczna segmentacja OT musi opierać się na tzw. *whitelisting* (białej liście). Oznacza to odwrócenie logiki: zamiast blokować to, co znane jako złe, blokujemy wszystko, a przepuszczamy tylko ruch, który jest niezbędny do procesu technologicznego. Komunikacja musi być nie tylko widoczna, ale i ściśle kontrolowana.

Mit 2: „Segmentacja spowolni moją produkcję”

To największa obawa inżynierów ruchu. Panuje przekonanie, że dodatkowe warstwy zabezpieczeń wprowadzą opóźnienia (latencję), które zakłócą pracę precyzyjnych maszyn. W rzeczywistości dobrze zaprojektowana segmentacja działa jak grodzie wodoszczelne na statku. Zwiększa odporność systemu. W przypadku awarii lub ataku w jednej sekcji, problem zostaje odizolowany i nie rozlewa się na cały zakład. Zamiast zakłócać procesy, segmentacja chroni je przed niechcianymi interwencjami.

Mit 3: „Zrobimy to raz i mamy spokój”

Fabryka to żywy organizm. Maszyny są modernizowane, dodawane są nowe czujniki IoT, zmieniają się procesy. Traktowanie segmentacji jako jednorazowego projektu „wdroż i zapomnij” to proszenie się o kłopoty. Wymagana jest koncepcja dynamiczna, która nadąża za ewolucją sieci przez dekady eksploatacji systemów.

Jak wdrożyć segmentację i nie „wysadzić” produkcji?

Kluczem do sukcesu nie jest zakup najdroższego sprzętu, ale metodyka działania. Wdrożenie segmentacji OT musi różnić się od wdrożeń w IT.

Po pierwsze: Pasywna inwentaryzacja

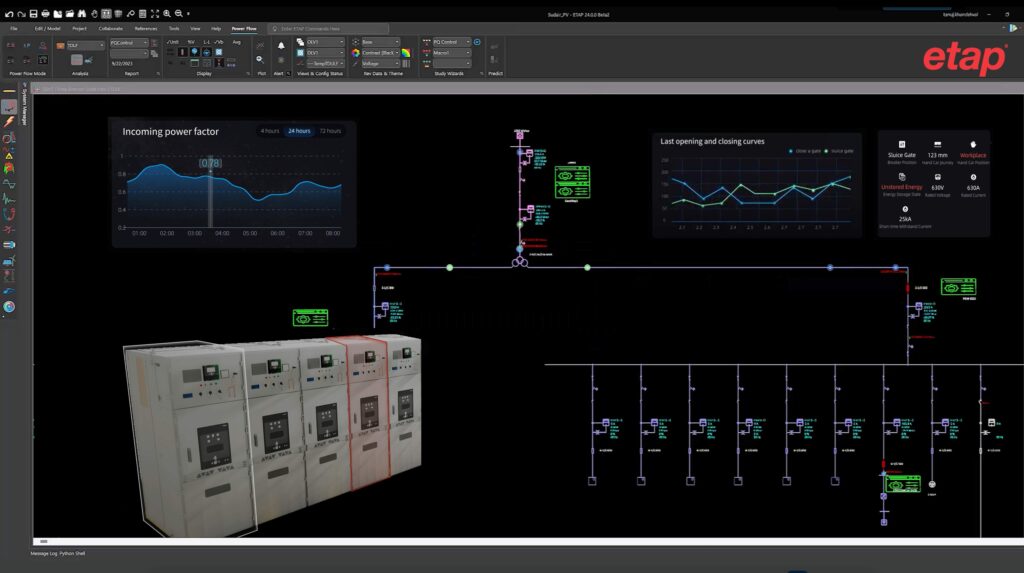

Nie można chronić czegoś, o czym nie wiemy, że istnieje. Podstawą jest pełen inwentarz zasobów. Jednak w świecie OT nie można stosować aktywnego skanowania sieci, znanego z IT, ponieważ starsze sterowniki PLC mogą tego nie przetrwać i zawiesić pracę maszyny. Stosuje się więc pasywną analizę ruchu – narzędzia nasłuchują sieci, nie ingerując w nią, identyfikując urządzenia i protokoły.

Po drugie: Mapowanie przepływów (Flow Mapping)

Zanim postawimy jakiekolwiek bariery, musimy zrozumieć, kto z kim „rozmawia”. Analiza rzeczywistych relacji komunikacyjnych pozwala na zaprojektowanie stref bezpieczeństwa, które odzwierciedlają realny proces produkcji, a nie teoretyczny schemat z dokumentacji (która często jest nieaktualna).

Po trzecie: Standardy (ISA/IEC 62443)

- Nie trzeba wyważać otwartych drzwi. Wiodące ramy odniesienia dla bezpieczeństwa OT, czyli norma ISA/IEC 62443, wprowadzają pojęcia Stref (Zones) i Kanałów (Conduits).

- Strefy grupują zasoby o podobnym poziomie ryzyka (np. oddzielna strefa dla systemów sterowania, oddzielna dla monitoringu).

- Kanały to kontrolowane ścieżki komunikacji między tymi strefami.

Każda strefa otrzymuje docelowy poziom bezpieczeństwa (SL – Security Level), dostosowany do jej krytyczności. System ERP nie musi być chroniony tak samo jak sterownik pieca hutniczego, ale komunikacja między nimi musi być ściśle reglamentowana.

Problem „Legacy” i wymogi prawne

Przemysł boryka się z problemem długu technologicznego. W halach wciąż pracują maszyny sterowane systemami, które pamiętają początek wieku (np. Windows XP). Nie da się ich zaktualizować, a ich wymiana jest ekonomicznie nieuzasadniona. Segmentacja jest dla nich jedynym ratunkiem – pozwala otoczyć takie zasoby „cyfrowym kordonem sanitarnym”, umożliwiając im bezpieczną pracę w nowoczesnym środowisku sieciowym.

Dodatkowym motywatorem są regulacje, takie jak dyrektywa NIS2. Nowe przepisy kładą ogromny nacisk na ograniczanie rozprzestrzeniania się incydentów oraz kontrolę dostępu. Segmentacja przestaje być więc tylko dobrą praktyką inżynierską, a staje się elementem niezbędnym do osiągnięcia zgodności z prawem (compliance).

Odporność jako strategia

Ochrona zakładów przemysłowych przestała być zadaniem czysto technicznym. To strategiczny obowiązek zarządu.

Segmentacja OT staje się fundamentem odporności biznesowej. Trend zmierza w kierunku integracji tych działań z rozwiązaniami ciągłego monitorowania i modelem Zero Trust dostosowanym do specyfiki fabrycznej. Inwestycja w logiczny podział sieci to polisa ubezpieczeniowa, która w krytycznym momencie może zadecydować o tym, czy firma przetrwa cyberatak, czy stanie się kolejnym, smutnym przykładem w branżowych statystykach.