Każdego dnia, sięgając po smartfon, uruchamiając ulubiony serial czy wysyłając służbowego maila, uczestniczymy w cichym cudzie współczesnej technologii. Pod lśniącą powierzchnią aplikacji i usług leży niewidzialny fundament – oprogramowanie open source.

To miliony linijek kodu, napisane, udoskonalone i udostępnione światu za darmo przez globalną społeczność. Ten kod jest krwiobiegiem internetu i szkieletem rewolucji AI.

Jednak ten cyfrowy świat, wzniesiony na idei wolności i współpracy, skrywa głęboki paradoks. Globalna gospodarka opiera się na infrastrukturze tworzonej w dużej mierze przez wolontariuszy, często balansujących na granicy wypalenia zawodowego.

To tak, jakby globalne szlaki handlowe opierały się na mostach budowanych hobbystycznie po godzinach. Jak długo taka struktura może wytrzymać? Kto tak naprawdę płaci za kod, na którym wszyscy polegamy?

Niewidzialny fundament: nasza globalna zależność

Oprogramowanie open source nie jest już alternatywą. Stało się domyślnym budulcem cyfrowego świata. Twarde dane malują obraz niemal całkowitej zależności. Analiza przeprowadzona przez Synopsys w 2024 roku wykazała, że aż 96% zbadanych komercyjnych baz kodu zawierało komponenty open source.

Co więcej, średnio 77% całego kodu w tych aplikacjach pochodziło właśnie z otwartych źródeł. To nie jest już kwestia wykorzystywania pojedynczych bibliotek – to budowanie całych systemów na fundamencie stworzonym przez społeczność.

Skala tej zależności staje się jeszcze bardziej uderzająca, gdy spojrzymy na dynamikę konsumpcji. W 2024 roku prognozowano, że całkowita liczba pobrań pakietów open source sięgnie niewyobrażalnej liczby 6,6 biliona.

Sam ekosystem npm (JavaScript) odpowiadał za 4,5 biliona żądań, notując 70% wzrost rok do roku, podczas gdy napędzany przez AI ekosystem Pythona (PyPI) wzrósł o 87%, osiągając 530 miliardów pobrań.

Przeciętna aplikacja komercyjna jest dziś skomplikowaną mozaiką złożoną średnio z 526 różnych komponentów open source. Każdy z nich ma własny cykl życia, własnych opiekunów i własne potencjalne problemy.

Pęknięcia w fundamencie: kod zombie i pobudka zwana Log4j

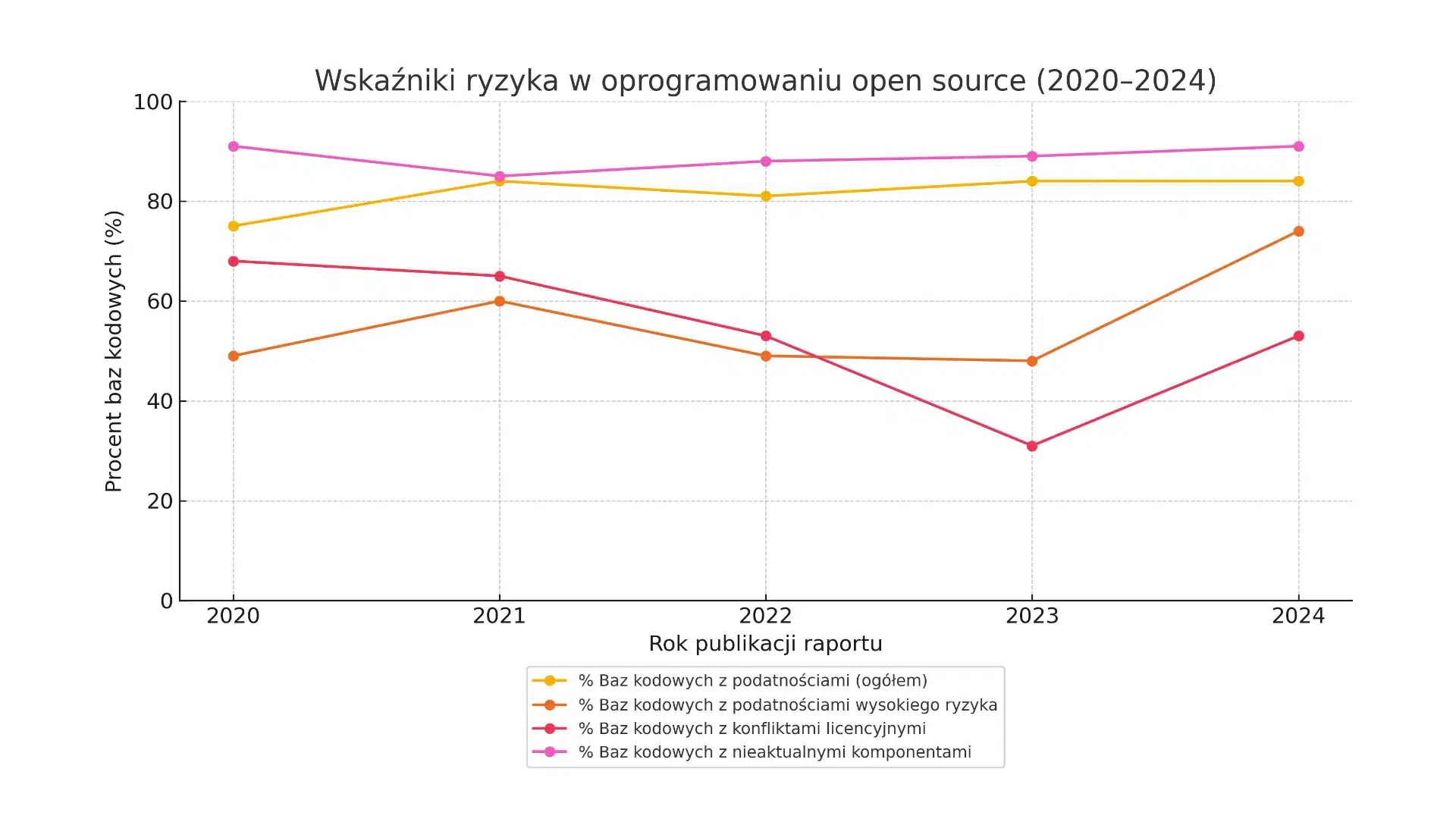

Wszechobecność open source jest mieczem obosiecznym. Ta sama łatwość, z jaką deweloperzy mogą włączać do swoich projektów gotowe komponenty, prowadzi do systemowych zaniedbań. Dane są alarmujące: aż 91% zbadanych komercyjnych baz kodu zawiera komponenty, które są o dziesięć lub więcej wersji przestarzałe.

Problem ten prowadzi do powstania tzw. „kodu zombie” – komponentów, które nie miały żadnej aktywności deweloperskiej od ponad dwóch lat. Zjawisko to dotyczy niemal połowy (49%) aplikacji na rynku.

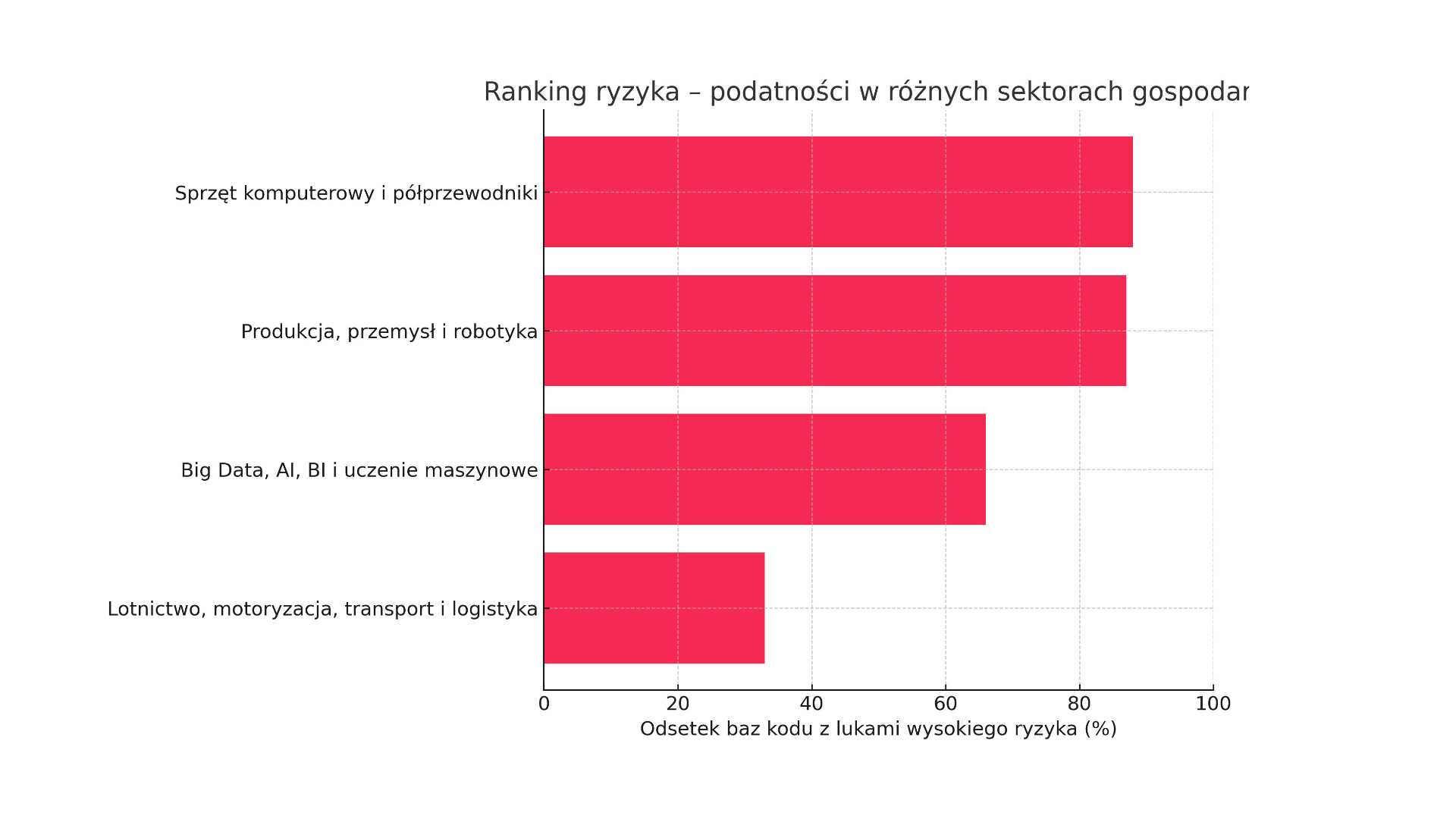

Oznacza to, że firmy budują swoje krytyczne systemy na porzuconych projektach, bez aktywnego wsparcia i, co najważniejsze, bez poprawek bezpieczeństwa. Konsekwencją jest tykająca bomba zegarowa: w ciągu zaledwie jednego roku odsetek baz kodu zawierających luki bezpieczeństwa o wysokim ryzyku wzrósł z 48% do 74%.

Nic nie ilustruje tego ryzyka lepiej niż incydent z grudnia 2021 roku, kiedy świat dowiedział się o luce w Log4j. Ta niewielka, darmowa biblioteka Javy, służąca do zapisywania logów, okazała się być wbudowana w miliony aplikacji na całym świecie.

Luka, nazwana Log4Shell, otrzymała maksymalną ocenę krytyczności 10/10. Atakujący mógł przejąć pełną kontrolę nad serwerem, wysyłając prosty ciąg znaków. Dyrektorka amerykańskiej agencji CISA, Jen Easterly, nazwała ją „jedną z najpoważniejszych luk, jakie widziała w całej swojej karierze”.

Incydent Log4j stał się globalną pobudką, brutalnie uświadamiając firmom, jak bardzo ich bezpieczeństwo zależy od pracy anonimowych wolontariuszy.

Co gorsza, nawet trzy lata po odkryciu Log4Shell, aż 13% wszystkich pobrań biblioteki Log4j to wciąż wersje podatne na atak. To dowód na głęboką bezwładność organizacji, które nie aktualizują swoich zależności nawet w obliczu powszechnie znanego, krytycznego zagrożenia.

Ludzki koszt „darmowego” oprogramowania: brzemię opiekuna

Za każdym wierszem kodu stoją ludzie. Model, który traktuje ich pracę jako darmowy zasób, generuje ogromne koszty ludzkie. Salvatore Sanfilippo, twórca bazy danych Redis, opisał to zjawisko jako „efekt zalewu”.

Z czasem strumień maili, zgłoszeń na GitHubie i pytań zamienia się w niekończącą się powódź, która prowadzi do poczucia winy z powodu niemożności udzielenia pomocy wszystkim.

Skalę tej presji ilustruje przykład Jeffa Geerlinga, który opiekuje się ponad 200 projektami. Każdego dnia otrzymuje od 50 do 100 powiadomień, z czego jest w stanie zająć się jedynie ułamkiem.

Nolan Lawson, inny znany maintainer, trafnie ujął emocjonalny ciężar tej pracy. Powiadomienia na GitHubie to „ciągły strumień negatywności”. Nikt nie otwiera zgłoszenia, by pochwalić działający kod. Ludzie piszą tylko wtedy, gdy coś jest nie tak.

Ta chroniczna presja prowadzi do wypalenia, które w kontekście open source ma jasno zdefiniowane przyczyny: roszczeniowość użytkowników, niska jakość kontrybucji, brak czasu i, co najbardziej dotkliwe, brak wynagrodzenia.

Świadomość, że praca, która pochłania ogromne ilości energii, jest fundamentem dla komercyjnych produktów przynoszących innym realne zyski, jest niezwykle demotywująca. Jak ujął to jeden z maintainerów:

„Moje oprogramowanie jest gratis, ale mój czas i uwaga nie są”. Wypalenie opiekuna to nie jest jedynie osobista tragedia. To krytyczne ryzyko dla globalnej infrastruktury.

„Kod zombie” jest bezpośrednim, mierzalnym symptomem tego kryzysu na poziomie ludzkim.

Nowa ekonomia kodu: W Stronę Zrównoważonej Przyszłości

W obliczu tych ryzyk, ekosystem open source powoli dojrzewa, przechodząc od modelu opartego na wolontariacie do bardziej zrównoważonych form finansowania.

1. Korporacyjni mecenasi: strategia, a nie altruizm

Na czele tej transformacji stoją giganci technologiczni. Firmy takie jak Google, Microsoft i Red Hat od lat są największymi kontrybutorami do świata open source. Ich motywacje nie są jednak altruistyczne – to chłodna, strategiczna kalkulacja.

Wspólne rozwijanie fundamentalnych komponentów (jak systemy operacyjne czy konteneryzacja) jest po prostu bardziej efektywne. Pozwala to konkurować na wyższym poziomie, w obszarach, które bezpośrednio wyróżniają ich produkty.

Angażując się w kluczowe projekty, korporacje mogą też wpływać na ich kierunek rozwoju, zapewniając zgodność z własną strategią.

2. Siła instytucji: rola fundacji

Drugim filarem są fundacje non-profit, takie jak Linux Foundation i Apache Software Foundation. Działają one jako neutralni powiernicy dla najważniejszych projektów, zapewniając im stabilność i niezależność od pojedynczej korporacji.

Gromadzą składki od sponsorów, tworząc budżet, który pozwala na finansowanie kluczowych deweloperów i audyty bezpieczeństwa.

3. Rewolucja twórców: model GitHub Sponsors

Obok wielkich graczy narodziła się nowa, oddolna fala finansowania. Platformy takie jak GitHub Sponsors umożliwiają bezpośrednie, cykliczne wpłaty od użytkowników i firm, tworząc strumień przychodów dla maintainerów.

Historia Caleba Porzio, twórcy narzędzi Livewire i AlpineJS, jest najlepszym przykładem potencjału tego modelu. Stojąc na granicy wypalenia, postanowił spróbować sił w programie GitHub Sponsors.

Prawdziwy przełom nastąpił, gdy zmienił paradygmat: zamiast prosić o wsparcie, postanowił zaoferować swoim sponsorom dodatkową, ekskluzywną wartość. Jego sekretem okazały się płatne screencasty – serie tutoriali wideo.

Dostęp do pełnej biblioteki zarezerwował wyłącznie dla osób wspierających go na GitHubie. Efekt był spektakularny. Jego roczne przychody wzrosły o 80 000 USD w ciągu 90 dni, a w kolejnych latach przekroczyły próg miliona dolarów.

To kluczowa lekcja: zrównoważony model nie musi opierać się na dobroczynności, ale na budowaniu realnego modelu biznesowego wokół darmowego, otwartego rdzenia.

Od pasażera na gapę do interesariusza

„Darmowe” oprogramowanie nigdy nie było darmowe. Jego cenę, do tej pory ukrytą, płacono czasem, energią i zdrowiem psychicznym globalnej armii wolontariuszy. Model, w którym traktowaliśmy ich pracę jak niewyczerpywalny zasób, dobiega końca.

Nadszedł czas, aby każdy uczestnik tego ekosystemu przeszedł transformację – od biernego „pasażera na gapę” do aktywnego interesariusza.

Wymaga to konkretnych działań. Deweloperzy muszą praktykować „higienę oprogramowania” – regularnie aktualizować zależności i świadomie zarządzać długiem technicznym.

Firmy muszą traktować open source jako krytyczny element łańcucha dostaw, tworząc „spisy komponentów oprogramowania” (SBOM) i inwestując w kluczowe dla biznesu projekty. Inwestowanie w open source to nie koszt, to ubezpieczenie ciągłości działania.

Stoimy u progu nowej ery dla open source – ery profesjonalizacji i zrównoważonego rozwoju. Przyszłość, w której twórcy są sprawiedliwie wynagradzani, a globalna infrastruktura cyfrowa jest bezpieczna, jest w naszym zasięgu. Jej zbudowanie wymaga jednak świadomego wysiłku od każdego z nas.