W historii technologii istnieją momenty, które na nowo definiują granice możliwości. Opanowanie ognia, wynalezienie druku, era cyfrowa – każda z tych epok była zapoczątkowana przez fundamentalne odkrycie.

Dziś stoimy u progu kolejnej takiej transformacji, która nie jest po prostu ewolucją mocy obliczeniowej, ale narodzinami zupełnie nowego paradygmatu. Mowa o obliczeniach kwantowych.

Wyścig o zbudowanie funkcjonalnego komputera kwantowego to najważniejszy technologiczny i geopolityczny pojedynek XXI wieku.

Stawką jest zdolność do rozwiązywania problemów, które dziś pozostają poza zasięgiem najpotężniejszych superkomputerów – od projektowania leków na poziomie molekularnym, przez tworzenie rewolucyjnych materiałów, po złamanie niemal wszystkich współczesnych systemów szyfrowania.

U podstaw tej rewolucji leży mechanika kwantowa, z jej zasadami superpozycji i splątania, która pozwala kubitowi – kwantowemu odpowiednikowi bitu – istnieć w wielu stanach jednocześnie. To właśnie ta fundamentalna różnica daje komputerom kwantowym ich niewyobrażalny potencjał.

Rok 2025, ogłoszony przez ONZ Międzynarodowym Rokiem Nauki i Technologii Kwantowej, jest symbolicznym punktem zwrotnym . Nie jesteśmy już w sferze czysto teoretycznych rozważań. Wkroczyliśmy w erę NISQ (Noisy Intermediate-Scale Quantum) – czas, w którym dysponujemy niedoskonałymi, „zaszumionymi” komputerami kwantowymi, które jednak z każdym rokiem stają się potężniejsze.

To rodzący się przemysł, którego wartość, szacowana na 866 mln USD w 2023 roku, ma według prognoz osiągnąć 4,4 mld USD do 2028 roku.

Wielkie rody kwantowe: pretendenci do korony

Na polu bitwy o kwantową przyszłość wyłoniło się trzech potężnych graczy: Google, IBM i Microsoft. Każdy z nich ma inną strategię, by zasiąść na technologicznym tronie.

Google: alchemicy z Mountain View

Strategia Google’a skupia się na spektakularnych, przełomowych demonstracjach mocy. Ich najnowszą bronią jest procesor „Willow”, ale prawdziwy przełom nie leży w liczbie kubitów, lecz w mistrzowskim opanowaniu korekcji błędów.

Inżynierowie Google’a ogłosili, że są w stanie utrzymać stabilność kubitu logicznego – czyli zestawu fizycznych kubitów współpracujących w celu korygowania błędów – nawet przez godzinę.

To monumentalny skok w porównaniu z mikrosekundami, które były standardem jeszcze niedawno. Ich roszczenie do tronu opiera się na byciu pierwszymi, którzy przesuwają granice nauki, tak jak w 2019 roku, gdy jako pierwsi ogłosili osiągnięcie „supremacji kwantowej”.

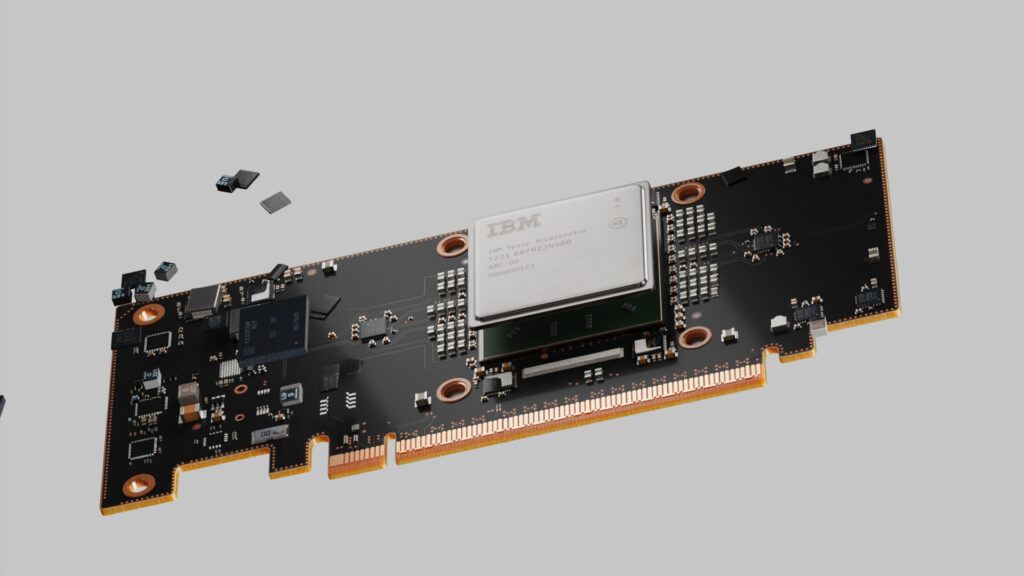

IBM: budowniczowie królestwa dla wszystkich

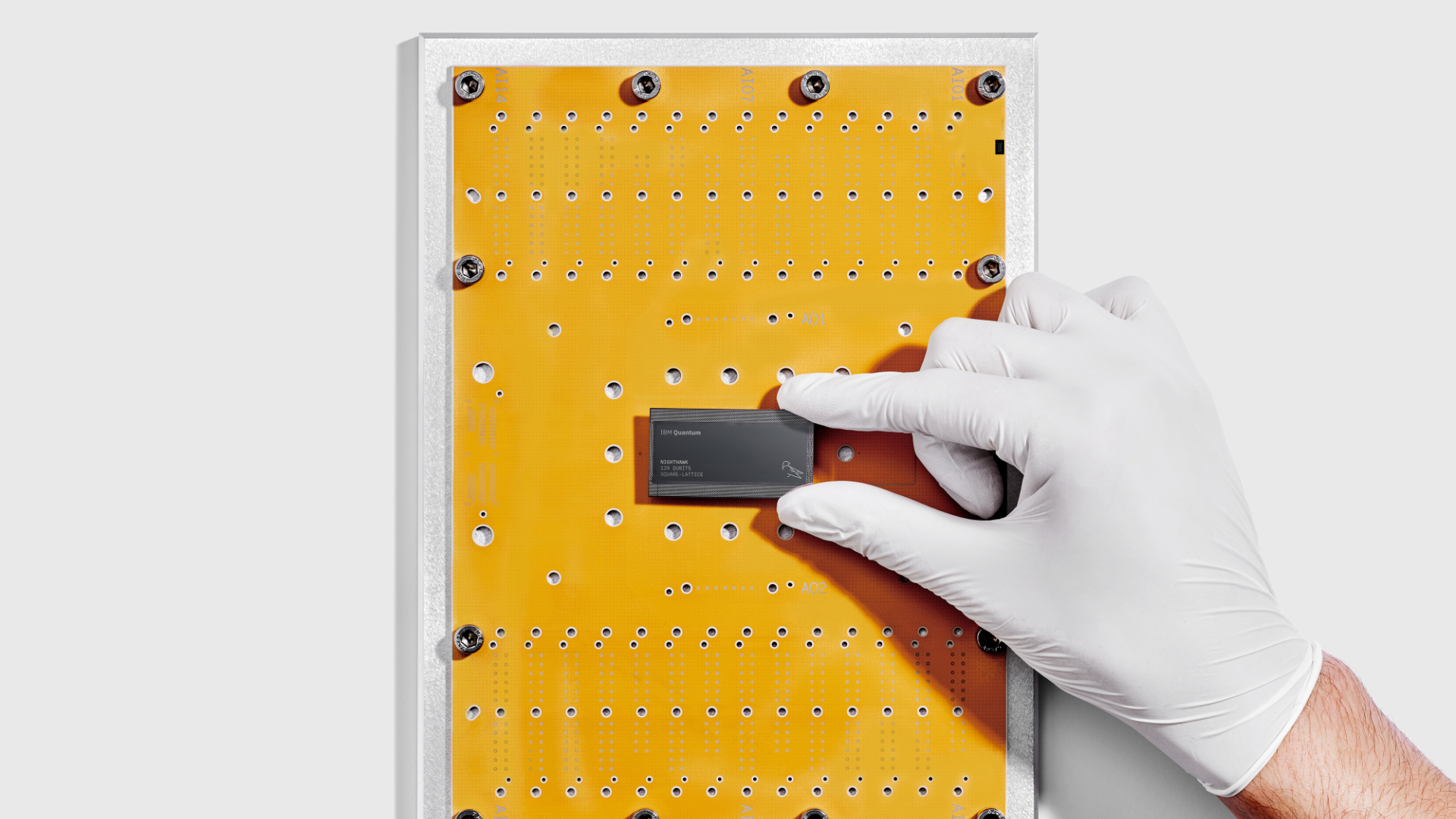

IBM gra w zupełnie inną grę. Zamiast pojedynczych przełomów, stawiają na konsekwentny postęp i demokratyzację dostępu do technologii. Ich mapa drogowa jest publiczna i precyzyjna, a na rok 2025 planują udostępnienie procesora „Nighthawk”.

Kluczowym elementem ich strategii jest integracja komputerów kwantowych z klasycznymi superkomputerami (HPC), tworząc hybrydową przyszłość. Otwarcie pierwszego w Europie kwantowego centrum danych w Niemczech to strategiczny ruch, przybliżający zasoby kwantowe bezpośrednio do europejskiego przemysłu i środowisk akademickich.

IBM nie buduje jedynie laboratoryjnego eksperymentu; tworzy gotową do wdrożeń biznesowych platformę dostępną przez chmurę.

Microsoft: cierpliwi architekci z Redmond

Microsoft obrał ścieżkę najwyższego ryzyka, ale i potencjalnie największej nagrody. Przez dekady inwestowali w badania nad mitycznym „kubitem topologicznym”, który z natury byłby odporny na błędy.

Czekając na dojrzałość tej technologii, zbudowali potężny ekosystem Azure Quantum, zaprojektowany tak, by być niezależnym od konkretnej architektury sprzętowej . Ich najnowszy przełom to demonstracja 12 splątanych kubitów logicznych o wskaźniku błędu 800 razy niższym niż w przypadku pojedynczych kubitów fizycznych, osiągnięta we współpracy z Quantinuum.

Partnerstwo z Atom Computing ma na celu zbudowanie „najpotężniejszej maszyny kwantowej na świecie”, łącząc ich oprogramowanie do korekcji błędów z obiecującą technologią opartą na neutralnych atomach .

Geopolityczna wielka gra: smok kontra orzeł

Rywalizacja przenosi się na arenę globalną, gdzie staje się centralnym elementem konfrontacji między Stanami Zjednoczonymi a Chinami. To walka o technologiczną hegemonię, w którą zaangażowane są miliardy dolarów z funduszy publicznych i prywatnych.

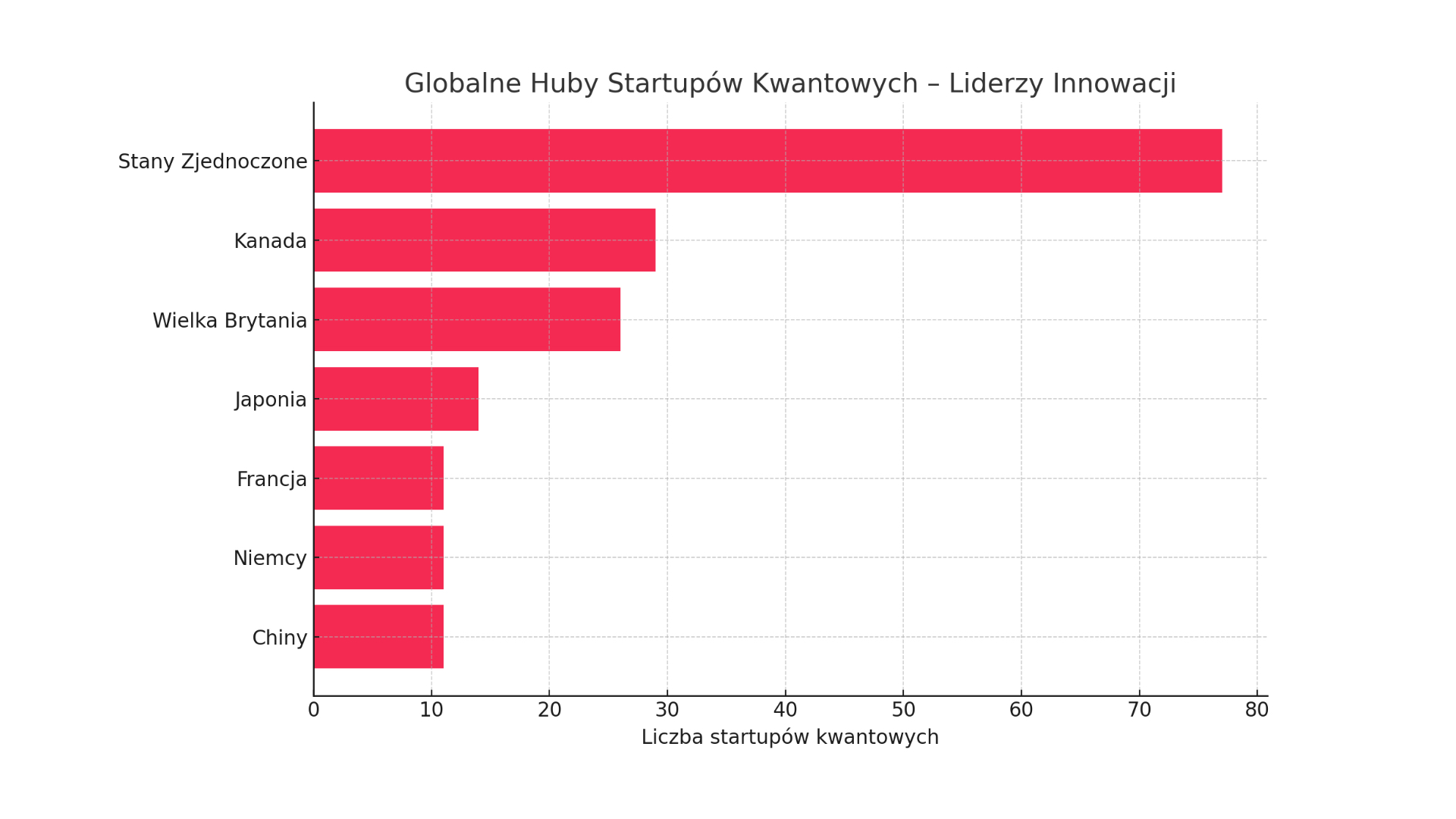

Stany Zjednoczone są liderem, jeśli chodzi o dynamikę ekosystemu startupowego – działa tam 77 firm zajmujących się technologiami kwantowymi . Ta innowacyjność jest napędzana przez gigantyczne inwestycje prywatne oraz potęgę badawczą wielkich rodów technologicznych.

Rząd federalny również odgrywa kluczową rolę, zapewniając znaczące finansowanie dla badań podstawowych.

Chiny prowadzą jednak grę długoterminową, w pełni sterowaną przez państwo. Z szokującą prędkością nadrabiają zaległości. Według raportu Australijskiego Instytutu Polityki Strategicznej (ASPI), Chiny już teraz prowadzą w 57 z 64 kluczowych technologii, w tym w tak istotnych obszarach jak czujniki kwantowe.

Państwo Środka realizuje strategię opartą na gigantycznych inwestycjach w infrastrukturę badawczą i dąży do osiągnięcia dominacji w produkcji dojrzałych chipów.

Europa, choć jest istotnym graczem, pozostaje w tyle za dwoma supermocarstwami pod względem skali inwestycji.

Mimo to, inicjatywy takie jak EuroHPC oraz strategiczne umiejscowienie komputerów kwantowych w Polsce i Niemczech świadczą o skoordynowanym wysiłku na rzecz utrzymania konkurencyjności.

Zdobycze zwycięzców: branże na progu jutra

Dlaczego rządy i korporacje inwestują miliardy w tę technologię? Odpowiedź leży w rewolucyjnych zastosowaniach, które czekają na zwycięzców.

Służba zdrowia i farmacja: projektowanie lekarstw

Jednym z najtrudniejszych problemów dla klasycznych komputerów jest precyzyjna symulacja złożonych molekuł. Komputery kwantowe są naturalnie predysponowane do symulowania takich systemów. Ich zastosowanie może skrócić czas potrzebny na odkrycie i opracowanie nowego leku nawet o 50-70%.

Giganci farmaceutyczni, tacy jak Roche i Pfizer, aktywnie współpracują z firmami technologicznymi, aby przygotować się na nadejście ery kwantowej.

Współpraca firmy Pfizer z firmą technologiczną XtalPi, wykorzystująca sztuczną inteligencję jako pomost do pełnych obliczeń kwantowych, już teraz skraca czas potrzebny na obliczenie struktury krystalicznej molekuł z miesięcy do zaledwie kilku dni.

Finanse: kwantowy fundusz hedgingowy

Rynki finansowe to świat złożonych problemów optymalizacyjnych i modelowania ryzyka. Algorytmy kwantowe są w stanie analizować znacznie większą liczbę zmiennych i scenariuszy jednocześnie, co prowadzi do optymalizacji portfeli i dokładniejszej oceny ryzyka.

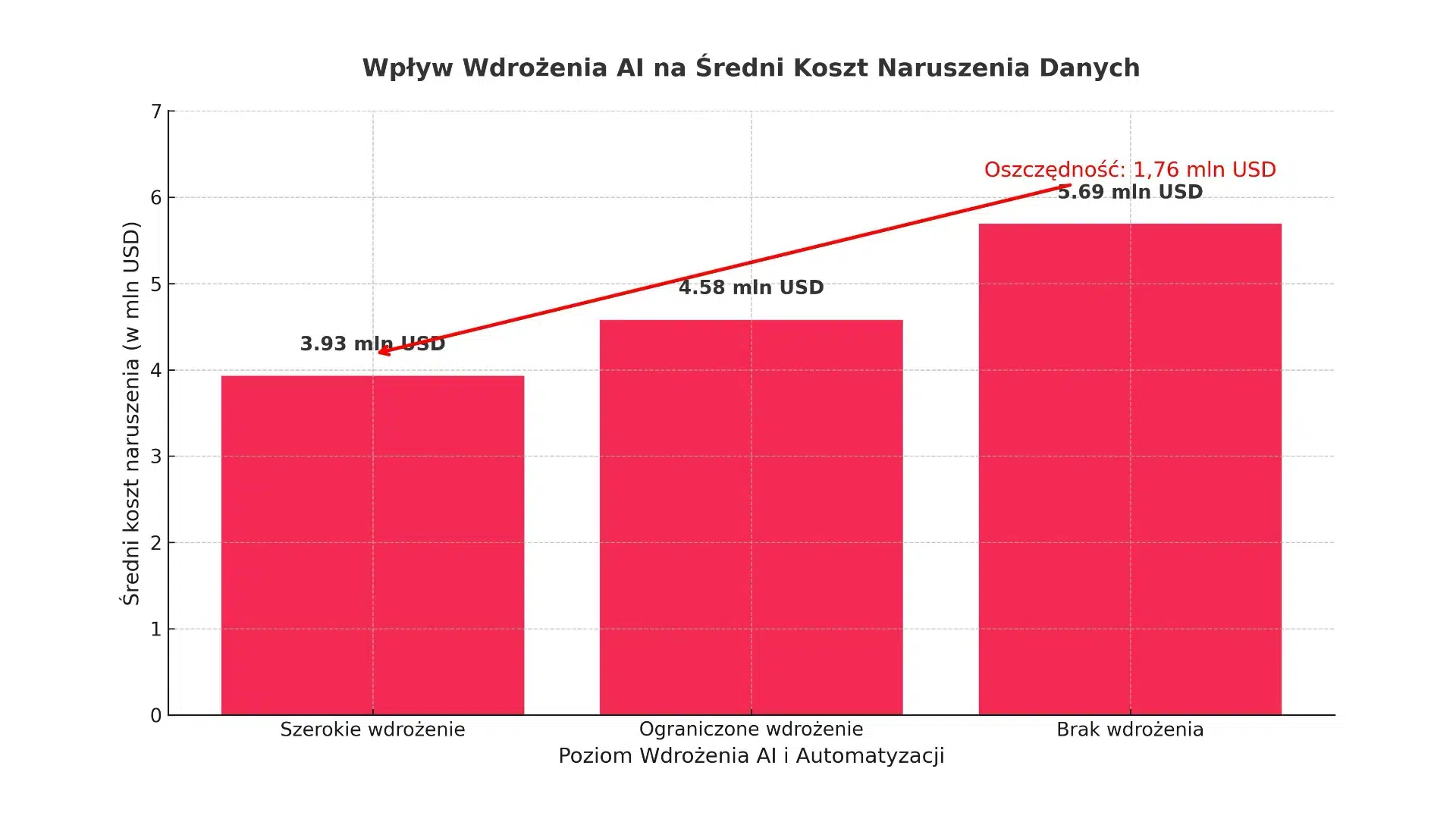

Instytucje finansowe, takie jak JPMorgan i BBVA, już teraz prowadzą projekty pilotażowe we współpracy z IBM i D-Wave . Jednak ta sama moc stanowi również egzystencjalne zagrożenie. Komputer kwantowy o odpowiedniej skali będzie w stanie złamać algorytmy szyfrowania, które stanowią fundament bezpieczeństwa całej gospodarki cyfrowej.

To tworzy pilną potrzebę wdrożenia tzw. kryptografii postkwantowej.

Materiałoznawstwo i chemia: inżynieria niemożliwego

Tworzenie nowych materiałów opiera się dziś w dużej mierze na metodzie prób i błędów. Komputery kwantowe otwierają drogę do „projektowania materiałów na zamówienie”, umożliwiając precyzyjną symulację właściwości kwantowych substancji, zanim jeszcze zostaną one wytworzone w laboratorium . Może to doprowadzić do przełomów, takich jak nadprzewodniki działające w temperaturze pokojowej czy katalizatory, które sprawią, że procesy przemysłowe staną się radykalnie bardziej energooszczędne. Firmy takie jak BASF są głęboko zaangażowane w badania, tworząc partnerstwa ze startupami i instytucjami akademickimi.

Od supremacji do przewagi: prawdziwa miara zwycięstwa

Ogłoszenie przez Google „supremacji kwantowej” w 2019 roku było kamieniem milowym, ale nie komercyjnym punktem zwrotnym. Problem, który rozwiązał ich komputer, nie miał praktycznego zastosowania . Dlatego kluczowe jest rozróżnienie terminów:

- Supremacja Kwantowa (Quantum Supremacy): Dowód, że komputer kwantowy może pokonać klasyczny w jakimkolwiek zadaniu, nawet bezużytecznym. To naukowy benchmark, ale bez bezpośredniego znaczenia komercyjnego .

- Przewaga Kwantowa (Quantum Advantage): Prawdziwy cel. Oznacza zdolność do rozwiązania użytecznego, realnego problemu biznesowego szybciej, taniej lub dokładniej niż jakikolwiek komputer klasyczny .

- Użyteczność Kwantowa (Quantum Utility): Pragmatyczny stan, w którym znajdujemy się obecnie. Oznacza wykorzystywanie dzisiejszych, niedoskonałych komputerów NISQ do osiągania namacalnych, choć jeszcze nie rewolucyjnych, rezultatów .

Sama zmiana języka, odchodzenie od konfrontacyjnego terminu „supremacja” na rzecz bardziej praktycznych pojęć „przewaga” i „użyteczność”, jest symptomem dojrzałości całej branży. Oznacza to przejście od czystej nauki do komercyjnych zastosowań.

Rewolucja kwantowa nie nadejdzie z hukiem. Będzie to cicha, pełzająca transformacja. Prawdziwą miarą zwycięstwa w tej grze o tron nie będzie supremacja, lecz użyteczność – liczba rozwiązanych problemów i wartość, jaką uda się stworzyć. Czas na przygotowania nie jest wtedy, gdy tron zostanie zdobyty, ale teraz, gdy wielkie rody wykonują swoje pierwsze, strategiczne ruchy. Gra się rozpoczęła.