Prognozy rynkowe dotyczące sektora technologicznego rzadko bywają tak jednoznaczne. Według najnowszych danych firmy analitycznej Gartner, globalne wydatki na IT osiągną w 2026 roku poziom 6,31 biliona dolarów. To dowód na przesunięcie środka ciężkości światowego biznesu. Wzrost o 13,5% w skali roku, znacząco przewyższający wcześniejsze estymacje, jest bezpośrednim efektem wyścigu zbrojeń w obszarze infrastruktury sztucznej inteligencji.

Fundament z betonu i krzemu: Eksplozja sektora centrów danych

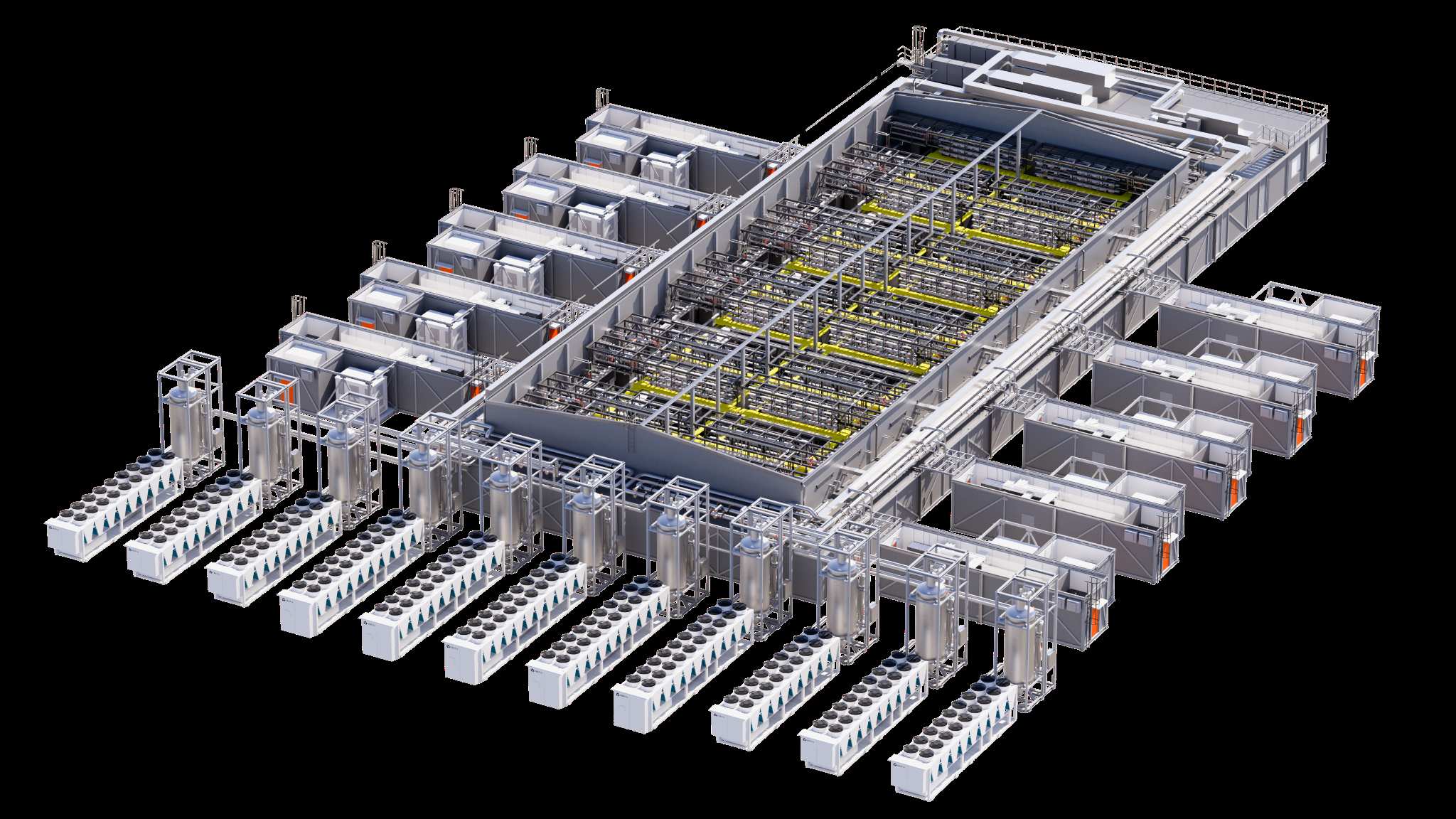

Najbardziej jaskrawym punktem raportu jest dynamika inwestycji w centra danych. Gartner przewiduje, że wydatki w tym segmencie wzrosną o 55,8% w 2026 roku, przekraczając barierę 788 miliardów dolarów. Aby zrozumieć skalę tego zjawiska, należy spojrzeć na nie przez pryzmat zmiany technologicznej: nie mamy do czynienia z prostą rozbudową istniejących zasobów, lecz z całkowitą rekonfiguracją architektury obliczeniowej.

Tradycyjne centra danych, zoptymalizowane pod kątem przechowywania danych i obsługi standardowych aplikacji biznesowych, ustępują miejsca obiektom typu HPC. Są one projektowane pod specyficzne wymagania procesorów graficznych (GPU) i układów TPU, które stanowią serce nowoczesnej AI. Skokowy wzrost nakładów finansowych obejmuje nie tylko same serwery, ale również zaawansowane systemy chłodzenia cieczą, infrastrukturę energetyczną o wysokiej gęstości oraz technologie wspomagające, bez których skalowanie dużych modeli językowych (LLM) byłoby niemożliwe.

Równolegle, segment usług IT, wdrożeń infrastrukturalnych oraz modelu IaaS wygeneruje obroty rzędu 1,87 biliona dolarów. Sugeruje to, że rynek dojrzał do konsumowania mocy obliczeniowej w modelu hybrydowym, gdzie fizyczna infrastruktura idzie w parze z wyspecjalizowanym zarządzaniem.

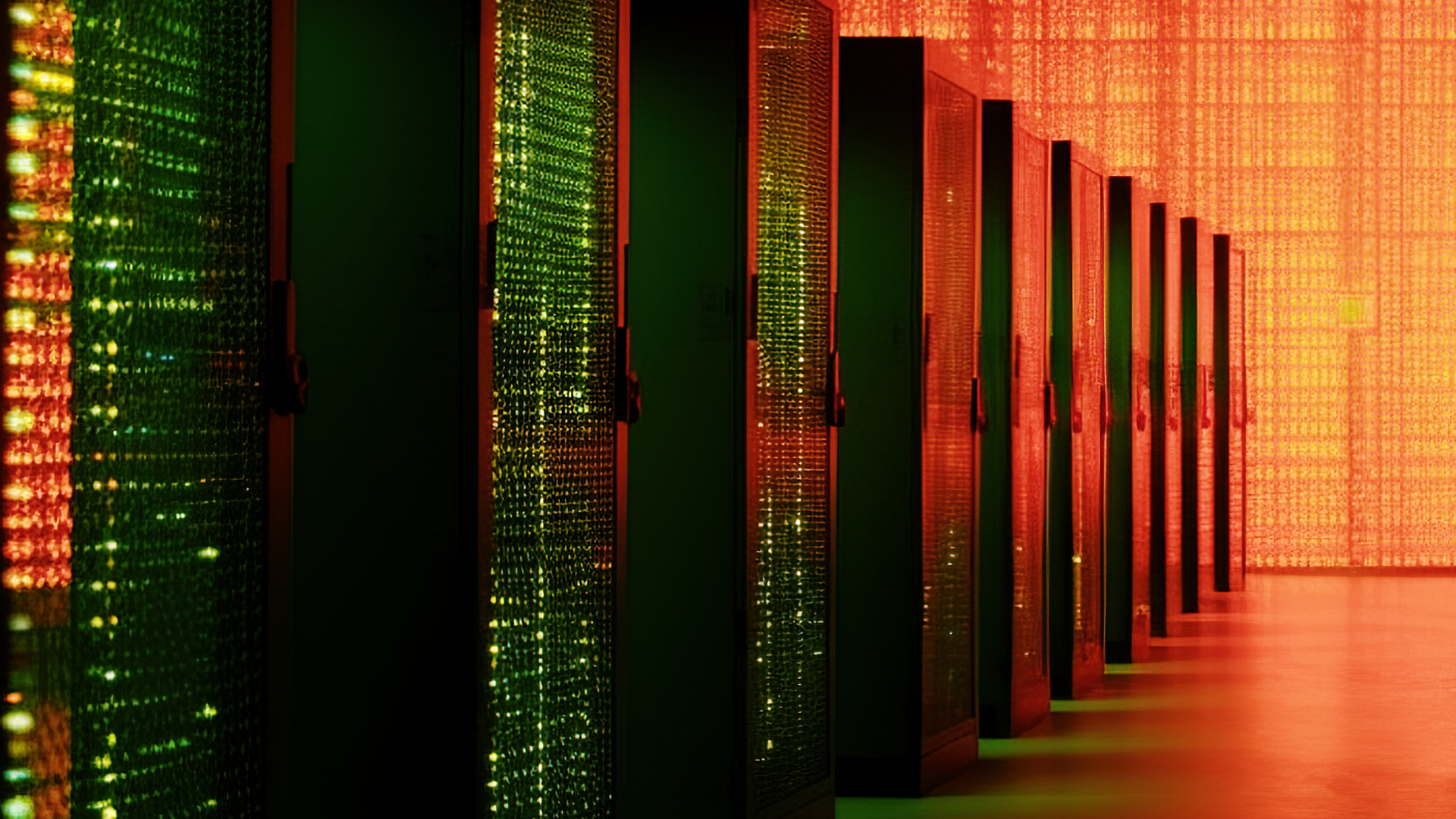

Dominacja hiperskalerów: Oligopol obliczeniowy

Zjawiskiem o charakterze strukturalnym jest postępująca koncentracja mocy obliczeniowej w rękach nielicznych podmiotów. Według prognoz, do 2031 roku hiperskalerzy – głównie Microsoft, Google (Alphabet) oraz AWS (Amazon) – będą kontrolować aż 67% globalnej pojemności centrów danych.

Tylko w bieżącym roku ci trzej giganci planują przeznaczyć ponad 500 miliardów dolarów na wydatki kapitałowe związane z infrastrukturą AI. Tak gigantyczne nakłady tworzą barierę wejścia niemal niemożliwą do pokonania dla nowych graczy. Dla biznesu oznacza to konieczność strategicznego wyboru dostawcy chmurowego, który de facto staje się partnerem w dostarczaniu przewagi konkurencyjnej opartej na danych.

Obserwujemy również nową mapę geopolityczną inwestycji IT. Inwestycja Microsoftu w Australii o wartości 25 miliardów dolarów czy budowa przez Metę 32. centrum danych na świecie pokazują, że dostępność do stabilnych źródeł energii i przestrzeni staje się ważniejsza niż bliskość tradycyjnych klastrów biznesowych.

Strategiczne sojusze i łańcuch dostaw

Analiza ostatnich transakcji rynkowych rzuca światło na kierunek, w którym zmierza branża. Umowy Anthropic z Google i Broadcomem na dostawy mocy TPU (Tensor Processing Unit) od 2027 roku wskazują na rosnące znaczenie autorskich układów scalonych, które mają uniezależnić gigantów od dominacji zewnętrznych dostawców procesorów.

Nawet najwięksi gracze potrzebują elastyczności i wyspecjalizowanych dostawców chmury GPU, aby sprostać gwałtownym skokom zapotrzebowania na moc obliczeniową, o czym świadczy chociażby partnerstwo Mety z CoreWeave, opiewające na 21 miliardów dolarów. Największe zyski będą generowane nie przez samych twórców oprogramowania AI, ale przez firmy dostarczające „podzespoły” tej rewolucji – od producentów akceleratorów po dostawców energii.

Spostrzeżenia rynkowe dla biznesu

W kontekście nadchodzącego szczytu inwestycyjnego w 2026 roku, liderzy biznesowi powinni wziąć pod uwagę trzy kluczowe wnioski:

- Infrastruktura jako wąskie gardło: Wzrost wydatków o 55,8% na centra danych sugeruje, że dostęp do mocy obliczeniowej może stać się towarem deficytowym. Firmy planujące wdrożenia AI na dużą skalę muszą zabezpieczyć zasoby infrastrukturalne z wyprzedzeniem, aby uniknąć przestojów w rozwoju produktów.

- Konieczność optymalizacji kosztowej: Przy wydatkach na IT sięgających 6 bilionów dolarów, efektywność staje się kluczowa. Przejście z ogólnych rozwiązań chmurowych na infrastrukturę zoptymalizowaną pod AI (jak IaaS wspierany przez układy TPU/GPU) będzie decydować o marżowości projektów cyfrowych.

- Nowy ekosystem dostawców: Warto obserwować firmy takie jak Broadcom czy CoreWeave. Reprezentują one nową kategorię partnerów technologicznych, którzy dzięki specjalizacji są w stanie dostarczyć komponenty niezbędne do skalowania AI szybciej i taniej niż tradycyjni dostawcy sprzętu.