Każda edycja konferencji AWS re:Invent w Las Vegas wyznacza azymut, którym przez kolejne miesiące podąża cała branża chmurowa. Jeśli jednak w poprzednich latach motywem przewodnim było „wspomaganie” człowieka przez sztuczną inteligencję – znane nam pod postacią Copilotów i asystentów czatowych – tak rok 2025 przyniósł fundamentalną zmianę narracji. AWS przestaje mówić o AI, która czeka na Twoje polecenia. Zaczyna mówić o AI, która działa sama. Hasłem tegorocznej edycji jest „autonomia”, a zaprezentowana nowa klasa Agentów Granicznych oraz rodzina modeli Nova to sygnał, że wkraczamy w erę, w której oprogramowanie przestaje być tylko narzędziem, a staje się niezależnym wykonawcą.

Liczba nowości ogłoszonych w ciągu pięciu dni konferencji jest przytłaczająca, jednak po odsianiu marketingowego szumu, na placu boju pozostają trzy kluczowe innowacje, które mają potencjał zredefiniować cykl wytwarzania oprogramowania (SDLC) oraz operacje IT. Są to: nowa kategoria autonomicznych agentów granicznych (Frontier AI Agents), potężna i zróżnicowana rodzina modeli Frontier Nova oraz, co równie istotne, demokratyzacja procesu dostosowywania tych modeli do specyficznych potrzeb biznesowych.

Agenci graniczni: Koniec mikrozarządzania AI

Do tej pory interakcja z generatywną sztuczną inteligencją przypominała pracę ze stażystą, któremu trzeba patrzeć na ręce przy każdym kroku. AWS postanowił to zmienić, wprowadzając koncepcję Agentów Granicznych (Frontier Agents). To nowa, bardziej wyrafinowana klasa oprogramowania, którą wyróżniają trzy cechy: autonomia, skalowalność i niezależność.

W praktyce oznacza to zmianę paradygmatu z „chat-based” na „goal-based”. Użytkownik nie musi już prowadzić agenta za rękę przez kolejne etapy procesu. Wystarczy zdefiniować cel końcowy. Agenci ci potrafią rozbić złożone zadanie na podpunkty, rozdzielić pracę między sobą, a co najważniejsze – pracować w tle przez wiele godzin, a nawet dni, bez jakiejkolwiek interwencji człowieka. To właśnie ta trwałość działania i zdolność do utrzymywania kontekstu przez długi czas odróżnia ich od dotychczasowych rozwiązań.

Na froncie tej rewolucji stoi Kiro Autonomous Agent. To rozwiązanie, które ma szansę stać się „cyfrowym kolegą” każdego programisty. W przeciwieństwie do standardowych asystentów kodu, Kiro nie ogranicza się do podpowiadania składni w IDE. Jest to zasób współdzielony, który współpracuje z całym zespołem. Integruje się z repozytoriami, pipeline’ami CI/CD oraz narzędziami takimi jak Jira, GitHub czy Slack. Dzięki temu buduje „zrozumienie” bazy kodu, produktów i standardów panujących w firmie.

Kiro może samodzielnie zarządzać backlogiem, priorytetyzować błędy, a nawet proponować zmiany w kodzie obejmujące wiele repozytoriów jednocześnie. Co kluczowe, agent ten uczy się na podstawie historycznych pull requestów i informacji zwrotnych, stając się z czasem coraz bardziej kompetentnym członkiem zespołu. Programiści mogą delegować mu zadania („napraw ten bug i sprawdź, czy nie występuje w innych serwisach”), a sami skupić się na pracach koncepcyjnych o wyższym priorytecie. Ostateczna kontrola pozostaje w rękach człowieka (poprzez akceptację PR), ale „brudna robota” zostaje wykonana automatycznie.

DevSecOps na autopilocie

Równie imponująco wygląda wizja AWS dotycząca bezpieczeństwa i utrzymania operacyjnego (DevOps). Wprowadzenie AWS Security Agent oraz AWS DevOps Agent to odpowiedź na chroniczny brak specjalistów w tych dziedzinach oraz rosnącą złożoność systemów rozproszonych.

AWS Security Agent ma ambicję transformacji podejścia do bezpieczeństwa z reaktywnego na proaktywne. Zamiast polegać na statycznych listach kontrolnych uruchamianych na koniec procesu, agent ten towarzyszy cyklowi życia aplikacji od samego początku. Analizuje dokumentację projektową i kod pod kątem luk bezpieczeństwa specyficznych dla danej organizacji. Być może największą nowością jest jednak sprowadzenie testów penetracyjnych do roli usługi na żądanie. Zamiast powolnych, ręcznych audytów, agent może przeprowadzać testy penetracyjne skalowalne do całego portfolio aplikacji, dostarczając gotowe fragmenty kodu naprawczego. To rozwiązanie problemu wyboru między „szybkim wdrożeniem” a „bezpiecznym wdrożeniem”.

Z kolei AWS DevOps Agent celuje w redukcję tzw. „zmęczenia alertami” (alert fatigue). W nowoczesnych środowiskach wielochmurowych i hybrydowych znalezienie igły w stogu siana (czyli przyczyny awarii w gigabajtach logów) jest wyzwaniem. Agent ten nie tylko monitoruje system 24/7, ale w momencie incydentu samodzielnie koreluje dane telemetryczne, kod i historię wdrożeń, by wskazać pierwotną przyczynę problemu (Root Cause Analysis). Co więcej, działa proaktywnie – analizuje wzorce z przeszłości, by sugerować optymalizacje infrastruktury zanim w ogóle dojdzie do awarii.

Nova 2: Modele szyte na miarę, nie „jeden do wszystkiego”

Silnikiem napędzającym te autonomiczne byty jest nowa rodzina modeli Frontier Nova 2. AWS wyraźnie odchodzi od wyścigu na jeden, gigantyczny model, który potrafi wszystko. Zamiast tego, firma proponuje portfolio wyspecjalizowanych narzędzi, dobieranych w zależności od balansu między inteligencją, szybkością a kosztem.

W skład nowej rodziny wchodzą cztery modele:

1. Nova 2 Lite: Model szybkiego rozumowania, zaprojektowany do codziennych obciążeń biznesowych, chatbotów obsługi klienta czy przetwarzania dokumentów. Jego unikalną cechą jest możliwość dostosowania przez użytkownika głębokości rozumowania (step-by-step reasoning). Pozwala to na precyzyjne sterowanie kosztem i szybkością odpowiedzi w zależności od złożoności zapytania.

2. Nova 2 Pro: To „ciężka artyleria” intelektualna. Model ten, oprócz przetwarzania tekstu i głosu, specjalizuje się w zadaniach wymagających wysokiej precyzji: kodowaniu agencyjnym, zaawansowanej matematyce i planowaniu długoterminowym. Ciekawą funkcją jest jego rola „nauczyciela” – Nova 2 Pro może być wykorzystywany do destylowania wiedzy i szkolenia mniejszych, bardziej wydajnych modeli dla konkretnych domen.

3. Nova 2 Sonic: Prawdziwy przełom w interakcji głosowej. To model, który ujednolica rozumienie i generowanie tekstu oraz mowy, umożliwiając konwersację w czasie rzeczywistym z minimalnymi opóźnieniami. Obsługuje ekspresyjne głosy i pozwala na przerywanie wypowiedzi czy zmianę tematu w locie, co czyni go idealnym kandydatem do nowej generacji asystentów głosowych.

4. Nova 2 Omni: Multimodalny gigant, który zaciera granice między formatami danych. Potrafi przetwarzać jednocześnie tekst, obrazy, wideo i głos. Jego możliwości są imponujące – od analizy godzinnych nagrań wideo i setek stron dokumentacji, po jednoczesne przetwarzanie katalogów produktów i bibliotek multimedialnych.

Zarówno modele Lite, jak i Pro, posiadają wbudowaną zdolność „uziemienia” (grounding) w sieci oraz wykonywania kodu, co eliminuje problem halucynacji opartych na nieaktualnych danych.

Demokratyzacja i personalizacja: Nova Forge i Bedrock

Technologia to jedno, ale jej wdrożenie w biznesie to drugie. AWS doskonale rozumie, że największą wartością dla firm nie jest „surowy” model, ale model, który zna specyfikę ich biznesu. Dlatego obok samych modeli, zaprezentowano potężne narzędzia do ich dostosowywania.

AWS Nova Forge to środowisko pozwalające firmom na tworzenie tzw. „Novellas” (czyli niestandardowych wariantów modeli Nova). Dzięki otwartym usługom szkoleniowym, klienci mogą łączyć swoje zastrzeżone dane z potężnymi możliwościami modeli Frontier na każdym etapie – od pre-treningu po post-trening. Pozwala to na stworzenie modelu, który łączy ogólną wiedzę o świecie ze szczegółowym zrozumieniem wewnętrznych procesów firmy, przy zachowaniu pełnej kontroli nad bezpieczeństwem danych. Użytkownicy mogą również korzystać z własnych środowisk uczenia przez wzmocnienie (Reinforcement Learning).

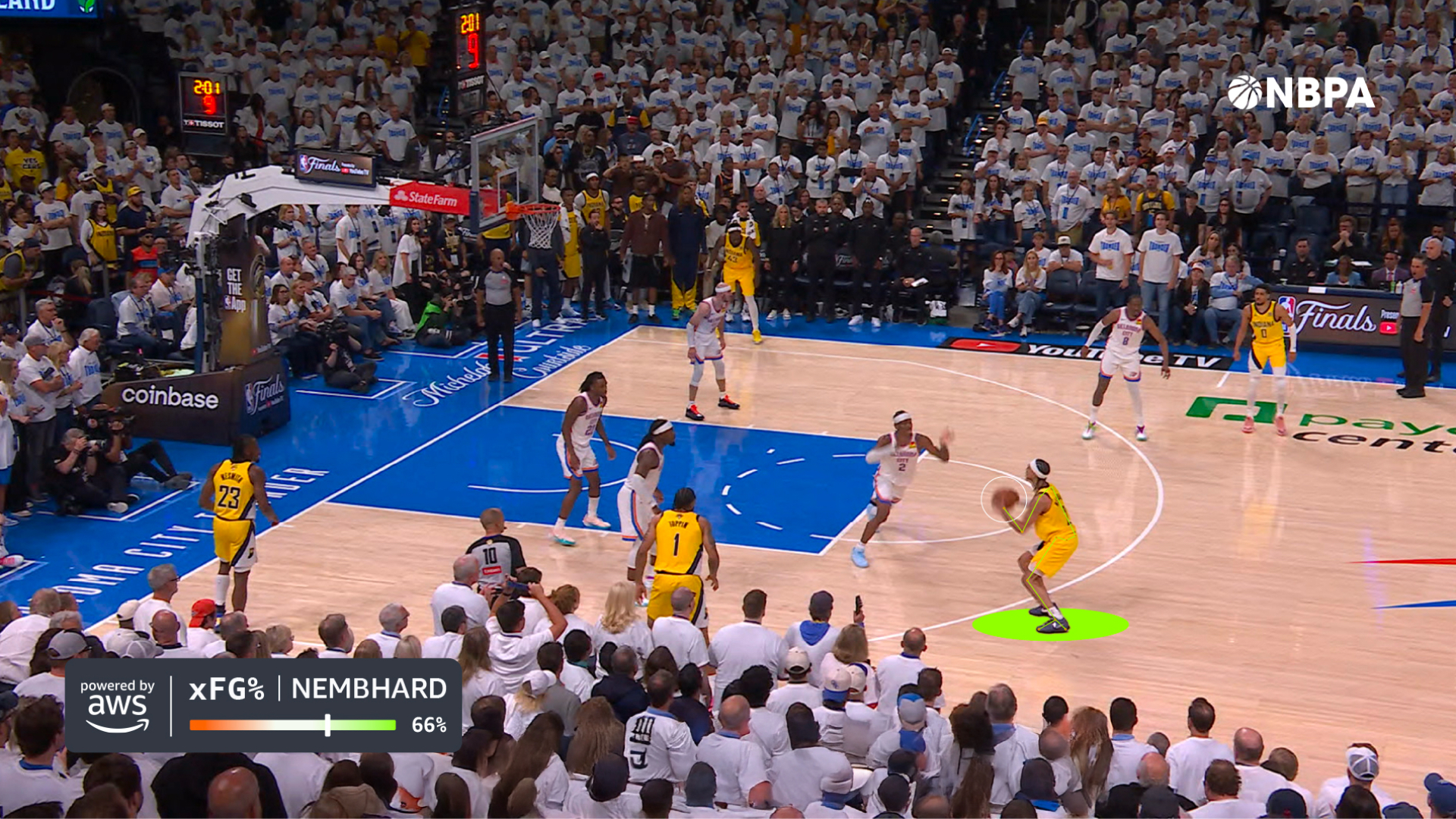

Dopełnieniem tej oferty są nowości w Amazon Bedrock i Amazon SageMaker AI. Wprowadzenie Reinforcement Fine Tuning (RFT) w Bedrock upraszcza proces dostrajania modeli, oferując średnio aż 66% poprawy dokładności w porównaniu do modeli bazowych. To kluczowa informacja dla dyrektorów finansowych – zamiast inwestować w gigantyczne, drogie w inferencji modele, firmy mogą osiągać lepsze wyniki, stosując mniejsze, tańsze i szybsze modele, które zostały precyzyjnie dotrenowane (fine-tuned) do konkretnego zadania.

Z kolei Amazon SageMaker AI wprowadza bezserwerowe dostosowywanie modeli, co drastycznie skraca czas wdrożenia – z tygodni do dni. Deweloperzy otrzymują wybór: mogą skorzystać z agenta, który przeprowadzi ich przez proces w języku naturalnym, lub przejąć pełną kontrolę nad parametrami, jeśli wymagają tego specyficzne potrzeby projektu.

Czy jesteśmy gotowi na autonomię?

Tegoroczny re:Invent to coś więcej niż tylko premiera nowych produktów. To manifest nowej filozofii pracy z technologią. AWS stawia tezę, że przyszłość IT nie należy do ludzi, którzy szybciej klikają w klawiaturę dzięki podpowiedziom AI, ale do ludzi, którzy potrafią zarządzać flotą autonomicznych agentów wykonujących pracę za nich.

Narzędzia takie jak Kiro, Nova Act (umożliwiający agentom wykonywanie działań w przeglądarkach) czy wyspecjalizowane modele Nova 2, tworzą ekosystem, w którym bariera wejścia do tworzenia zaawansowanego oprogramowania drastycznie maleje, a efektywność operacyjna rośnie. Pozostaje jednak pytanie otwarte: jak szybko organizacje będą gotowe zaufać autonomii agentów? Oddanie kontroli nad repozytorium kodu czy testami bezpieczeństwa w „ręce” AI wymaga nie tylko zmiany technologicznej, ale przede wszystkim mentalnej. Jedno jest pewne – po re:Invent 2025 wyścig zbrojeń w branży IT przeniósł się na zupełnie nowy poziom.