Rynek HaaS dynamicznie rośnie, napędzany potrzebą elastyczności finansowej, szybkiego dostępu do nowoczesnych technologii i uproszczonego zarządzania infrastrukturą IT. Wraz z jego rozwojem pojawiają się jednak pytania o realne korzyści, ukryte koszty oraz granicę między usługą a klasycznym leasingiem.

Firmy nieustannie poszukują modeli, które zapewnią im większą elastyczność, niższe koszty i dostęp do nowoczesnych technologii. Jednym z takich rozwiązań, które w ostatnim czasie zyskało na popularności, a jednocześnie wywołuje sporo dyskusji, jest Hardware-as-a-Service (HaaS). Czy to rzeczywista zmiana paradygmatu, czy tylko nowe opakowanie dla znanych już koncepcji?

Czym właściwie jest HaaS? To więcej niż leasing

Hardware-as-a-Service to model oparty na subskrypcji, w którym firmy płacą stałą opłatę za korzystanie ze sprzętu – komputerów, serwerów czy urządzeń sieciowych – zamiast inwestować w ich zakup. Kluczowa różnica między HaaS a klasycznym leasingiem tkwi w elemencie usługowym. W ramach oferty dostawcy często zapewniają instalację, bieżące utrzymanie, aktualizacje oraz wsparcie techniczne. Całością cyklu życia sprzętu zarządza dostawca HaaS, najczęściej Managed Service Provider (MSP).

Zakres tego modelu jest bardzo szeroki – od podstawowego wyposażenia biurowego, przez sprzęt medyczny, aż po drony. Warto jednak podkreślić, że definicja HaaS nie jest jednoznaczna. Niektóre oferty przypominają raczej klasyczny leasing (tzw. „HaaS-lite”), podczas gdy bardziej zaawansowane modele – takie jak Device-as-a-Service (DaaS) czy PC-as-a-Service (PCaaS) – obejmują kompleksowe zarządzanie całym środowiskiem sprzętowym. To właśnie ta różnorodność sprawia, że HaaS budzi tyle pytań o swoją realną wartość.

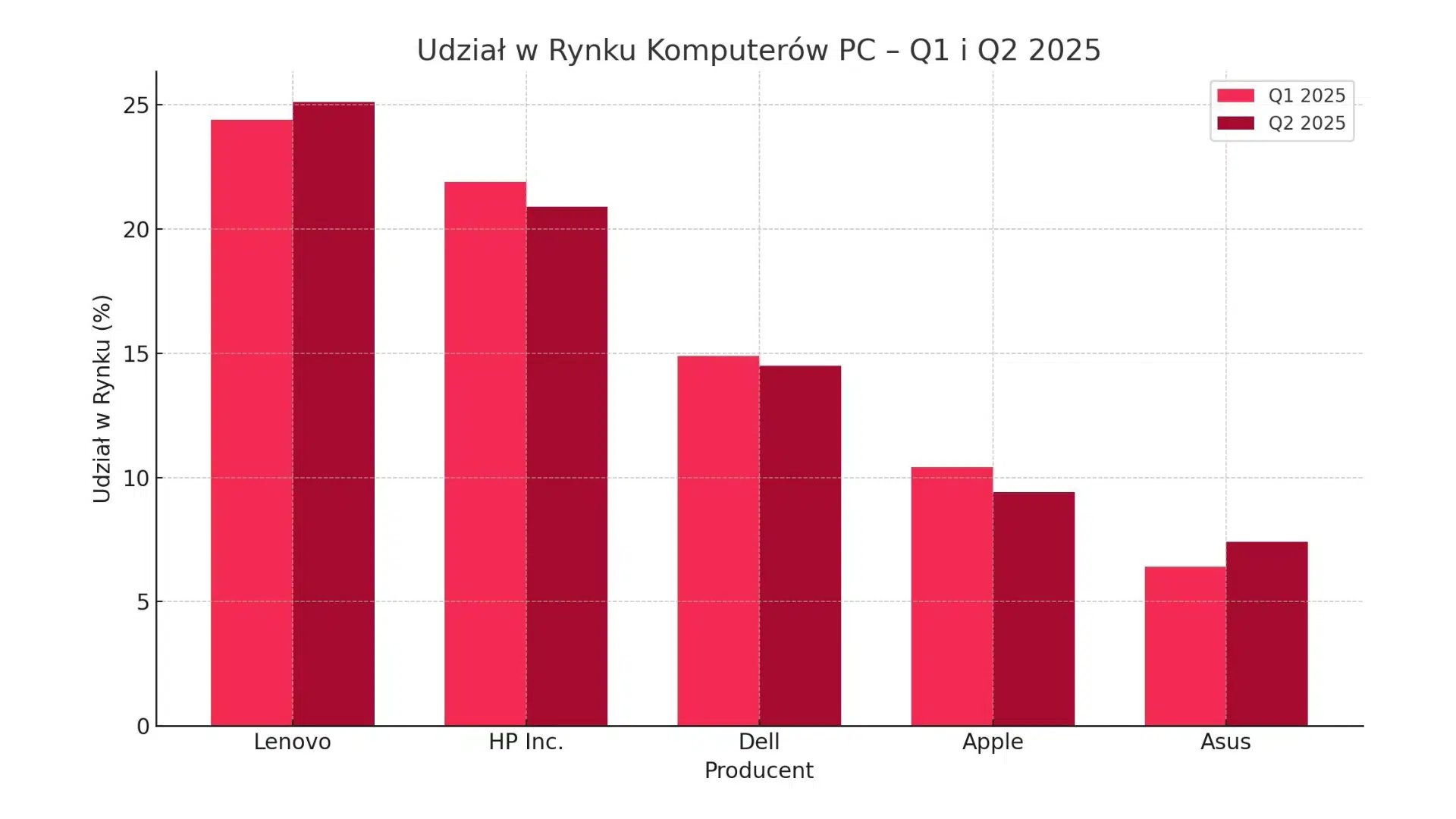

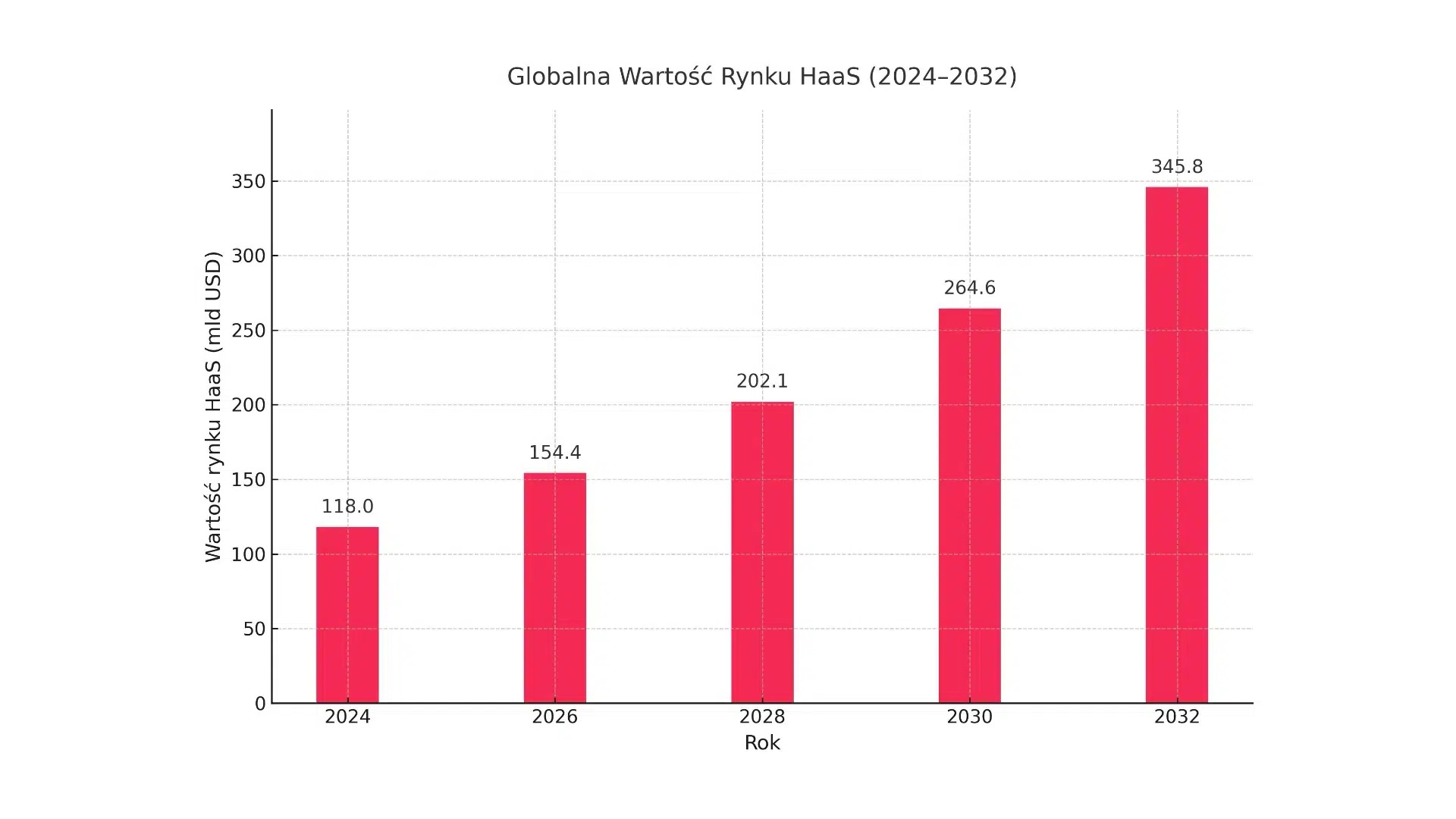

HaaS w liczbach

Rynek Hardware-as-a-Service rozwija się w imponującym tempie, choć dane z różnych źródeł bywają rozbieżne – często z powodu odmiennych definicji i metodologii badawczych.

Business Research Insights szacuje wartość rynku HaaS na 153,7 mld USD w 2024 roku, prognozując wzrost do 214,4 mld USD do 2033 roku. Wskaźnik CAGR w tym przypadku to około 39,5%, choć inne dane tej samej firmy sugerują raczej 15%. Z kolei Introspective Market Research ocenia rynek na 90,02 mld USD w 2023 roku, z prognozą wzrostu do 890,49 mld USD do 2032 roku (CAGR 29,00%). Global Growth Insights podaje wartość 82,58 mld USD w 2024 roku i prognozuje 261,20 mld USD do 2033 roku (CAGR 13,65%). Według Verified Market Research, rynek wart jest 52 mld USD w 2024 roku i osiągnie 122 mld USD do 2032 roku, co przekłada się na CAGR rzędu 14,5%.

Pomimo różnic w liczbach, wszystkie raporty są zgodne co do jednego: rynek HaaS rośnie dynamicznie.

Najczęściej oferowane w tym modelu są komputery, serwery, urządzenia sieciowe i systemy przechowywania danych. Kluczowe branże to IT i telekomunikacja, sektor bankowo-finansowy (BFSI), opieka zdrowotna oraz edukacja. Choć obecnie dominuje Ameryka Północna, najszybszy wzrost notuje region Azji i Pacyfiku – sygnalizując coraz szerszy dostęp do technologii, szczególnie wśród małych i średnich przedsiębiorstw.

Obietnice HaaS

Model Hardware-as-a-Service przyciąga przedsiębiorstwa szeregiem konkretnych korzyści. Jedną z najważniejszych jest możliwość przekształcenia wydatków inwestycyjnych (CAPEX) w operacyjne (OPEX), co zwiększa elastyczność finansową. Zamiast ponosić wysokie koszty zakupu sprzętu, firmy płacą stałą opłatę subskrypcyjną, co znacząco poprawia ich płynność. Nie dziwi więc, że aż 66% organizacji preferuje modele finansowania oparte właśnie na OPEX.

Kolejną zaletą jest skalowalność oraz dostęp do najnowszych technologii. Przedsiębiorstwa mogą elastycznie zwiększać lub zmniejszać liczbę urządzeń w zależności od aktualnych potrzeb, a dostawcy HaaS dbają o regularne odświeżanie sprzętu. Dzięki temu firmy minimalizują ryzyko pracy na przestarzałych rozwiązaniach.

HaaS upraszcza także zarządzanie infrastrukturą IT. Obowiązki związane z instalacją, konserwacją, naprawami czy aktualizacjami przejmuje dostawca, co znacząco odciąża wewnętrzne zespoły techniczne.

Nie bez znaczenia jest również wpływ tego modelu na bezpieczeństwo i zgodność z regulacjami. Regularnie aktualizowany, zarządzany sprzęt pozwala lepiej chronić dane i wspiera spełnianie wymogów prawnych.

Na koniec warto wspomnieć o aspekcie zrównoważonego rozwoju. Dostawcy HaaS coraz częściej biorą odpowiedzialność za recykling lub ponowne wykorzystanie sprzętu, wspierając tym samym idee gospodarki cyrkularnej.

Druga strona medalu: ryzyka i wyzwania

Choć model HaaS oferuje wiele korzyści, wiąże się również z istotnymi ryzykami, które firmy powinny uwzględnić przed podjęciem decyzji o jego wdrożeniu.

Jednym z kluczowych wyzwań jest całkowity koszt posiadania (TCO). Choć miesięczne opłaty subskrypcyjne mogą wydawać się korzystne, w dłuższej perspektywie korzystanie z HaaS może okazać się droższe niż tradycyjny zakup sprzętu, zwłaszcza jeśli urządzenia są wykorzystywane przez wiele lat. Dlatego niezbędna jest szczegółowa analiza TCO, uwzględniająca wszystkie opłaty i warunki finansowe.

Kolejnym problemem mogą być pułapki kontraktowe. Długoterminowe umowy mogą prowadzić do silnego uzależnienia od dostawcy, czyli tzw. vendor lock-in. Koszty wcześniejszego zerwania kontraktu bywają wysokie, a w zapisach umowy mogą się kryć niekorzystne klauzule, które ujawniają się dopiero w praktyce.

Istotne są również kwestie związane z bezpieczeństwem danych i prywatnością. Przekazanie infrastruktury oraz danych zewnętrznemu dostawcy zawsze rodzi pytania o poziom zabezpieczeń i zgodność z regulacjami, takimi jak RODO. Kluczowe jest zatem zrozumienie, jakie środki ochrony stosuje dostawca i w jaki sposób dba o zgodność z przepisami.

Model HaaS może też oznaczać pewne ograniczenia w zakresie personalizacji i kontroli. Standardowe konfiguracje oferowane przez dostawców nie zawsze odpowiadają indywidualnym potrzebom firm, co może utrudniać dostosowanie sprzętu do specyfiki działania organizacji.

Ostatecznie skuteczność wdrożenia HaaS zależy od dojrzałości samego dostawcy oraz jakości zawartej umowy. Wybór nieodpowiedniego partnera lub zbyt powierzchowna analiza kontraktu mogą prowadzić do kosztownych problemów i rozczarowań.

HaaS w praktyce: więcej niż leasing?

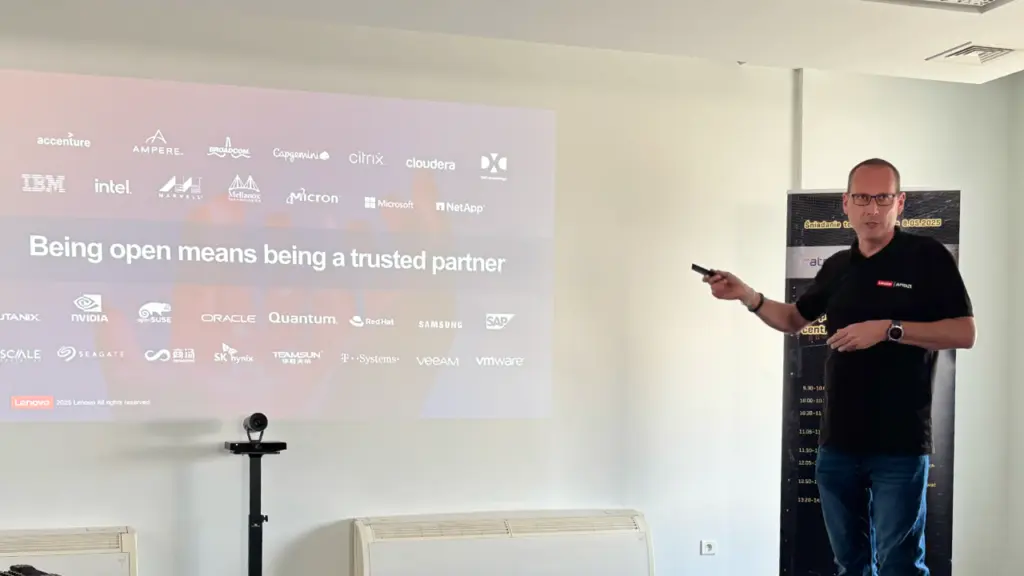

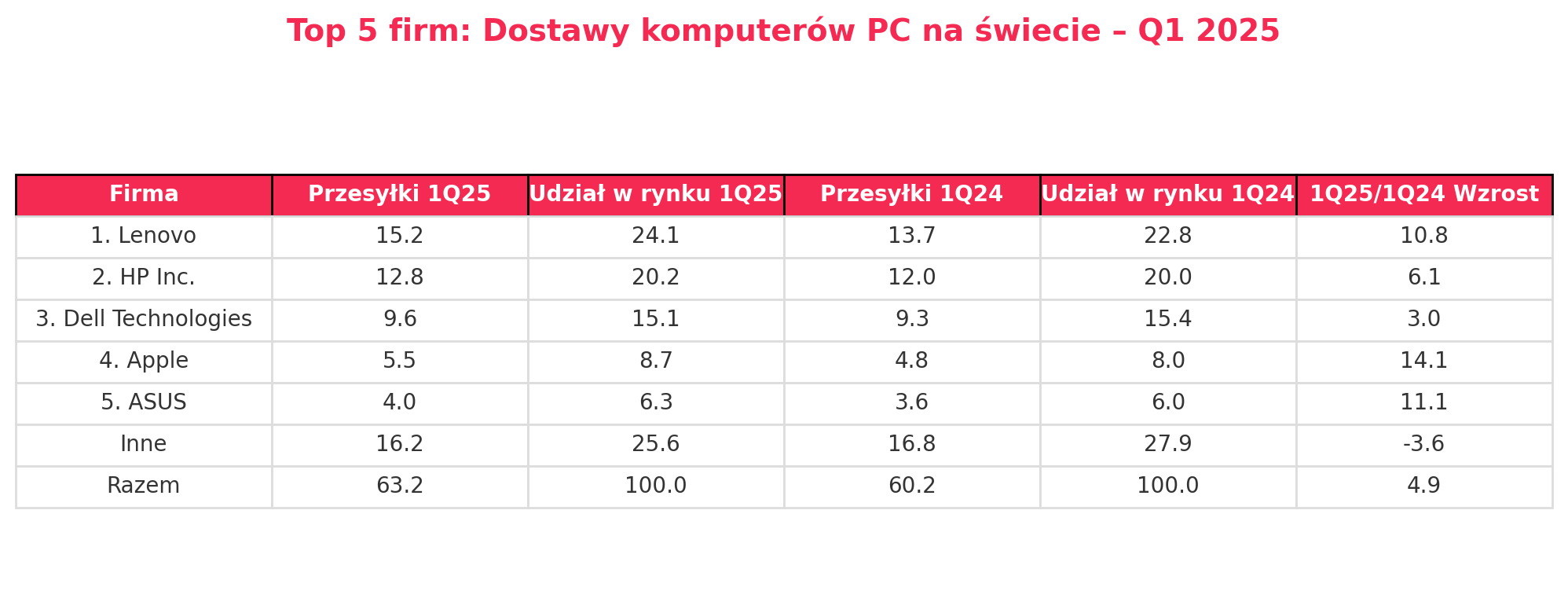

Wiodący producenci, tacy jak Dell (APEX PCaaS), HP (DaaS) czy Lenovo (TruScale DaaS), oferują dziś zaawansowane rozwiązania, które łączą sprzęt z pełnym zarządzaniem cyklem życia, wsparciem technicznym i komponentem analitycznym. Takie dojrzałe modele DaaS i PCaaS wykraczają daleko poza klasyczny leasing – ich istotą jest zintegrowane podejście, w którym usługa jest równie ważna jak sam sprzęt.

Model HaaS znajduje zastosowanie w wielu branżach. W sektorze IT i telekomunikacji pomaga w optymalizacji infrastruktury, w ochronie zdrowia umożliwia dostęp do nowoczesnego sprzętu medycznego, a w edukacji wspiera cyfrowe narzędzia nauczania. W przemyśle wykorzystywany jest w inteligentnych fabrykach, natomiast w handlu detalicznym sprawdza się jako baza dla systemów POS.

Doświadczenia firm korzystających z HaaS są jednak zróżnicowane. Wiele z nich wskazuje na wymierne korzyści – oszczędności, lepsze zarządzanie zasobami IT czy uproszczenie operacji. Zdarzają się jednak także negatywne opinie. Część klientów sygnalizuje poczucie „uwięzienia” w sztywnych kontraktach, niejasne warunki umów, rozczarowanie ograniczonym zakresem usług – szczególnie tam, gdzie HaaS okazuje się być jedynie klasycznym leasingiem w nowym opakowaniu – oraz problemy z wydajnością dostarczanego sprzętu.

Wpływ nowych technologii

Model Hardware-as-a-Service nieustannie ewoluuje pod wpływem dynamicznego rozwoju takich technologii jak Internet Rzeczy (IoT), Edge Computing czy sztuczna inteligencja (AI).

Rozwiązania IoT generują rosnące zapotrzebowanie na różnorodne urządzenia, a HaaS pozwala firmom elastycznie wdrażać ten sprzęt bez konieczności dużych inwestycji początkowych. W przypadku Edge Computingu kluczowa staje się niezawodna infrastruktura brzegowa, którą HaaS może dostarczać w sposób skalowalny i szybki. Z kolei rozwój AI nie tylko zwiększa popyt na wysokowydajny sprzęt, ale też może zrewolucjonizować sam model HaaS – na przykład poprzez zastosowanie predykcyjnego utrzymania sprzętu czy personalizację ofert w oparciu o analizę danych.

Dzięki temu HaaS staje się jednym z filarów cyfrowej transformacji. Ułatwia firmom pracę w modelach zdalnym i hybrydowym, umożliwia sprawną integrację z chmurą i zapewnia dostęp do nowoczesnych rozwiązań przy zachowaniu elastyczności finansowej.

Globalny trend czy marketingowa etykieta?

Za tym, że HaaS jest realnym trendem rynkowym, przemawia kilka istotnych argumentów: mocne dane o wzroście rynku, widoczne zaangażowanie globalnych producentów, ewolucja samego modelu oraz rosnąca popularność subskrypcyjnego podejścia do pozyskiwania technologii. Model ten odpowiada na rzeczywiste potrzeby biznesu – szczególnie w zakresie elastyczności, szybkości wdrożeń i odciążenia działów IT.

Z drugiej strony nie brakuje wątpliwości. Wśród zastrzeżeń pojawiają się obawy o wyższy całkowity koszt posiadania (TCO) w dłuższym okresie, ryzyko pułapek kontraktowych i vendor lock-in, kwestie bezpieczeństwa danych czy ograniczenia w zakresie personalizacji. Często też okazuje się, że pod hasłem HaaS kryje się niewiele więcej niż klasyczny leasing w nowym opakowaniu.

Rzeczywiście wartościowy HaaS – zazwyczaj funkcjonujący jako Device-as-a-Service (DaaS) lub PC-as-a-Service (PCaaS) – obejmuje znacznie więcej niż samo udostępnienie sprzętu. To m.in. zarządzanie pełnym cyklem życia urządzeń, proaktywne wsparcie techniczne, analityka użytkowania i automatyzacja procesów. To właśnie te elementy sprawiają, że HaaS staje się rozwiązaniem transformacyjnym, a nie tylko finansową alternatywą.

Model HaaS może być świetnym wyborem dla firm, które chcą uniknąć wysokich kosztów początkowych, potrzebują skalowalności i szybkiego dostępu do nowoczesnych technologii, a także dążą do odciążenia wewnętrznych zasobów IT. Z kolei w przypadku stabilnych potrzeb sprzętowych, długiego cyklu życia urządzeń lub konieczności pełnej kontroli, bardziej opłacalny może okazać się zakup lub tradycyjny leasing.

Podsumowując, Hardware-as-a-Service to realny trend, który – szczególnie w swoich dojrzałych formach – może skutecznie wspierać cyfrową transformację firm. Jednak sukces jego wdrożenia zależy przede wszystkim od świadomej analizy potrzeb, jakości oferty oraz doboru odpowiedniego partnera. Im bardziej kompleksowy zakres usług, tym większa szansa, że HaaS rzeczywiście stanie się narzędziem rozwoju, a nie źródłem problemów.