Polska scena technologiczna dojrzewa w ekspresowym tempie. Mit o kraju będącym jedynie zapleczem utalentowanych programistów ustępuje miejsca nowej rzeczywistości: Polska staje się generatorem innowacji, a polskie startupy rodzą się z globalnymi ambicjami wpisanymi w ich DNA.

Dla nich ekspansja to nie odległy cel, lecz strategiczna konieczność od pierwszego dnia działalności. Twarde dane potwierdzają ten trend – aż 91% polskich startupów planuje rozwój na rynkach zagranicznych.

W przeciwieństwie do amerykańskich firm, które mogą budować swoją potęgę na ogromnym rynku wewnętrznym, polskie spółki muszą myśleć globalnie, by osiągnąć skalę. Ta pozorna słabość staje się ich siłą, wymuszając tworzenie produktów konkurencyjnych na światowym poziomie od samego startu.

Globalny kompas: główne kierunki polskiej ekspansji

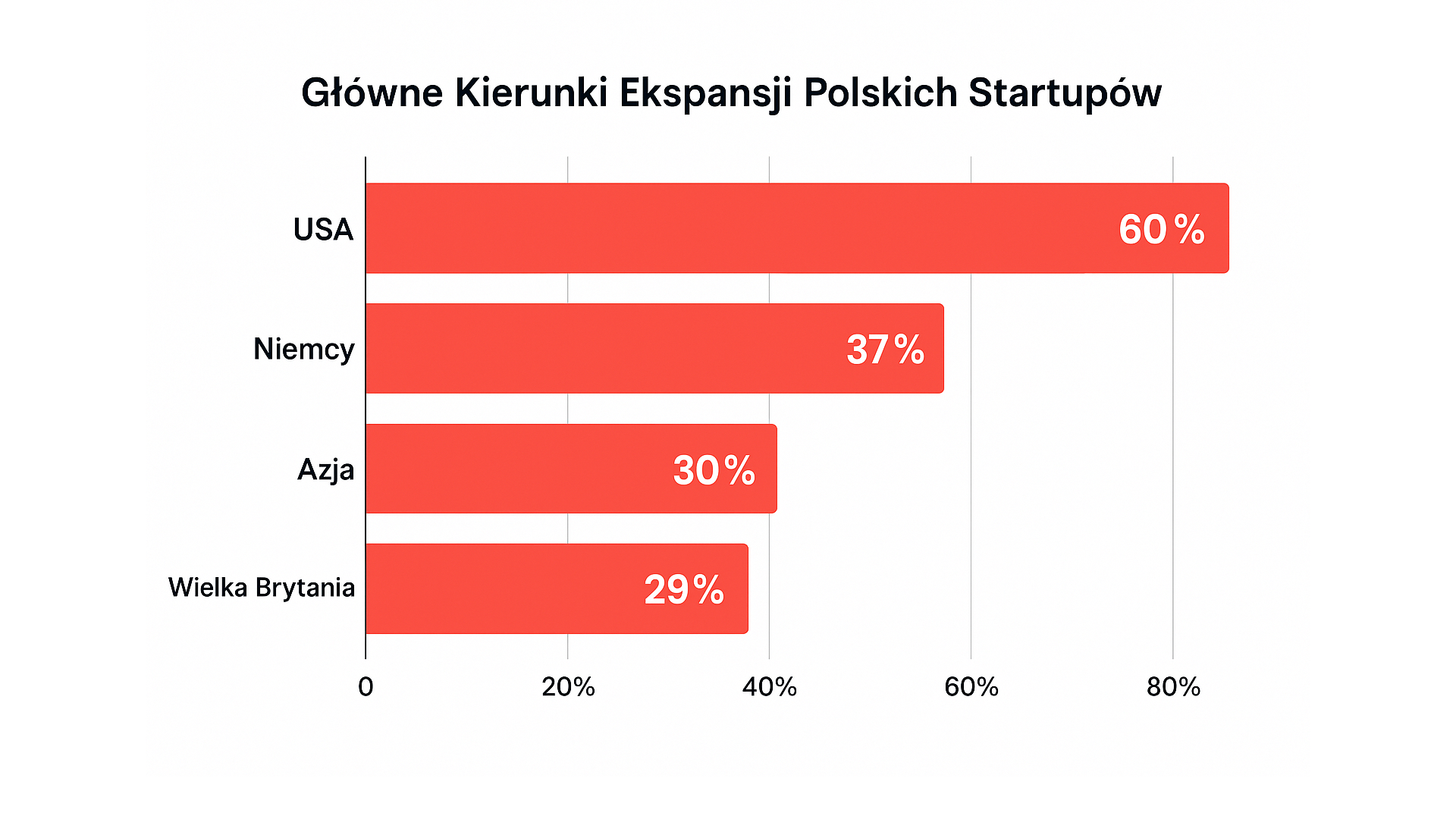

Ambicje polskich founderów przekładają się na konkretne, strategiczne decyzje. Analiza danych z raportu Startup Poland 2024 pozwala nakreślić mapę przepływu innowacji i kapitału, wskazując cztery kluczowe areny globalnej rywalizacji.

Zdecydowanym liderem są Stany Zjednoczone, cel dla aż 60% firm, które przyciąga obietnica dostępu do największych inwestorów i gigantycznej bazy klientów.

W Europie najpopularniejszym kierunkiem są Niemcy, wskazywane przez 37% startupów, dla których bliskość geograficzna i silne powiązania handlowe stanowią naturalny pierwszy krok na Zachód.

Mimo zawirowań związanych z Brexitem, Wielka Brytania pozostaje atrakcyjna dla 29% firm, z Londynem wciąż pełniącym rolę globalnego centrum finansów i technologii. Coraz śmielej polskie firmy spoglądają też w stronę Azji – ten kierunek rozważa 30% przedsiębiorstw, doceniając potencjał tamtejszych rynków konsumenckich.

Motywacje są równie istotne co kierunki. Poza oczywistymi celami, jak zwiększenie przychodów, aż 46% startupów poszukuje za granicą tzw. „smart money” – finansowania połączonego ze strategicznym doradztwem i dostępem do sieci kontaktów. To znak dojrzałości ekosystemu.

Polscy founderzy rozumieją, że choć kapitał na wczesnym etapie jest dostępny w kraju, to globalny sukces wymaga wsparcia inwestorów z międzynarodowym doświadczeniem. Czek od funduszu z Doliny Krzemowej to nie tylko pieniądze – to walidacja modelu biznesowego i bilet wstępu do pierwszej ligi.

Analiza rynków: przewodnik strategiczny

Każdy z głównych rynków docelowych oferuje unikalny zestaw szans i wyzwań, wymagając od polskich firm przyjęcia odmiennej strategii.

Stany Zjednoczone: gra o najwyższą stawkę

USA to Ziemia Obiecana technologii, gdzie sukces oznacza wejście do globalnej elity. Rynek ten oferuje niezrównany dostęp do kapitału – w 2023 roku zainwestowano tam 170.6 mld USD, w porównaniu do zaledwie 45 mld USD w Europie.

Ogromny, jednolity rynek i kultura szybkiej adopcji technologii stwarzają idealne warunki do błyskawicznego skalowania. Jednak za tymi szansami kryją się ogromne bariery: hiperkonkurencja, astronomiczne koszty operacyjne oraz złożoność prawna i regulacyjna.

W odpowiedzi na te warunki polskie startupy wypracowały dominujący model wejścia na rynek, znany jako „flipping”. Polega on na założeniu amerykańskiej spółki-matki (najczęściej w stanie Delaware), która pozyskuje kapitał od funduszy VC i prowadzi sprzedaż, podczas gdy trzon zespołu inżynierskiego pozostaje w Polsce.

Ten hybrydowy model pozwala maksymalizować dostęp do kapitału i klientów, jednocześnie minimalizując koszty rozwoju produktu.

Wielka Brytania: szansa w chaosie po brexicie

Rynek brytyjski, wybierany przez 29% firm, to arena pełna sprzeczności. Brexit wprowadził nowe bariery handlowe i administracyjne, ale jednocześnie stworzył rynkową próżnię. Część mniej zdeterminowanych firm z UE wycofała się, co otwiera drzwi dla zwinnych polskich graczy, zdolnych do adaptacji.

Wzrost polskiego eksportu do Wielkiej Brytanii o 14% rok do roku jest tego najlepszym dowodem. Londyn pozostaje przy tym globalnym hubem, zwłaszcza w sektorze FinTech, oferując dostęp do talentów i kapitału. Sukces w post-brexitowej Wielkiej Brytanii jest więc miarą nie tylko jakości produktu, ale także doskonałości operacyjnej.

Niemcy: cyfrowy partner przemysłowego giganta

Niemcy, cel dla 37% startupów, to kierunek logiczny, oparty na bliskości geograficznej i potężnych więziach gospodarczych. Największą szansą jest tu proces cyfrowej transformacji niemieckiego przemysłu (Przemysł 4.0), który generuje ogromny popyt na oprogramowanie B2B, rozwiązania IoT i automatyzację.

Polskie firmy, ze swoimi silnymi kompetencjami inżynierskimi, mogą pozycjonować się jako zwinni partnerzy w modernizacji niemieckiego „Mittelstandu”. Wyzwaniem pozostaje jednak konserwatywna kultura biznesowa, która może wydłużać cykle sprzedażowe, oraz spowalniająca gospodarka i biurokracja.

Region CEE: strategiczny poligon doświadczalny

Dla polskich startupów Europa Środkowo-Wschodnia pełni rolę idealnego środowiska „przed-skalowania”. Bliskość kulturowa i niższe koszty wejścia pozwalają przetestować model internacjonalizacji przy mniejszym ryzyku, zanim firma zdecyduje się na podbój rynków zachodnich.

To tutaj polskie firmy mogą zbudować swój „mięsień internacjonalizacji” – nauczyć się zarządzać zagranicznymi zespołami i adaptować produkt do lokalnych potrzeb. Sukces w Czechach czy Rumunii dostarcza bezcennych referencji, które wzmacniają pozycję w rozmowach z globalnymi inwestorami.

Główną barierą regionu pozostaje jednak niedobór kapitału na późniejszych etapach rozwoju, tzw. „klif Serii A”.

Uniwersalne wyzwania na drodze do globalizacji

Niezależnie od obranego kierunku, polskie startupy napotykają na wspólny zestaw barier. Najpoważniejszą z nich są trudności w pozyskaniu finansowania, na co wskazuje 55% firm. Problem jest szczególnie dotkliwy na etapie wzrostu, gdy potrzebne są duże rundy inwestycyjne do agresywnego skalowania.

Drugą kluczową barierą są wysokie koszty zatrudnienia (wskazywane przez 54% startupów), dotyczące zarówno rosnących płac w Polsce, jak i konieczności zatrudniania drogich specjalistów na rynkach docelowych.

Trzeci obszar to złożoność prawna i biurokracja, która w kontekście międzynarodowym jest zwielokrotniona przez mnogość systemów podatkowych i regulacji.

Kluczem do sukcesu jest proaktywne adresowanie tych wyzwań poprzez przemyślaną strategię: budowanie relacji z międzynarodowymi funduszami VC na długo przed rundą, wdrażanie hybrydowych modeli operacyjnych oraz inwestycje w dogłębną lokalizację produktu i marketingu.

Polska jako globalny hub innowacji

Analiza globalnych aspiracji polskich startupów prowadzi do jednego wniosku: jesteśmy świadkami końca ery, w której polskie firmy technologiczne były definiowane przez swoją geografię. Ekspansja staje się normą, tworząc potężne koło zamachowe dla całego ekosystemu.

Founderzy, którzy odnieśli sukces za granicą, wracają z bezcennym kapitałem wiedzy, stając się nową generacją aniołów biznesu i mentorów. Każdy kolejny międzynarodowy sukces toruje drogę następnym.

Polska przechodzi transformację z bycia źródłem talentów w bycie generatorem globalnych firm technologicznych. Droga ta jest pełna wyzwań, jednak ambicje są jasno określone, a mapa prowadząca do globalnego sukcesu staje się coraz lepiej poznanym szlakiem.