Japońscy naukowcy ustanowili nowy rekord prędkości Internetu: 125 000 gigabitów na sekundę, czyli 125 terabitów. To ponad dwa razy więcej niż poprzedni rekord z 2024 roku, który wynosił 50 250 Gb/s. Takie tempo transferu pozwoliłoby pobrać całe Internet Archive – ponad 40 petabajtów danych – w mniej niż cztery minuty. Jednak istotą tego osiągnięcia nie jest sam wynik, lecz technologia, która może zmienić reguły gry w projektowaniu infrastruktury telekomunikacyjnej.

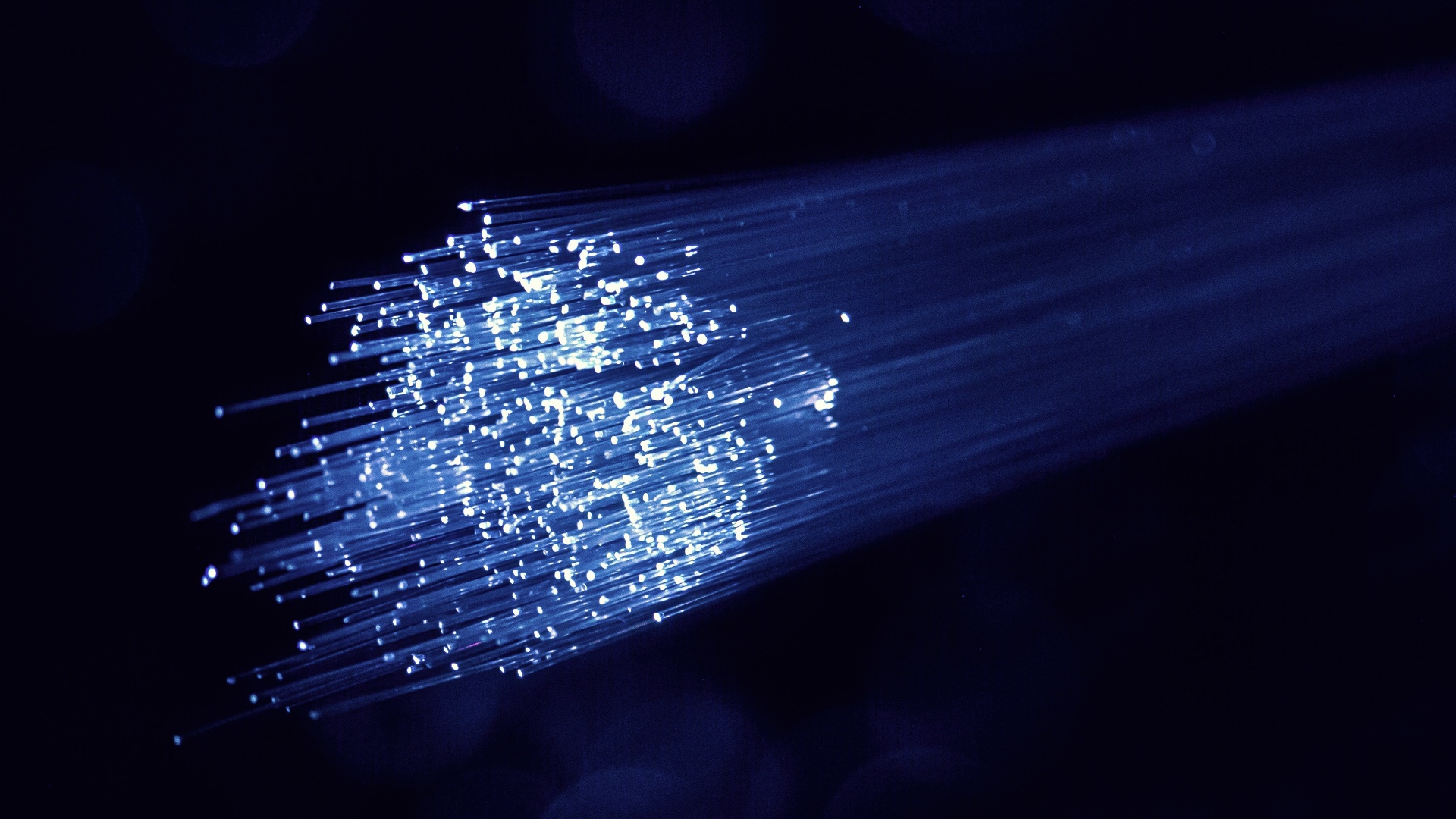

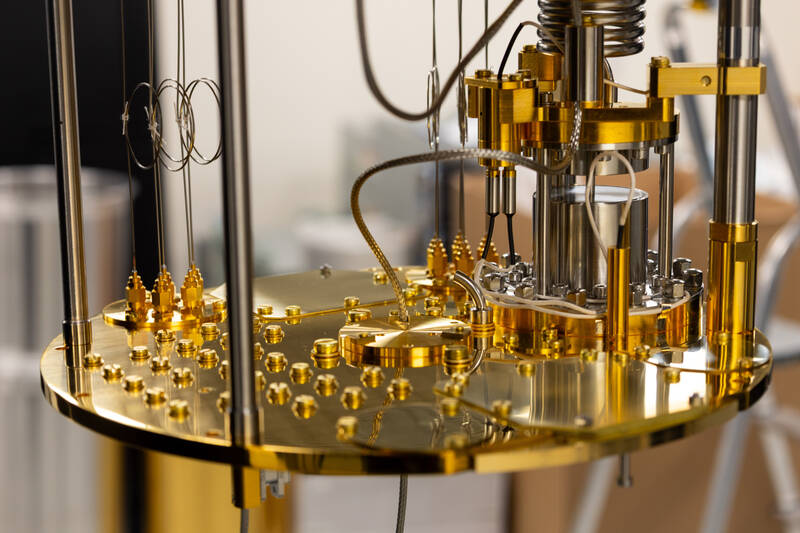

Nowy rekord to efekt badań zespołu z Narodowego Instytutu Technologii Informacyjnych i Komunikacyjnych (NICT) w Japonii. Kluczowym elementem ich rozwiązania jest nowy typ światłowodu, który łączy 19 niezależnych kanałów transmisji w jednej wiązce o średnicy zaledwie 0,127 mm – dokładnie tyle, ile mają obecnie stosowane pojedyncze włókna. Mimo wielokanałowości kabel nie wymaga więc zmiany fizycznej infrastruktury. To otwiera możliwość wdrażania superszybkich łączy w ramach istniejącej sieci światłowodowej.

Osiągnięcie prędkości rzędu 125 Tb/s na dystansie ponad 1800 km – porównywalnym z trasą z Nowego Jorku na Florydę – to także przełom w zakresie długodystansowej transmisji danych. Do tej pory duża przepustowość często oznaczała duże straty sygnału i konieczność gęstego rozmieszczania wzmacniaczy. Japończycy rozwiązali ten problem dzięki nowej konstrukcji włókien, które zachowują stabilne właściwości świetlne na całej długości kabla. Dane były przesyłane przez system aż 21 razy, zanim dotarły do odbiornika – bez istotnej utraty jakości.

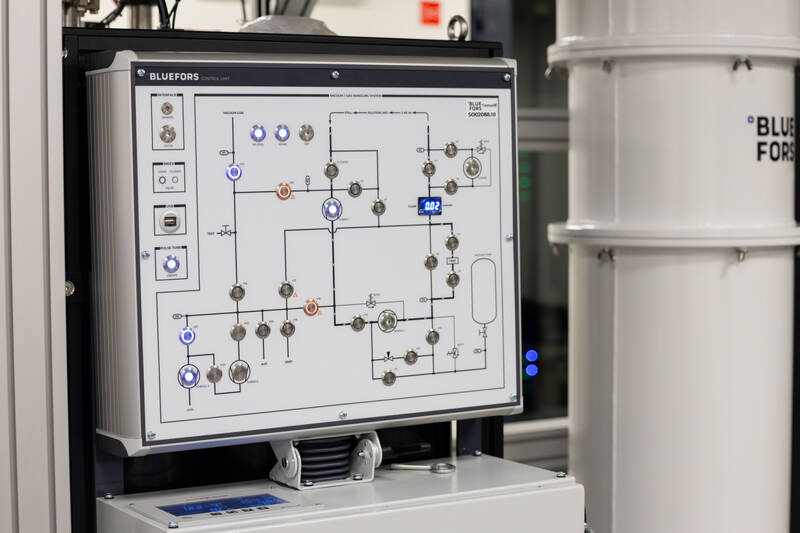

Choć osiągnięcie nie zostało jeszcze niezależnie zweryfikowane, a technologia pozostaje w fazie eksperymentalnej, stanowi istotny sygnał dla rynku telekomunikacyjnego. W ciągu ostatnich kilku lat świat obserwuje wyścig o wydajność w transmisji danych – popyt napędzany jest przez AI, chmurę, wideo 4K/8K i przemysłowy IoT. Z raportów Cisco i Nokia wynika, że globalny ruch IP rośnie średnio o 25–30% rocznie. W takim tempie obecne systemy sieciowe mogą w ciągu dekady osiągnąć granice wydolności.

Nowe rozwiązanie z Japonii wpisuje się w szerszy trend rozwoju tzw. światłowodów wielordzeniowych (MCF – multicore fiber). Już dziś są one testowane w Europie i USA jako potencjalna alternatywa dla „grubych” wiązek kabli, szczególnie w infrastrukturze szkieletowej. Przewaga japońskiej konstrukcji polega jednak na tym, że może być wdrażana bez przebudowy istniejących kanałów kablowych i instalacji.

Na komercjalizację tego typu technologii przyjdzie jeszcze poczekać. Historia światłowodów pokazuje jednak, że to, co dziś uchodzi za eksperyment, za dekadę może być standardem. Jeśli tak się stanie, infrastruktura telekomunikacyjna stanie się nie tylko szybsza, ale też bardziej energooszczędna i odporna na przeciążenia. A to kluczowe, jeśli cyfrowa gospodarka ma rosnąć dalej.