Rok 2025 na europejskiej scenie technologicznej to czas pozornych sprzeczności. Z jednej strony, dane wskazują na historycznie niski poziom fundraisingu funduszy Venture Capital – w pierwszym półroczu zebrano zaledwie 5,2 mld euro, co stawia bieżący rok na drodze do najsłabszego wyniku od dekady.

Z drugiej strony, ten sam rynek jest świadkiem rekordowych, wielomilionowych rund finansowania dla wybranych firm, a wyceny dojrzałych spółek rosną do nienotowanych wcześniej poziomów. Ta dychotomia nie jest oznaką słabości, lecz głębokiej rekalibracji całego ekosystemu.

W 2025 roku europejski rynek technologiczny przechodzi od fazy szerokiego, oportunistycznego wzrostu do etapu strategicznej głębi. Kapitał, choć trudniej dostępny, jest lokowany w sposób bardziej skoncentrowany i przemyślany.

Inwestorzy celują w sektory o kluczowym znaczeniu dla przyszłej konkurencyjności i suwerenności kontynentu: Sztuczną Inteligencję (AI), Deep Tech, HealthTech oraz technologie obronne. To zwrot napędzany zarówno przez pragmatyzm prywatnych inwestorów, jak i świadomą politykę przemysłową funduszy publicznych.

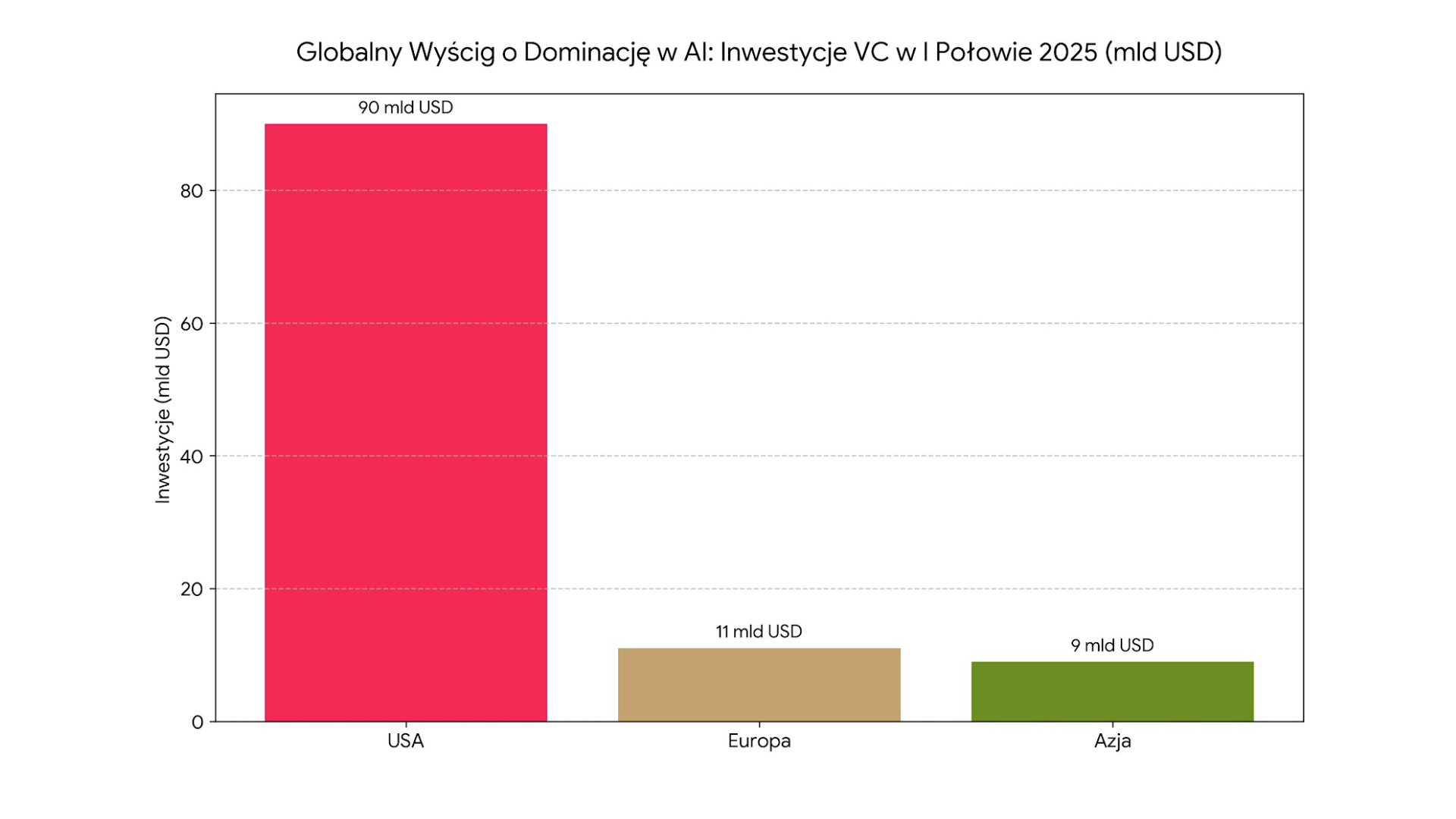

Globalna arena AI: europejski gambit w wyścigu zdominowanym przez USA

Dane z pierwszej połowy 2025 roku jednoznacznie pokazują, że globalny krajobraz inwestycji w sztuczną inteligencję jest zdominowany przez Stany Zjednoczone. Skala amerykańskiej dominacji jest przytłaczająca.

W pierwszym kwartale 2025 roku inwestycje VC w USA osiągnęły wartość 91,5 mld USD, podczas gdy w Europie było to 18 mld USD, a w regionie Azji i Pacyfiku zaledwie 12,9 mld USD. W obszarze generatywnej AI, która przyciąga najwięcej uwagi, przepaść jest jeszcze głębsza – firmy z USA odpowiadały za 97% wartości globalnych transakcji w H1 2025.

Na europejskim podwórku również dochodzi do przetasowań. Tradycyjnie to Wielka Brytania była niekwestionowanym liderem. Jednak w drugim kwartale 2025 roku Niemcy, po raz pierwszy od ponad dekady, wyprzedziły Zjednoczone Królestwo pod względem wartości pozyskanego finansowania VC.

Francja, wspierana potężnymi publicznymi deklaracjami inwestycyjnymi – prezydent Emmanuel Macron ogłosił plan o wartości 109 mld euro na rozwój AI – dynamicznie umacnia swoją pozycję.

Brak możliwości konkurowania z amerykańskimi gigantami w niezwykle kapitałochłonnej „wojnie na modele” fundamentalne zmusił Europę do przyjęcia bardziej pragmatycznej strategii. Zamiast próbować budować od zera własne, konkurencyjne modele językowe (LLM), europejscy inwestorzy i założyciele koncentrują się na tzw. „warstwie aplikacyjnej” AI.

Podejście to polega na wykorzystaniu istniejących, potężnych modeli do rozwiązywania konkretnych, wertykalnych problemów biznesowych. Przykłady tej strategii w działaniu są liczne. Niemiecki Helsing, który pozyskał 600 mln euro, stosuje AI do analizy danych na polu walki, stając się kluczowym graczem w sektorze obronnym.

Brytyjska Synthesia, z rundą na 180 mln USD, zdominowała rynek generowania wideo na potrzeby szkoleń korporacyjnych i marketingu.

Poza hype AI: mapa najgorętszych sektorów inwestycyjnych

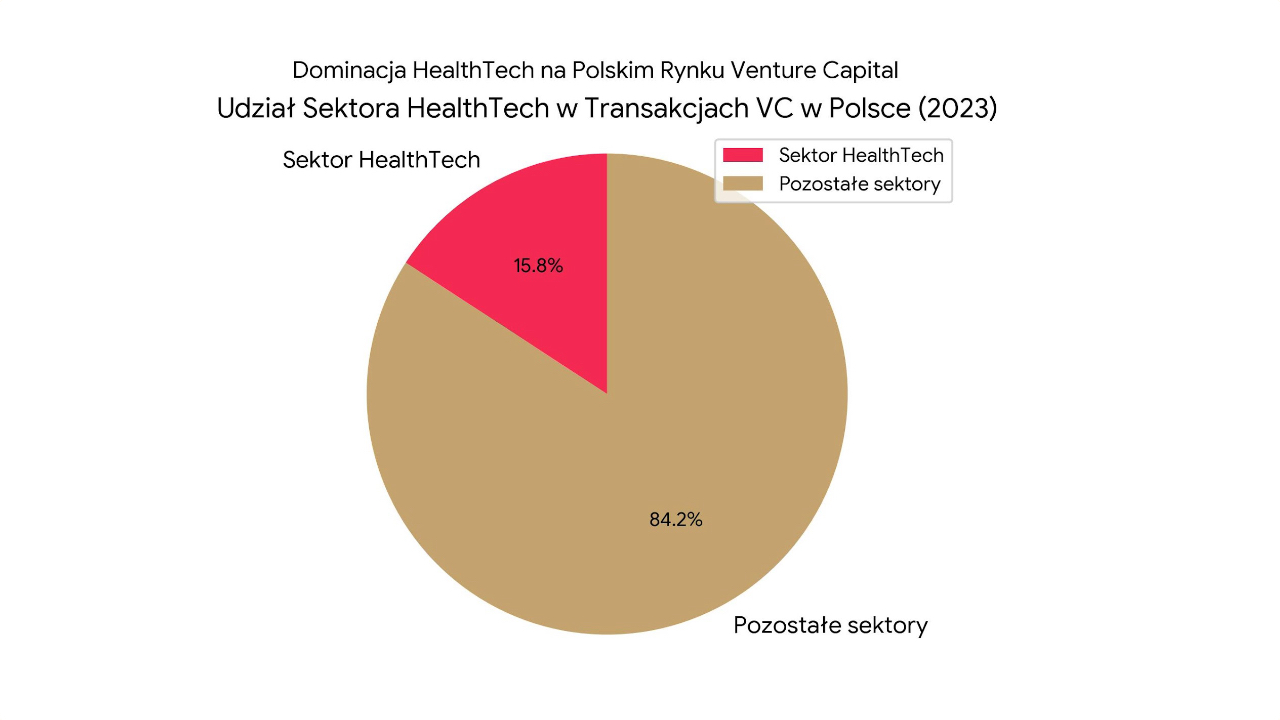

Chociaż sztuczna inteligencja dominuje w nagłówkach, analiza przepływu kapitału w pierwszej połowie 2025 roku ujawnia znacznie bardziej zniuansowany obraz. Inwestorzy dywersyfikują swoje portfele, kierując znaczące środki do sektorów o fundamentalnym znaczeniu dla gospodarki i społeczeństwa.

Dane z H1 2025 pokazują wyraźną zmianę warty. HealthTech (technologie medyczne) stał się najlepiej finansowanym sektorem, pozyskując imponujące 5,7 mld euro. Tuż za nim uplasowały się Deep Tech (technologie głębokie) i B2B SaaS (oprogramowanie jako usługa dla biznesu), z wynikiem 5,2 mld euro każdy.

FinTech, niegdyś niekwestionowany lider, spadł na dalszą pozycję z 3,7 mld euro, notując 20% spadek rok do roku. Z kolei GreenTech (określany również jako Climate Tech), mimo globalnego spowolnienia, pozostaje kluczowym filarem europejskich inwestycji, przyciągając w pierwszym półroczu 5,3 mld USD (około 4,9 mld euro).

HealthTech: nowy lider napędzany demografią i AI

Wzrost znaczenia sektora HealthTech jest bezdyskusyjny. Europa odnotowała 1,65-krotny wzrost finansowania w tym sektorze rok do roku, osiągając 3,3 mld USD. Ten boom ma solidne fundamenty: starzejące się społeczeństwo Europy i rewolucja AI w diagnostyce oraz odkrywaniu leków. Mega-rundy dla brytyjskiego Verdiva Bio (410 mln USD) czy szwedzkiego Neko Health (260 mln USD) są tego najlepszym dowodem.

GreenTech: odporny filar w fazie konsolidacji

Sektor GreenTech przeżywa okres korekty. Finansowanie w H1 2025 spadło o około 40-50% w porównaniu z rokiem poprzednim. Jednak ten spadek sygnalizuje przejście od finansowania szerokiego rynku do inwestycji w kapitałochłonny i strategicznie ważny Deep Tech.

Pieniądze płyną do firm pracujących nad energią termojądrową (Proxima Fusion), zrównoważonym paliwem lotniczym (Skynrg) oraz systemami bateryjnymi na dużą skalę (Green Flexibility).

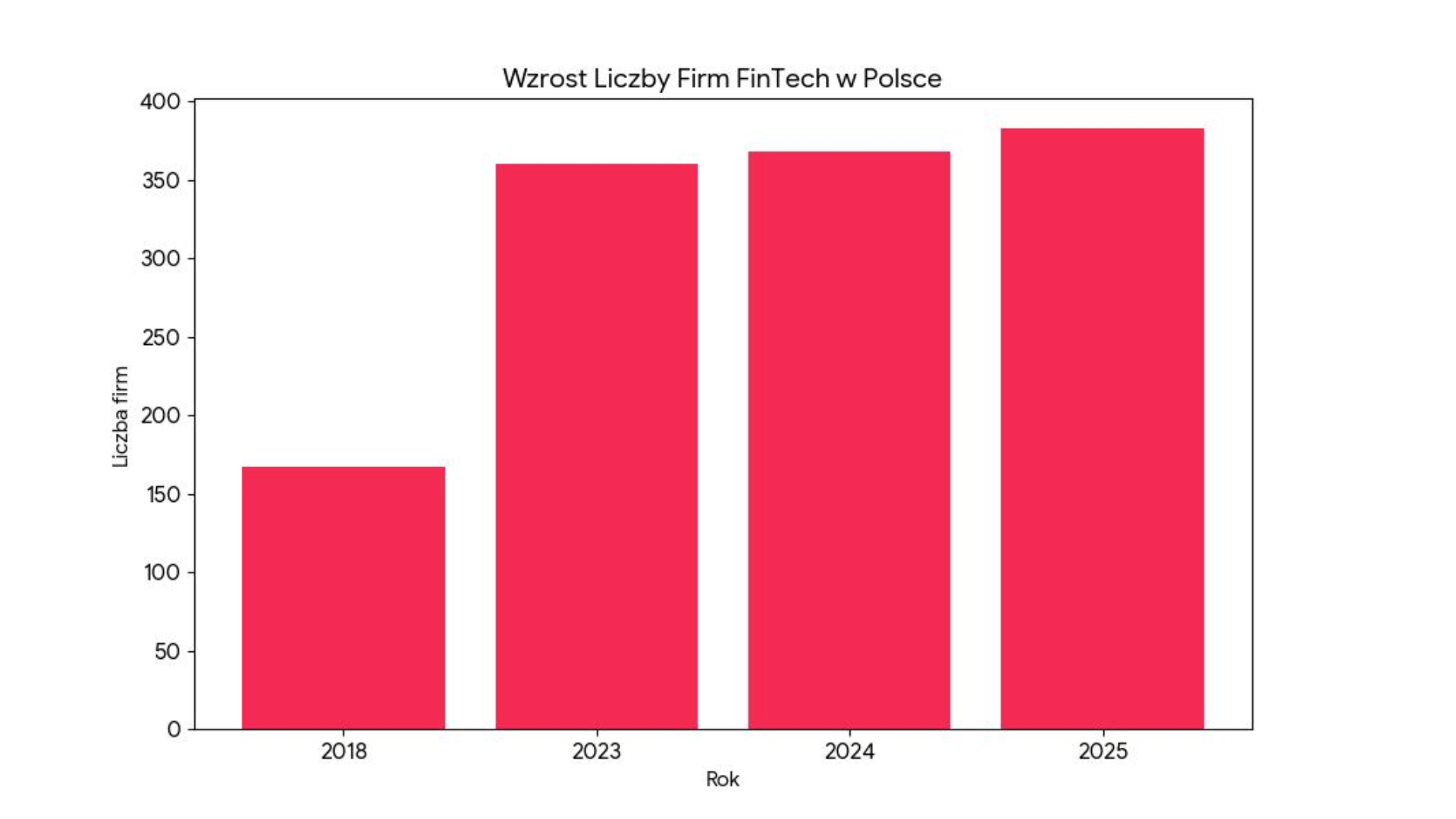

FinTech: dojrzały sektor w poszukiwaniu efektywności

FinTech wchodzi w fazę dojrzałości. Spadek łącznej wartości finansowania do 3,7 mld euro w H1 2025 jest faktem. Jednak w tym samym czasie mediana wielkości rundy wzrosła o 38%, co oznacza, że kapitał koncentruje się w mniejszej liczbie, ale za to bardziej dojrzałych i sprawdzonych firm.

Cyberbezpieczeństwo i defense tech: wschodzące gwiazdy

Wzrost tych dwóch sektorów jest bezpośrednio napędzany przez otoczenie geopolityczne. Europejski rynek cyberbezpieczeństwa wzrósł o 13% w H1 2025, stymulowany przez nowe regulacje i zagrożenia związane z AI.

Jednocześnie sektor Aerospace & Defence przyciągnął rekordowe 1,5 mld euro, co jest konsekwencją rosnących napięć i inicjatyw UE mających na celu wzmocnienie europejskiej obronności.

Publiczne pieniądze: jak Bruksela buduje technologiczną suwerenność

W 2025 roku krajobraz inwestycyjny w Europie jest kształtowany nie tylko przez prywatny kapitał, ale w równym stopniu przez strategiczne interwencje funduszy publicznych.

Program „Horyzont Europa”, dysponujący budżetem 95,5 mld euro na lata 2021-2027, jest głównym narzędziem UE do finansowania badań i innowacji, z czego około 35% przeznaczono na transformację cyfrową.

Program koncentruje się na strategicznych obszarach, takich jak technologie kwantowe, grafen, zaawansowane obliczenia i AI, wspierając je m.in. poprzez inicjatywy flagowe o budżecie 1 mld euro każda.

Z kolei Krajowe Plany Odbudowy (KPO) to bezprecedensowy zastrzyk finansowy dla gospodarek państw członkowskich. Każdy kraj był zobowiązany do przeznaczenia co najmniej 20% środków na cele cyfrowe i 37% na cele klimatyczne.

Przykładowo, Francja przeznacza ok. 8,5 mld euro na transformację cyfrową, w tym 1,8 mld euro na technologie takie jak cyberbezpieczeństwo i chmura. Niemcy przeznaczyły na cyfryzację ponad 52% swojego planu (ok. 14,5 mld euro) , a Włochy 25,6% (ok. 49,8 mld euro).

Te działania pokazują, że fundusze publiczne nie są jedynie formą dotacji, ale narzędziem świadomej polityki przemysłowej. Celem jest budowanie „suwerenności technologicznej” , czyli uniezależnienie Europy od kluczowych technologii z USA i Chin.

Równanie wyjścia: dojrzały ekosystem szuka płynności

W 2025 roku europejski ekosystem technologiczny stoi przed poważnym wyzwaniem: jak zapewnić zwrot z inwestycji w środowisku, w którym tradycyjne ścieżki wyjścia kapitałowego są ograniczone.

Rynek pierwszych ofert publicznych (IPO) pozostaje w stagnacji, z dramatycznym spadkiem o 65% w porównaniu z H1 2024. W odpowiedzi gwałtownie rośnie znaczenie fuzji i przejęć (M&A) – w samej Wielkiej Brytanii w H1 2025 odnotowano najwyższą od 15 lat liczbę ofert przejęć.

Mimo ogólnego spowolnienia, rynek jest silnie spolaryzowany. Mediana wyceny pre-money w Europie osiągnęła w czerwcu 2025 roku dekadowy szczyt na poziomie 8,6 mln euro.

Świadczy to o zjawisku „ucieczki do jakości”, w ramach którego inwestorzy koncentrują kapitał na najbardziej obiecujących, sprawdzonych spółkach. Najlepszym wskaźnikiem tego trendu są największe rundy finansowania, które doskonale ilustrują kluczowe trendy: dominację AI, strategiczne znaczenie Defense Tech i HealthTech oraz kapitałochłonność GreenTech.

Polski wzrost: Dynamo z Europy Środkowo-Wschodniej

W krajobrazie europejskiego rynku VC, charakteryzującym się ostrożnością, Polska wyróżnia się jako jeden z najdynamiczniej rozwijających się ekosystemów. Polski rynek VC odnotował w pierwszym kwartale 2025 roku spektakularny wzrost wartości transakcji o 155% rok do roku, osiągając poziom 444 mln PLN (około 106 mln EUR).

Ten imponujący wzrost jest napędzany przez kilka fundamentalnych zmian świadczących o dojrzewaniu polskiego ekosystemu:

- Przejście do późniejszych rund: Prawie połowa (48%) transakcji w Q1 2025 to rundy Serii A lub późniejsze, co pokazuje, że polski rynek jest już w stanie nie tylko tworzyć, ale także skalować innowacyjne firmy.

- Internacjonalizacja kapitału: Aż 42% kapitału zainwestowanego w polskich startupach w Q1 2025 pochodziło od funduszy zagranicznych, w tym z USA, Niemiec i Wielkiej Brytanii.

- Flagowe sukcesy: Runda finansowania dla ElevenLabs, przekraczająca 700 mln PLN i przyciągająca czołowe amerykańskie fundusze, takie jak Andreessen Horowitz (a16z) i Sequoia Capital, jest wydarzeniem bezprecedensowym. Podobnie jak inwestycja w firmę Nomagic (ok. 140 mln PLN). Te transakcje definitywnie umieszczają Polskę na globalnej mapie innowacji.

Analiza europejskiego rynku technologicznego w 2025 roku prowadzi do jednoznacznego wniosku: mamy do czynienia z rynkiem dojrzalszym, bardziej selektywnym i strategicznie ukierunkowanym.

Czas łatwego pieniądza i finansowania wzrostu za wszelką cenę minął. Zastąpiła go era mniejszej liczby transakcji, które są jednak większe, mądrzejsze i skoncentrowane w sektorach o fundamentalnym znaczeniu dla przyszłości kontynentu.

Dla inwestorów największe możliwości leżą na przecięciu globalnych trendów technologicznych (przede wszystkim AI) i strategicznych priorytetów Europy (suwerenność, transformacja energetyczna, bezpieczeństwo).

Dla założycieli sukces w obecnym klimacie wymaga czegoś więcej niż tylko innowacyjnej technologii – inwestorzy oczekują wyraźnego dopasowania produktu do rynku i wiarygodnej ścieżki do rentowności.

Rok 2025 to test dojrzałości dla europejskiego ekosystemu technologicznego. To czas, w którym Europa, być może z konieczności, uczy się inwestować nie tylko szeroko, ale przede wszystkim mądrze, budując fundamenty pod swoją długoterminową konkurencyjność na globalnej scenie.