Europa Środkowo-Wschodnia (CEE) od dawna przestała być postrzegana jako „wschodzący” rynek technologiczny. Dziś jest to globalnie ugruntowane, dynamiczne i konkurencyjne centrum innowacji, którego rynek usług IT i badań i rozwoju rośnie cztery do pięciu razy szybciej niż średnia światowa.

W sercu tej technologicznej renesansu znajduje się czwórka kluczowych graczy, swoisty „Wyszehrad+ Technologii”: Polska, Czechy, Węgry i Rumunia. Każde z tych państw wnosi do regionalnej układanki unikalny profil: Polska jawi się jako regionalny hegemon pod względem skali, Czechy jako stabilne centrum przemysłowo-technologiczne, Węgry jako magnes dla bezpośrednich inwestycji zagranicznych i wyspecjalizowanych kompetencji, a Rumunia jako „cyfrowy pretendent” o najwyższym tempie wzrostu.

Arena technologiczna CEE

Aby zrozumieć dynamikę rywalizacji w regionie, należy najpierw ocenić fundamentalny kontekst ekonomiczny, porównując skalę, strukturę i znaczenie rynków IT w każdym z czterech państw. To właśnie te wskaźniki określają, kto jest największym graczem i gdzie leży epicentrum wzrostu.

Skala i dynamika rynku: mierzenie sił

Wielkość rynku jest podstawowym wskaźnikiem siły. Pod tym względem Polska jest niekwestionowanym liderem w regionie, choć różne źródła podają nieco odmienne szacunki, co odzwierciedla złożoność i dynamikę sektora. Według danych PMR, wartość polskiego rynku IT w 2023 roku wyniosła 66,3 mld zł (ok. 15,4 mld EUR), z prognozą wzrostu do 74 mld zł (ok. 17,2 mld EUR) do 2025 roku. Z kolei analitycy IDC Poland szacują tę wartość jeszcze wyżej – na 80,3 mld zł (ok. 18,6 mld EUR) w 2023 roku. Niezależnie od przyjętej metodologii, skala polskiego rynku znacząco przewyższa sąsiadów.

Czeski rynek ICT (technologii informacyjno-komunikacyjnych) prezentuje obraz dojrzałej i stabilnej potęgi. Prognozy wskazują, że do 2026 roku jego przychody osiągną 24,3 mld EUR, przy stałym rocznym wzroście na poziomie 2,1%. Wskazuje to na rynek mniej zmienny, o ugruntowanej pozycji. Węgierski rynek ICT jest trudniejszy do jednoznacznej oceny ze względu na rozbieżne dane. Mordor Intelligence szacuje jego wartość na imponujące 35,17 mld USD w 2025 roku, z prognozowanym rocznym wzrostem (CAGR) na poziomie 11,41% do 2030 roku. Inne źródła podają bardziej zachowawczą kwotę 5 mld EUR na rok 2024. Ta rozbieżność sugeruje, że wyższa estymacja obejmuje szeroki zakres usług telekomunikacyjnych i sprzedaży sprzętu, napędzanych przez duże korporacje. Sam węgierski segment e-commerce osiągnął w 2024 roku wartość 1 920 mld HUF (ok. 4,9 mld EUR).

Najbardziej dynamiczny obraz przedstawia Rumunia. Jej gospodarka cyfrowa ma osiągnąć wartość 52 mld EUR do 2030 roku. Rynek eksportu usług IT, wyceniany na 24,9 mld EUR w 2023 roku, ma wzrosnąć do 44,8 mld EUR do 2028 roku, co oznacza imponujący CAGR na poziomie 9,1%. To najszybsza trajektoria wzrostu w analizowanej grupie, pozycjonująca Rumunię jako głównego pretendenta do miana regionalnego lidera dynamiki.

Ta dychotomia między skalą a prędkością wzrostu tworzy strategiczne napięcie. Polska, jako największy rynek, oferuje stabilność, dojrzały i zróżnicowany ekosystem, co jest atrakcyjne dla dużych korporacji poszukujących miejsca na centra R&D. Z drugiej strony, Rumunia, z jej niemal dwucyfrowym wzrostem, stanowi magnes dla funduszy venture capital i firm poszukujących gwałtownej ekspansji, gotowych zaakceptować ryzyko związane z mniej dojrzałym rynkiem. Wybór między tymi krajami nie jest więc prostą decyzją, lecz zależy od apetytu inwestora na ryzyko i jego strategii wzrostu.

Potęga napędzająca PKB: Więcej niż sektor usług

Znaczenie sektora IT dla gospodarek narodowych najlepiej odzwierciedla jego udział w Produkcie Krajowym Brutto. W Polsce jest to imponujące 8%, co świadczy o głębokiej integracji technologii z całą gospodarką i jej kluczowej roli jako motoru napędowego. Rumunia również może pochwalić się wysokim wskaźnikiem na poziomie 6,6%. Zaskakująco, na Węgrzech udział ten jest najniższy i wynosi 4,3%. Choć dla Czech brakuje precyzyjnych danych dla samego IT, kontekst stanowi potężny przemysł motoryzacyjny, generujący 10% PKB, co wskazuje na silne powiązania sektora technologicznego z przemysłem.

Te dane, zestawione z ogólnym poziomem zamożności, pokazują, że technologia jest kluczowym narzędziem konwergencji. Polska i Rumunia, z PKB na mieszkańca (według parytetu siły nabywczej) na poziomie 79% średniej unijnej, gonią Czechy (92%). Sektor IT jest bez wątpienia jednym z głównych akceleratorów tego procesu.

Architektura Rynku: Co kryje się pod maską?

Struktura wewnętrzna rynków IT w każdym z krajów ujawnia ich unikalne specjalizacje i strategiczne kierunki rozwoju.

Polska: Obserwujemy wyraźną bifurkację rynku. Segment sprzętowy stabilizuje się po pandemicznym boomie, podczas gdy oprogramowanie i usługi rosną w siłę, osiągając w 2023 roku wartość 30,5 mld zł (7,1 mld EUR). Kluczowym motorem napędowym są usługi chmurowe, których rynek urósł o 25% rok do roku, osiągając wartość 2 mld USD.

Czechy: Rynek jest silnie zdeterminowany przez potężną bazę przemysłową, zwłaszcza sektory motoryzacyjny i elektrotechniczny. Generuje to ogromne zapotrzebowanie na systemy wbudowane, automatyzację przemysłową i zaawansowane rozwiązania IT dla przedsiębiorstw. Kraj ten jest również hubem dla międzynarodowych centrów R&D, takich jak Microsoft, IBM czy Oracle.

Węgry: Rynek charakteryzuje się wyjątkowo wysokim poziomem adopcji zaawansowanych technologii przez przedsiębiorstwa. Wskaźnik wykorzystania chmury wynosi 37,1% (nieco poniżej średniej UE), a analityki danych aż 53,2%, co znacznie przewyższa średnią unijną (33,2%). Wskazuje to na dojrzałą i wymagającą bazę klientów korporacyjnych. Największym segmentem rynku ICT są usługi telekomunikacyjne, stanowiące ponad 41% całości.

Rumunia: Rynek jest w dużej mierze zorientowany na eksport, szczególnie w obszarze usług tworzenia oprogramowania. Mimo że rząd kładzie duży nacisk na cyfryzację małych i średnich przedsiębiorstw, jej poziom (27%) wciąż pozostaje daleko w tyle za średnią UE (57,7%), co paradoksalnie tworzy ogromny potencjał wzrostu na rynku wewnętrznym.

Analiza struktury rynków ujawnia interesujący fenomen na Węgrzech. Z jednej strony, tamtejsze przedsiębiorstwa wykazują ponadprzeciętną dojrzałość w adopcji zaawansowanych technologii, jak analityka danych.

Z drugiej, udział całego sektora IT w PKB jest najniższy w grupie. Ta pozorna sprzeczność sugeruje, że zaawansowanie technologiczne jest skoncentrowane w wąskiej grupie dużych, często zagranicznych korporacji (np. z sektora motoryzacyjnego), a nie jest zjawiskiem powszechnym, napędzanym przez szeroki, krajowy przemysł IT.

Wskazuje to na rynek o strukturze „top-heavy”, z potencjalnie mniejszymi możliwościami dla lokalnych MŚP w porównaniu do Polski, gdzie krajowy sektor IT stanowi znacznie większą siłę gospodarczą.

Równanie kapitału ludzkiego: talent, umiejętności i wynagrodzenia

W branży zdominowanej przez „wojnę o talenty”, to właśnie kapitał ludzki jest najcenniejszym aktywem i ostatecznym wyznacznikiem konkurencyjności. Analiza przechodzi od liczb makroekonomicznych do praktycznych realiów budowania i utrzymywania zespołów technologicznych.

Zasoby talentu: Głębokie, ale wymagające źródło

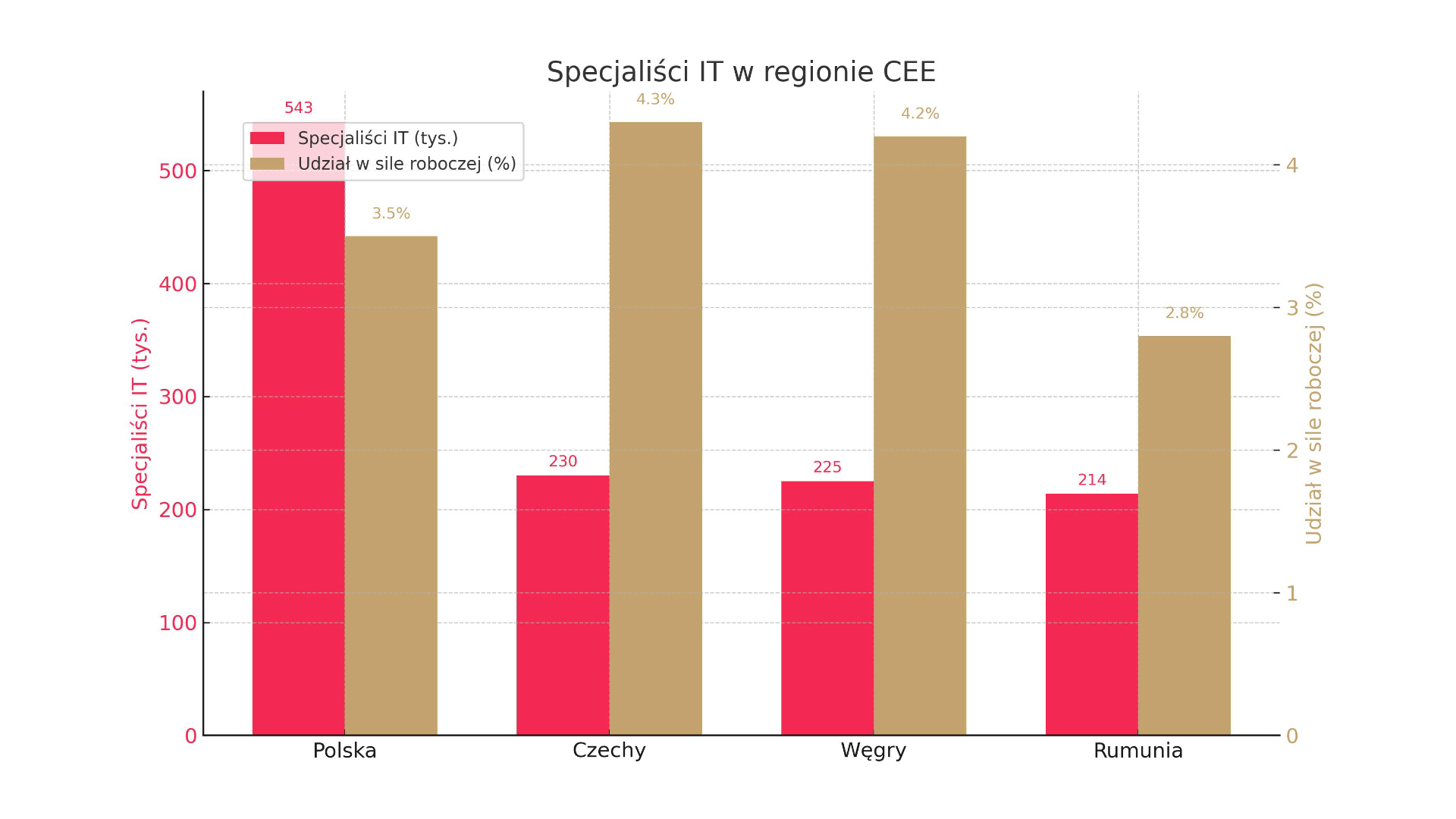

Polska: Gigant z luką kompetencyjną: Polska dysponuje zdecydowanie największą pulą talentów, szacowaną na od 493 000 do ponad 586 000 specjalistów. Jest to potężny atut, jednak kraj zmaga się z istotną luką kompetencyjną. Udział specjalistów IT w ogólnej liczbie zatrudnionych wynosi 3,5%, co jest wskaźnikiem niższym od średniej unijnej (4,5%). Szacuje się, że do osiągnięcia średniej UE brakuje w Polsce aż 147 000 ekspertów.

Czechy: Hub specjalistów: Czechy posiadają solidną bazę blisko 230 000 ekspertów ICT, co stanowi 4,3% siły roboczej – wartość zbliżona do średniej unijnej. Renomowane uczelnie techniczne zapewniają stały dopływ absolwentów, choć muszą oni konkurować o talenty z potężnym sektorem przemysłowym.

Węgry: Stabilność i kwalifikacje: Na Węgrzech udział specjalistów ICT w zatrudnieniu wynosi 4,2%, również blisko średniej UE. Jednak roczne tempo wzrostu liczby tych specjalistów (2,4%) jest wolniejsze niż w Unii (4,3%) , co sugeruje stabilną, ale mniej dynamicznie rozwijającą się pulę talentów.

Rumunia: Paradoks gęstości: Rumunia dysponuje dużą i wysoko cenioną pulą talentów liczącą od 202 000 do 226 000 specjalistów. Kraj ten szczyci się największą w Europie liczbą certyfikowanych specjalistów IT na mieszkańca. Paradoksalnie, ich udział w całkowitej sile roboczej jest najniższy w grupie i wynosi zaledwie 2,8%. Dodatkowo, Rumunia boryka się z problemem „drenażu mózgów”, co stanowi poważne wyzwanie dla utrzymania w kraju największych talentów.

Ta dynamika przepływu talentów ma fundamentalne znaczenie dla długoterminowego rozwoju. Zjawisko „drenażu mózgów” w Rumunii stoi w kontrze do „napływu mózgów” w Polsce, która staje się atrakcyjnym miejscem pracy dla specjalistów z innych krajów, w tym z Ukrainy.

Gospodarka, która traci talenty, często eksportuje specjalistów na poziomie juniorskim i średniozaawansowanym, co osłabia jej zdolność do tworzenia złożonych, wysokomarżowych produktów na miejscu. Z kolei kraj przyciągający talenty może przyspieszyć swój marsz w górę łańcucha wartości, importując doświadczonych ekspertów.

Wskazuje to, że polski ekosystem może dojrzewać szybciej, podczas gdy rumuński, jeśli nie odwróci tego trendu, może pozostać bardziej skoncentrowany na świadczeniu usług outsourcingowych.

Mapa Płac: Starcie czterech stolic

Wynagrodzenia są kluczowym czynnikiem konkurencyjności na rynku talentów. Porównanie stawek w głównych hubach technologicznych regionu ujawnia znaczące różnice.

Warszawska premia: Polskie płace należą do najwyższych w regionie. Starszy programista na kontrakcie B2B w Krakowie czy Warszawie może liczyć na wynagrodzenie przekraczające 26 000 zł netto miesięcznie (ok. 6 000 EUR). Nawet na umowie o pracę pensje seniorów przekraczają 12 000 zł netto (ok. 2 800 EUR).

Praska konkurencyjność: Czeskie zarobki są również bardzo wysokie. Typowy przedział dla specjalistów IT to od 43 130 CZK (ok. 1 730 EUR) do 122 874 CZK (ok. 4 930 EUR) miesięcznie. Najlepiej opłacane role, jak Data Scientist, mogą przynosić roczny dochód rzędu 1,2 mln CZK (ok. 48 150 EUR). Średnie roczne wynagrodzenie inżyniera oprogramowania wynosi około 55 600 EUR.

Budapesztańska propozycja wartości: Węgierskie pensje oferują lepszy stosunek kosztów do jakości. Średnie wynagrodzenie dla specjalisty IT to około 1 800 EUR miesięcznie , a inżynier oprogramowania w Budapeszcie zarabia średnio 40 400 EUR rocznie. To czyni Węgry znacznie bardziej przystępnymi kosztowo przy budowie zespołu niż Polska czy Czechy.

Rosnące koszty w Bukareszcie: Rumuńskie płace rosną szybko, ale wciąż oferują przewagę kosztową. Średnie zarobki w branży technologicznej wynoszą 3 402 EUR netto miesięcznie. Ogólny przedział dla IT to od 4 647 RON (ok. 930 EUR) do 16 879 RON (ok. 3 390 EUR) miesięcznie. Stawki te są jednak dodatkowo podbijane przez całkowite zwolnienie z podatku dochodowego do określonego progu, co znacząco zwiększa wynagrodzenie netto.

Powszechność i wysokie stawki kontraktów B2B w Polsce są nie tylko metodą rozliczeń, ale symptomem dojrzałego, wysoce konkurencyjnego rynku talentów seniorskich. Model ten daje maksymalną elastyczność i potencjał zarobkowy najlepszym specjalistom, ale jednocześnie tworzy niestabilność dla pracodawców i prowadzi do bardziej transakcyjnych relacji z pracownikami.

W kontraście, dominacja tradycyjnych umów o pracę na Węgrzech i w Czechach (odpowiednio 83,5% i 67% w IT) sugeruje bardziej stabilny, korporacyjny rynek pracy. Oznacza to, że firmy w Polsce muszą przyjąć inną strategię HR, koncentrując się na oferowaniu atrakcyjnych projektów i najwyższych stawek, podczas gdy w Czechach i na Węgrzech większy nacisk można położyć na długoterminowe ścieżki kariery i kulturę organizacyjną.

Lista pożądanych ekspertyz: Kto jest na topie?

W całym regionie obserwuje się ogromne zapotrzebowanie na specjalistów w dziedzinach takich jak sztuczna inteligencja i uczenie maszynowe (AI/ML), analityka danych (Data & BI), cyberbezpieczeństwo oraz DevOps. To właśnie te role są najwyżej wynagradzane.

Jednak każdy z krajów posiada również swoje nisze, w których osiągnął pozycję lidera. Polska jest globalną potęgą w produkcji gier komputerowych (gamedev), z gigantami takimi jak CD Projekt RED na czele. Branża ta generuje ponad 500 mln EUR przychodów, tworząc unikalny w skali regionu ekosystem talentów w dziedzinie projektowania gier, programowania i grafiki.

Rumunia dynamicznie rozwija własną scenę gamedev, przyciągając globalnych graczy, takich jak Amazon Games, który otworzył nowe studio w Bukareszcie. Kraj ten ma również silną pozycję w sektorze Fintech, a stolica generuje 77% obrotów tej branży w kraju.

Czeska scena technologiczna doskonale wpisuje się w potrzeby swojej bazy przemysłowej, celując w takie dziedziny jak cyberbezpieczeństwo (to stąd wywodzi się Avast) oraz oprogramowanie dla przedsiębiorstw. Z kolei Węgry, z wysokim wskaźnikiem adopcji chmury i analityki danych przez korporacje, generują duże zapotrzebowanie na architektów danych, inżynierów chmury oraz specjalistów od systemów klasy enterprise, np. SAP.

Granica innowacji: startupy, outsourcing i inwestycje

Przyszłość każdego rynku technologicznego zależy od jego zdolności do innowacji, przyciągania kapitału i integracji z globalnym ekosystemem. Ta sekcja analizuje dynamikę, która kształtuje jutro sceny technologicznej w Europie Środkowo-Wschodniej.

Tętniące życiem Venturelands: Wyścig startupów

Polska: Lider pod względem wolumenu: Polska może pochwalić się największym ekosystemem startupowym w grupie, z ponad 1251 firmami. Dominującym hubem jest Warszawa. Ekosystem jest na tyle dojrzały, że wydał na świat blisko jedną trzecią wszystkich jednorożców (firm o wycenie ponad 1 mld USD) w regionie CEE. Wyzwaniem pozostaje jednak finansowanie – aż 56% startupów zgłasza trudności z jego pozyskaniem.

Czechy: Efektywny rywal: Mimo mniejszej skali, czeski ekosystem jest wysoko oceniany, zajmując 3. miejsce w Europie Wschodniej, przed Polską. Słynie ze startupów z obszarów SaaS, Fintech i Healthtech i jest kolebką globalnych sukcesów, takich jak Avast, oraz jednorożców, jak Rohlik i Productboard. Kluczowym wyzwaniem jest postrzegany przez inwestorów brak wystarczającej liczby wysokiej jakości projektów.

Węgry: Gigant w stagnacji? Węgry mają na koncie znane firmy, takie jak Prezi czy LogMeIn, ale w ostatnich latach zmagają się z utrzymaniem impetu. Całkowita wartość inwestycji uległa stagnacji na poziomie około 54 mln EUR. Ostatnio obserwuje się jednak ożywienie w segmencie wczesnych startupów opartych na AI, co może zwiastować odbicie.

Rumunia: Fabryka jednorożców: Rumuński ekosystem został zdefiniowany przez spektakularny sukces UiPath, globalnego lidera w dziedzinie automatyzacji procesów (RPA). To wydarzenie umieściło kraj na mapie międzynarodowych inwestorów. Szczególnie aktywna jest scena AI, z dużymi rundami finansowania dla firm takich jak FintechOS. Ekosystem jest silnie skoncentrowany w Bukareszcie.

Sukces UiPath wywarł głęboki, wtórny wpływ na cały rumuński ekosystem. Nie tylko stworzył pokolenie doświadczonych, zamożnych aniołów biznesu i seryjnych przedsiębiorców (tzw. „mafia UiPath”), ale także zadziałał jako globalny dowód słuszności, zmniejszając postrzegane ryzyko inwestycyjne w Rumunii w oczach międzynarodowych funduszy VC. To tłumaczy imponujące rundy finansowania dla firm takich jak FintechOS i ogólne ożywienie wokół rumuńskiej sceny, które w innym przypadku mogłoby wydawać się nieproporcjonalne do wielkości rynku. Ten „efekt jednorożca” jest potężnym akceleratorem, który pozwala ekosystemowi osiągać wyniki znacznie przewyższające jego nominalną wagę.

Globalne zaplecze: Strategiczny partner, nie tania siła robocza

Cały region CEE jest czołową globalną destynacją dla outsourcingu IT. Klienci coraz częściej przenoszą punkt ciężkości z optymalizacji kosztów na dostęp do wysokiej klasy umiejętności, innowacji i bliskości kulturowej. Regionalna pula talentów przekracza 1,75 miliona inżynierów.

Stabilne otoczenie biznesowe jest kluczowym atutem. W rankingu Doing Business 2020 Polska (40. miejsce), Czechy (41.), Węgry (52.) i Rumunia (55.) oferują przewidywalne warunki, co stanowi przewagę nad innymi globalnymi hubami outsourcingowymi.

Polska jest często uznawana za lidera konkurencyjności IT w regionie dzięki ogromnej puli talentów, klimatowi biznesowemu i silnemu eksportowi. Jest głównym ośrodkiem dla centrów R&D globalnych gigantów, takich jak Google i Microsoft.

Czechy plasują się w pierwszej piątce krajów pod względem atrakcyjności outsourcingu, słynąc z wysokiej jakości usług i bezpieczeństwa danych.

Węgry i Rumunia przyciągają inwestorów odpowiednio niskim, 9-procentowym podatkiem dochodowym od osób prawnych oraz zwolnieniami podatkowymi dla programistów, co w połączeniu z dużą pulą talentów tworzy potężną propozycję wartości.

Silna obecność międzynarodowych centrów R&D i firm outsourcingowych w Polsce i Czechach to nie tylko branża usługowa; to kluczowy inkubator dla krajowego ekosystemu startupowego. Centra te szkolą lokalne talenty według światowych standardów, zapoznają je z globalnymi praktykami biznesowymi i tworzą sieć profesjonalistów, którzy ostatecznie odchodzą, aby założyć własne firmy produktowe. Programista pracujący przez pięć lat w warszawskim biurze Google uczy się zarządzania produktem, skalowania i sprzedaży międzynarodowej na poziomie niedostępnym w większości lokalnych firm. Taki specjalista, uzbrojony w unikalne umiejętności, kontakty i zrozumienie potrzeb globalnego rynku, ma znacznie większe szanse na sukces. W ten sposób sektor outsourcingu nie jest odrębnym bytem, lecz fundamentalnym filarem, który zasila i przyspiesza rozwój rodzimej gospodarki produktowej i startupowej.

Rola państwa: Katalizatory wzrostu

Rządy wszystkich czterech krajów aktywnie wspierają sektor technologiczny poprzez różnorodne inicjatywy, w tym zachęty podatkowe, programy finansowania i wizy dla startupów. Kluczowe polityki, takie jak rumuńskie zwolnienie z podatku dochodowego dla programistów czy węgierska niska stawka CIT , stanowią istotną przewagę konkurencyjną. Polska i Czechy skutecznie wykorzystują fundusze unijne oraz krajowe agencje rozwoju (jak PFR Ventures i CzechInvest), aby napędzać swoje ekosystemy innowacji.

Werdykt: Pozycja Polski i droga naprzód

Synteza przedstawionych danych pozwala na sformułowanie klarownego werdyktu dotyczącego pozycji Polski na tle regionalnych rywali oraz nakreślenie strategicznych perspektyw dla całego regionu.

Regionalna analiza SWOT: Porównawcza karta wyników

Polska:

- Mocne strony: Największy rynek i pula talentów, zróżnicowany ekosystem (gamedev, enterprise), silna scena startupowa.

- Słabe strony: Znacząca luka talentów, rosnąca presja płacowa, duża konkurencja.

- Szanse: Napływ talentów z zagranicy, możliwość przejścia w górę łańcucha wartości do bardziej złożonych produktów.

- Zagrożenia: Utrata konkurencyjności kosztowej na rzecz Rumunii/Węgier, nasycenie rynku w niektórych obszarach.

Czechy:

- Mocne strony: Stabilny, dojrzały rynek, wysoko wykwalifikowani specjaliści, silna integracja z przemysłem, doskonałe otoczenie biznesowe.

- Słabe strony: Mniejsza pula talentów, wolniejszy wzrost, wyższe koszty niż u niektórych sąsiadów.

- Szanse: Wykorzystanie bazy przemysłowej do innowacji w ramach Przemysłu 4.0, stanie się hubem dla wysokomarżowych centrów R&D.

- Zagrożenia: Konkurencja o talenty z potężnym sektorem produkcyjnym, ryzyko stagnacji.

Węgry:

- Mocne strony: Korzystne otoczenie podatkowe, wysoka adopcja zaawansowanych technologii w przedsiębiorstwach, mocna propozycja wartości.

- Słabe strony: Stagnacja w finansowaniu startupów, wolniejszy wzrost puli talentów, mniejsza dynamika ekosystemu.

- Szanse: Potencjał do stania się wyspecjalizowanym hubem dla rozwiązań AI i data science dla korporacji, przyciąganie BIZ zorientowanego na koszty.

- Zagrożenia: Pozostawanie w tyle za regionalnymi liderami innowacji startupowej, niepewność polityczna wpływającą na zaufanie inwestorów.

Rumunia:

- Mocne strony: Najwyższe tempo wzrostu, duża gęstość talentów, znaczące przewagi kosztowe, „efekt jednorożca” po sukcesie UiPath.

- Słabe strony: Drenaż mózgów, słabiej rozwinięty rynek krajowy, luki infrastrukturalne poza głównymi hubami.

- Szanse: Ogromny potencjał w cyfryzacji krajowych MŚP, stanie się centrum gamedev Europy Południowo-Wschodniej.

- Zagrożenia: Utrzymanie talentów, ryzyko przegrzania gospodarki, uzależnienie od rynków eksportowych.

Pozycja Polski na arenie CEE: Mistrz wagi ciężkiej pod presją

Polska pozostaje niekwestionowanym liderem sceny technologicznej Europy Środkowo-Wschodniej pod względem skali, liczby talentów i różnorodności ekosystemu. Wielkość jej rynku oraz głębokość specjalizacji, zwłaszcza w gamedev i oprogramowaniu dla przedsiębiorstw, są bezkonkurencyjne.

Jednakże przywództwo ma swoją cenę. Polska staje w obliczu wyzwań typowych dla dojrzałego rynku: intensywnej konkurencji płacowej, która podważa jej przewagę kosztową, oraz krytycznej luki w umiejętnościach, która może zdławić przyszły wzrost. Polska nie jest już opcją „tanią”; jest opcją „skali”.

Podczas gdy Polska przewodzi, konkurencja nie śpi. Rumunia rzuca jej wyzwanie pod względem wzrostu i dynamiki, Czechy – stabilności i wyspecjalizowanej jakości, a Węgry – efektywności kosztowej dla inwestycji korporacyjnych.

Zbiorowa siła: Przyszłość jest regionalna

Przyszłość sceny technologicznej CEE nie będzie zależeć od tego, który kraj „wygra”, ale od tego, jak cały region poradzi sobie z transformacją z destynacji outsourcingowej napędzanej kosztami w partnera innowacyjnego napędzanego wartością. Polska, jako największy gracz, ma kluczową rolę do odegrania w przewodzeniu tej zmianie, ale jej sukces jest nierozerwalnie związany z kondycją i dynamiką jej sąsiadów.