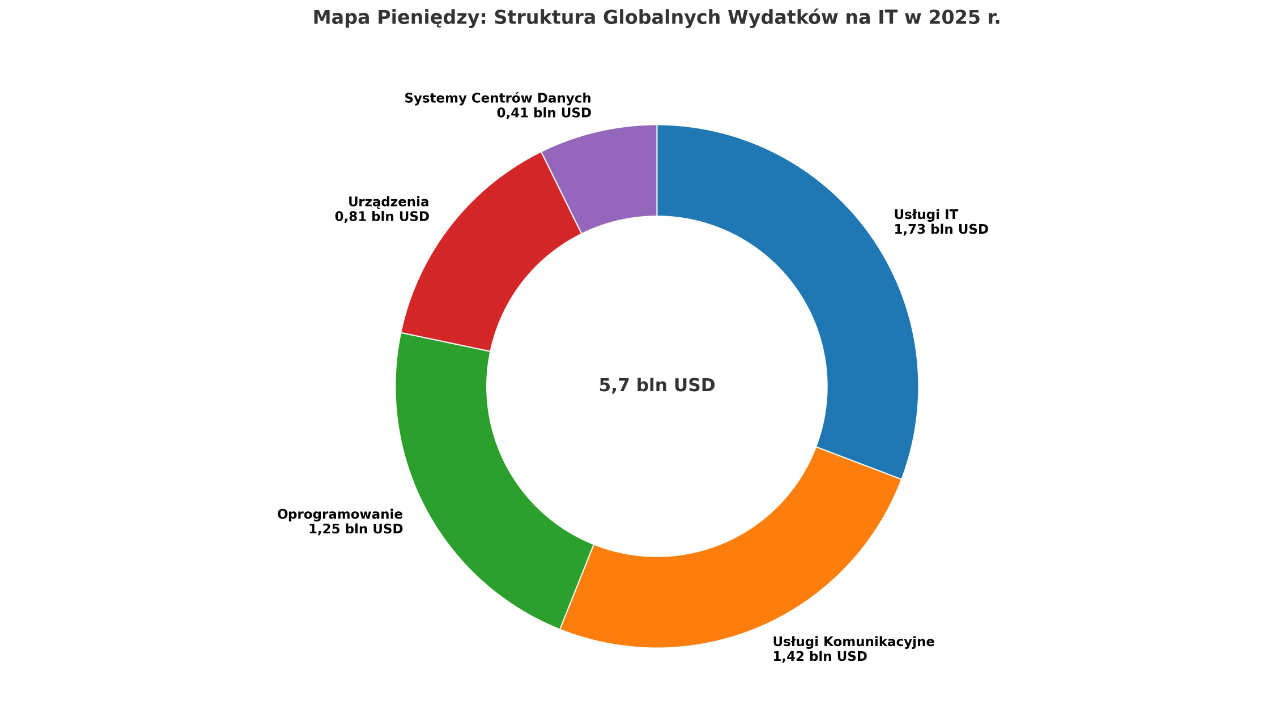

Gdy estymacje wydatków na systemy typu GenAI szybują o blisko 40% w skali roku, kończy się czas radosnej partyzantki w działach innowacji. Wchodzimy w epokę, w której CIO musi przestać postrzegać sztuczną inteligencję jako błyskotliwą ciekawostkę, a zacząć traktować ją jako surowy, nieprzewidywalny i wymagający głębokiej strukturyzacji zasób operacyjny. Problem polega na tym, że tradycyjne ramy zarządzania, oparte na statycznych audytach i okresowych przeglądach zgodności, rozbijają się o ścianę nowoczesnych, niedeterministycznych architektur.

Poza horyzont statycznej kontroli

Wdrażanie zaawansowanych systemów, takich jak generowanie rozszerzone o wyszukiwanie (RAG) czy autonomiczni agenci, przypomina próbę zarządzania żywym organizmem za pomocą instrukcji obsługi pralki. Klasyczne podejście do bezpieczeństwa IT zakładało przewidywalność: określone wejście generuje konkretne wyjście. Modele językowe tę zasadę unieważniają. Dlatego też dyskusja o nadzorze musi zostać przeniesiona z sal konferencyjnych prosto do repozytoriów kodu.

Zamiast traktować zarządzanie (governance) jako uciążliwy dodatek post-factum, liderzy technologiczni są zmuszeni do implementacji strategii zarządzania przez projekt (governance by design). To fundamentalna zmiana: etyka i bezpieczeństwo przestają być listą życzeń spisaną w dokumencie PDF, a stają się twardym wymogiem technicznym, tak samo istotnym jak przepustowość łączy czy wydajność serwerów. W tej nowej hierarchii wartości to architektura systemu definiuje granice wolności algorytmu, a nie odwrotnie.

Konstrukcja stabilnego ekosystemu

Fundamentem, na którym opiera się bezpieczna integracja AI z tkanką przedsiębiorstwa, jest sześć filarów technicznych. Każdy z nich stanowi krytyczny punkt styku między surową mocą obliczeniową a biznesową odpowiedzialnością.

Pierwszym z nich są techniczne poręcze, pełniące funkcję proaktywnego bezpiecznika. Działają one w trybie rzeczywistym, filtrując zapytania oraz odpowiedzi jeszcze zanim dotrą one do użytkownika końcowego. Nie jest to jedynie cenzura treści, lecz zaawansowana warstwa walidacji, która chroni przed wyciekiem danych wrażliwych czy nieświadomym naruszeniem własności intelektualnej. Poziom restrykcyjności tych barier musi być dynamicznie skalowany względem ryzyka – inne rygory dotyczą wewnętrznego bota wspierającego kodowanie, a inne systemu analizującego dane medyczne pacjentów.

Równie istotna jest obserwowalność, która w świecie AI ewoluuje daleko poza proste monitorowanie czasu pracy serwera. CIO potrzebuje narzędzi, które wskażą moment, w którym model zaczyna „dryfować” – tracić precyzję lub zmieniać sposób wnioskowania pod wpływem nowych danych. Obserwowalność dostarcza paliwa dla procesów zarządzania, uruchamiając automatyczne pętle doszkalania w chwilach, gdy algorytm przestaje przystawać do rzeczywistości biznesowej.

Trzeci filar to identyfikowalność, czyli lekarstwo na problem „czarnej skrzynki”. W systemach wykorzystujących dane z wielu źródeł, precyzyjne logowanie ścieżki wnioskowania pozwala na audyt wsteczny. Dzięki temu możliwe jest ustalenie, na podstawie którego konkretnego dokumentu model sformułował błędny wniosek. To klucz do budowania zaufania nie tylko wśród regulatorów, ale przede wszystkim wśród użytkowników biznesowych, którzy muszą wiedzieć, na czym opiera się sugerowana im strategia.

Czwarty element, scentralizowane bramy AI, porządkuje chaos dostępów i kosztów. Działając jako jedyny punkt wejścia dla usług inteligentnych, bramy te pozwalają na precyzyjne zarządzanie limitami tokenów oraz ochronę kluczy API. Bez tego poziomu kontroli, rozproszone subskrypcje w różnych działach firmy stają się finansową i bezpieczeństwową czarną dziurą.

Dopełnieniem tej struktury są katalogi AI oraz opakowania technologiczne. Katalogi stanowią pojedyncze źródło prawdy o wszystkich modelach i agentach działających w organizacji, zapobiegając dublowaniu prac i niejasnościom w kwestii odpowiedzialności. Opakowania (wrappers) natomiast pozwalają na izolację logiki biznesowej od samego modelu bazowego. Umożliwia to szybką wymianę dostawcy technologii bez konieczności przebudowy całego ekosystemu aplikacji, co w obliczu dynamicznych zmian na rynku modeli językowych jest polisą ubezpieczeniową na przyszłość.

Integracja z globalnym porządkiem

Budowa tak zaawansowanej architektury nie odbywa się w próżni. Musi ona rezonować z wyłaniającymi się ramami prawnymi, takimi jak EU AI Act czy standardy NIST. Dostosowanie technicznych środków kontroli do tych regulacji pozwala przekształcić abstrakcyjne zasady etyczne w mierzalne parametry systemowe. To właśnie w tym miejscu odpowiedzialna sztuczna inteligencja przestaje być hasłem marketingowym, a staje się rygorystycznym kodeksem postępowania zapisanym w infrastrukturze.

Warto jednak zauważyć, że nawet najbardziej wyrafinowana automatyzacja nie eliminuje konieczności nadzoru ludzkiego. Wręcz przeciwnie – w scenariuszach o wysokim stopniu krytyczności, architektura powinna być zaprojektowana tak, aby wymuszać interwencję człowieka. Definiowanie jasnych struktur własności dla każdego systemu AI jest ostatnim, decydującym ogniwem łańcucha odpowiedzialności.