Małe i średnie przedsiębiorstwa (MŚP) to kręgosłup europejskiej gospodarki. Stanowią 99,8% wszystkich firm, generują ponad połowę wartości dodanej i dają zatrudnienie blisko dwóm trzecim pracowników sektora prywatnego. W dobie globalnej konkurencji i rosnących oczekiwań klientów, cyfryzacja przestała być dla nich opcją – stała się warunkiem przetrwania. Jednak najnowsze dane z całej Unii Europejskiej malują niepokojący obraz: podczas gdy duże korporacje odjeżdżają cyfrowym ekspresem, sektor MŚP w dużej mierze wciąż czeka na peronie.

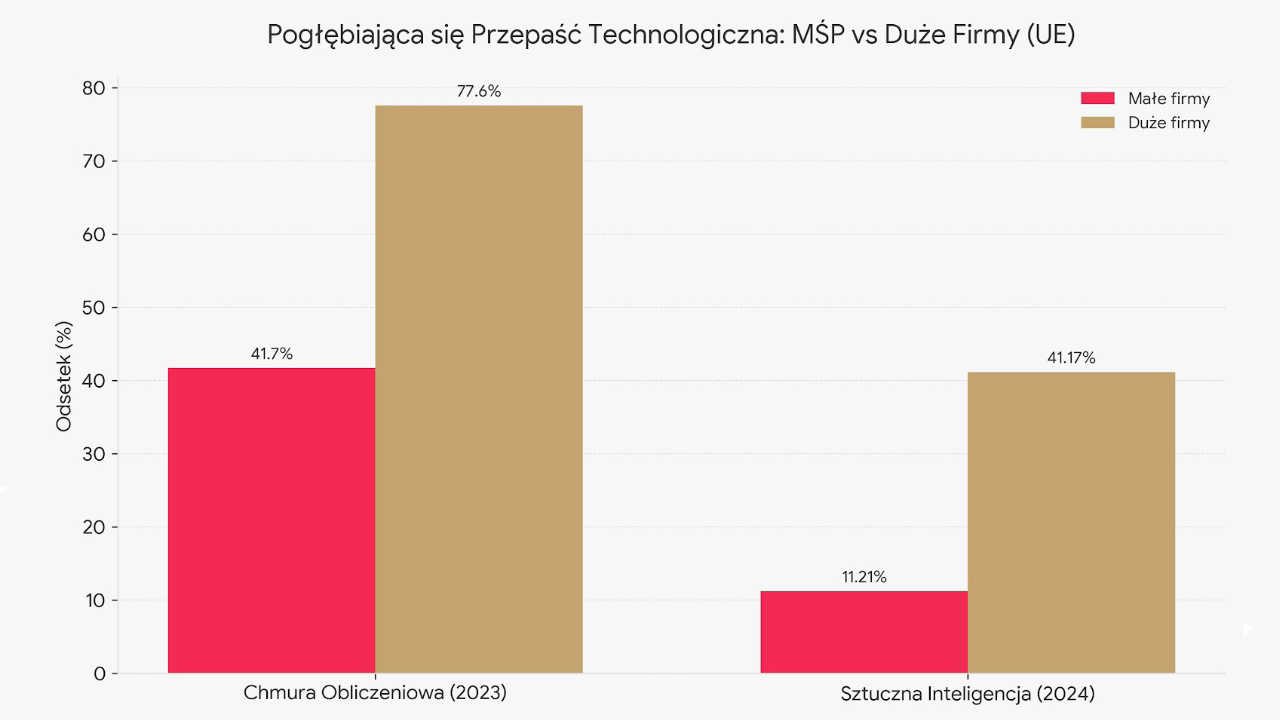

Analiza adopcji trzech filarów nowoczesnego biznesu – chmury obliczeniowej, sztucznej inteligencji (AI) i cyberbezpieczeństwa – ujawnia głęboką i pogłębiającą się przepaść. Ta „luka dojrzałości cyfrowej” zagraża nie tylko konkurencyjności poszczególnych firm, ale także realizacji ambitnych celów strategicznych UE, znanych jako „Droga ku cyfrowej dekadzie”.

Europa dwóch prędkości: kto jest cyfrowym liderem, a kto zostaje w tyle?

Aby zrozumieć realny poziom cyfryzacji, nie wystarczy sprawdzić, czy firma ma dostęp do internetu. Kluczowe jest to, jak głęboko technologia jest zintegrowana z jej procesami biznesowymi. Mierzy to unijny Indeks Intensywności Cyfrowej (DII), który ocenia wykorzystanie 12 kluczowych technologii.

Zaledwie 58% MŚP w UE osiągnęło „podstawowy poziom” cyfryzacji, co oznacza wykorzystanie co najmniej czterech z tych technologii. To wynik odległy od celu UE, który zakłada, że do 2030 roku próg ten powinno osiągnąć ponad 90% firm z tego sektora.

Mapa Europy pokazuje wyraźny podział. Na czele peletonu znajdują się kraje nordyckie – w Finlandii aż 86% MŚP spełnia kryteria podstawowej cyfryzacji, a w Szwecji 80%. Na drugim biegunie plasują się Rumunia (27%) i Bułgaria (28%). Polska, z wynikiem 43% (dane na 2022 r.), znajduje się znacznie poniżej unijnej średniej, co sygnalizuje systemowe bariery hamujące potencjał naszych firm.

Problem polega na różnicy między „byciem online” a „byciem cyfrowym”. Prawie wszystkie firmy w UE mają szerokopasmowy internet, ale często wykorzystują go pasywnie – do obsługi poczty czy prowadzenia profilu w mediach społecznościowych. Prawdziwa transformacja zaczyna się, gdy technologia staje się integralną częścią modelu operacyjnego, a nie tylko jego fasadą.

Chmura obliczeniowa: fundament, na którym widać pęknięcia

Chmura obliczeniowa to dziś fundament elastyczności i skalowalności. W 2023 roku korzystało z niej 45,2% przedsiębiorstw w UE, co stanowi stały, ale powolny wzrost. Jednak diabeł tkwi w szczegółach.

Największym wyzwaniem jest „luka chmurowa” między firmami różnej wielkości. Podczas gdy 77,6% dużych korporacji aktywnie korzysta z chmury, wskaźnik ten dla małych przedsiębiorstw spada do zaledwie 41,7%. To ponad 35-punktowa przepaść, która pokazuje, że MŚP wciąż napotykają bariery w dostępie do tej fundamentalnej technologii.

Co więcej, firmy, które już są w chmurze, wykorzystują ją głównie do podstawowych zadań: obsługi poczty elektronicznej (82,7%), przechowywania plików (68%) czy oprogramowania biurowego (66,3%). Znacznie rzadziej sięgają po zaawansowane usługi, takie jak platformy deweloperskie (PaaS) czy moc obliczeniowa (IaaS), które są niezbędne do budowania innowacji.

Wniosek dla menedżerów jest prosty: chmura to nie tylko magazyn na dane, ale przede wszystkim platforma startowa dla AI. Firmy, które dziś nie zainwestują w dojrzałą infrastrukturę chmurową, jutro będą miały podwójną barierę do pokonania, by wejść do świata sztucznej inteligencji.

Sztuczna inteligencja: technologia, która dzieli najbardziej

Jeśli chmura pokazuje pęknięcia, to sztuczna inteligencja ujawnia prawdziwą przepaść. Mimo ogromnego zainteresowania, adopcja AI w europejskich firmach pozostaje na alarmująco niskim poziomie – w 2024 roku było to zaledwie 13,48%. To wynik dramatycznie odległy od unijnego celu 75% na 2030 rok.

„Luka wdrożeniowa AI” jest gigantyczna. Ze sztucznej inteligencji korzysta aż 41,17% dużych korporacji, ale tylko 11,21% małych firm. Oznacza to, że duże firmy wdrażają AI niemal cztery razy częściej. Polska, z wynikiem 5,9%, znajduje się na szarym końcu Europy, wyprzedzając jedynie Rumunię (3,07%).

Dlaczego ta przepaść jest tak głęboka? Wdrożenie chmury to często decyzja o optymalizacji kosztów. Implementacja AI to strategiczna inwestycja o niepewnym zwrocie, wymagająca nie tylko kapitału, ale przede wszystkim kompetencji i dojrzałej strategii zarządzania danymi – zasobów, których MŚP często brakuje.

Jeśli ten trend się utrzyma, AI, zamiast wyrównywać szanse, stanie się „wielkim dzielnikiem”. Może to doprowadzić do scenariusza „zwycięzca bierze wszystko”, w którym duże, bogate w dane korporacje, dzięki AI, staną się jeszcze silniejsze, marginalizując mniejszych graczy.

Cyberbezpieczeństwo: paradoks ryzyka w sektorze MŚP

Na papierze sytuacja wygląda dobrze: 92,76% firm w UE stosuje co najmniej jeden środek bezpieczeństwa ICT. Jednak są to głównie podstawy, takie jak silne hasła czy backup danych. Prawdziwy obraz odporności cyfrowej wyłania się, gdy spojrzymy na działania proaktywne.

Regularną ocenę ryzyka ICT – fundament każdej dojrzałej strategii bezpieczeństwa – przeprowadza zaledwie 34,1% firm w UE. Różnica między dużymi (75,62%) a małymi (29,35%) przedsiębiorstwami jest tu kolosalna. Oznacza to, że większość MŚP działa „na ślepo”, nie rozumiejąc w pełni swojej powierzchni ataku.

To prowadzi do „paradoksu ryzyka cyfrowego MŚP”. Z jednej strony, małe firmy są coraz częściej celem ataków, postrzegane jako „łatwiejszy łup” i brama do łańcuchów dostaw większych partnerów. Z drugiej strony, inwestują najmniej w strategiczną obronę, błędnie wierząc, że są zbyt małe, by przyciągnąć uwagę cyberprzestępców. W połączonej gospodarce bezpieczeństwo MŚP staje się kwestią bezpieczeństwa całego ekosystemu.

Jak zasypać cyfrową przepaść?

Bierność nie jest już opcją. Aby przetrwać i konkurować w cyfrowej dekadzie, liderzy MŚP muszą podjąć zdecydowane działania.

Warto zacząć od strategii, nie od technologii. Zanim zainwestujesz w jakiekolwiek narzędzie, zdefiniuj kluczowy problem biznesowy, który chcesz rozwiązać. Czy jest to zwiększenie sprzedaży, redukcja kosztów, a może poprawa obsługi klienta? Dopiero wtedy dobierz odpowiednie rozwiązanie.

Wykorzystaj chmurę jako fundament. Zmigruj podstawowe systemy (e-mail, pliki, księgowość) do chmury. To nie tylko uwolni zasoby i zwiększy bezpieczeństwo, ale przede wszystkim stworzy scentralizowaną bazę danych – warunek konieczny dla przyszłych wdrożeń AI.

Inwestuj w ludzi, nie tylko w platformy. Najlepsza technologia jest bezużyteczna bez kompetentnego zespołu. Skorzystaj z dostępnych programów unijnych i krajowych (np. Digital Skills and Jobs Coalition, SME4DD), aby podnosić kwalifikacje pracowników w zakresie analizy danych, marketingu cyfrowego i cyberbezpieczeństwa.

Myśl o bezpieczeństwie od samego początku. Traktuj cyberbezpieczeństwo jako integralną część każdego projektu cyfrowego, a nie kosztowny dodatek. Proaktywne podejście jest zawsze tańsze i skuteczniejsze niż reagowanie na kryzys.