Najnowszy raport Palo Alto Networks Unit 42 ujawnia alarmujący zwrot, jeśli chodzi o metody cyberataków. Atakujący odchodzą od tradycyjnej kradzieży danych na rzecz sabotażu operacyjnego, co prowadzi do gwałtownego wzrostu zakłóceń działalności firm i rekordowych żądań okupu. Ta zmiana strategii, w połączeniu z rosnącą szybkością i złożonością ataków, stawia organizacje w obliczu bezprecedensowych wyzwań w zakresie cyberbezpieczeństwa.

Sabotaż operacyjny nowym standardem

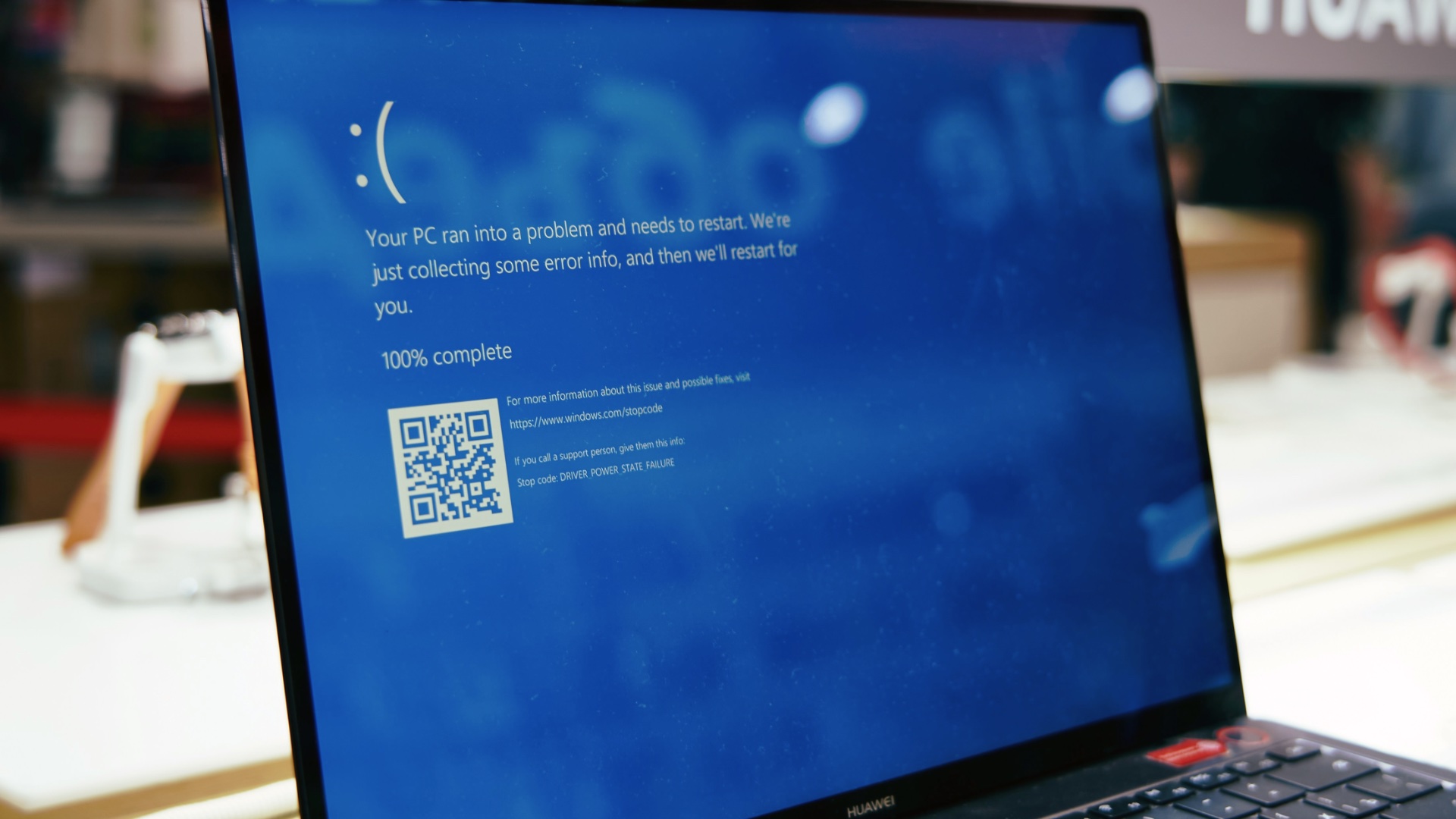

Dane z raportu „Global Incident Response Report 2025” wskazują na wyraźny trend: cyberprzestępcy coraz częściej koncentrują się na zakłócaniu działalności firm. Aż 86% ataków skutkuje przerwami w operacjach, a atakujący celowo niszczą infrastrukturę IT, blokują dostęp do systemów i usuwają kopie zapasowe. Ta destrukcyjna taktyka wywiera ogromną presję na ofiary, często zmuszając je do szybkiego ugięcia się pod żądaniami okupu.

Cyberprzestępcy działają coraz sprawniej i coraz lepiej wykorzystują sztuczną inteligencję do automatyzacji swoich działań. W 2024 roku cyberprzestępcy w 25% przypadków wykradali dane w mniej niż 5 godzin. To trzykrotnie szybciej niż jeszcze w 2021 roku. Tempo ataków nadal rośnie – eksperyment Unit 42 wykazał, że AI może skrócić czas kradzieży danych z dwóch dni do zaledwie 25 minut. Jednocześnie metody cyberprzestępców stają się coraz bardziej złożone. W 2024 roku aż 70% incydentów obejmowało atak na co najmniej trzy obszary IT jednocześnie – od sieci i punktów końcowych, po chmurę i infrastrukturę krytyczną – komentuje Wojciech Gołębiowski, wiceprezes i dyrektor zarządzający Palo Alto Networks w Europie Środkowo-Wschodniej.

Konsekwencją tego przesunięcia jest dramatyczny wzrost kwot okupu. Średnia wartość wyłudzeń osiągnęła w 2024 roku 1,25 miliona dolarów, co stanowi oszałamiający wzrost o 80% w porównaniu z rokiem poprzednim. Tak wysokie kwoty odzwierciedlają rosnące koszty przestojów i utraty reputacji, z jakimi muszą mierzyć się ofiary. Cyberprzestępcy, świadomi tej presji, bezwzględnie ją wykorzystują.

Wyścig z czasem i złożoność ataków

Raport Unit 42 potwierdza, że cyberprzestępcy działają z niespotykaną dotąd szybkością. W 2024 roku w 25% przypadków dane były wykradane w czasie krótszym niż 5 godzin – to trzykrotnie szybciej niż w 2021 roku. Co więcej, eksperymenty Unit 42 sugerują, że sztuczna inteligencja może jeszcze bardziej skrócić ten czas, potencjalnie do zaledwie 25 minut. Ta błyskawiczna prędkość pozostawia organizacjom minimalne okno na wykrycie i powstrzymanie ataku.

Jednocześnie metody atakujących stają się coraz bardziej wyrafinowane. W 2024 roku aż 70% incydentów obejmowało ataki na co najmniej trzy różne obszary IT jednocześnie, od sieci i punktów końcowych po chmurę i infrastrukturę krytyczną. Ta wielowektorowa strategia utrudnia obronę i zwiększa prawdopodobieństwo sukcesu ataku.

Phishing i chmura na celowniku

Raport identyfikuje również kluczowe wektory ataku i obszary podatności. Phishing powrócił na czoło listy, stanowiąc przyczynę 23% ataków. Rozwój generatywnej AI, która umożliwia tworzenie niezwykle przekonujących wiadomości phishingowych, znacząco przyczynia się do tego wzrostu. Ponadto, 44% cyberataków wykorzystywało luki w przeglądarkach internetowych, a chmura stała się kluczowym celem, z 45% przypadków kradzieży danych związanych z usługami chmurowymi. Co niepokojące, 29% wszystkich ataków miało swoje źródło w środowiskach chmurowych, a 21% prowadziło do bezpośrednich strat operacyjnych.

Zagrożenie wewnętrzne i brak integracji

Raport Unit 42 zwraca również uwagę na alarmujący wzrost liczby ataków wewnętrznych, które w 2024 roku wzrosły trzykrotnie. Wiele z nich jest powiązanych z działalnością grup hakerskich sponsorowanych przez Koreę Północną, które stosują wyrafinowane techniki inżynierii społecznej, takie jak fałszywe oferty pracy, aby uzyskać dostęp do systemów.

Co więcej, raport ujawnia poważne niedociągnięcia w obecnych strategiach bezpieczeństwa. Aż 75% ataków można było wykryć wcześniej, ponieważ dowody na włamanie znajdowały się w logach. Problemem jest jednak nadmierne zaufanie i brak integracji narzędzi bezpieczeństwa. Organizacje używają średnio 50 różnych systemów ochrony, które często nie współpracują ze sobą, tworząc luki, które wykorzystują cyberprzestępcy.

Konieczność proaktywnej obrony

W obliczu tych rosnących zagrożeń, raport Unit 42 podkreśla pilną potrzebę zmiany podejścia do cyberbezpieczeństwa. Firmy muszą przyspieszyć wdrażanie strategii Zero Trust, ograniczyć domyślne zaufanie w swoich systemach i skuteczniej zabezpieczać aplikacje i środowiska chmurowe. Kluczowe jest również usprawnienie działań zespołów bezpieczeństwa poprzez wdrożenie zintegrowanych systemów monitorowania i automatyzację wykrywania i neutralizacji ataków.

W obliczu rosnącej liczby cyberataków firmy muszą przyspieszyć wdrażanie strategii Zero Trust, czyli ograniczyć domyślne zaufanie w swoich systemach. Kluczowe jest także skuteczniejsze zabezpieczenie aplikacji i środowisk chmurowych – od etapu ich tworzenia po codzienne działanie – tak, by szybko wykrywać i usuwać luki w zabezpieczeniach. Równie istotne jest usprawnienie działań zespołów bezpieczeństwa, żeby miały pełny obraz sytuacji i mogły szybciej reagować na zagrożenia. Pomogą w tym zintegrowane systemy monitorujące, obejmujące zarówno infrastrukturę lokalną, chmurę, jak i urządzenia końcowe, a także automatyczne wykrywanie i neutralizacja ataków – wyjaśnia Wojciech Gołębiowski, wiceprezes i dyrektor zarządzający Palo Alto Networks w Europie Środkowo-Wschodniej.

Raport „Global Incident Response 2025” jasno pokazuje, że cyberbezpieczeństwo nie jest już jedynie kwestią ochrony danych. W erze sabotażu operacyjnego, firmy muszą zabezpieczać całą swoją infrastrukturę, a skuteczna obrona wymaga przejścia od reaktywnego do proaktywnego działania. To jedyna droga do zapewnienia stabilności i odporności biznesu w coraz bardziej niebezpiecznym cyfrowym krajobrazie.