Jeżeli ostatnie 15 lat czegoś nas nauczyło, to tego, aby oczekiwać nieprzewidywalnego. Niewiele osób przewidziało kryzys finansowy w 2009 roku. Nikt nie przewidział pandemii COVID-19. Każde takie wydarzenie pokazuje, że to, co ma sens dziś, jutro może się okazać bezsensowne. Parafrazując często wypowiadane przez przywódców powiedzenie: żaden plan nie przetrwa konfrontacji z czasem.

Wydarzenia te mają daleko idące skutki – nie tylko dla życia jednostek, ale dla całych społeczeństw i działalności biznesowej. Chcę dziś skupić się na tym, w jaki sposób przedsiębiorstwa mogą chronić się przed takimi wstrząsami. A dokładniej, w jaki sposób wybór technologii może zwiększyć ich odporność.

Linia argumentacji

Wstrząsy są – ze swojej natury – nieprzewidywalne. Jeśli nie da się przewidzieć zagrożenia, to jak łagodzić jego skutki, gdy nadejdzie? Często kluczem jest szybkość reagowania – umiejętność odsunięcia od siebie zagrożenia, zanim nas dotknie. Problem tkwi w tym, jak zapewnić to szybkie reagowanie.

Każda dobrze zarządzana firma przyjmuje takie podejście w sferze finansów – często utrzymuje rezerwy w różnych aktywach i walutach, aby ograniczyć skutki nagłej utraty wartości jednej z nich i zachować płynność umożliwiającą dywersyfikację na bezpieczniejsze inwestycje. To samo dotyczy krajów i ich bezpieczeństwa energetycznego.

Odnieśmy to teraz do branży technologicznej. Gdy przedsiębiorstwo uzależnia się całkowicie od jednego dostawcy, to koniec końców jest zdane na jego łaskę i niełaskę. Jeśli coś pójdzie nie tak albo relacje z dostawcą ulegną pogorszeniu, takie przedsiębiorstwo nie ma alternatywy. A przynajmniej nie od razu. Historia pokazuje, że to może się wydarzyć. 2e2, Nirvanix, Fusion – oto kilka przykładów renomowanych firm zajmujących się przetwarzaniem i przechowywaniem danych w chmurze, które niestety upadły.

Nagła podwyżka cen, naruszenie bezpieczeństwa lub pojawienie się w branży nowego, innowacyjnego gracza – wszystkie te czynniki mogą skłaniać do zmiany dostawcy rozwiązań. Ale im większa zależność od aktualnego dostawcy, tym trudniej to osiągnąć.

Gdy firma ma możliwość swobodnego przemieszczania aplikacji i obciążeń między poszczególnymi środowiskami, może zwiększać lub zmniejszać ich wykorzystanie w zależności od potrzeb. Dlatego właśnie rozsądną strategią stało się hybrydowe podejście do infrastruktury – łączenie środowiska lokalnego z chmurą, chmury prywatnej z chmurą publiczną, a także różnych chmur publicznych ze sobą.

I również dlatego infrastrukturę hybrydową uzupełnia oprogramowanie open source. Nie chodzi tylko o to, że mając dane bazowe, można przenieść aplikację do innej infrastruktury albo przenieść dane do całkiem nowej aplikacji. Oprogramowanie open source sprzyja elastyczności, ponieważ stoi za nim społeczność, a indywidualni współtwórcy zwykle szybciej reagują na kryzys niż duże firmy, gdzie panuje ścisła hierarchia i złożone struktury decyzyjne.

Jak być w czołówce innowacyjności

Na szczęście duże wstrząsy zdarzają się dość rzadko. Na co dzień w firmach więcej czasu poświęca się na myślenie o rozwoju i zdobywaniu rynku, oraz odpowiednie planowanie. W takiej sytuacji połączenie oprogramowania open source z infrastrukturą hybrydową jest doskonałym sposobem na wprowadzanie innowacji.

Także tutaj źródłem wartości jest społeczność open source. Logika jest prosta. W pokoju jest 100 osób. Czy stawiasz na to, że najlepszy pomysł będzie dziełem jednej osoby, czy może efektem zbiorowego wysiłku pozostałych 99 osób? Innowacyjność nigdy nie rodzi się w jednym miejscu. Technologia open source daje dostęp do wszystkich i wszędzie. To oznacza więcej osób z pomysłem, więcej osób czuwających nad poprawnością oraz więcej osób zapewniających wsparcie.

Innowacyjność nie polega na kupowaniu „nowinek”. Jak niedawno wyjaśnił nasz dyrektor generalny Paul Cormier, takie podejście nie jest ani praktyczne, ani zrównoważone. W innowacyjności chodzi o modernizację, czyli udoskonalanie tego, co mamy. Jeżeli pod względem wprowadzania innowacji jesteśmy uzależnieni od chęci i możliwości dostawcy, to zawsze będziemy w tyle. Technologia open source daje kontrolę i zgodność operacyjną, które sprzyjają myśleniu w kategoriach „zbuduj to lepiej”, co z kolei rodzi bardziej proaktywne podejście do szukania nowych możliwości komercyjnych.

Wiedzą o tym prywatne firmy technologiczne. Google ma Kubernetes i Fluttera; Microsoft – Azure Docs i VS Code; AWS i Apple używają Linuksa. Najlepszym przykładem potencjału innowacyjności, jaki ma w sobie technologia open source, jest bitcoin. Ta kryptowaluta osiągnęła kapitalizację rynkową rzędu 800 miliardów dolarów dzięki pomysłowości i zaangażowaniu społeczności, która ją stworzyła i utrzymuje.

Eliminowanie nadmiernej złożoności

Im więcej czegoś mamy, z tym większą złożonością musimy się mierzyć. Środowisko lokalne, w którym działa tylko kilka programów, jest uporządkowane i łatwo nim zarządzać. Jednak infrastruktura hybrydowa z oprogramowaniem open source działająca na dużą skalę musi być dopracowana.

Bez odpowiedniej orkiestracji – czyli koordynacji – sytuacja może stać się skomplikowana i kosztowna.

Wiemy o tym intuicyjnie. Biblioteki pozwalają uporządkować informacje; w samochodach znajdują się skoordynowane systemy mechaniczne, nawigacyjne i rozrywkowe; smartfony aranżują nasze życie. Orkiestracja usuwa ograniczenia, umożliwiając wybór i skalowanie.

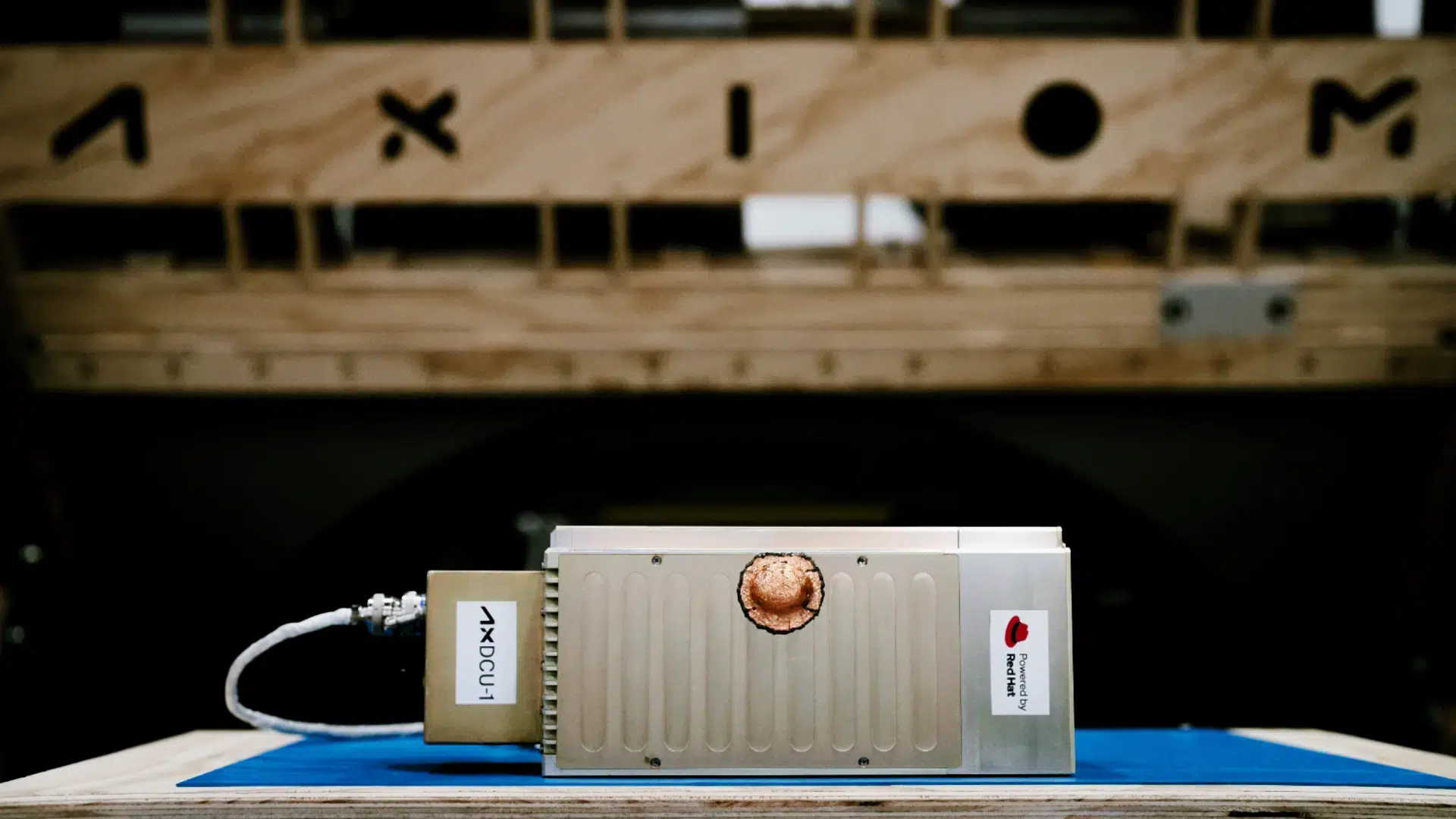

Dotyczy to również technologii wykorzystywanych w przedsiębiorstwach. Platforma orkiestracji – na przykład Red Hat OpenShift – eliminuje złożoność poprzez umożliwienie współdziałania oprogramowania (i jego poszczególnych składników) niezależnie od tego, gdzie jest uruchomione. Ma to kluczowe znaczenie dla skutecznego modernizowania aplikacji, ponieważ umożliwia przedsiębiorstwu refaktoryzację albo całkowitą przebudowę oprogramowania z użyciem kontenerów i mikroserwisów. Dodatkowa warstwa automatyzacji zapewnia płynność działania.

Kultura – ostatni element układanki

Orkiestracja to nie tylko kwestia organizacji i automatyzacji produktów i reguł. Technologia sama w sobie jest pozbawiona wartości, jeśli nie ma wsparcia ze strony ludzi. To ludzie wdrażają technologię i sprawiają, że staje się produktywna.

A zatem należy objąć orkiestracją ludzi. Tylko co to właściwie znaczy? Odpowiedzią na oba te pytania jest kultura. A bardziej konkretnie: otwarta kultura.

Nie ma sensu umożliwiać wyboru technologii, jeśli jednocześnie ludzie nie będą mieć odpowiednich zdolności do dokonywania wyborów. To właśnie rozumiemy przez otwartą kulturę. Zaufanie do współpracowników i ocenianie ich pomysłów na podstawie wartości merytorycznej, a nie stażu pracy osoby, która je proponuje. Wspieranie „cichych talentów” wewnątrz firmy i ich pomysłów. Logicznym efektem tego podejścia jest zróżnicowanie wiedzy i doświadczenia.

Aby czerpać korzyści z kontroli i elastyczności infrastruktury hybrydowej i oprogramowania open source, trzeba też przyjąć otwartą kulturę.

Wkład w tworzenie historii

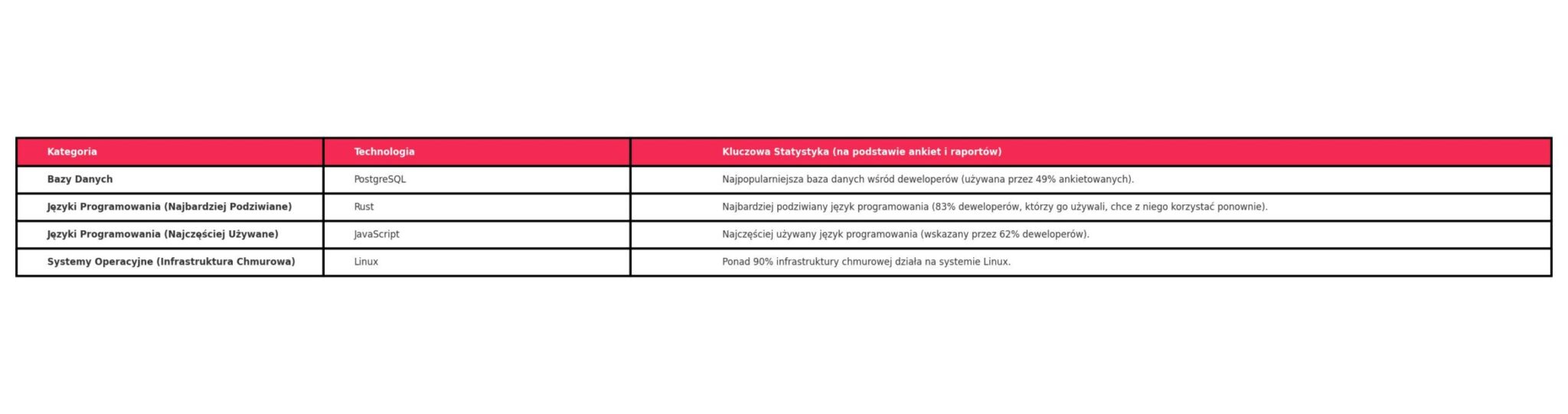

Oto strategia, po którą sięga większość przedsiębiorstw. Niedawne badanie ankietowe przeprowadzone przez Red Hat wśród prawie 1300 szefów działów IT z całego świata pokazuje, jak te argumenty odzwierciedlają się w praktyce: aż 95% respondentów stwierdziło, że technologia open source jest ważna dla całej infrastruktury organizacji, a wśród najważniejszych powodów wymieniło wzrost elastyczności (79%), dostęp do innowacji (77%) i wsparcie dla strategii chmur hybrydowych (77%).

Wyniki tej analizy branżowej dostarczają przekonujących argumentów za technologią open source. Firma dobrze przygotowana na przetrwanie wstrząsów i wykorzystywanie szans odniesie większy sukces niż przedsiębiorstwo działające w sztywnych ramach. Rezygnacja z technologii open source i infrastruktury hybrydowej jest równoznaczna z przekonaniem, że jesteśmy u kresu historii i widzieliśmy już wszystkie możliwe zawirowania, jakie mogą się wydarzyć na świecie i na rynkach. Wystarczy jednak rozejrzeć się wokół, aby stwierdzić, że wcale tak nie jest.

Autor: Hans Roth, starszy wiceprezes i dyrektor generalny w EMEA, Red Hat