Rynek oprogramowania do zarządzania relacjami z klientem (CRM) to strategiczne pole bitwy, którego wartość w 2024 roku przekroczyła 80 miliardów dolarów, czyniąc go największą kategorią oprogramowania dla przedsiębiorstw.

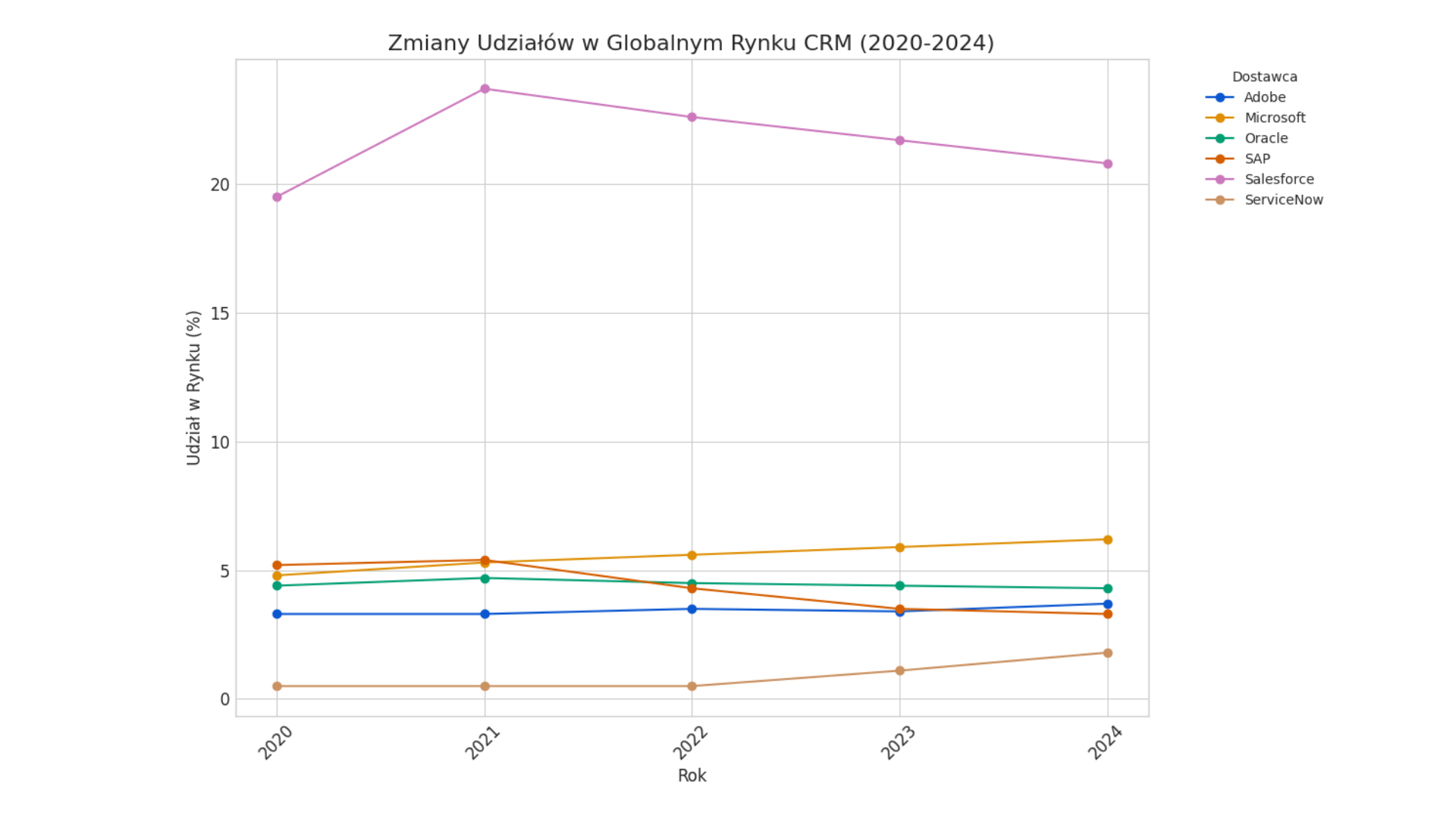

Na czele tego imperium od ponad dekady stoi Salesforce, niekwestionowany lider, którego analitycy z IDC już dwunasty rok z rzędu koronują na króla rynku. Z platformy korzysta ponad 150 000 firm, w tym około 90% korporacji z listy Fortune 500, a jego udział w rynku jest większy niż łączny udział czterech największych konkurentów.

Jednak nawet najpotężniejsze królestwa nie są wieczne. Mimo że przychody Salesforce wciąż rosną, jego procentowy udział w rynku zaczął nieznacznie spadać – z 21,7% w 2023 roku do 20,7% w 2024. Ten subtelny, lecz istotny sygnał pokazuje, że krajobraz strategiczny ulega zmianie.

Odrodzenie ekosystemowego giganta w postaci Microsoftu, pojawienie się dysruptora z innej domeny, jakim jest ServiceNow, oraz nieustająca presja rewolucji AI tworzą największe od lat wyzwanie dla hegemonii Salesforce. Czy jesteśmy świadkami początku końca ery Salesforce, czy jedynie przejściowych turbulencji?

Anatomia dominacji: jak Salesforce zbudował swoje imperium

Zrozumienie obecnych wyzwań wymaga analizy fundamentów potęgi Salesforce. Jego dominacja to wynik konsekwentnej strategii opartej na trzech filarach:

- Pionierstwo w chmurze: Jako jeden z pierwszych graczy, który postawił na model Software-as-a-Service (SaaS), Salesforce zyskał ogromną przewagę, eliminując u klientów potrzebę inwestowania w kosztowną infrastrukturę

- Niezrównany ekosystem (AppExchange): Stworzenie AppExchange było strategicznym majstersztykiem. Umożliwiając tysiącom deweloperów tworzenie własnych rozszerzeń, Salesforce zbudował wokół swojej platformy samonapędzającą się gospodarkę, która sprawiła, że system stał się niezwykle „lepki” – trudny i kosztowny do opuszczenia.

- Wzrost przez akwizycje: Przejęcia takie jak Tableau (15,7 mld USD) czy Slack (27,7 mld USD) nie były jedynie zakupami technologii, ale strategicznymi ruchami mającymi na celu przejęcie kontroli nad kluczowymi obszarami: analityką danych i komunikacją firmową.

W obliczu nowych zagrożeń Salesforce inwestuje miliardy w rozwój platformy Einstein AI, czego dowodem jest niedawne przejęcie Convergence AI za 14 miliardów dolarów, firmy specjalizującej się w predykcji zachowań klientów.

Jednak to właśnie strategia, która była źródłem siły Salesforce – agresywne przejęcia – może okazać się jego piętą achillesową. Doprowadziła ona do powstania potężnego, ale architektonicznie niespójnego portfolio.

Zamiast jednej, zunifikowanej platformy, Salesforce oferuje zbiór połączonych ze sobą „chmur”, co tworzy fundamentalne wyzwania związane z unifikacją danych – kluczowym warunkiem skutecznego wdrożenia AI.

Przebudzenie giganta: Microsoft Dynamics 365 i potęga ekosystemu

Microsoft przez lata był postrzegany jako jeden z wielu pretendentów, jednak jego ostatnie ruchy czynią go najpoważniejszym rywalem dla Salesforce. Strategia Microsoftu nie polega na wygraniu w bezpośrednim porównaniu funkcji CRM.

Zamiast tego, firma dąży do tego, by Dynamics 365 stał się naturalnym wyborem dla milionów przedsiębiorstw, które już funkcjonują w jej ekosystemie.

Kluczem jest bezproblemowa, natywna integracja z Microsoft 365, Teams, Power BI oraz chmurą Azure. W tej strategii centralną rolę odgrywa Copilot – warstwa inteligencji, która przenika wszystkie aplikacje Microsoftu.

Copilot w Outlooku analizuje treść maila i automatycznie sugeruje utworzenie nowej szansy sprzedaży w Dynamics 365. W Teams generuje podsumowanie spotkania, które od razu trafia do CRM. Ta głęboka, kontekstowa integracja tworzy pętlę produktywności, której Salesforce nie jest w stanie łatwo skopiować.

Co więcej, Microsoft aktywnie konkuruje niższym całkowitym kosztem posiadania (TCO) i elastycznością. Studia przypadków firm, które przeszły z Salesforce na Dynamics 365, często podkreślają redukcję niepotrzebnych customizacji o 30-60% oraz znaczne przyspieszenie cykli raportowania.

Dla dyrektorów IT zmagających się z chaosem aplikacyjnym, propozycja Microsoftu – konsolidacja dostawców w ramach jednego, spójnego ekosystemu – jest niezwykle kusząca.

Atak z innej dziedziny: ServiceNow i rewolucja workflow

Wejście ServiceNow na rynek CRM to jedno z najciekawszych wydarzeń w branży od lat. Firma nie próbuje konkurować z Salesforce na jego warunkach. Zamiast tego, proponuje fundamentalnie inne podejście. Tradycyjne CRM-y to „systemy zapisu” (systems of record).

ServiceNow pozycjonuje się jako „system działania” (system of action), którego celem jest orkiestracja i automatyzacja działań w całej firmie, aby zrealizować obietnicę złożoną klientowi.

Sercem przewagi konkurencyjnej ServiceNow jest jego architektura. W przeciwieństwie do Salesforce, ServiceNow od początku rozwijało się organicznie, w oparciu o filozofię „jednej platformy, jednego modelu danych, jednej architektury”.To podejście eliminuje złożoność integracji i tworzy idealne środowisko dla sztucznej inteligencji.

Unikalna pozycja ServiceNow wynika z jego korzeni w zarządzaniu usługami IT (ITSM). Firma przenosi swoją ekspertyzę w automatyzacji złożonych, wewnętrznych procesów na procesy skierowane do klienta, takie jak obsługa klienta (CSM) i serwis w terenie (FSM).

Strategia ta jest szczególnie atrakcyjna dla branż o skomplikowanych procesach posprzedażowych, jak telekomunikacja czy usługi finansowe. ServiceNow próbuje zmienić zasady gry, argumentując, że prawdziwa wartość leży nie w samej sprzedaży, ale w realizacji obietnicy złożonej klientowi.

Stara gwardia w obronie: pozycja Oracle i SAP

Podczas gdy na czele toczy się walka, weterani rynku, Oracle i SAP, prowadzą własną batalię o obronę swoich terytoriów. Strategia Oracle opiera się na niższym TCO i oferowaniu w pełni zintegrowanego pakietu aplikacji front-office (CX/CRM) i back-office (ERP, HCM).

Jest to atrakcyjne dla firm już zakorzenionych w ekosystemie Oracle, co potwierdza pozycja „Lidera” w Magicznym Kwadrancie Gartnera.

Podejście SAP jest podobne i koncentruje się na wykorzystaniu gigantycznej bazy klientów systemu ERP S/4HANA. Propozycja wartości SAP CX polega na obietnicy płynnej, natywnej integracji z kluczowymi danymi finansowymi i logistycznymi rezydującymi w sercu przedsiębiorstwa.

Dla obecnego klienta SAP, wybór zintegrowanego CRM od tego samego dostawcy jest często ścieżką najmniejszego oporu.

Przyszłość królestwa

Walka o tron CRM nie toczy się już tylko na polu funkcjonalności. O przyszłości zadecyduje starcie fundamentalnie różnych filozofii technologicznych.

Analiza strategii głównych graczy ujawnia trzy kluczowe osie rywalizacji: platforma kontra aplikacja, AI wbudowane kontra AI jako warstwa oraz centralna rola danych.

Biorąc pod uwagę te trendy, można nakreślić trzy prawdopodobne scenariusze na najbliższe lata:

- Erozja Status Quo: Salesforce utrzymuje pozycję lidera, ale jego udział w rynku nadal powoli maleje. Microsoft umacnia się na drugiej pozycji, a ServiceNow zdobywa znaczącą niszę w branżach o złożonych procesach usługowych.

- Duopol Władzy: Przewaga ekosystemu Microsoftu okazuje się decydująca. Firma znacząco zmniejsza dystans do Salesforce, tworząc wyraźny wyścig dwóch koni

- Nowy Triumwirat: Podejście ServiceNow, skoncentrowane na przepływach pracy, odnosi tak duży sukces, że redefiniuje część rynku, czyniąc z firmy trzeciego, niekwestionowanego gracza na najwyższym poziomie.

Werdykt końcowy? Tytuł „najlepszego CRM” przestał być uniwersalny. Optymalny wybór zależy od strategicznego centrum grawitacji danej firmy.

Jeśli priorytetem jest najlepsze w swojej klasie, zorientowane na sprzedaż zaangażowanie klienta, wsparte przez największy na świecie ekosystem aplikacji, Salesforce pozostaje domyślnym liderem.

Jeśli celem jest maksymalizacja produktywności w całej organizacji i wykorzystanie istniejących inwestycji w technologie Microsoft, Dynamics 365 oferuje potężną, zintegrowaną i często bardziej opłacalną propozycję.

Jeśli model biznesowy opiera się na złożonych, wielodziałowych procesach usługowych i wsparcia posprzedażowego, ServiceNow prezentuje fundamentalnie inne i potencjalnie znacznie skuteczniejsze podejście.

Ostateczna rada dla decydentów brzmi: nie oceniajcie platform CRM wyłącznie na podstawie ich dzisiejszych funkcji. Analizujcie ich fundamentalną filozofię architektoniczną i jej zgodność z długoterminową strategią waszej firmy w obszarze danych, AI i automatyzacji. W tej nowej erze to właśnie te fundamenty zadecydują o przyszłym sukcesie.