Wkraczamy w erę fundamentalnej zmiany interakcji człowieka z technologią cyfrową. Spatial Computing, czyli przetwarzanie przestrzenne, przekształca otaczającą nas przestrzeń w interaktywny interfejs, łącząc świat fizyczny z cyfrowym. Technologie takie jak Augmented Reality (AR), Mixed Reality (MR) i Virtual Reality (VR) umożliwiają komputerom naturalną integrację z rzeczywistością: AR nakłada dane na świat rzeczywisty, MR pozwala na interakcję z cyfrowymi obiektami w fizycznym otoczeniu, a VR całkowicie zanurza użytkownika w wirtualnym środowisku.

To nie tylko ewolucja urządzeń – to zmiana w sposobie postrzegania i wykorzystania informacji. Tradycyjne interfejsy 2D wymagają mentalnej translacji, podczas gdy Spatial Computing osadza dane bezpośrednio w przestrzeni użytkownika, oferując bardziej intuicyjne i mniej obciążające poznawczo interakcje. Dla biznesu oznacza to szybsze szkolenie pracowników, mniej błędów i bardziej płynne procesy.

Rozwój Spatial Computing napędzają kluczowe technologie: edge i cloud computing zapewniają moc obliczeniową blisko użytkownika, AI i ML interpretują dane z sensorów i wspierają naturalne interakcje (np. śledzenie dłoni), a systemy world capture tworzą trójwymiarowe mapy otoczenia. Współdziałanie tych rozwiązań umożliwia transformację procesów biznesowych, projektowania i obsługi klienta, oferując doświadczenia o niespotykanej dotąd głębi.

Stan rynku AR/VR: specjalistyczna nisza z dużym potencjałem wzrostu

Rynek AR/VR, będący fundamentem Spatial Computing, dynamicznie rośnie, choć wciąż znajduje się na wczesnym etapie rozwoju. W 2024 roku jego wartość szacowano na 22,12 mld USD, z prognozowanym wzrostem do 96,32 mld USD w 2029 roku (CAGR 34,2%). Inne prognozy mówią o wzroście globalnym do 38% rocznie, a w regionie EMEA – ok. 16%. Segment AR rozwija się szybciej (CAGR 40,7%) niż VR (26,3%).

Pomimo wysokiego tempa wzrostu, rynek pozostaje relatywnie niewielki w porównaniu z dojrzałymi sektorami IT. Wysoki CAGR jest typowy dla rynków wschodzących – wskazuje na potencjał, ale też zmienność i ryzyko. Inwestorzy muszą liczyć się z koniecznością długofalowego podejścia.

AR/VR to wciąż specjalistyczna nisza – silnie zależna od B+R i technologicznych przełomów. Jak pokazuje branżowa konferencja AWE, sektor XR nadal jest mały, a firmy szukające finansowania muszą wykazywać się silną pozycją w swojej kategorii. Wdrożenia korporacyjne mają często charakter pilotażowy.

Postęp technologiczny znajduje odzwierciedlenie w rosnącej liczbie patentów – od zaawansowanego sprzętu (HMD, interfejsy, wyświetlacze), przez oprogramowanie (środowiska wirtualne, interakcje), po integrację z AI i mobilne aplikacje AR. Krajobraz patentowy ujawnia kierunki inwestycji gigantów takich jak Meta, Apple czy Sony, co może sygnalizować zmiany w łańcuchu wartości i ryzyka związane z własnością intelektualną – istotne także dla mniejszych firm i kanału IT.

Rynek dzieli się na segment konsumencki (dominujący wolumenowo) oraz biznesowy. W tym drugim prognozuje się największy wzrost, szczególnie w MR i XR – w kontekście szkoleń, zdalnej współpracy czy immersyjnych doświadczeń w przemyśle, medycynie i handlu. Na tych zastosowaniach koncentruje się dalsza część artykułu.

Dlaczego AR/VR to rynek dla odważnych? Kluczowe kompetencje i wyzwania technologiczne

Sukces na rynku Spatial Computing wymaga nie tylko odwagi inwestycyjnej, lecz przede wszystkim specjalistycznych kompetencji technicznych. Złożoność tej dziedziny wynika z jej interdyscyplinarnego charakteru, łączącego grafikę 3D, inżynierię oprogramowania oraz projektowanie doświadczeń użytkownika. Tworzenie realistycznych środowisk wirtualnych wymaga zaawansowanego modelowania oraz znajomości silników takich jak Unity czy Unreal Engine, które stały się podstawą budowania interaktywnych aplikacji. Projektowanie przestrzennych interfejsów wymaga natomiast podejścia uwzględniającego ergonomię, naturalność gestów i unikanie dyskomfortu. W zastosowaniach biznesowych niezbędna jest również umiejętność integracji z istniejącą infrastrukturą – systemami ERP, MES, PLM czy platformami IoT – a także z cyfrowymi bliźniakami.

Połączenie tych kompetencji w jednym zespole jest trudne, co tworzy barierę wejścia dla wielu firm. Jednocześnie stanowi to szansę dla wyspecjalizowanych integratorów i deweloperów, którzy mogą oferować te umiejętności jako usługę. Firmy, które zbudują interdyscyplinarne zespoły, zyskają przewagę w dostarczaniu rozwiązań trudnych do samodzielnego wdrożenia przez klientów, co wzmacnia pozycję tzw. „pierwszego na rynku”.

Mimo szybkiego rozwoju, adopcja AR/VR w przedsiębiorstwach napotyka liczne wyzwania. Koszty sprzętu, oprogramowania i tworzenia treści są wysokie, a zwrot z inwestycji trudny do oszacowania. Zaawansowane headsety pozostają drogie, a ograniczenia sprzętowe – takie jak krótki czas pracy na baterii czy niewygoda użytkowania – nadal stanowią barierę. Problematyczna bywa także integracja z istniejącą infrastrukturą IT i OT, co często wiąże się z dodatkowymi kosztami i złożonością techniczną.

Równolegle, rynek cierpi na deficyt wartościowych, branżowych treści, które mogłyby jednoznacznie wykazać korzyści wdrożenia. Tworzenie takich aplikacji jest kosztowne i czasochłonne, co zniechęca deweloperów – zwłaszcza przy niewielkiej bazie użytkowników. Dodatkowo, użytkownicy nadal zmagają się z problemami komfortu, takimi jak zmęczenie oczu czy cybersickness, co utrudnia długotrwałe korzystanie z urządzeń. Istotne są też kwestie prywatności i bezpieczeństwa – AR/VR generuje ogromne ilości danych o użytkownikach i ich otoczeniu, co budzi uzasadnione obawy.

Rynek pozostaje silnie zfragmentowany – różnorodność sprzętu, systemów operacyjnych i narzędzi deweloperskich utrudnia tworzenie przenośnych, skalowalnych rozwiązań, zwiększając koszty rozwoju. Powstaje swoiste błędne koło: wysokie koszty i bariery techniczne ograniczają inwestycje, co zmniejsza bazę użytkowników i zniechęca twórców treści. Z kolei brak atrakcyjnych aplikacji nie uzasadnia zakupu drogiego sprzętu. Przełamanie tego impasu wymaga albo znacznego postępu technologicznego i obniżenia kosztów, albo pojawienia się przełomowej aplikacji o tak dużej wartości, że usprawiedliwiona inwestycję mimo początkowych barier.

Zastosowania biznesowe i przemysłowe AR/VR: gdzie już dziś tworzy się wartość

Mimo wyzwań technologicznych i rynkowych, technologie AR/VR już teraz przynoszą wymierne korzyści w wielu branżach. Ich sukces najczęściej wynika z rozwiązywania konkretnych problemów operacyjnych – od poprawy efektywności i jakości, po zwiększenie bezpieczeństwa i lepszy transfer wiedzy.

W sektorze przemysłowym AR/VR znalazło zastosowanie m.in. w zdalnym wsparciu technicznym i konserwacji. Pracownik wyposażony w okulary AR może uzyskać w czasie rzeczywistym wskazówki od eksperta, co pozwala szybciej diagnozować awarie i ograniczać przestoje. Równie skuteczne okazują się szkolenia w VR, które umożliwiają symulację pracy w niebezpiecznych warunkach bez ryzyka dla ludzi i sprzętu. Technologie te wspierają także montaż i kontrolę jakości – w Boeingu i Lockheed Martin użycie AR przyspieszyło realizację zadań i zmniejszyło liczbę błędów. W połączeniu z cyfrowymi bliźniakami i wizualizacją danych, AR/VR wspiera również optymalizację procesów i lepsze zarządzanie produkcją. Przykład DHL pokazuje, że wdrożenie „vision picking” z użyciem AR może zwiększyć produktywność kompletacji nawet o 25% i znacząco skrócić czas wdrożenia nowych pracowników.

W opiece zdrowotnej AR/VR wspiera planowanie zabiegów chirurgicznych, umożliwiając lekarzom analizę modeli anatomicznych stworzonych na podstawie obrazowania CT lub MRI. Technologie te zmieniają też sposób szkolenia medyków – np. FundamentalVR odnotował 44% poprawy precyzji zabiegów dzięki treningowi z użyciem HapticVR®. VR jest również wykorzystywane w rehabilitacji, leczeniu fobii i bólu, a także w edukacji pacjentów – lekarze mogą w przystępny sposób prezentować stan zdrowia i plan leczenia, co zwiększa zaufanie i zaangażowanie.

Poza przemysłem i medycyną AR/VR zyskuje znaczenie w edukacji. Immersyjne treści pozwalają tworzyć wirtualne laboratoria, interaktywne lekcje i trójwymiarowe wizualizacje zjawisk, co zwiększa efektywność nauczania. Badania pokazują, że wykorzystanie VR może poprawić retencję wiedzy o 75%, skrócić czas nauki o 40% i zwiększyć zaangażowanie uczniów.

W handlu i architekturze AR/VR zmieniają sposób prezentacji produktów i projektów. Architekci wykorzystują VR do spacerów po wirtualnych budynkach, co ułatwia podejmowanie decyzji inwestycyjnych. Klienci detaliczni mogą natomiast „przymierzać” ubrania czy meble w AR, co zwiększa satysfakcję i ogranicza liczbę zwrotów. Wirtualne wizyty w nieruchomościach zyskują na popularności, a rynek detaliczny notuje jeden z najszybszych wzrostów, z przewidywanym CAGR na poziomie 46% do 2025 roku.

Według danych IDC, do 2025 roku ponad połowa rynku AR/VR w regionie EMEA przypadnie na branże takie jak inżynieria, opieka zdrowotna, produkcja i handel detaliczny. Coraz większy udział mają również rozwiązania korporacyjne – w szczególności w zakresie szkoleń i zdalnej współpracy – które wyprzedzają już segment konsumencki.

Wdrożenie AR/VR często inicjuje głębszą transformację cyfrową. Aby wyświetlać np. dane serwisowe maszyny bezpośrednio w polu widzenia technika, systemy immersyjne muszą być zintegrowane z backendem firmy – ERP, PLM czy platformami IoT. Z tego względu AR/VR staje się nie tylko nowym interfejsem, lecz również katalizatorem porządkowania danych, poprawy interoperacyjności i modernizacji IT. Dla partnerów technologicznych oznacza to dostęp do większych, bardziej strategicznych projektów, obejmujących integrację systemów, zarządzanie danymi i rozwój infrastruktury.

Cykl życia technologii AR/VR: kiedy nastąpi masowa adopcja?

Umiejscowienie technologii AR/VR na krzywej Gartner Hype Cycle pozwala lepiej zrozumieć jej obecny poziom dojrzałości i przewidywany czas do osiągnięcia masowej adopcji. Choć rynek jako całość wciąż określany jest jako wczesny, innowacyjny i badawczy, pojawiają się już rentowne nisze. AR/VR nie zajmuje jednej, precyzyjnej pozycji na wykresie – różne segmenty tej technologii znajdują się na różnych etapach cyklu.

Przykładowo, metaverse jako narzędzie edukacyjne był w 2023 roku umieszczany na etapie „Innovation Trigger”. Industrial Metaverse i pokrewne technologie, takie jak symulacje AI w produkcji, pojawiły się w Hype Cycle dla Zaawansowanych Technologii w Produkcji na 2024 rok, co również wskazuje na wczesną fazę rozwoju. Gartner prognozował, że do 2026 roku jedna czwarta ludzi będzie spędzać co najmniej godzinę dziennie w metaverse, choć zaznaczał, że jego dojrzałość wciąż pozostaje odległa.

Podstawowe zastosowania VR w grach czy prostych szkoleniach mogły już przejść przez fazę zawyżonych oczekiwań i znajdować się w okresie rozczarowania lub wchodzić w etap stopniowego dojrzewania. Z kolei bardziej złożone wizje, jak pełna integracja Spatial Computing jako interfejsu biznesowego, nadal mieszczą się w fazie wczesnych zapowiedzi lub osiągają dopiero szczyt oczekiwań.

Wizualizacja AR/VR na wykresie Hype Cycle powinna odzwierciedlać tę niejednorodność – zaznaczając zarówno segmenty bliższe dojrzałości, jak i te wciąż na etapie eksperymentów. Przewidywany czas dojścia do etapu masowej produktywności może wynosić od 5 do 10 lat dla prostszych zastosowań, natomiast dla bardziej zaawansowanych – ponad dekadę.

Tempo przechodzenia przez kolejne fazy cyklu zależy od wielu czynników. Kluczowe będą spadek cen sprzętu, jego miniaturyzacja, poprawa komfortu użytkowania i rozwój angażujących treści. Znaczenie ma również standaryzacja platform, udowodniony zwrot z inwestycji w środowiskach biznesowych oraz integracja z technologiami wspierającymi – takimi jak 5G i przyszłe 6G, które zapewnią niezbędną przepustowość i niskie opóźnienia dla bardziej złożonych doświadczeń immersyjnych.

Krajobraz technologiczny: platformy deweloperskie i sprzętowe

Rynek Spatial Computing rozwija się dynamicznie, a zrozumienie dostępnych urządzeń i narzędzi programistycznych staje się kluczowe dla firm IT planujących wejście w ten obszar. Ekosystem ten kształtowany jest zarówno przez ewolucję sprzętu, jak i przez rozwój oprogramowania.

Na rynku dostępna jest szeroka gama urządzeń AR/VR, zróżnicowanych pod względem jakości, funkcji i zastosowań. Meta Quest 3 to popularny headset oferujący zarówno VR, jak i rozwinięte funkcje Mixed Reality. Apple Vision Pro definiowany jest jako komputer przestrzenny, oferując najwyższą jakość obrazu i zaawansowane śledzenie ruchów w środowisku MR. HoloLens 2, rozwijany przez Microsoft, uznawany jest za lidera wśród urządzeń MR dla biznesu, dzięki integracji z rozwiązaniami Dynamics 365. Fińskie Varjo dostarcza sprzęt o ultrawysokiej rozdzielczości, przeznaczony do symulacji i projektowania przemysłowego, natomiast lżejsze okulary AR, takie jak XREAL Light czy Ray-Ban Meta, sprawdzają się w zastosowaniach terenowych, gdzie ważna jest świadomość otoczenia i mobilność.

Sprzęt zmierza w stronę większej lekkości, lepszej jakości wyświetlania, szerszego pola widzenia i dłuższego czasu pracy na baterii. Analitycy przewidują też stopniowe przejście od rozwiązań VR do bardziej uniwersalnych headsetów MR i ER, łączących wiele funkcji w jednym urządzeniu.

Wybór odpowiedniej platformy deweloperskiej znacząco wpływa na czas, koszt i efektywność tworzenia aplikacji immersyjnych. Unity cieszy się dużą popularnością dzięki wszechstronności i dostępowi do gotowych komponentów, co ułatwia budowanie aplikacji dla urządzeń mobilnych i prototypów. Unreal Engine wyróżnia się możliwością generowania grafiki fotorealistycznej i jest preferowany w symulacjach, architekturze i produkcji filmowej. Oba silniki oferują narzędzia przyjazne projektantom, także tym bez głębokiej wiedzy programistycznej.

Równolegle rozwijane są SDK powiązane z konkretnymi platformami. Apple visionOS oferuje pełną integrację z ekosystemem Apple, umożliwiając tworzenie zaawansowanych aplikacji przestrzennych z naciskiem na bezpieczeństwo i zarządzanie. Microsoft wspiera rozwój aplikacji dla HoloLens poprzez Mixed Reality Toolkit (MRTK), które ułatwia pracę z komponentami interfejsu i śledzeniem ruchu. Otwartym standardem rozwijanym przez Khronos Group pozostaje OpenXR, mający na celu ujednolicenie tworzenia aplikacji AR/VR niezależnie od platformy sprzętowej. Chociaż OpenXR ogranicza fragmentację, najbardziej innowacyjne funkcje nadal pojawiają się najpierw w natywnych SDK producentów, co sprawia, że pełna interoperacyjność pozostaje wyzwaniem.

Dla dostawców rozwiązań IT oznacza to konieczność podejmowania decyzji strategicznych – czy postawić na uniwersalność i kompatybilność, czy specjalizować się w konkretnych platformach, aby mieć dostęp do najbardziej zaawansowanych funkcji. Rywalizacja o deweloperów stała się centralnym elementem strategii takich firm jak Apple, Microsoft czy Meta, które inwestują w rozwój własnych SDK, dokumentacji i narzędzi, dążąc do kształtowania rynku i zwiększania wartości swoich ekosystemów. Kontrola nad środowiskiem deweloperskim to dziś kluczowy element przewagi technologicznej.

Strategia dla kanału IT: jak wykorzystać przewagę pioniera na rynku AR/VR

Spatial Computing, mimo wczesnego etapu rozwoju, otwiera przed partnerami IT realne możliwości zdobycia przewagi rynkowej. Kluczem jest nie sprzedaż sprzętu, lecz budowa kompetencji i kompleksowych rozwiązań, które z czasem mogą przekształcić wczesnych graczy w liderów, gdy technologia dojrzeje i stanie się powszechnie wdrażana.

Aby osiągnąć tę pozycję, firmy muszą inwestować w rozwój własnych laboratoriów i centrów kompetencyjnych. Takie miejsca pozwalają testować technologie, prowadzić prace badawczo-rozwojowe, szkolić zespoły i prezentować rozwiązania klientom w praktyce. Równolegle konieczny jest rozwój specjalistycznych kompetencji – od grafiki 3D, przez projektowanie przestrzennych interfejsów, po integrację z systemami przemysłowymi. Znajomość silników gier, jak Unity czy Unreal Engine, oraz umiejętność łączenia AR/VR z ERP, CRM, MES czy IoT stają się fundamentem tworzenia realnej wartości.

Partnerzy IT mogą odegrać kluczową rolę jako integratorzy, łącząc nowe technologie z istniejącą infrastrukturą klienta i budując dedykowane rozwiązania branżowe. Oferowanie usług doradczych i strategicznego wsparcia we wdrażaniu AR/VR – od oceny ROI po zarządzanie projektem – staje się równie ważne, jak sama realizacja techniczna. Dodatkową szansą, zwłaszcza dla operatorów i dostawców usług sieciowych, jest rodzący się internet przestrzenny, gdzie możliwa będzie monetyzacja kontekstowych danych poprzez otwarte API.

Wejście na ten rynek wiąże się jednak z wyzwaniami. Wysokie koszty początkowe, niepewność co do skali adopcji, brak wystarczającej edukacji klientów i deficyt wykwalifikowanych specjalistów to realne bariery. Dodatkowo, fragmentacja technologiczna i zróżnicowanie platform wymagają umiejętnego poruszania się w dynamicznym i niejednorodnym środowisku.

Sukces będzie wymagał przesunięcia roli partnera IT z dystrybutora w kierunku twórcy zintegrowanych rozwiązań. Wartość leży nie w samym sprzęcie, lecz w umiejętnym połączeniu technologii – od headsetów, przez oprogramowanie, po systemy backendowe i sztuczną inteligencję – w spójne środowisko biznesowe. Partnerzy, którzy opanują ten proces, mogą stać się centralnym ogniwem ekosystemu, tworząc własne rozwiązania branżowe i budując reputację zaufanych doradców.

Edukacja rynku stanie się przy tym nieodłączną częścią strategii. Wiele firm nadal postrzega AR/VR jako futurystyczną koncepcję, a nie dostępne narzędzie biznesowe. Partnerzy muszą więc aktywnie promować wiedzę – poprzez warsztaty, demonstracje, studia przypadku i doświadczenia immersyjne. Jak zauważono na konferencji AWE, to właśnie praktyczne prezentacje w VR – a nie slajdy – najlepiej przekonują decydentów. Inwestycja w laboratoria powinna służyć nie tylko rozwojowi kompetencji, ale też jako centrum edukacyjne, które przełamuje bariery i przyspiesza decyzje zakupowe.

Przyszłość Spatial Computing

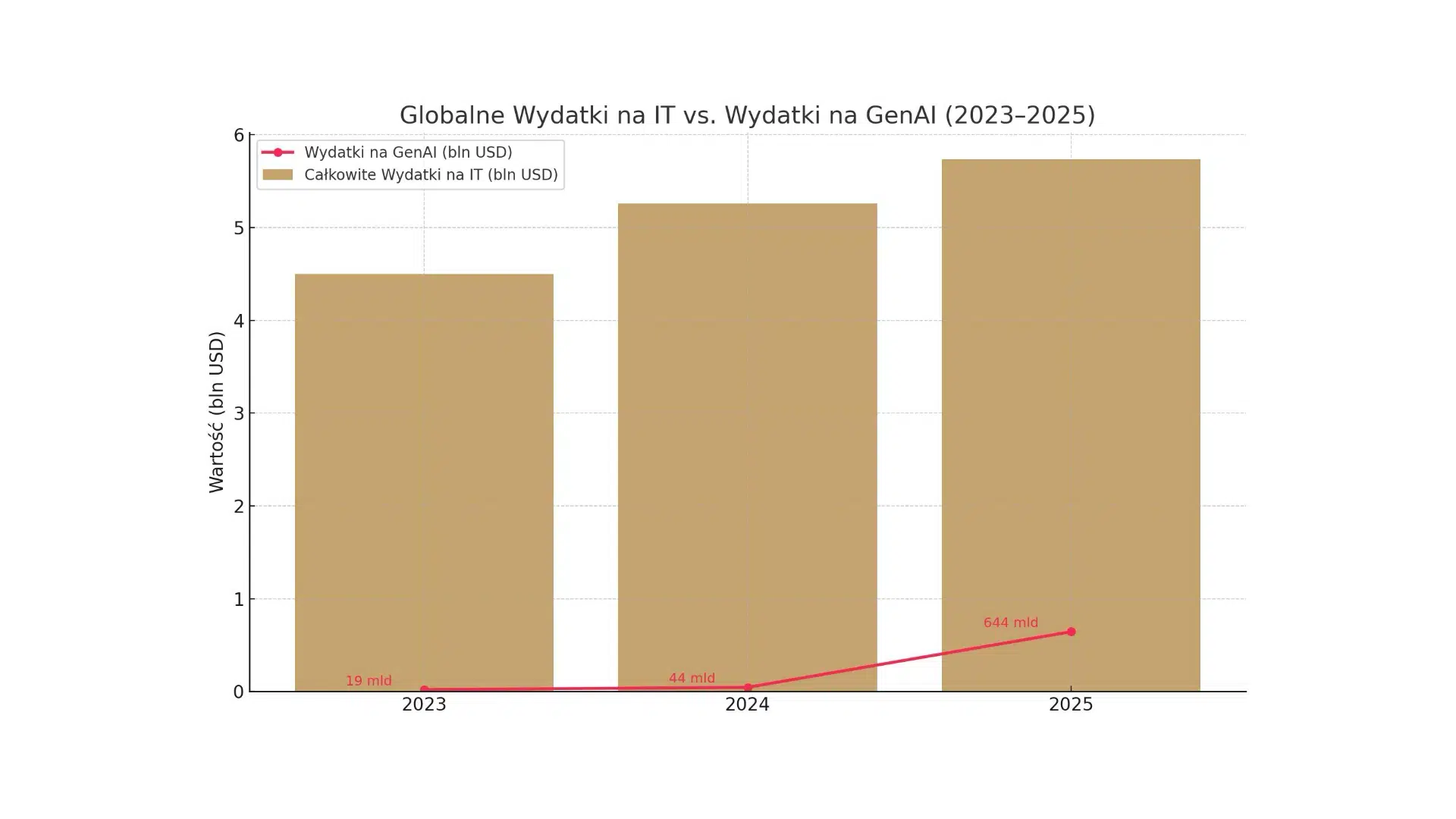

Spatial Computing ewoluuje dynamicznie, napędzany przez integrację nowych technologii i rosnące oczekiwania wobec cyfrowych, immersyjnych doświadczeń. Dla firm IT zrozumienie kierunków rozwoju jest kluczowe, by skutecznie poruszać się w tym zmieniającym się krajobrazie.

Coraz większą rolę w tym obszarze odgrywa sztuczna inteligencja, która wspiera tworzenie spersonalizowanych i kontekstowych doświadczeń. Generatywne AI znacząco przyspiesza produkcję treści, automatyzuje procesy i poprawia wydajność urządzeń. Równolegle rozwija się WebXR, umożliwiając dostęp do treści AR/VR bezpośrednio z poziomu przeglądarki, co obniża bariery wejścia.

Postęp w optyce, wyświetlaczach i interfejsach użytkownika pozwala tworzyć lżejsze, bardziej komfortowe i realistyczne urządzenia. Technologie takie jak soczewki typu „pancake”, falowody czy zaawansowana haptyka zwiększają immersję i wygodę. Przewiduje się, że sam rynek optyki XR osiągnie wartość 5,1 mld USD do 2034 roku.

Kolejnym etapem rozwoju będzie połączenie Spatial Computing z IoT i cyfrowymi bliźniakami, co umożliwi tworzenie dynamicznych, interaktywnych reprezentacji rzeczywistego świata. Wspierać to będą technologie sieciowe nowej generacji – wdrożenia 5G i przyszłe 6G, które zapewnią wymaganą przepustowość i niskie opóźnienia. Branża równocześnie będzie dążyć do większej interoperacyjności, czemu sprzyja rozwój otwartych standardów, takich jak OpenXR.

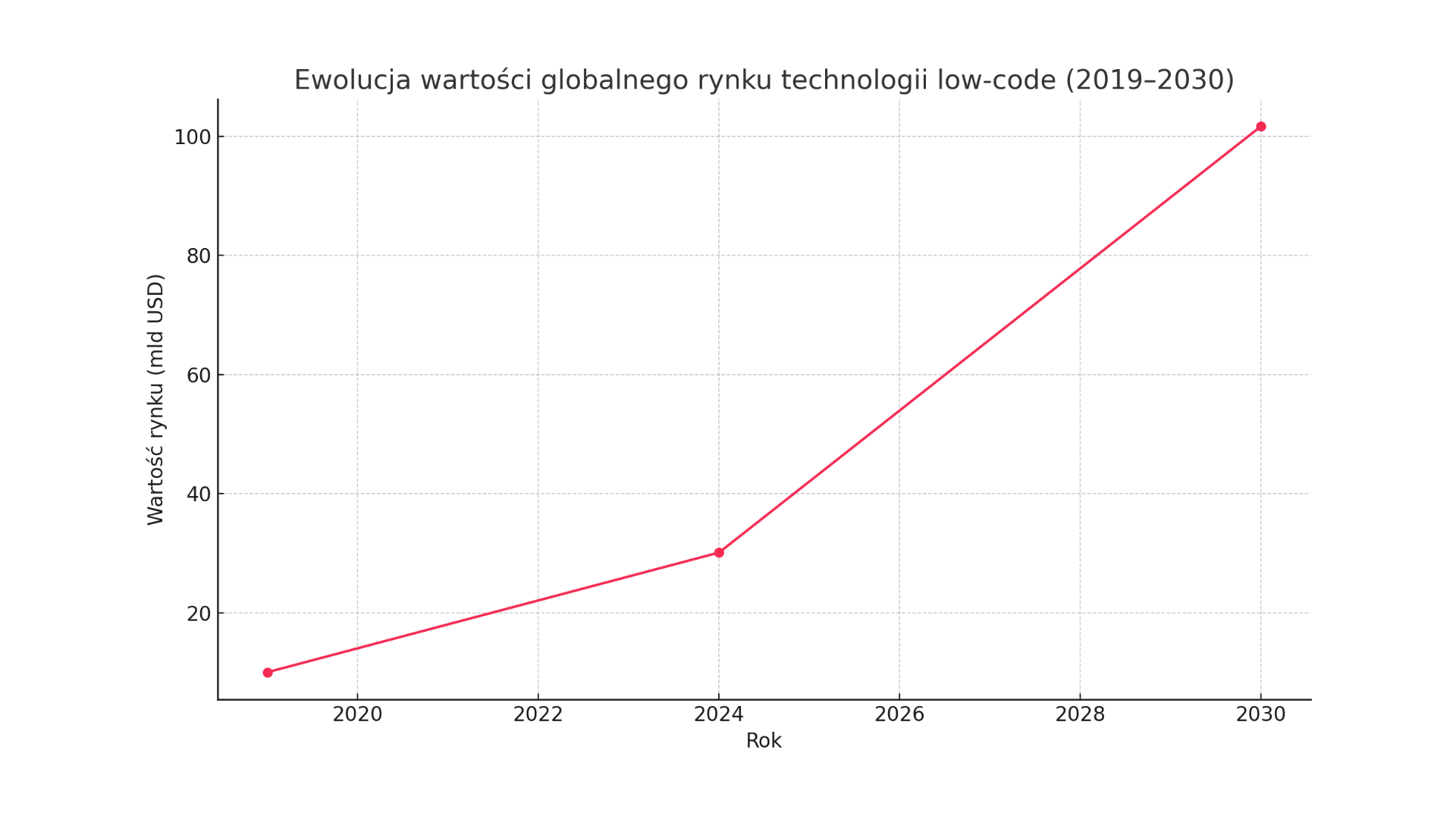

Narzędzia no-code, rozwiązania low-code i AI umożliwią szerszemu gronu użytkowników tworzenie własnych aplikacji XR. Ta demokratyzacja treści przypomina rewolucję WWW – prowadzi do eksplozji kreatywności i innowacji, zwłaszcza w biznesie i edukacji.

W dłuższej perspektywie Spatial Computing może stać się podstawowym interfejsem w pracy, nauce, komunikacji i rozrywce. Wraz z jego upowszechnieniem wzrośnie znaczenie etyki, prywatności i odpowiedzialności technologicznej. Firmy, które zadbają o zaufanie i dobrostan użytkowników, zyskają przewagę konkurencyjną.

Aby wykorzystać potencjał tego rynku, partnerzy IT powinni działać strategicznie. Najlepiej zacząć od pilotażowych projektów w wyspecjalizowanych niszach. Pozwoli to budować kompetencje, ograniczając ryzyko. Kluczowe będą inwestycje w wiedzę, zwłaszcza w obszarach powiązanych z konkretnymi branżami i technologiami immersyjnymi.

Równolegle należy rozwijać relacje z producentami sprzętu, deweloperami oprogramowania i innymi partnerami technologicznymi. Tworzenie silnego ekosystemu ułatwia dostarczanie kompleksowych rozwiązań i przyspiesza wdrożenia.

Edukacja rynku pozostaje istotnym elementem strategii. Warto organizować warsztaty, tworzyć studia przypadków i pokazy na żywo, które pomogą klientom dostrzec realną wartość biznesową tych rozwiązań. Technologie AR/VR powinny rozwiązywać konkretne problemy – poprawiać efektywność, zwiększać bezpieczeństwo lub redukować koszty – a nie być celem samym w sobie.

Utrzymanie konkurencyjności wymaga stałej obserwacji trendów i gotowości do adaptacji. Rynek rozwija się szybko, a jego krajobraz technologiczny nieustannie się zmienia. Wreszcie, odpowiedzialne podejście do projektowania i wdrażania rozwiązań, z uwzględnieniem aspektów etycznych i ochrony danych, będzie coraz ważniejsze dla klientów i regulatorów.

Spatial Computing to młody, ale obiecujący obszar, który oferuje firmom IT unikalną szansę na ugruntowanie pozycji lidera. Ci, którzy już dziś inwestują w wiedzę, budują specjalizacje i edukują rynek, mogą zyskać przewagę trudną do odrobienia w przyszłości.