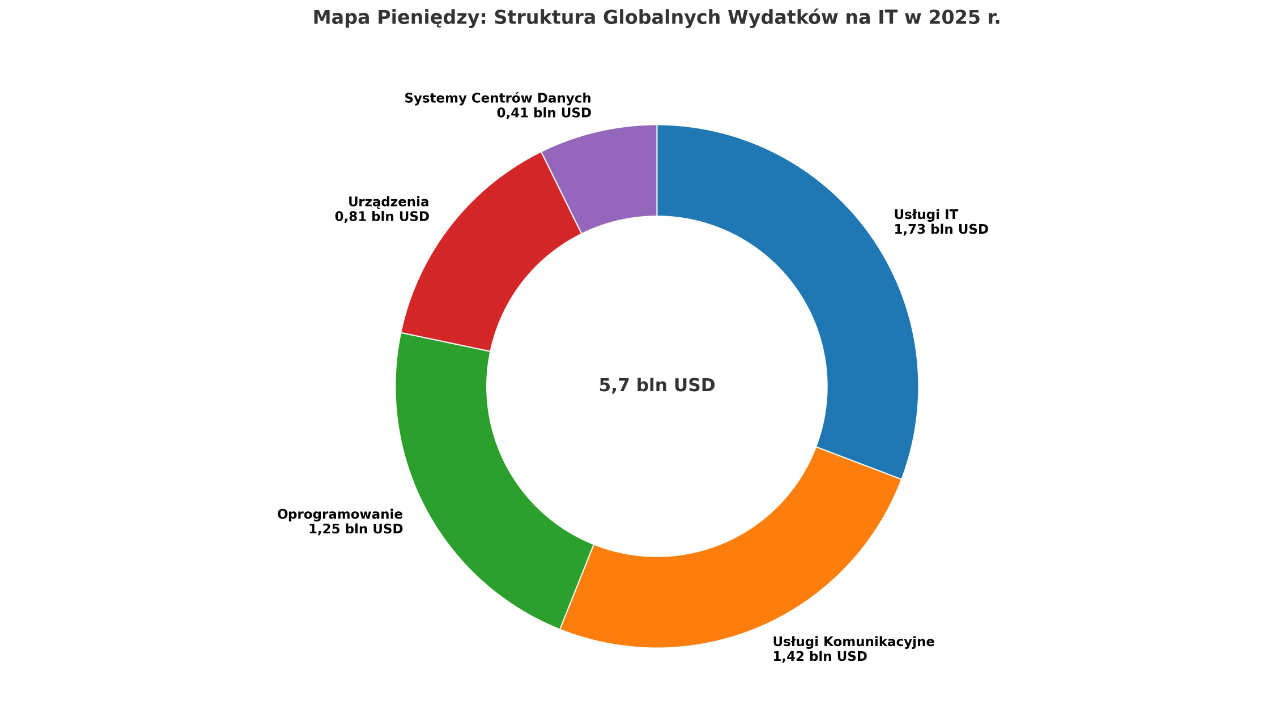

Globalny rynek technologii informatycznych stoi u progu bezprecedensowego boomu. Wiodące firmy analityczne, takie jak Gartner, prognozują, że w 2025 roku światowe wydatki na IT osiągną astronomiczną kwotę 5,7 biliona dolarów, co oznacza imponujący wzrost o ponad 9% w stosunku do roku 2024.

Inne prognozy, choć różniące się w szczegółach, są zgodne co do jednego: jesteśmy świadkami historycznego napływu kapitału do sektora technologicznego. Jednakże, zatrzymanie się na tej nagłówkowej liczbie byłoby błędem. Sama kwota, choć robi wrażenie, jest jedynie fasadą dla znacznie głębszych i bardziej fundamentalnych przemian.

Historia, którą opowiadają te pieniądze, nie jest o prostym wzroście, ale o strategicznej i gwałtownej reorientacji globalnego biznesu.

Prawdziwa opowieść kryje się w asymetrii tego wzrostu. Podczas gdy cały rynek rośnie o około 9%, niektóre segmenty eksplodują. Wydatki na systemy centrów danych mają wzrosnąć o zdumiewające 23,2%, a na oprogramowanie o 14,2%.

Z drugiej strony, usługi komunikacyjne odnotują znacznie skromniejszy wzrost, zaledwie o 3,8% . Ta dysproporcja nie jest przypadkowa. Jest to dowód na świadomą, strategiczną decyzję biznesową, którą można nazwać „Wielką Realokacją” kapitału.

Firmy nie tylko wydają więcej; one aktywnie przesuwają środki z jednych obszarów do drugich, de-priorytetyzując utrzymanie status quo na rzecz agresywnych inwestycji w inteligencję i usługi.

Budżety na IT w 2025 roku nie są po prostu większe – są one mądrzejsze, bardziej skoncentrowane i bezwzględnie ukierunkowane na przyszłość, w której oprogramowanie i sztuczna inteligencja nie są już narzędziami wsparcia, ale samym sercem tworzenia wartości.

Gorączka złota AI: od wielkich eksperymentów do pragmatycznej integracji

Niekwestionowanym motorem napędowym wydatków w 2025 roku jest generatywna sztuczna inteligencja (GenAI). To ona jest epicentrum „Wielkiej Realokacji”, przyciągając kapitał w skali, która redefiniuje priorytety inwestycyjne na całym świecie.

Fizycznym przejawem tej gorączki złota jest monumentalna rozbudowa infrastruktury. Prognozy wskazują, że wydatki na serwery zoptymalizowane pod kątem AI osiągną w 2025 roku 202 miliardy dolarów, podwajając tym samym wydatki na tradycyjne serwery.

Cały segment systemów dla centrów danych ma wzrosnąć o wspomniane 23,2%, co jest bezpośrednim skutkiem zapotrzebowania na moc obliczeniową niezbędną do trenowania i wdrażania zaawansowanych modeli AI .

Na czele tego boomu stoją hiperskalerzy – giganci chmurowi tacy jak Amazon Web Services, Microsoft Azure i Google Cloud. Te firmy, wraz z dostawcami usług IT, będą odpowiadać za ponad 70% wszystkich wydatków na IT w 2025 roku. Ich rola ewoluuje.

Nie są już tylko dostawcami infrastruktury jako usługi (IaaS); stają się fundamentem nowego, oligopolistycznego rynku modeli AI.

Jednocześnie rynek dojrzewa w niezwykle szybkim tempie. Faza nieograniczonych, często chaotycznych eksperymentów z AI wewnątrz przedsiębiorstw dobiega końca. Wiele firm zderzyło się ze ścianą: koszty kapitałowe i operacyjne tworzenia własnych modeli okazały się znacznie wyższe niż oczekiwano, luki kompetencyjne w zespołach były zbyt duże, a zwrot z inwestycji (ROI) z programów pilotażowych – rozczarowujący.

W rezultacie następuje kluczowa zmiana w strategii: przejście od kosztownego modelu „buduj” do pragmatycznego modelu „kupuj”. Dyrektorzy IT nie tworzą już narzędzi GenAI od zera; zamiast tego kupują gotowe funkcjonalności, które dostawcy oprogramowania wbudowują w istniejące platformy.

Rynek wchodzi w fazę, którą Gartner określa jako „dno rozczarowania” (trough of disillusionment) . Paradoksalnie, nie oznacza to spadku wydatków, a jedynie spadek nierealistycznych oczekiwań.

Firmy odchodzą od pogoni za rewolucyjnymi przełomami na rzecz praktycznych zastosowań AI, które zwiększają produktywność pracowników, automatyzują procesy i dają realną przewagę konkurencyjną.

Ekonomia definiowana oprogramowaniem: jak Twój samochód wyjaśnia przyszłość biznesu

Spektakularny wzrost wydatków na oprogramowanie (+14,2%) i usługi IT (+9%) to najsilniejszy sygnał, że jesteśmy świadkami narodzin nowego paradygmatu ekonomicznego . Aby zrozumieć jego istotę, nie trzeba szukać daleko – wystarczy spojrzeć na transformację, jaka dokonuje się w przemyśle motoryzacyjnym.

Model „Software-Defined Vehicle” (SDV), czyli pojazdu definiowanego przez oprogramowanie, jest doskonałym, namacalnym studium przypadku, które ilustruje, jak produkty fizyczne przekształcają się w platformy do świadczenia wysokomarżowych, cyklicznych usług cyfrowych.

Rewolucja SDV polega na fundamentalnym oddzieleniu warstwy sprzętowej od warstwy oprogramowania w pojeździe. Dzięki temu producenci samochodów mogą wdrażać nowe funkcje i ulepszenia w sposób ciągły, za pośrednictwem aktualizacji bezprzewodowych (Over-The-Air, OTA), bez konieczności fizycznej ingerencji w samochód.

To całkowicie zmienia naturę produktu. Samochód przestaje być aktywem, którego wartość maleje z czasem, a staje się dynamiczną platformą, zdolną do generowania przychodów przez cały cykl swojego życia.

Producenci już teraz eksperymentują z nowymi modelami biznesowymi: BMW testuje subskrypcje na podgrzewane fotele, a Volkswagen planuje oferować funkcje autonomicznej jazdy w modelu „pay-as-you-go”.

Ten trend nie ogranicza się jednak do motoryzacji. Jest to wiodący wskaźnik uniwersalnej transformacji modeli biznesowych. Cały rynek oprogramowania zmierza w kierunku modeli subskrypcyjnych i Software-as-a-Service (SaaS).

Oprogramowanie jest najszybciej rosnącym sektorem technologicznym i przewiduje się, że do 2029 roku będzie odpowiadać za 60% globalnego wzrostu wydatków na technologię . To potwierdza, że model SDV jest zwiastunem szerszej zmiany, w której granice między produktem a usługą zacierają się.

W tej nowej ekonomii dział IT, tradycyjnie postrzegany jako centrum kosztów, awansuje do roli centralnego kreatora wartości.

Dyrektor ds. informatyki (CIO) i dyrektor ds. technologii (CTO) stają się kluczowymi postaciami w strategii produktowej, a ich wiedza jest niezbędna do tworzenia podstawowego produktu firmy.

Profesjonalista 2025: kształtowanie nowoczesnego zestawu umiejętności IT

Transformacja technologiczna i biznesowa ma głęboki wpływ na rynek pracy, kształtując na nowo zapotrzebowanie na umiejętności. Aby odnieść sukces w tym dynamicznym środowisku, profesjonaliści IT muszą rozwijać hybrydowy zestaw umiejętności, łączący głęboką wiedzę techniczną z trwałymi zdolnościami „miękkimi”.

Analiza rynku pracy na rok 2025 nie pozostawia wątpliwości: najbardziej poszukiwane zawody są niemal w całości związane z technologią. Na szczycie list znajdują się specjaliści AI i uczenia maszynowego, analitycy danych oraz analitycy ds. cyberbezpieczeństwa.

Prognozy wskazują, że samo zapotrzebowanie na specjalistów od cyberbezpieczeństwa wzrośnie o 33% w latach 2023-2033. Wśród kluczowych umiejętności technicznych, których poszukują pracodawcy, dominują: sztuczna inteligencja, analiza danych, chmura obliczeniowa oraz programowanie, ze szczególnym uwzględnieniem języka Python.

Jednak sama biegłość techniczna przestaje być wystarczająca. W miarę jak AI przejmuje coraz więcej zadań analitycznych, rośnie wartość umiejętności, których maszyny nie są w stanie łatwo zreplikować.

Pracodawcy coraz częściej priorytetyzują zdolności takie jak analityczne i kreatywne myślenie, kompleksowe rozwiązywanie problemów, inteligencja emocjonalna i zdolność adaptacji.

Sztuczna inteligencja z pewnością doprowadzi do przemieszczeń na rynku pracy. Szacuje się, że AI może zautomatyzować nawet jedną czwartą zadań zawodowych w USA i Europie, szczególnie tych rutynowych, jak podstawowe programowanie czy obsługa klienta.

Jednak dominująca narracja ekspertów nie skupia się na masowym bezrobociu, lecz na transformacji pracy. AI nie tyle eliminuje zawody, co je redefiniuje, tworząc nowe, często bardziej strategiczne role. W tym nowym krajobrazie zawodowym „okres półtrwania umiejętności technologicznych” wynosi obecnie mniej niż pięć lat .

Oznacza to, że najważniejszą meta-umiejętnością staje się zwinność w ciągłym uczeniu się (continuous learning agility). Przyszłość pracy nie polega na rywalizacji między człowiekiem a AI, ale na ich symbiozie.

Najbardziej efektywni profesjonaliści to ci, którzy opanują sztukę wykorzystywania AI jako partnera do współpracy w celu wzmocnienia własnej kreatywności i produktywności.

Nawigacja w kolejnej fali transformacji IT

Analiza globalnych trendów w wydatkach na IT na rok 2025 jasno pokazuje, że jesteśmy świadkami głębokich, strukturalnych zmian. Obserwujemy przejście od wydawania więcej do wydawania mądrzej, a rynek AI dojrzewa, przechodząc od budowania do integrowania gotowych rozwiązań.

Jednocześnie modele biznesowe ewoluują od sprzedaży produktów do sprzedaży usług, co wymusza transformację na rynku pracy – od statycznych ról do dynamicznych umiejętności.