Rok 2025 nie jest kolejnym rokiem ewolucji na rynku laptopów biznesowych; to rok rewolucyjnego wstrząsu. Zbieg trzech potężnych sił – masowego wdrożenia sztucznej inteligencji na poziomie urządzenia (on-device AI), nieuchronnego końca wsparcia technicznego dla systemu Windows 10 oraz trwałego ugruntowania się hybrydowych modeli pracy – tworzy idealną burzę, która na nowo definiuje, czym jest i co potrafi komputer dla profesjonalisty. To fundamentalna zmiana paradygmatu, przesuwająca środek ciężkości z surowej mocy obliczeniowej na inteligentne, zintegrowane i bezpieczne ekosystemy.

Transformacja ta opiera się na trzech filarach. Pierwszym jest rewolucja AI, która przenosi ciężar obliczeń z chmury bezpośrednio na urządzenie. Dzięki dedykowanym jednostkom przetwarzania neuronowego (NPU), laptopy zyskują bezprecedensową zdolność do personalizacji, automatyzacji zadań i zapewniania produktywności w czasie rzeczywistym, a wszystko to przy zachowaniu najwyższych standardów prywatności danych. Drugim filarem jest potężny, nieunikniony katalizator rynkowy: termin 14 października 2025 roku, oznaczający koniec wsparcia dla systemu Windows 10. Zmusza on przedsiębiorstwa na całym świecie do masowej modernizacji flot komputerowych, idealnie zbiegając się w czasie z premierą nowej generacji sprzętu. Trzecim filarem jest nowy paradygmat pracy. Model hybrydowy stał się normą, wymuszając na producentach tworzenie urządzeń, które są nie tylko wydajne, ale także ultrabezpieczne, wysoce mobilne i zoptymalizowane pod kątem nieustannej współpracy wideo.

W tym nowym krajobrazie przewaga konkurencyjna nie jest już definiowana wyłącznie przez pryzmat mocy procesora, mierzonej w gigahercach, czy liczby rdzeni. Zwycięzcami w 2025 roku zostaną ci producenci, którzy zaoferują najbardziej spójny, inteligentny i bezpieczny ekosystem, łączący sprzęt, oprogramowanie i usługi w sposób, który realnie odpowiada na wyzwania zdecentralizowanego, napędzanego przez AI środowiska pracy. Niniejsza analiza zagłębia się w dane rynkowe, strategie technologiczne i pozycjonowanie kluczowych graczy, aby zidentyfikować trendy, które zdefiniują przyszłość laptopów biznesowych.

Krajobraz rynku w 2025 roku – odbicie w cieniu niepewności

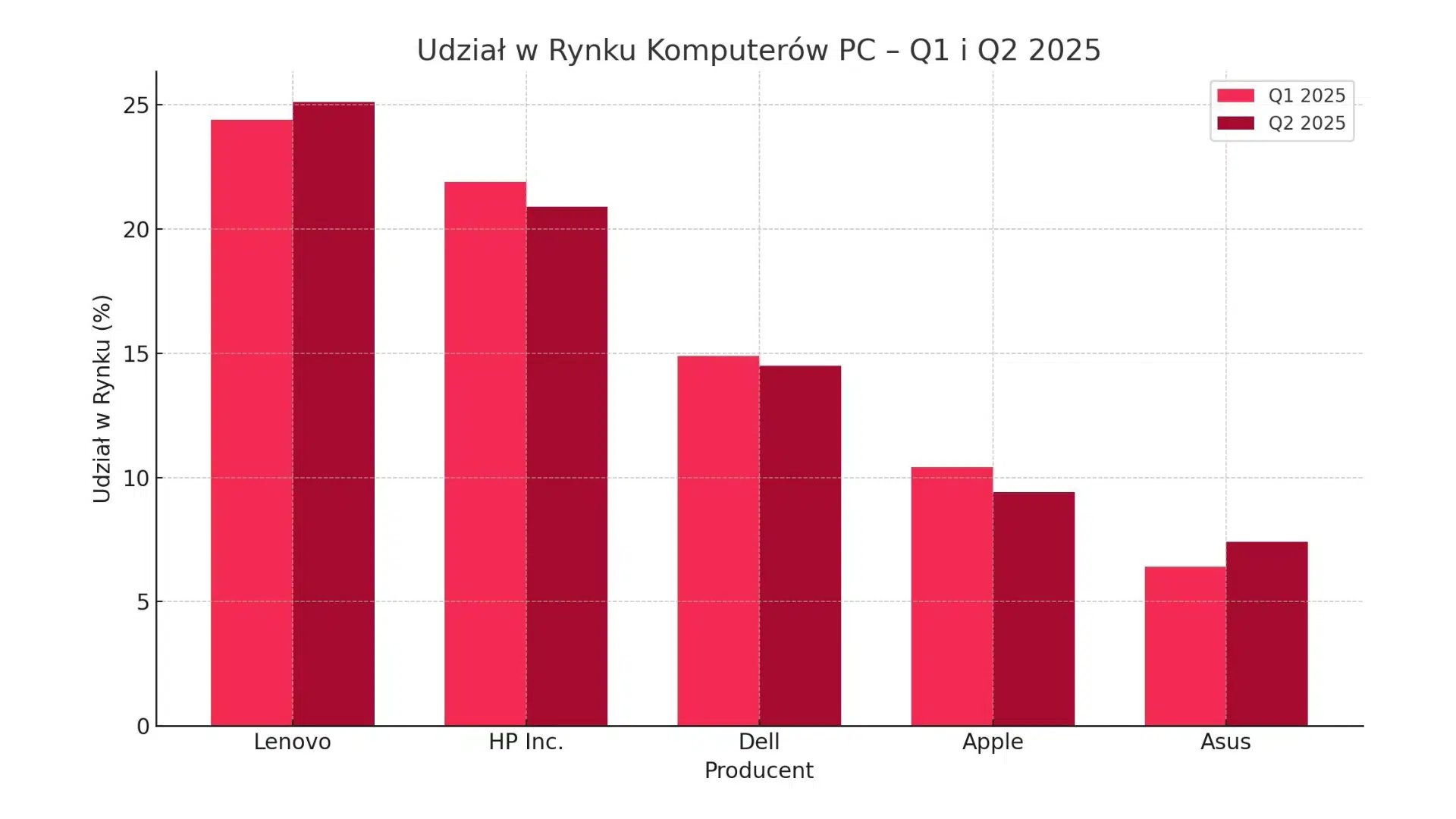

Pierwsza połowa 2025 roku przyniosła rynkowi PC długo oczekiwane ożywienie. Po okresie stagnacji, globalne dostawy komputerów osobistych odnotowały solidne wzrosty, rosnąc o 9% rok do roku w pierwszym kwartale i o 7% w drugim kwartale. Dane te, na pierwszy rzut oka, sygnalizują powrót zdrowego popytu i początek nowego cyklu zakupowego.

Analiza czołowych producentów ukazuje zróżnicowaną dynamikę. Lenovo utrzymało pozycję niekwestionowanego lidera, notując imponujące wzrosty dostaw na poziomie 11% w Q1 i 15.2% w Q2 2025, co świadczy o skuteczności strategii produktowej i operacyjnej. HP Inc. stabilnie zajmuje drugie miejsce, utrzymując solidny udział w rynku. Prawdziwą gwiazdą pierwszej połowy roku okazało się jednak Apple, które zademonstrowało spektakularną dynamikę wzrostu, z dostawami rosnącymi o 22% w Q1 i 21.3% w Q2. Takie wyniki wskazują na rosnącą akceptację platformy Mac w środowiskach komercyjnych i profesjonalnych, które tradycyjnie były bastionem systemów Windows. Z kolei Dell, trzeci największy gracz, zanotował w drugim kwartale spadek dostaw o 3.0%, co może sygnalizować pewne wyzwania w dostosowaniu portfolio do bieżącego cyklu produktowego lub silniejszą konkurencję ze strony rywali.

Chociaż liczby wskazują na ożywienie, głębsza analiza ujawnia bardziej złożony obraz. Pozornie silne dane o wzroście w pierwszej połowie 2025 roku nie odzwierciedlają w pełni organicznego popytu ze strony użytkowników końcowych. W dużej mierze są one efektem strategicznego gromadzenia zapasów przez producentów i kanały dystrybucyjne, co stanowi odpowiedź na rosnącą niepewność geopolityczną i groźbę wprowadzenia nowych ceł handlowych, zwłaszcza w Stanach Zjednoczonych.[4, 5] Producenci celowo przyspieszali zamówienia, aby wyprzedzić potencjalne podwyżki ceł na elektronikę, co oznacza, że wysokie liczby dostaw mogą znacząco wyprzedzać faktyczny popyt końcowy. Tworzy to ryzyko powstania nadmiernych zapasów w kanale dystrybucyjnym, co może prowadzić do presji cenowej i potencjalnej korekty rynkowej w drugiej połowie roku.

Polski rynek IT odzwierciedla globalne trendy ożywienia, ale z własną, unikalną specyfiką. W pierwszym kwartale 2025 roku sprzedaż komputerów w polskiej dystrybucji wzrosła o imponujące 18.1% rok do roku, jednak siłą napędową tego wzrostu był przede wszystkim segment konsumencki. Sektor biznesowy wykazywał większą powściągliwość, co ujawnia istnienie „luki dowodu wartości”. Na polskim rynku obserwujemy wyraźną rozbieżność między globalnym szumem marketingowym wokół komputerów AI PC a faktycznymi decyzjami zakupowymi firm. Podczas gdy globalne prognozy przewidują, że laptopy AI będą stanowić blisko 60% rynku już w 2025 roku, dane z polskiego rynku za pierwszy kwartał pokazują, że sprzedaż najnowszych chipów zoptymalizowanych pod kątem AI była „niższa niż oczekiwano”. Klienci biznesowi chętniej wybierali sprawdzone i często tańsze procesory starszych generacji.

Rewolucja AI PC – narodziny nowej kategorii urządzeń

Rok 2025 to moment, w którym pojęcie „AI PC” przechodzi z fazy marketingowego hasła do realnej, zdefiniowanej kategorii produktów. De facto rynkowym benchmarkiem, który zdefiniował, czym jest nowoczesny komputer AI, stał się standard Microsoft Copilot+ PC. To nowa klasa urządzeń z systemem Windows, zaprojektowana od podstaw z myślą o lokalnym przetwarzaniu zadań związanych ze sztuczną inteligencją. Aby laptop mógł nosić to oznaczenie, musi spełniać rygorystyczne wymagania techniczne: wydajność jednostki przetwarzania neuronowego (NPU) na poziomie co najmniej 40 bilionów operacji na sekundę (TOPS), minimum 16 GB pamięci RAM oraz szybki dysk SSD o pojemności co najmniej 256 GB.

Rola NPU jest fundamentalna. W przeciwieństwie do tradycyjnych architektur, gdzie zadania AI obciążały główny procesor (CPU) lub kartę graficzną (GPU), NPU jest zaprojektowane specjalnie do efektywnego wykonywania tych obliczeń przy znacznie niższym zużyciu energii. Przekłada się to na dłuższy czas pracy na baterii i cichszą pracę urządzenia – kluczowe atrybuty w mobilnym środowisku biznesowym.

Praktyczne zastosowania w biznesie stają się coraz bardziej namacalne. Wideokonferencje stają się inteligentniejsze dzięki funkcjom takim jak tłumienie hałasu w czasie rzeczywistym czy automatyczne kadrowanie mówcy. Aplikacje biurowe, takie jak Microsoft Teams czy Outlook, oferują automatyczne transkrypcje i podsumowania spotkań oraz wątków e-mailowych, uwalniając czas pracowników. W programie Excel możliwe staje się generowanie skomplikowanych raportów na podstawie prostych poleceń w języku naturalnym.

Nagły wzrost znaczenia AI PC jest napędzany przez dwa potężne, zbiegające się w czasie zjawiska. Po pierwsze, koniec wsparcia dla Windows 10 14 października 2025 roku działa jako potężny komercyjny katalizator, zmuszając firmy do modernizacji flot sprzętowych. W tym momencie komputery Copilot+ PC są pozycjonowane jako logiczny, standardowy wybór przy każdej wymianie sprzętu. Po drugie, obserwujemy fundamentalną zmianę architektoniczną: re-decentralizację obliczeń. Przeniesienie przetwarzania AI z chmury na urządzenie końcowe jest odpowiedzią na rosnące obawy biznesu dotyczące prywatności, szybkości, niezawodności i kontroli kosztów związanych z modelem chmurowym.

Wojna o krzem – kto napędza inteligencję na pokładzie?

U podstaw rewolucji AI PC leży nowa generacja procesorów, a rywalizacja między ich twórcami stała się kluczowym polem bitwy. W erze AI PC kluczowym wskaźnikiem wydajności stała się moc NPU, wyrażana w TOPS (Trillions of Operations Per Second).

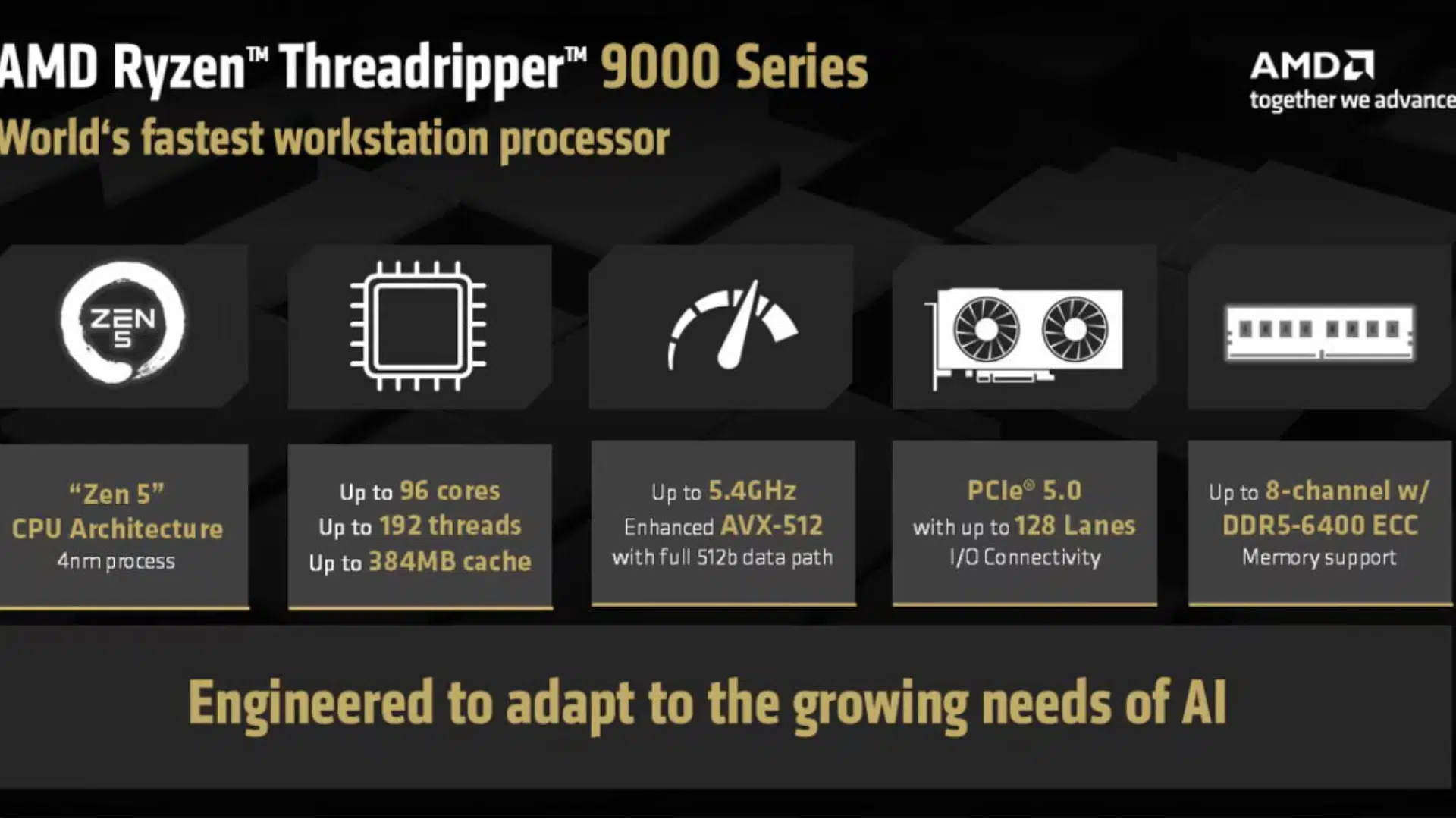

Każdy z czterech głównych graczy na rynku krzemu przyjął odmienną strategię. Intel, z nową generacją procesorów Core Ultra (’Lunar Lake’) dostarczających 47 TOPS, skupia się na obronie swojej dominującej pozycji w segmencie komercyjnym, wykorzystując dojrzały ekosystem x86. AMD, z serią Ryzen AI 300 (’Strix Point’) oferującą 50 TOPS, pozycjonuje się jako agresywny pretendent, celując w koronę lidera wydajności, także w zintegrowanej grafice. Qualcomm, ze swoim Snapdragonem X Elite (45 TOPS), dokonuje przełomu, przenosząc wysoce efektywną energetycznie architekturę ARM do świata Windows i obiecując rewolucyjny czas pracy na baterii. Wreszcie Apple, z układem M4 (38 TOPS), kontynuuje strategię pełnej pionowej integracji, koncentrując się na optymalizacji synergii między sprzętem a oprogramowaniem, a nie na samym wyścigu na najwyższą nominalną wartość TOPS.

Za fasadą liczb kryją się głębsze wymiary rywalizacji. Prawdziwa bitwa toczy się o stworzenie najbardziej wydajnej platformy deweloperskiej, ponieważ to oprogramowanie, a nie sprzęt, ostatecznie dostarczy wartość użytkownikowi. Wejście Qualcomma na rynek Windows z architekturą ARM tworzy też fundamentalny dylemat dla decydentów IT: czy postawić na gwarantowaną kompatybilność platformy x86, czy zaryzykować potencjalne problemy z emulacją starszych aplikacji na rzecz znacznie dłuższego czasu pracy na baterii platformy ARM.

Bitwa o ekosystem, nie tylko o sprzęt

W obliczu tak fundamentalnych zmian, najwięksi producenci laptopów walczą o stworzenie spójnego ekosystemu.

Lenovo prowadzi dwutorową strategię. „AI Engine+” w serii Legion jest skierowany do graczy i optymalizuje wydajność w czasie rzeczywistym. Z kolei „AI Now” w serii ThinkPad to osobisty asystent dla profesjonalistów, działający lokalnie na urządzeniu i kładący nacisk na prywatność. Ta strategia jest wspierana przez solidne wyniki finansowe działu Intelligent Devices Group (IDG), który odnotował silny, dwucyfrowy wzrost przychodów.

HP koncentruje się na zintegrowanej platformie „HP AI Companion”, która ma tworzyć „inteligentne przepływy pracy” i personalizować doświadczenie użytkownika, z silnym naciskiem na bezpieczeństwo i przetwarzanie na urządzeniu. Firma przyjęła elastyczne podejście, oferując w swoich laptopach AI PC procesory od Intela, AMD i Qualcomma, a kluczowym elementem oferty jest pakiet zabezpieczeń HP Wolf Security. Sukces tej strategii potwierdza 9% wzrost przychodów w segmencie komercyjnym w drugim kwartale roku fiskalnego 2025.

Dell podchodzi do rewolucji AI w sposób bardziej ewolucyjny, stopniowo integrując inteligentne funkcje w swoich sprawdzonych liniach biznesowych, takich jak Latitude i Precision. Firma koncentruje się na praktycznych korzyściach: optymalizacji wydajności, wzmocnieniu bezpieczeństwa i ulepszeniu interakcji z użytkownikiem. Ta konserwatywna strategia, odzwierciedlona w płaskich przychodach w segmencie komercyjnym w Q2 2025, wydaje się mieć na celu przede wszystkim utrzymanie zaufania obecnych, dużych klientów korporacyjnych.

Apple opiera swoją strategię na głębokiej integracji ekosystemu i bezkompromisowej prywatności. Pakiet „Apple Intelligence” jest wpleciony w rdzeń systemów operacyjnych, a większość operacji odbywa się lokalnie na urządzeniu. Firma koncentruje się na płynności i realnej użyteczności funkcji AI, które czerpią siłę ze świadomości osobistego kontekstu użytkownika. Imponujące, dwucyfrowe wzrosty dostaw komputerów Mac w pierwszej połowie 2025 roku są dowodem na to, że ta strategia rezonuje z rynkiem.

Rok 2025 stanowi punkt zwrotny, który wymaga od decydentów IT ponownego przemyślenia strategii zakupowych. AI staje się standardem, rynek platform ulega fragmentacji (x86 vs. ARM), a bezpieczeństwo staje się integralną częścią sprzętu.

Wybór odpowiedniego laptopa biznesowego wymaga nowego, holistycznego podejścia. Tradycyjny model zakupu, oparty głównie na specyfikacji technicznej, jest już niewystarczający. Decydenci IT muszą myśleć jak stratedzy, opierając proces decyzyjny na trójwymiarowej macierzy, która uwzględnia specyficzne potrzeby organizacji: oś wydajności (w tym NPU i efektywność energetyczna), oś ekosystemu (kompromis między kompatybilnością x86 a wydajnością baterii ARM) oraz oś bezpieczeństwa (głębokość integracji rozwiązań sprzętowych).

Tradycyjna metryka całkowitego kosztu posiadania (TCO) również musi zostać zredefiniowana. Nowe TCO musi uwzględniać zwrot z inwestycji (ROI) wynikający ze wzrostu produktywności pracowników dzięki funkcjom AI oraz wartość unikania ryzyka, jaką daje przetwarzanie danych na urządzeniu.

Patrząc w przyszłość, można spodziewać się dalszego pogłębienia obecnych trendów. Sztuczna inteligencja stanie się jeszcze bardziej spersonalizowana, a w procesie decyzyjnym coraz większą rolę będzie odgrywał zrównoważony rozwój.