Sztuczna inteligencja (AI) rewolucjonizuje globalną gospodarkę, stając się kluczowym czynnikiem przewagi konkurencyjnej dla przedsiębiorstw. Tempo jej rozwoju jest bezprecedensowe, przewyższając nawet dynamikę popularyzacji internetu. Firmy, które proaktywnie wdrażają spójne strategie AI, zyskują przewagę rynkową, podczas gdy te, które tego nie robią, ryzykują pozostanie w tyle. Polska, w kontekście globalnego wyścigu technologicznego, wykazuje imponujące przyspieszenie we wdrażaniu rozwiązań opartych na sztucznej inteligencji. Według raportu Strand Partners, przygotowanego na zlecenie Amazon Web Services (AWS), już 34% polskich przedsiębiorstw zastosowało technologie AI, a średnio co dwie minuty jedna polska firma wdraża nowe rozwiązania z tego obszaru.

Adopcja AI w polskich firmach rozwija się dynamicznie. Dane Głównego Urzędu Statystycznego (GUS) oraz Europejskiego Funduszu Leasingowego (EFL) wskazują na wzrost odsetka firm korzystających z AI z 3,7% w 2023 roku do 5,9% w 2024 roku. W przypadku dużych przedsiębiorstw wskaźnik ten jest jeszcze wyższy – co dziesiąta organizacja już wykorzystuje AI. Badanie przeprowadzone przez EY pod koniec 2024 roku, obejmujące ponad 500 firm, ujawnia wysoką gotowość do dalszych wdrożeń AI (89% firm, wzrost z 78%) oraz priorytetyzację inwestycji w tę technologię (59%, wzrost z 53%). Ponad połowa ankietowanych firm planuje zwiększyć wydatki na AI w ciągu najbliższych 18 miesięcy.

Korzyści płynące z wdrożenia AI są mierzalne i stanowią silną motywację dla dalszych inwestycji. Aż 78% firm, które wdrożyły narzędzia sztucznej inteligencji, potwierdza osiągnięcie oczekiwanych rezultatów. Co więcej, 87% przedsiębiorstw zauważyło wzrost przychodów, który średnio wyniósł 35%, a 90% firm odnotowało wzrost produktywności, szczególnie w obszarach rutynowych, takich jak analizy danych, automatyzacja zadań czy raportowanie. Badania McKinsey & Company dodatkowo potwierdzają, że firmy, które zintegrowały AI ze swoimi procesami operacyjnymi, zwiększyły produktywność średnio o 25%, jednocześnie obniżając koszty operacyjne o 10%. W sektorze rekrutacji, wdrożenie AI skróciło czas potrzebny na zamknięcie procesu o 35% i zmniejszyło koszty o 20%.

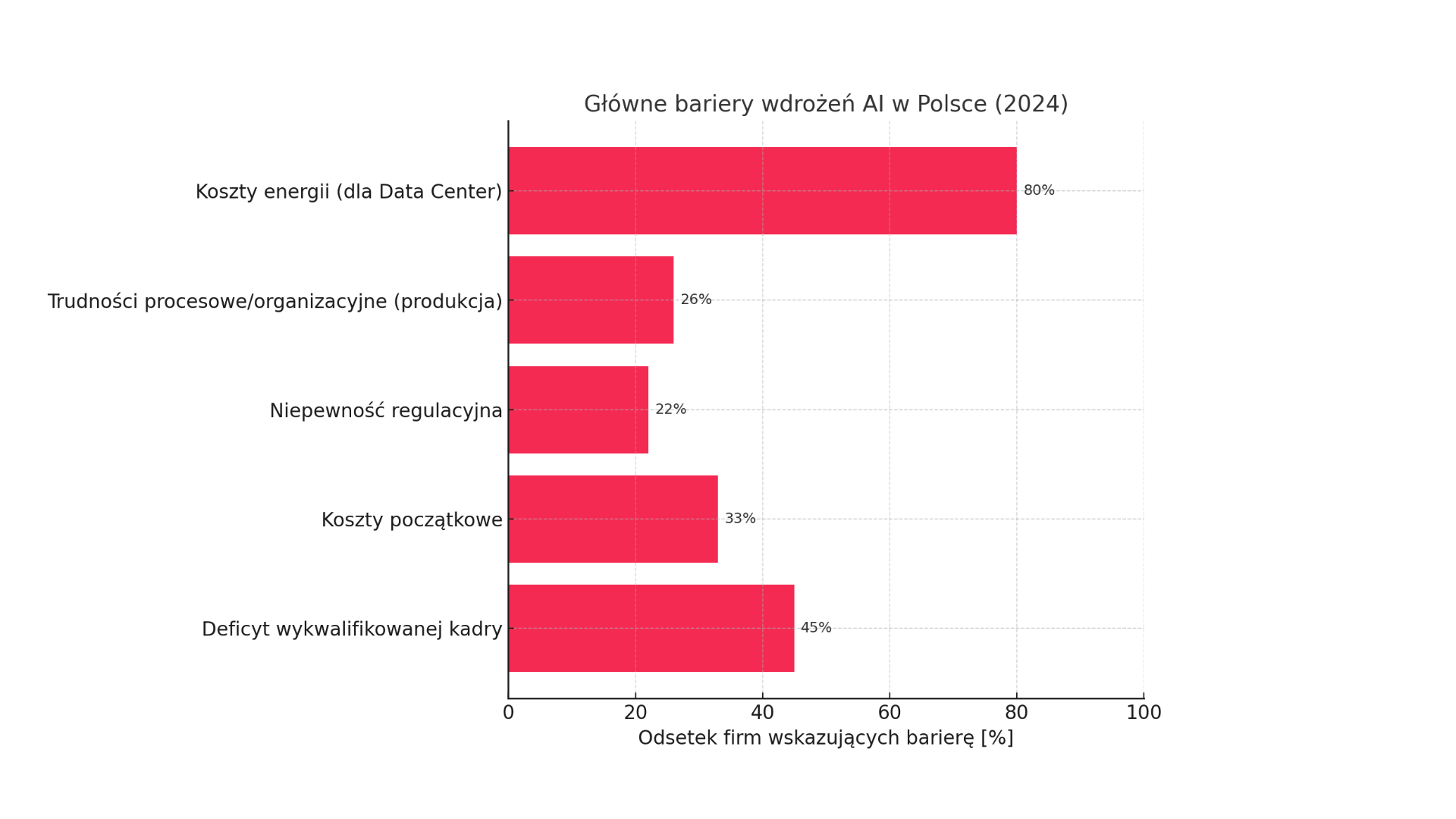

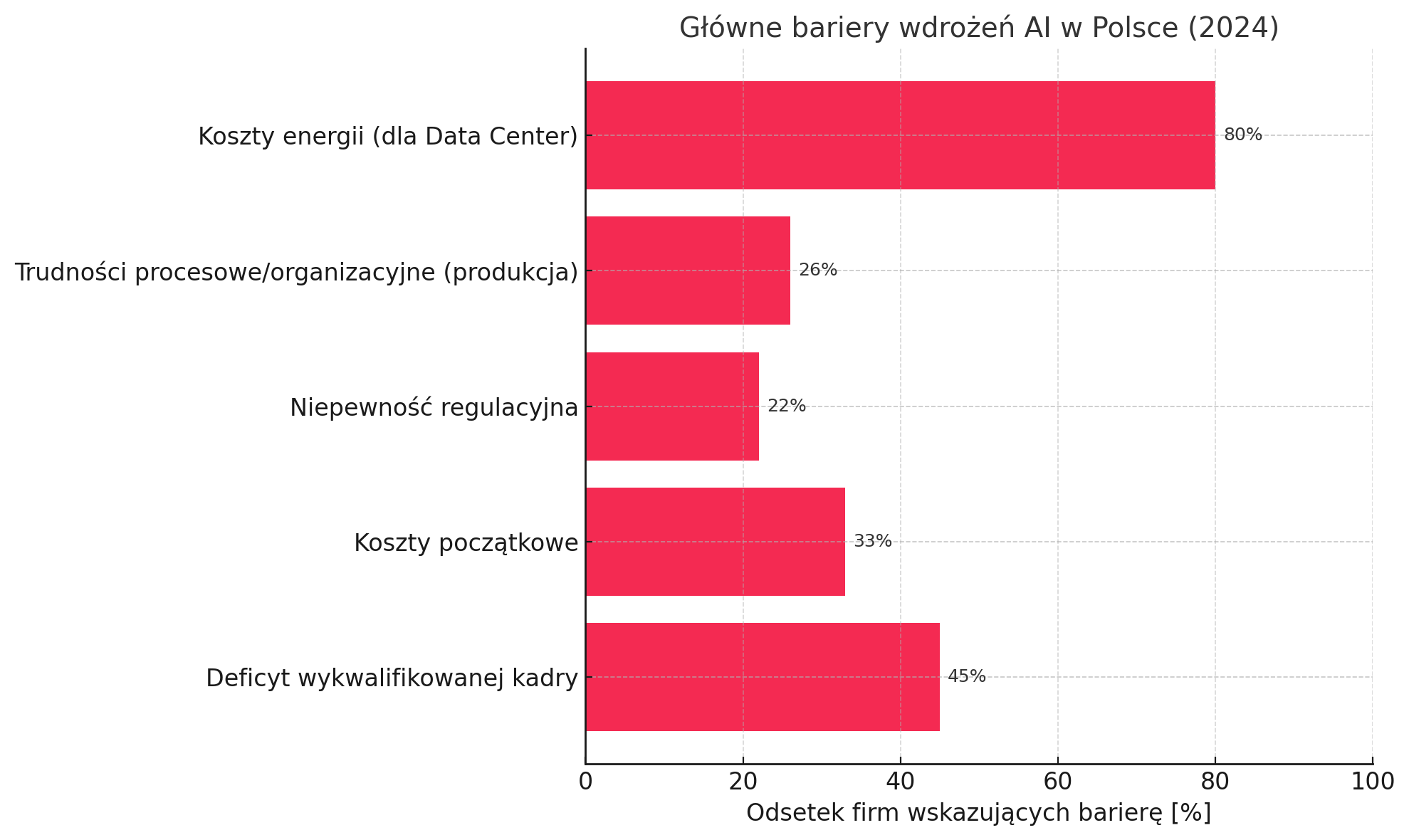

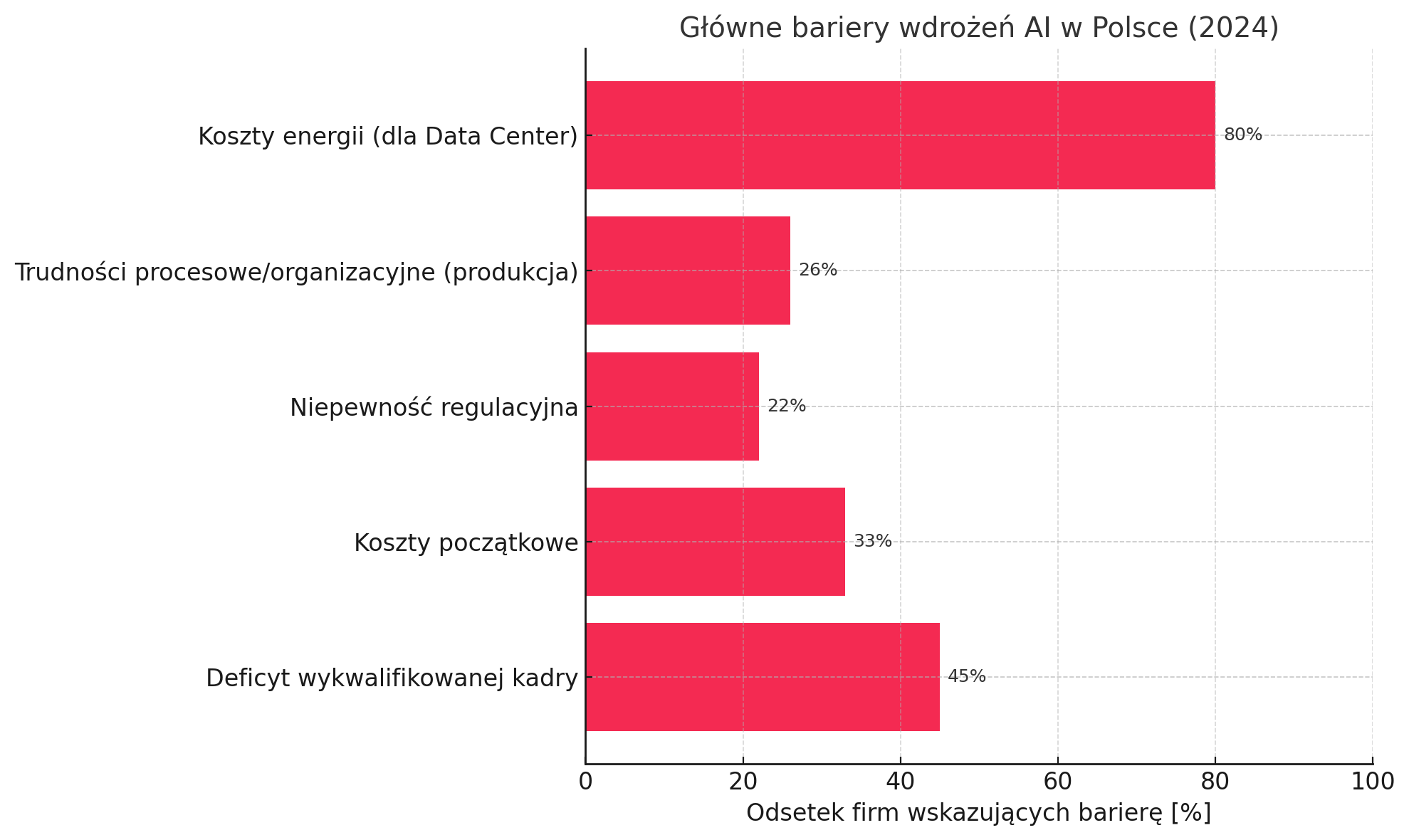

Jednak dynamiczny rozwój sztucznej inteligencji jest nierozerwalnie związany z rosnącym zapotrzebowaniem na energię elektryczną. Infrastruktura AI, oparta w dużej mierze na centrach danych, staje się coraz bardziej energochłonna, a jej zapotrzebowanie na prąd rośnie w tempie wykładniczym. W tym kontekście, rosnące koszty energii elektrycznej są identyfikowane jako największe wyzwanie stojące przed polskimi centrami danych, co zostało wskazane przez 80% respondentów w badaniu przeprowadzonym na zlecenie firmy Kingston.

Kwestia wpływu kosztów energii na rozwój AI w Polsce ma fundamentalne znaczenie dla całej gospodarki i sektora IT. Inwestycje w przełomowe technologie, takie jak sztuczna inteligencja, mają potencjał przyspieszenia wzrostu gospodarczego i umocnienia pozycji Polski w globalnym łańcuchu wartości. Kraje, które jako pierwsze dostosują swoje systemy energetyczne do nowej rzeczywistości cyfrowej, mogą stać się liderami transformacji. Z kolei regiony, które nie zdołają zwiększyć dostępności energii lub zapewnić jej konkurencyjnych cen, mogą zostać pominięte w globalnym wyścigu technologicznym.

Analiza dostępnych danych wskazuje, że silny wzrost adopcji AI w Polsce, napędzany realnymi korzyściami biznesowymi, tworzy fundamentalną presję na infrastrukturę energetyczną. To zmienia postawione w tytule pytanie z „czy rozwój AI zostanie zatrzymany?” na „jak zarządzimy energią, aby utrzymać ten rozwój?”. Skoro korzyści biznesowe z AI są tak znaczące i powszechnie odczuwalne, firmy będą dążyć do jej wdrażania, niezależnie od rosnących kosztów energii. Oznacza to, że wysokie ceny energii nie zatrzymają rozwoju AI, ale zmuszą firmy do szukania rozwiązań, które zoptymalizują zużycie energii lub zapewnią dostęp do tańszych źródeł. Ta fundamentalna presja na energię oznacza, że sektor energetyczny i decydenci polityczni muszą traktować rozwój AI jako kluczowego, rosnącego odbiorcę energii, a nie jako marginalny problem. Konieczne jest przyspieszenie transformacji energetycznej i modernizacji sieci, aby Polska mogła utrzymać swoją konkurencyjność w globalnym wyścigu AI i uniknąć sytuacji, w której brak odpowiedniej infrastruktury energetycznej stanie się realną barierą dla inwestycji.

Dynamika cen energii elektrycznej w Polsce: prognozy dla sektora biznesowego

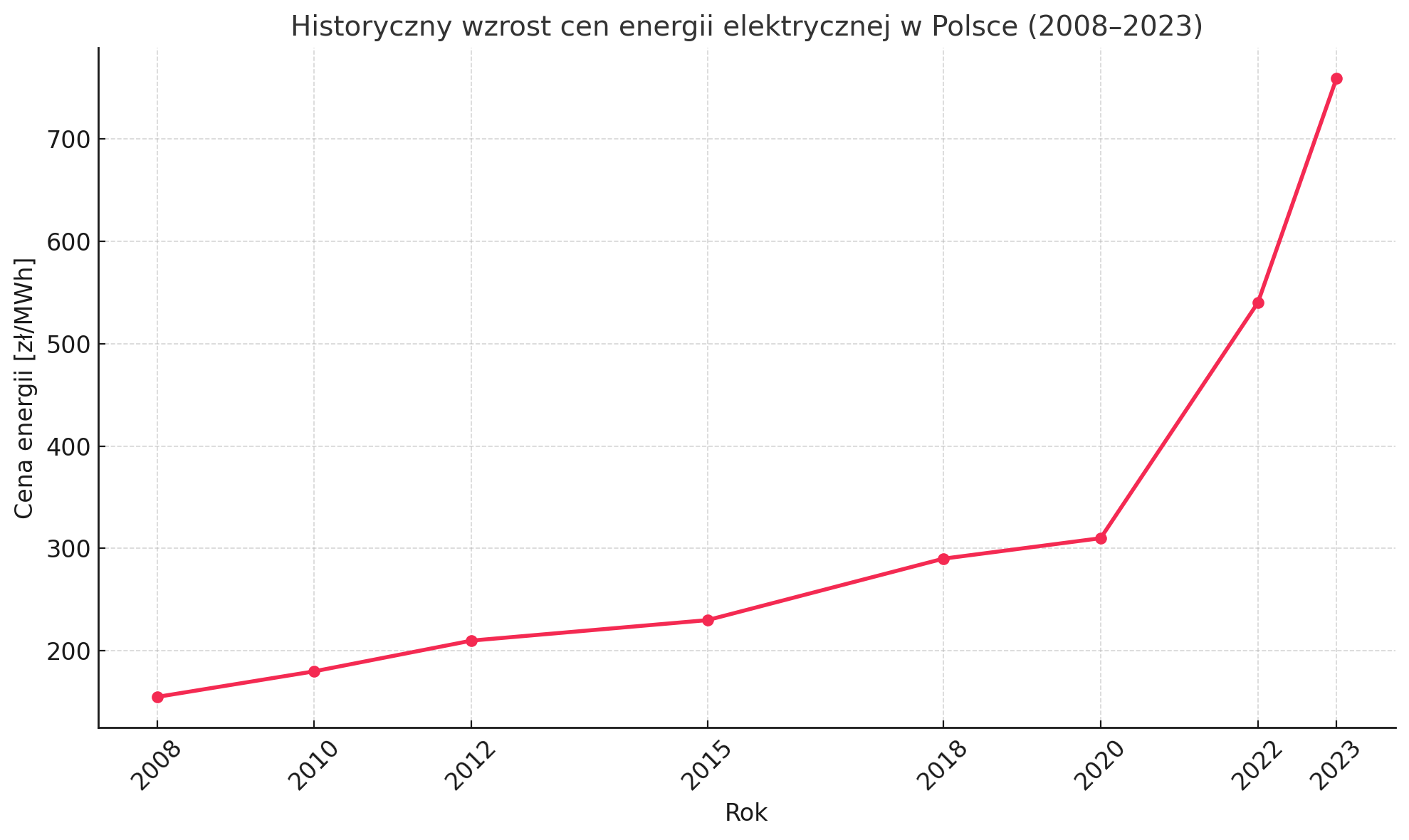

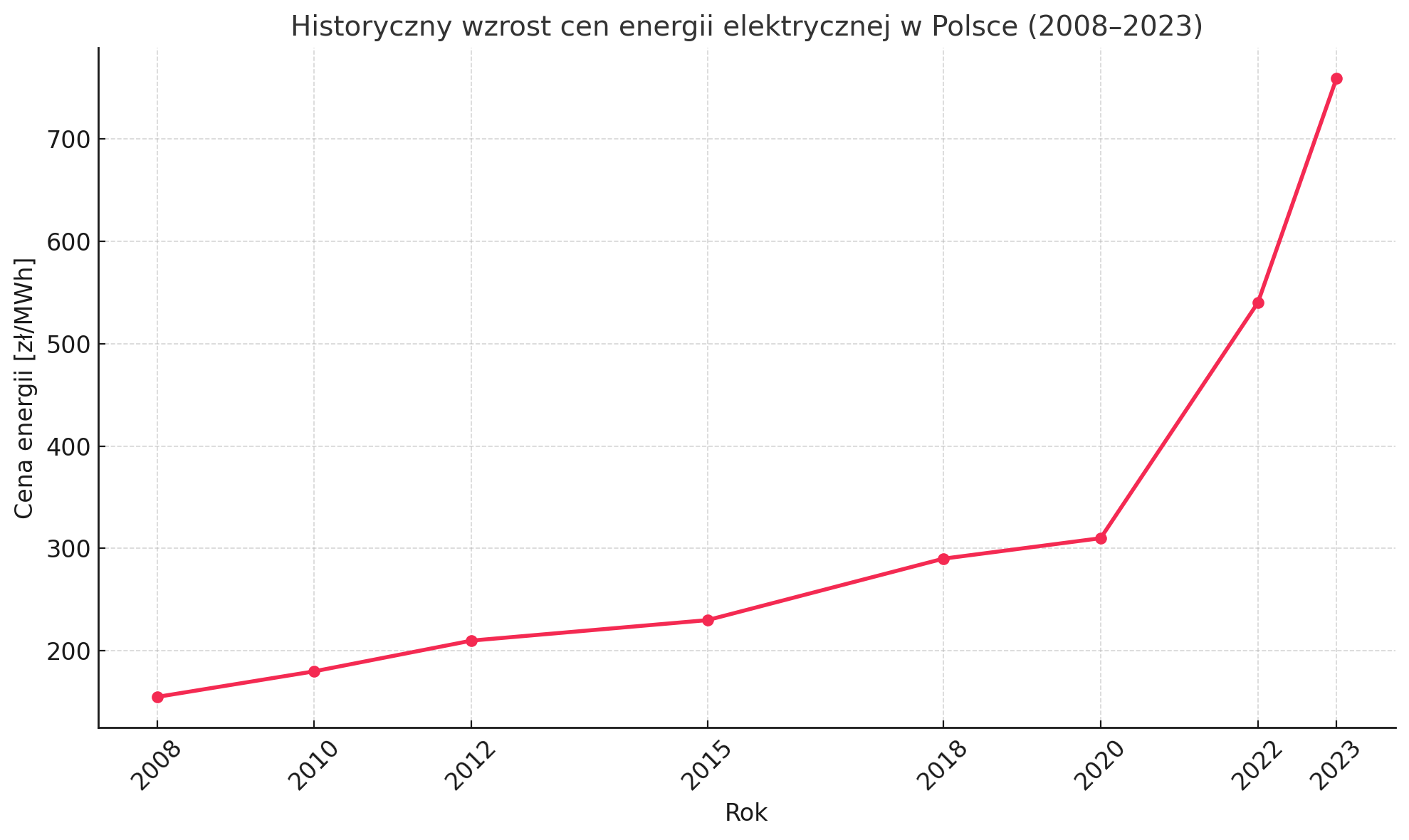

Koszty energii elektrycznej stanowią istotny element w kalkulacji opłacalności inwestycji w infrastrukturę IT, w tym w systemy sztucznej inteligencji. Analiza dynamiki cen energii w Polsce, zarówno historycznych, jak i prognozowanych, jest kluczowa dla zrozumienia wyzwań stojących przed sektorem biznesowym.

W ciągu ostatnich 15 lat ceny energii elektrycznej w Polsce wzrosły blisko pięciokrotnie, z 155 zł/MWh w 2008 roku do 759 zł/MWh w 2023 roku. Główną przyczyną tego znaczącego wzrostu był rosnący koszt wytwarzania energii w elektrowniach węglowych oraz dynamiczny wzrost cen uprawnień do emisji dwutlenku węgla (EU ETS), które w kwietniu 2023 roku osiągnęły około 90 euro/tCO₂, stabilizując się w kwietniu 2024 roku na poziomie 65 euro/tCO₂. Hurtowe ceny energii elektrycznej w Polsce, pomimo pewnej stabilizacji po gwałtownych wzrostach w latach 2022-2023, nadal utrzymują się na jednym z najwyższych poziomów w Europie. W drugim kwartale 2024 roku średnia cena energii elektrycznej w Polsce wyniosła około 390 zł/MWh, podczas gdy średnia europejska kształtowała się na poziomie 340 zł/MWh.

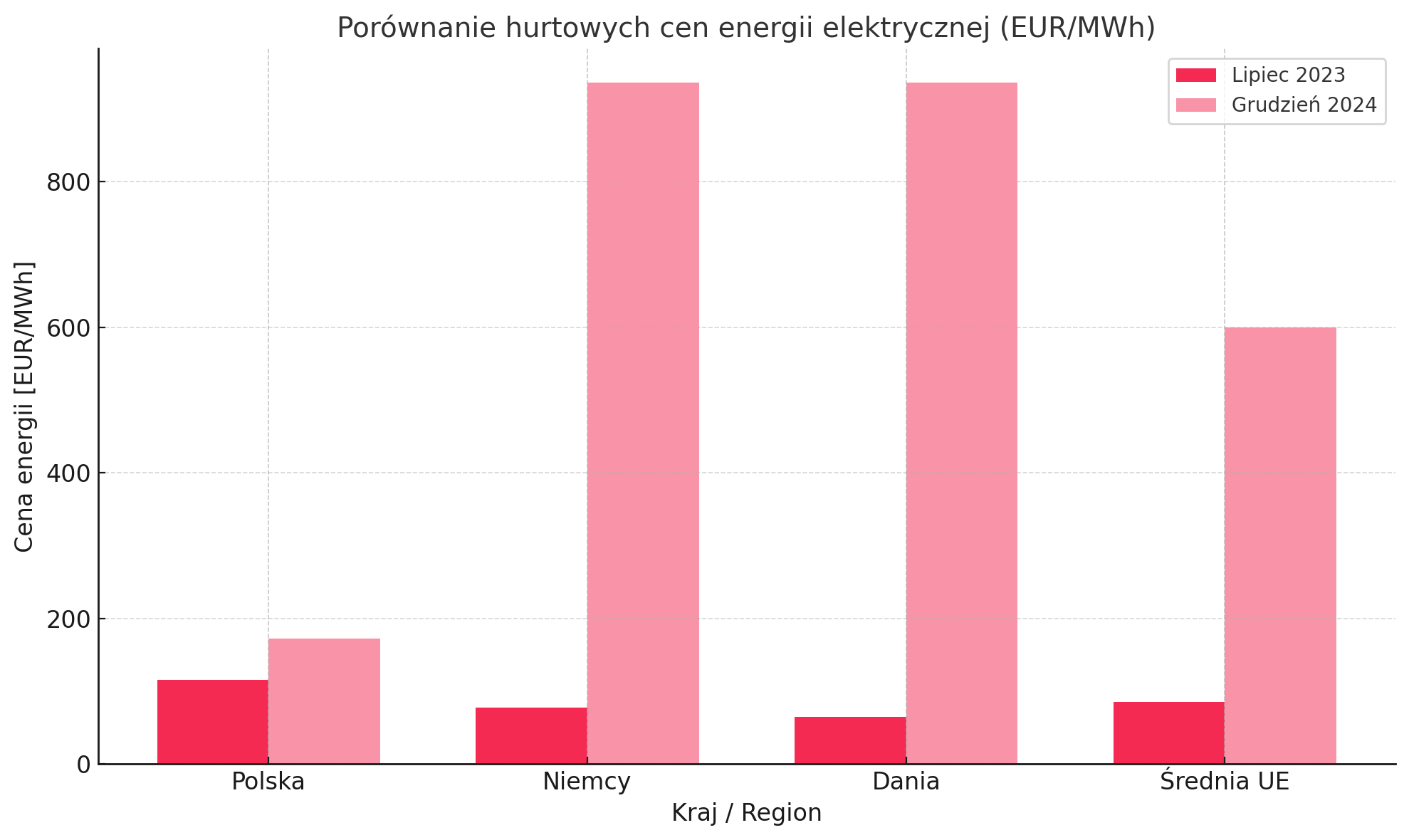

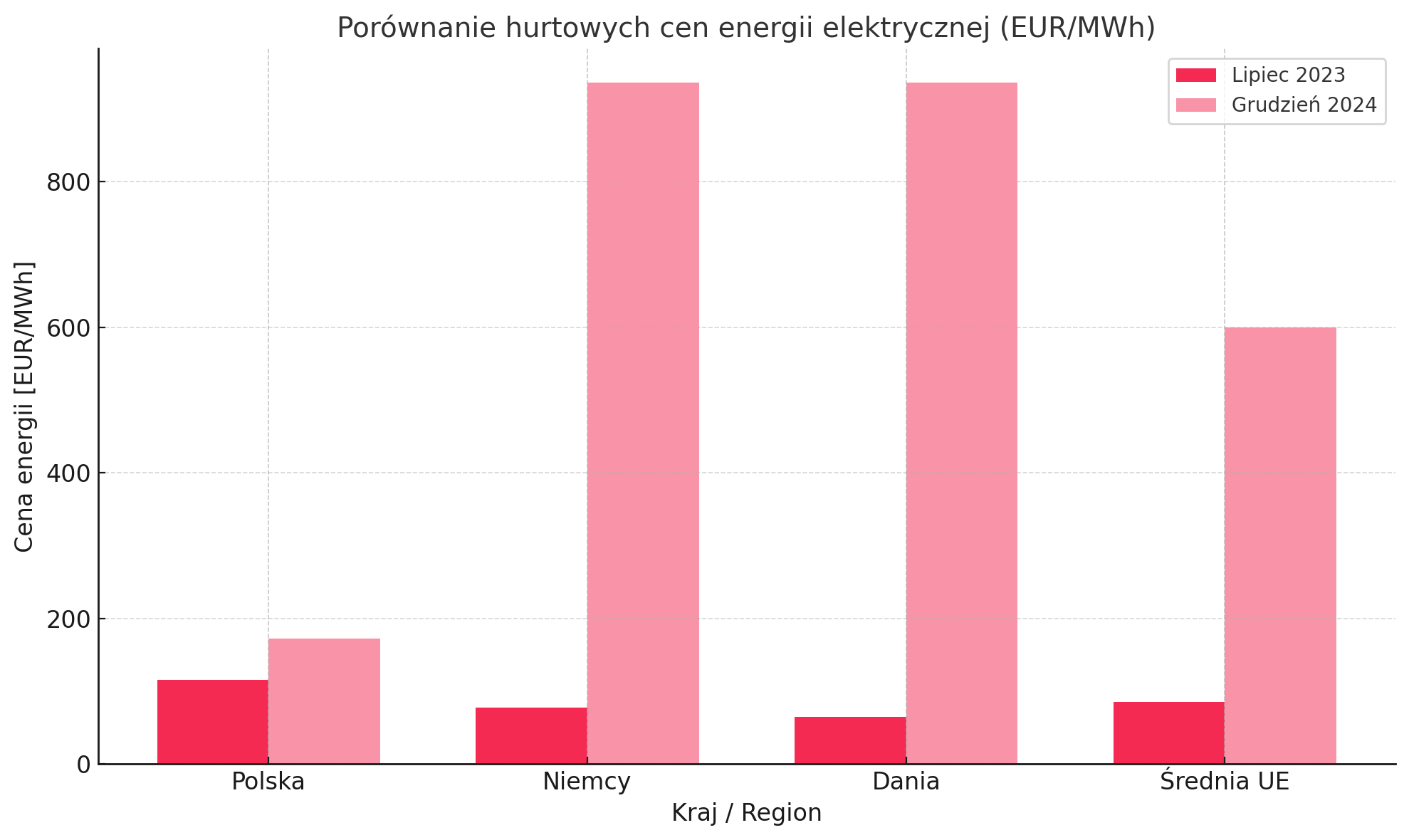

Szczegółowe porównania pokazują, że w lipcu 2023 roku hurtowa cena 1 MWh w Polsce (115,73 euro) była o około 49% wyższa niż w Niemczech (77,48 euro) i jednocześnie najwyższa w całej Unii Europejskiej. Bartłomiej Derski z portalu WysokieNapiecie.pl podkreśla, że tak niekorzystna różnica cen między Polską a Niemcami (ponad 200 zł) nie miała miejsca w historii. Jest to w dużej mierze spowodowane tym, że Polska płaci więcej za uprawnienia do emisji CO2, a koszt wytworzenia prądu z polskiego węgla, przekraczający 330 zł za 1 MWh, jest droższy od węgla importowanego. Pod koniec 2024 roku małe firmy miały możliwość zakontraktowania energii na 2025 rok po cenie poniżej 50 gr/kWh netto. Niemniej jednak, w grudniu 2024 roku polska energia kosztowała średnio 172 euro za megawatogodzinę, co było znacznie mniej niż w Niemczech czy Danii, gdzie stawki osiągnęły 936 euro/MWh. Mimo to, koszty kontraktów rocznych na 2025 rok w Polsce (około 100 euro/MWh) są już o 9% wyższe niż w Niemczech i o 25% wyższe niż w Danii. To wskazuje, że chwilowo niższe ceny bieżące nie przekładają się na długoterminową przewagę konkurencyjną.

Prognozy cen energii elektrycznej na lata 2025-2030

W kontekście prognoz, dla gospodarstw domowych ceny prądu zostały zamrożone do 30 września 2025 roku na poziomie 50 gr netto za 1 kWh. Jednak po tym okresie, dla firm, które nie zabezpieczyły umów lub nie wysłały wymaganych oświadczeń na czas, ceny mogą wzrosnąć drastycznie, nawet do 2,31 zł/kWh, choć na rynku wciąż dostępne są oferty po 60 gr/kWh. Taka sytuacja oznacza, że brak proaktywnego zarządzania umowami energetycznymi może skutkować koniecznością zwrotu znacznych kwot na rachunek sprzedawcy energii.

Prognozy Polskich Sieci Elektroenergetycznych (PSE) oraz Krajowego Planu Rozwoju Sektora Przemysłowego (KPRSP) na lata 2025-2040 wskazują, że zużycie energii w 2030 roku w Polsce wyniesie 175,0 TWh. Z drugiej strony, eksperci McKinsey szacują, że transformacja energetyczna w Polsce pozwoli obniżyć średnie ceny energii elektrycznej o około 70 zł/MWh (15%) do 2030 roku i o około 150 zł/MWh (30%) do 2050 roku, co przełożyłoby się na średnio 25 mld zł oszczędności rocznie dla całej gospodarki.

Porównanie cen energii w Polsce z innymi krajami UE dla centrów danych

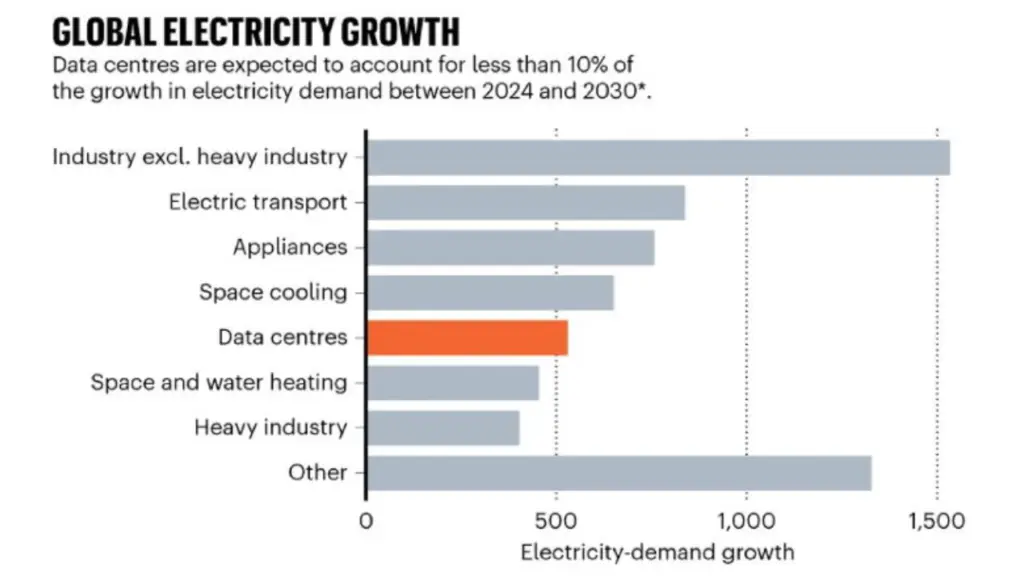

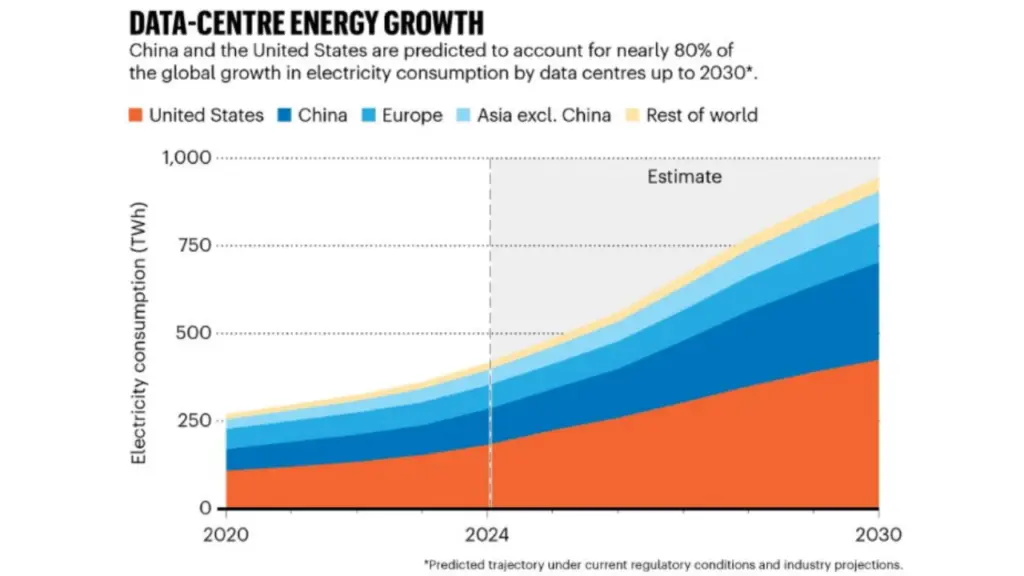

Jak już wspomniano, hurtowe ceny energii w Polsce były w lipcu 2023 roku najwyższe w Unii Europejskiej. Obecnie Europa odpowiada za około 15% globalnego wykorzystania mocy w centrach danych, jednak odnotowała spadek udziału na koniec 2023 roku. Globalne zapotrzebowanie na energię przez centra danych może wzrosnąć ponad dwukrotnie do 2030 roku, osiągając około 945 TWh globalnie, z czego w samej Europie do 113 TWh.

Krótkoterminowe zamrożenie cen dla gospodarstw domowych w Polsce, choć politycznie uzasadnione, maskuje głębokie, strukturalne wyzwania dla sektora biznesowego, zwłaszcza dla energochłonnych branż, takich jak AI. Firmy te, po 2025 roku, mogą napotkać na drastyczny wzrost kosztów, co zagraża ich rentowności. Polityka zamrażania cen dla konsumentów indywidualnych tworzy iluzję stabilności na rynku energii, która nie odzwierciedla rzeczywistych kosztów wytwarzania i hurtowych cen dla biznesu. Firmy, zwłaszcza te z dużą infrastrukturą AI, nie mogą liczyć na podobne mechanizmy osłonowe w dłuższej perspektywie. Brak proaktywnego zarządzania kontraktami energetycznymi staje się więc nie tylko błędem operacyjnym, ale strategicznym ryzykiem dla rentowności projektów AI. To zmusza firmy do myślenia o długoterminowych strategiach pozyskiwania energii, takich jak umowy PPA, zamiast polegać na interwencjach rządowych. Ta sytuacja podkreśla pilną potrzebę przyspieszenia transformacji energetycznej w Polsce. Dopóki miks energetyczny będzie oparty na węglu i obciążony kosztami EU ETS, ceny hurtowe pozostaną wysokie, a sektor AI będzie operował w środowisku niepewności kosztowej. Brak stabilnych i konkurencyjnych cen energii może spowolnić napływ zagranicznych inwestycji w duże centra danych AI, które szukają optymalnych warunków operacyjnych na całym świecie.

Pomimo chwilowych niższych cen bieżących w porównaniu do niektórych krajów UE, Polska ma strukturalnie wyższe hurtowe ceny energii i wyższe koszty kontraktów rocznych dla biznesu. Stanowi to systemową barierę dla globalnej konkurencyjności polskiego sektora AI i może hamować rozwój dużych projektów infrastrukturalnych. Ta strukturalna różnica w cenach energii stawia Polskę w niekorzystnej pozycji konkurencyjnej. Firmy globalne, zwłaszcza hyperscalerzy, którzy planują budowę dużych centrów danych, dokonują wyborów lokalizacyjnych w oparciu o długoterminową stabilność i konkurencyjność kosztową energii. Jeśli Polska oferuje wyższe ceny kontraktowe, staje się mniej atrakcyjna, co może ograniczać napływ kluczowych inwestycji w infrastrukturę AI. Spadek udziału Europy w globalnym wykorzystaniu mocy w centrach danych jest sygnałem ostrzegawczym. Aby Polska mogła stać się wiodącym hubem AI w Europie, konieczna jest nie tylko transformacja energetyczna, ale także osiągnięcie cen energii konkurencyjnych na poziomie regionalnym. Inwestycje w OZE i energetykę jądrową są kluczowe nie tylko dla zrównoważonego rozwoju, ale przede wszystkim dla zapewnienia ekonomicznej podstawy dla dalszego, nieskrępowanego rozwoju AI.

Rozwój AI w Polsce: trendy i bariery

Rozwój sztucznej inteligencji w Polsce charakteryzuje się dynamicznym tempem, co potwierdzają liczne dane rynkowe. Odsetek firm korzystających z AI wzrósł z 3,7% w 2023 roku do 5,9% w 2024 roku, a w dużych przedsiębiorstwach już co dziesiąta organizacja wykorzystuje te technologie. Raport Strand Partners, przygotowany dla AWS, wskazuje, że 34% polskich firm wdrożyło rozwiązania AI, a dynamika jest tak duża, że średnio co dwie minuty kolejna polska firma zaczyna korzystać z AI.

Firmy, które zdecydowały się na wdrożenie AI, odnotowują znaczące korzyści. Aż 87% z nich zauważyło wzrost przychodów, średnio o 35%, a 90% doświadczyło wzrostu produktywności, zwłaszcza w obszarach rutynowych, takich jak analiza danych, automatyzacja zadań czy raportowanie. Badanie EY potwierdza, że AI przyczynia się do optymalizacji procesów, usprawnienia analizy danych, poprawy cyberbezpieczeństwa oraz rozwoju produktów i usług. Dodatkowo, analizy McKinsey & Company wskazują, że firmy, które wdrożyły AI w swoich procesach operacyjnych, zwiększyły produktywność średnio o 25%, jednocześnie redukując koszty operacyjne o 10%. W sektorze rekrutacji, wdrożenie AI skróciło czas potrzebny na zatrudnienie o 35% i obniżyło związane z tym koszty o 20%.

Polski Fundusz Rozwoju (PFR) opracował Mapę Polskich Rozwiązań AI, grupując rozwiązania również w obszarze zrównoważonego rozwoju. Wśród kluczowych polskich firm rozwijających AI można wymienić Infermedica, Molecule.one, DeepFlare (medycyna i biotechnologia), Authologic, Nethone (finanse, cyberbezpieczeństwo), Nomagic, AI Clearing (przemysł i logistyka), Synerise, Cosmose AI (obsługa klienta i marketing) oraz Eleven Labs, Addepto (generatywna AI i technologie przyszłości). Popularnymi platformami z funkcjami AI w Polsce są również Bitrix24 i HubSpot.

Inwestycje w AI i rozwój infrastruktury

Polska aktywnie inwestuje w rozwój infrastruktury AI. Planowana jest budowa 13 „Fabryk AI”, które mają stać się kluczowymi punktami dostępu do współdzielonej mocy obliczeniowej, niezbędnej do trenowania modeli językowych i przetwarzania danych na masową skalę. Fabryki te będą dostępne zarówno dla przedsiębiorstw, jak i jednostek badawczych. Wydatki na AI w Polsce wzrosły średnio o 20% w ciągu ostatniego roku, co plasuje kraj blisko średniej europejskiej. Istotnym elementem ekosystemu badawczo-rozwojowego jest IDEAS NCBR, ośrodek powołany przez Narodowe Centrum Badań i Rozwoju, którego misją jest wspieranie rozwoju AI w Polsce poprzez łączenie środowiska akademickiego z biznesowym.

Bariery rozwoju AI

Mimo dynamicznego wzrostu adopcji i widocznych korzyści, Polska stoi przed wyzwaniem, które można określić jako „potrójną barierę” dla pełnego rozkwitu AI: energii, kadr i regulacji. Te bariery nie są izolowane, lecz wzajemnie się wzmacniają, tworząc złożony ekosystem wyzwań, który wymaga skoordynowanych działań.

Po pierwsze, brak odpowiednio wykwalifikowanej kadry jest wskazywany jako główna przeszkoda w dalszej ekspansji AI przez 45% firm. W odpowiedzi na ten deficyt, pracodawcy oferują atrakcyjne premie i wynagrodzenia, średnio o 42% wyższe dla ekspertów w dziedzinie sztucznej inteligencji. Po drugie, koszty początkowe stanowią wyzwanie dla 33% firm. Chociaż obawy przed kosztami maleją w sektorze produkcji (z 33% do 10%), to trudności procesowe i organizacyjne rosną na znaczeniu (26% w produkcji). Po trzecie, niepewność regulacyjna dotyka 22% przedsiębiorstw, a w sektorze startupów problem ten jest odczuwalny dla aż 80% podmiotów. W sektorze usług wskazywana jest niepewność regulacyjna (17%), a w handlu – bezpieczeństwo danych (26%). Badanie Kingston dla centrów danych w Polsce potwierdza, że poza rosnącymi cenami energii, wyzwaniem są brak wykwalifikowanej kadry i regulacje dotyczące cyberbezpieczeństwa.

Wysokie koszty energii mogą zniechęcać do inwestycji w fizyczną infrastrukturę AI, taką jak budowa dużych centrów danych, co z kolei może ograniczać zapotrzebowanie na specjalistów AI lub sprawiać, że Polska będzie mniej atrakcyjna dla talentów. Niepewność regulacyjna może spowalniać zarówno inwestycje w energooszczędne rozwiązania AI, jak i rozwój innowacyjnych projektów, które mogłyby zmniejszyć zapotrzebowanie na energię. Z kolei brak kadr może utrudniać wdrożenie i optymalizację energooszczędnych systemów, pogłębiając problem kosztów energii.

Sukces Polski w rozwoju AI nie zależy wyłącznie od indywidualnych inwestycji firm czy rządowych programów, takich jak „Fabryki AI”. Wymaga on holistycznego podejścia, które jednocześnie adresuje wszystkie te wzajemnie powiązane bariery. Zaniedbanie jednego z obszarów, na przykład brak stabilnych cen energii, może osłabić efekty działań w innych, takich jak inwestycje w kadry czy regulacje. Oznacza to, że Polska musi stworzyć spójny ekosystem wspierający AI, gdzie polityka energetyczna, edukacyjna i regulacyjna są ze sobą zsynchronizowane, aby zapewnić długoterminową konkurencyjność na arenie międzynarodowej.

Energochłonność infrastruktury AI

Rozwój sztucznej inteligencji nierozerwalnie wiąże się z rosnącym zapotrzebowaniem na moc obliczeniową, a co za tym idzie, na energię elektryczną. Centra danych, będące kręgosłupem infrastruktury AI, stają się jednymi z największych konsumentów prądu na świecie.

Globalne i polskie zapotrzebowanie na energię przez centra danych

Globalne centra danych zużywają coraz większe ilości energii. Międzynarodowa Agencja Energetyczna (IEA) prognozuje, że do 2026 roku mogą one zużywać o 80% więcej energii niż w 2022 roku, nawet przy uwzględnieniu wzrostu efektywności. Analitycy Goldman Sachs szacują, że do 2030 roku zużycie energii przez centra danych zwiększy się ponad dwukrotnie – z 498 TWh do 1076 TWh, co będzie odpowiadało dzisiejszemu zużyciu energii całej Japonii. Podobne prognozy przedstawiają IDC i Deloitte, wskazując na gwałtowny wzrost zapotrzebowania na energię w centrach danych napędzany przez AI.

W Polsce moc przydzielona centrom danych w 2023 roku wyniosła 173 MW, co stanowi wzrost o prawie 43% rok do roku. Prognoza na 2030 rok wskazuje na osiągnięcie co najmniej 500 MW, co oznacza średnioroczne tempo wzrostu (CAGR) na poziomie 25%. Polskie Sieci Elektroenergetyczne (PSE) przewidują, że udział centrów danych w krajowym zużyciu energii elektrycznej będzie wynosić około 4,2–4,5%. Co więcej, duże centra danych, takie jak te, które Microsoft uruchomi w Polsce, mogą potrzebować nawet ponad 100 MW. Roczne zużycie energii na takim poziomie wystarczyłoby do naładowania wszystkich samochodów elektrycznych w Polsce dwukrotnie.

Sztuczna inteligencja przyczynia się do zużycia energii zarówno podczas fazy treningu modeli, jak i w fazie wnioskowania (inference). Faza treningu modeli AI jest niezwykle energochłonna, wymaga ogromnej mocy obliczeniowej i trwa tygodnie lub miesiące, angażując setki lub tysiące procesorów graficznych (GPU) lub jednostek przetwarzania tensorowego (TPU). Przykładowo, trening modelu GPT-3 (posiadającego 175 miliardów parametrów) zużył około 1287 MWh energii elektrycznej, co odpowiada rocznemu zużyciu około 120 amerykańskich gospodarstw domowych.

Wnioskowanie (inference) to faza operacyjna, w której wytrenowany model generuje prognozy lub odpowiedzi na nowe dane. Chociaż trening jest intensywny, to faza wnioskowania odpowiada za 70-80% całkowitego zużycia energii w cyklu życia modelu ze względu na jej ciągły i powtarzalny charakter. Każde zapytanie do modelu AI, takiego jak ChatGPT, zużywa co najmniej cztery do pięciu razy więcej mocy obliczeniowej niż tradycyjne wyszukiwanie w internecie. Pojedyncze zapytanie do ChatGPT3 zużywa około 10 razy więcej energii niż typowe wyszukiwanie w Google.

W celu mitygacji tego zużycia, wykorzystanie mniejszych modeli AI do prostszych zadań stanowi efektywną metodę oszczędzania energii – są one bardziej ekonomiczne i ekologiczne. Dodatkowo, technika kwantyzacji modelu, która zmniejsza precyzję wag modeli i aktywacji, znacznie redukuje zużycie pamięci i przyspiesza wnioskowanie, co przekłada się na mniejsze zużycie energii.

Struktura kosztów operacyjnych infrastruktury AI

Globalne inwestycje w infrastrukturę AI już przekraczają 100 miliardów dolarów rocznie, co wskazuje, że skala problemu będzie tylko rosnąć. McKinsey szacuje, że do 2030 roku firmy będą musiały zainwestować 5,2 biliona dolarów w centra danych do obsługi samego AI. Koszty energii i utrzymania obiektów są kluczowym czynnikiem w tej strukturze. Około 25% (1,3 biliona dolarów) z prognozowanych 5,2 biliona dolarów inwestycji jest przeznaczone na „energizerów”, czyli podmioty odpowiedzialne za wytwarzanie i przesył energii, chłodzenie oraz sprzęt elektryczny.

Koszty operacyjne dla rozwiązań lokalnych (on-premise) obejmują znaczące wydatki kapitałowe (CapEx) na sprzęt i oprogramowanie, a także bieżące koszty energii i utrzymania obiektów. W przeciwieństwie do tego, rozwiązania chmurowe (cloud) oferują zredukowane koszty początkowe i niższe wymagania konserwacyjne, ale wiążą się z bieżącymi kosztami operacyjnymi (OpEx) w postaci opłat abonamentowych. W przypadku infrastruktury on-premise, koszty zasilania i chłodzenia centrów danych mogą być wysokie i zmienne z powodu wahań cen energii.

Koszty rozwoju AI różnią się w zależności od złożoności projektu: proste rozwiązania (np. chatboty) mogą kosztować od 20 000 do 80 000 dolarów, zaawansowane (np. systemy zarządzania ryzykiem) od 50 000 do 150 000 dolarów, a niestandardowe, złożone systemy (np. zaawansowane platformy handlowe) od 100 000 do ponad 500 000 dolarów. Koszty infrastruktury dla obciążeń AI w chmurze zaczynają się od około 2000 dolarów miesięcznie i szybko rosną wraz z wykorzystaniem mocy obliczeniowej. Opłaty za korzystanie z modeli językowych (LLM), oparte na liczbie tokenów, mogą wynosić od 500 do ponad 5000 dolarów miesięcznie przy dużym wolumenie interakcji. W Polsce, koszty energii stanowią największe wyzwanie dla centrów danych, co potwierdza 80% respondentów.

Eksponencjalny wzrost AI oznacza, że centra danych staną się głównymi konsumentami energii, znacznie przewyższając tradycyjne IT. Przejście od treningu do wnioskowania jako dominującego czynnika zużycia energii oznacza ciągłe, wysokie koszty operacyjne. To zjawisko wymusza strategiczne skupienie się na efektywności energetycznej, odnawialnych źródłach energii oraz optymalizacji modeli AI, aby skutecznie zarządzać długoterminowymi skutkami finansowymi i środowiskowymi.

Wybór między infrastrukturą AI lokalną (on-premise) a chmurową (cloud) jest coraz bardziej podyktowany względami kosztów energii. Chmura oferuje skalowalność i korzyści w zakresie kosztów operacyjnych, podczas gdy rozwiązania lokalne zapewniają większą kontrolę. Wyższe ceny energii w Polsce wzmacniają ryzyko finansowe związane z rozwiązaniami on-premise, skłaniając firmy w kierunku chmury lub ekologicznych centrów danych. Ta dynamika może przekształcić lokalny rynek centrów danych i przyspieszyć adopcję zrównoważonych praktyk energetycznych.

Strategie mitygacji i perspektywy rozwoju

W obliczu rosnącego zapotrzebowania na energię ze strony infrastruktury AI, kluczowe staje się wdrożenie skutecznych strategii mitygacji kosztów i zapewnienia zrównoważonego rozwoju.

Inwestycje w efektywność energetyczną centrów danych

Efektywność energetyczna jest fundamentem zrównoważonego rozwoju centrów danych. Nowoczesne rozwiązania obejmują stosowanie chłodzenia cieczą w obiegu zamkniętym oraz odzysk komponentów IT do ponownego użycia, co praktykuje na przykład OVHcloud. Celem dla wszystkich nowych centrów danych do 2030 roku jest wykorzystywanie wyłącznie odnawialnej energii oraz osiąganie wskaźnika PUE (Power Usage Effectiveness) na poziomie 1,3 w chłodnym klimacie i 1,4 w cieplejszym.

Działania takie jak audyty efektywności energetycznej, wdrażanie inteligentnych systemów zarządzania energią oraz odzysk ciepła mogą przynieść znaczące oszczędności i przyczynić się do dekarbonizacji. Przykładem jest Beyond.pl, który odzyskuje ciepło z komór serwerowych do ogrzewania własnego biurowca. Na poziomie oprogramowania, kwantyzacja modeli AI, która zmniejsza precyzję wag modeli i aktywacji, znacząco redukuje zużycie pamięci i przyspiesza wnioskowanie, co przekłada się na mniejsze zużycie energii. Podobnie, wykorzystanie mniejszych modeli AI do prostszych zadań jest bardziej energooszczędne. Nowe techniki, takie jak opracowana przez BitEnergy AI, mogą zmniejszyć zużycie energii przez AI nawet o 95%, choć wymagają specjalistycznego sprzętu.

Wykorzystanie OZE i umowy PPA

Odnawialne źródła energii są postrzegane jako przyszłość branży centrów danych. Beyond.pl jest przykładem firmy, która zasila swoje centra danych w 100% energią odnawialną i dąży do neutralności klimatycznej do 2040 roku, będąc jedynym polskim członkiem Climate Neutral Data Centre Pact. Kolokacja obiektów w pobliżu źródeł wytwarzania energii z OZE pozwala dostawcom obniżyć zarówno wydatki na budowę, jak i straty energii związane z dystrybucją, zwiększając ogólną wydajność i zrównoważony rozwój. Umowy PPA (Power Purchase Agreements) umożliwiają firmom zabezpieczenie dostaw zielonej energii, co jest kluczowe dla zaspokojenia rosnącego zapotrzebowania na prąd.

Rola chmury obliczeniowej (Cloud) vs. infrastruktury lokalnej (On-Premise)

Wybór między chmurą obliczeniową a infrastrukturą lokalną ma istotne implikacje dla kosztów energii. Chmura oferuje skalowalność, elastyczność, zredukowane koszty początkowe, niższe wymagania konserwacyjne oraz dostęp do zaawansowanych narzędzi i technologii AI. Z kolei rozwiązania on-premise zapewniają większą kontrolę nad danymi i infrastrukturą, co jest korzystne dla firm przetwarzających wrażliwe informacje, ale brakuje im skalowalności chmury i wymagają znaczących inwestycji kapitałowych (CapEx). Koszty energii są kluczowym czynnikiem w porównaniu tych dwóch modeli. Koszty zasilania i chłodzenia centrów danych on-premise mogą być wysokie i zmienne ze względu na wahania cen energii. Model płatności za usługi chmurowe, oparty na rzeczywistym zużyciu (pay-as-you-go), eliminuje potrzebę prognozowania przyszłej pojemności i oferuje długoterminowe oszczędności oraz elastyczność.

Wsparcie rządowe i regulacje

Regulacje, takie jak unijna ustawa o AI (EU AI Act), coraz częściej zawierają wymogi dotyczące zużycia energii i przejrzystości, co będzie miało wpływ na firmy rozwijające lub wykorzystujące technologie AI. Dostawcy modeli AI ogólnego przeznaczenia (GPAI models) są zobowiązani do tworzenia i utrzymywania dokumentacji technicznej, w tym danych o zużyciu energii. Modele o ryzyku systemowym podlegają dodatkowym obowiązkom, co dodatkowo motywuje do minimalizowania zużycia energii.

Ekosystem energetyczny UE jest obecnie słabo przygotowany na rewolucję AI, co wymaga rozwoju energetyki atomowej. W Polsce, Polskie Sieci Elektroenergetyczne (PSE) otrzymają ponad 1,3 miliarda złotych bezzwrotnego dofinansowania z Krajowego Planu Odbudowy (KPO) na rozbudowę i modernizację kluczowych linii przesyłowych. Rząd przyjął również projekt ustawy o deregulacji sektora energetycznego, mający na celu przyspieszenie zielonej transformacji i zwiększenie udziału OZE w polskim miksie energetycznym. Dodatkowo, Grupa Enea pozyskała ponad 9 miliardów złotych na rozwój i modernizację sieci elektroenergetycznych oraz OZE. Na poziomie europejskim, inicjatywy takie jak EU InvestAI i francuskie projekty obliczeniowe AI, a także EuroHPC Joint Undertaking, mają na celu rozwój infrastruktury superkomputerowej i zdolności badawczych.

Proaktywne przyjęcie energooszczędnych praktyk w centrach danych, takich jak chłodzenie cieczą i optymalizacja PUE, w połączeniu z szybkim przejściem na odnawialne źródła energii poprzez umowy PPA, jest nie tylko wymogiem środowiskowym, ale także krytyczną strategią ekonomiczną dla rozwoju AI w Polsce. Takie podejście bezpośrednio przeciwdziała rosnącym kosztom energii i zwiększa atrakcyjność Polski dla inwestycji w AI.

Nacisk unijnej ustawy o AI na przejrzystość energetyczną i ryzyko systemowe dla modeli AI, w połączeniu ze znaczącymi polskimi i unijnymi inwestycjami w modernizację sieci i OZE, sygnalizuje wyraźny kierunek regulacyjny i strategiczny w stronę zrównoważonej sztucznej inteligencji. Tworzy to zarówno obowiązki w zakresie zgodności, jak i przewagi konkurencyjne dla polskich firm, które priorytetowo traktują efektywność energetyczną i zieloną infrastrukturę, potencjalnie kształtując przyszły krajobraz rozwoju AI w regionie.

Wnioski

Dynamiczny rozwój sztucznej inteligencji w Polsce jest niezaprzeczalny i przynosi wymierne korzyści biznesowe, od wzrostu przychodów i produktywności po optymalizację procesów. Polski sektor IT wykazuje dużą gotowość do dalszych inwestycji w AI, co potwierdza szybki wzrost adopcji i plany rozbudowy infrastruktury, w tym tworzenie „Fabryk AI”.

Jednakże, ten ambitny rozwój napotyka na znaczące wyzwania, z których rosnące koszty energii elektrycznej są jednym z najbardziej palących. Polska, pomimo pewnych chwilowych wahań, charakteryzuje się strukturalnie wysokimi hurtowymi cenami energii w porównaniu do innych krajów UE, co jest wynikiem dominacji węgla w miksie energetycznym i wysokich kosztów uprawnień do emisji CO2. Prognozy wskazują, że po okresie zamrożenia cen dla gospodarstw domowych, sektor biznesowy może doświadczyć znaczących wzrostów kosztów, jeśli nie zabezpieczy odpowiednich kontraktów. Ta sytuacja stawia polskie firmy, zwłaszcza te z energochłonną infrastrukturą AI, w niekorzystnej pozycji konkurencyjnej na arenie międzynarodowej.

Analiza wskazuje, że rozwój AI w Polsce stoi przed „potrójną barierą”: wysokimi kosztami energii, deficytem wykwalifikowanej kadry oraz niepewnością regulacyjną. Te czynniki są ze sobą ściśle powiązane i wzajemnie się wzmacniają. Wysokie ceny energii mogą zniechęcać do inwestycji w infrastrukturę, co wpływa na zapotrzebowanie na specjalistów i ogólną atrakcyjność rynku. Brak kadr może utrudniać wdrażanie i optymalizację energooszczędnych rozwiązań, a niejasne regulacje spowalniać innowacje.

Wzrost kosztów energii nie zatrzyma rozwoju AI w Polsce, ale z pewnością go ukształtuje. Firmy będą zmuszone do strategicznego podejścia do zarządzania energią, inwestując w efektywność energetyczną centrów danych (np. chłodzenie cieczą, optymalizacja PUE), oraz w odnawialne źródła energii, często poprzez długoterminowe umowy PPA. Rosnące znaczenie chmury obliczeniowej, oferującej skalowalność i elastyczność kosztową, będzie również wpływać na decyzje inwestycyjne.

Wsparcie rządowe i regulacje unijne, takie jak EU AI Act z wymogami przejrzystości energetycznej, a także inwestycje w modernizację sieci i rozwój OZE, są kluczowe dla stworzenia sprzyjającego środowiska dla AI. Aby Polska mogła utrzymać swoją konkurencyjność i stać się wiodącym hubem AI w Europie, niezbędne jest holistyczne i skoordynowane działanie, które jednocześnie adresuje wyzwania energetyczne, kadrowe i regulacyjne. Tylko w ten sposób możliwe będzie zapewnienie długoterminowego, zrównoważonego i ekonomicznie opłacalnego rozwoju sztucznej inteligencji w kraju.