Eksport usług IT stał się jednym z kluczowych elementów polskiego handlu zagranicznego, znacząco wspierając nadwyżkę w obrotach bieżących kraju. Polska od połowy lat 90. utrzymuje dodatnie saldo w handlu usługami, a w ostatnich latach to właśnie usługi stały się głównym motorem nadwyżki w handlu zagranicznym. Choć największy udział w eksporcie usług mają tradycyjnie transport i turystyka, usługi IT (informatyczne) dynamicznie zwiększają swoje znaczenie. Od 2010 r. eksport usług IT rósł średnio o ponad 20% rocznie – ponad dwukrotnie szybciej niż eksport usług ogółem. W efekcie udział usług informatycznych w polskim eksporcie usług wzrósł z ok. 5% dekadę temu do blisko 13% w 2022 r. Polski sektor IT stał się ważnym motorem gospodarki – w ostatniej dekadzie jego przychody wzrosły niemal czterokrotnie, udział branży w PKB się podwoił, a wartość eksportu usług IT zwiększyła się 7,5-krotnie. Jeszcze dobitniej znaczenie branży widać na arenie międzynarodowej: w 2023 r. Polska sprzedała za granicę więcej usług IT niż takie potęgi technologiczne jak Japonia czy Korea Płd.

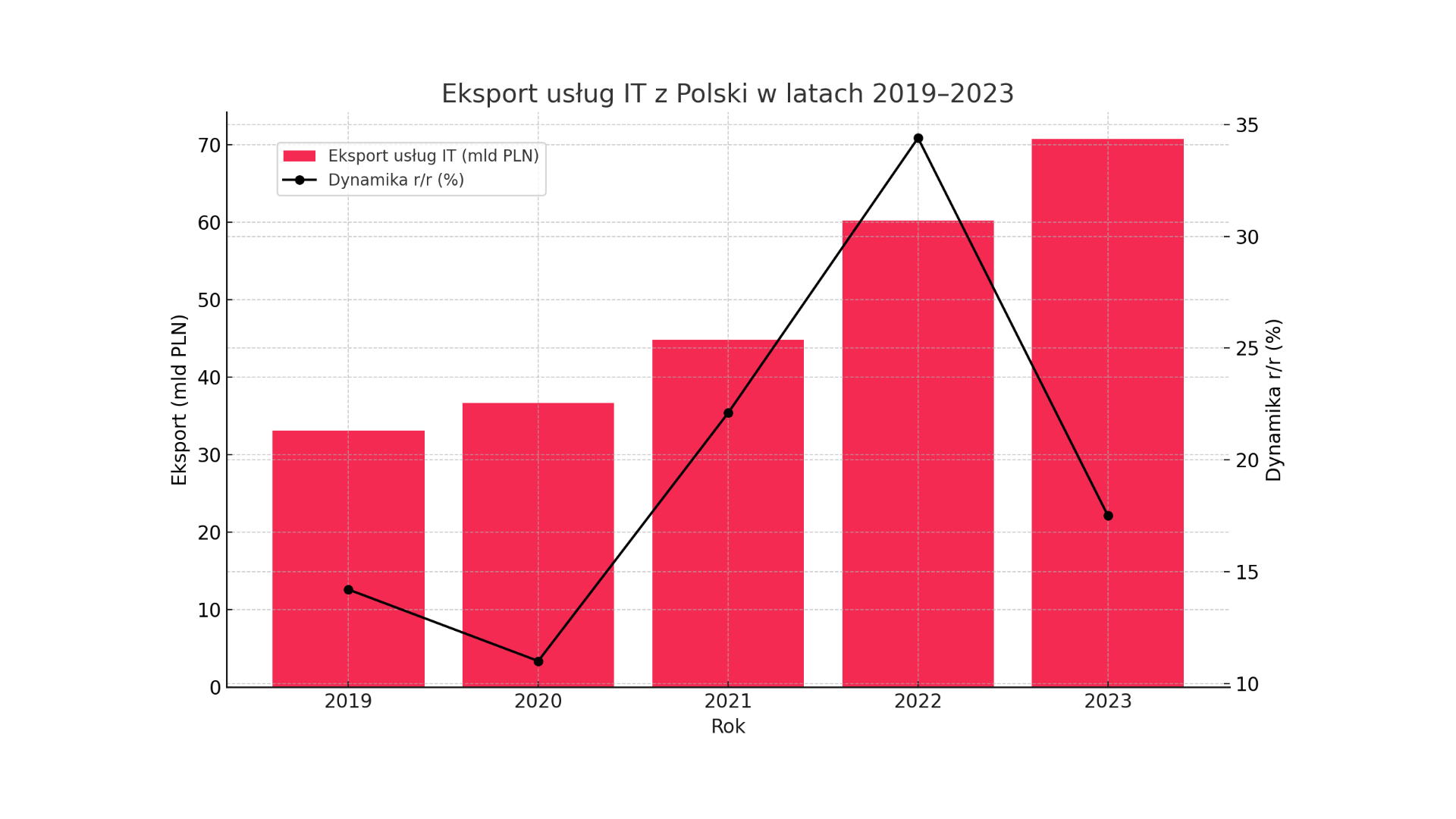

Zarówno dane Narodowego Banku Polskiego, jak i GUS, pokazują wyraźny i nieprzerwany wzrost wartości eksportu usług IT w ostatnich latach. Jak ilustruje powyższy wykres, w 2019 r. eksport usług telekomunikacyjnych, informatycznych i informacyjnych (kategoria łączna w statystykach bilansu płatniczego) wyniósł 33,1 mld zł, by w 2020 r. wzrosnąć do 36,7 mld zł. Mimo globalnego szoku związanego z pandemią COVID-19 odnotowano zatem wzrost o ok. 10,9% r/r, choć było to tempo nieco niższe niż we wcześniejszych latach. Już w 2021 r. nastąpiło jednak przyspieszenie – wartość eksportu usług IT osiągnęła 44,8 mld zł, co oznacza +22,1% r/r. Rok 2022 przyniósł prawdziwy skok: eksport tej kategorii zwiększył się do 60,2 mld zł, aż o 34,4% więcej niż rok wcześniej. Był to najwyższy jak dotąd poziom, co potwierdza, że polski sektor ICT znakomicie wykorzystał światowy boom na usługi cyfrowe w czasie pandemii. W 2023 r. dynamika nieco wyhamowała, jednak nadal była imponująca – eksport usług telekomunikacyjnych, informatycznych i informacyjnych osiągnął 70,7 mld zł, rosnąc o 17,5% w stosunku do 2022 r. W tym ostatnim roku same usługi informatyczne (bez telekomunikacji) stanowiły gros tej kwoty – 64,7 mld zł – co podkreśla, że to właśnie stricte usługi IT napędzają tę kategorię. Sumarycznie, w ciągu zaledwie czterech lat eksport usług IT z Polski ponad dwukrotnie się zwiększył (z ~33 mld zł w 2019 do ~71 mld zł w 2023). Warto zauważyć, że wzrosty te występowały równolegle do ogólnego rozwoju eksportu usług, dzięki czemu udział segmentu ICT w całym eksporcie usług systematycznie rósł. Według danych PFR opartych o Eurostat, na koniec 2022 r. eksport usług informatycznych z Polski wyniósł 11,66 mld EUR (ok. 54 mld zł), a import 7,04 mld EUR, co oznacza znaczącą nadwyżkę. Co ważne, od 2010 r. nie zanotowano ani jednego roku spadku – polskie usługi IT cieszą się rosnącym popytem za granicą. Mimo że transport i turystyka generują większe wolumeny, informatyka stała się najszybciej rosnącym segmentem – średnie tempo wzrostu eksportu usług IT w latach 2011–2021 (22,4% rocznie) ponad dwukrotnie przekraczało tempo wzrostu całego eksportu usług (11,2%). To sprawia, że usługi IT odgrywają coraz większą rolę w bilansie płatniczym. Dla kontekstu, w 2022 r. nadwyżka w handlu usługami osiągnęła rekordowe 171,1 mld zł (5,6% PKB), a same usługi stanowiły największy pozytywny składnik salda obrotów bieżących – dynamiczny eksport IT istotnie się do tego przyczynił.

Geografia eksportu: kluczowe rynki zbytu

Struktura geograficzna eksportu usług IT z Polski koncentruje się wokół wysoko rozwiniętych gospodarek, zwłaszcza z obszaru Europy Zachodniej i Ameryki Północnej. Najważniejszym pojedynczym odbiorcą od lat pozostają Niemcy – ogółem w 2023 r. polscy rezydenci sprzedali do Niemiec usługi (wszystkich typów) warte 100,9 mld zł, z czego znaczącą część stanowiły usługi biznesowe i IT. W segmencie usług informatycznych również Niemcy zajmują pierwszą pozycję. Kolejne kluczowe rynki to Stany Zjednoczone oraz Wielka Brytania, a w Europie kontynentalnej wyróżniają się także Szwajcaria i Holandia jako istotni nabywcy polskich usług cyfrowych. Według danych PFR i ABSL polskie firmy IT sprzedają swoje usługi głównie do Niemiec, USA, Austrii i Wielkiej Brytanii. Wysoka pozycja Niemiec wynika zarówno z bliskości geograficznej i powiązań w ramach UE, jak i obecności wielu centrów IT obsługujących rynek niemiecki. Z kolei znaczący udział USA świadczy o globalnej konkurencyjności polskiego sektora IT – amerykańskie korporacje chętnie zlecają usługi polskim podmiotom lub lokują w Polsce swoje centra technologiczne. W ujęciu regionalnym kraje Unii Europejskiej pozostają głównymi odbiorcami polskich usług ICT. W 2022 r. ok. 55% wartości eksportu usług z kategorii „pozostałe usługi” (obejmującej m.in. IT i usługi biznesowe) trafiło do państw UE. Poza Niemcami istotnymi partnerami w tym obszarze były Szwajcaria (8,7% tej kategorii) oraz Wielka Brytania. Stany Zjednoczone odpowiadały za ok. 15–16% sprzedaży w grupie pozostałych usług w 2022 r., co wskazuje na ich znaczący udział również w popycie na usługi IT. Warto podkreślić, że polskie firmy technologiczne zyskały dobrą renomę na świecie – polscy programiści od lat plasują się w czołówce globalnych rankingów jakości i innowacyjności, co ułatwia ekspansję na rynki zagraniczne. Pomaga to pozyskiwać klientów m.in. w Austrii, krajach nordyckich czy Kanadzie, choć udział tych rynków jest mniejszy. Niemniej, dywersyfikacja geograficzna jest zauważalna – polskie usługi IT trafiają do klientów w dziesiątkach krajów na kilku kontynentach, co zmniejsza zależność od pojedynczego rynku.

Uwarunkowania makroekonomiczne: pandemia, kursy walut, koniunktura

Na trend wzrostowy eksportu usług IT w badanym okresie nałożyły się ważne czynniki makroekonomiczne. Pandemia COVID-19 początkowo wywołała globalną niepewność gospodarczą, lecz sektor IT okazał się relatywnie odporny, a w średnim terminie nawet zyskał na przyspieszeniu cyfryzacji. W 2020 r. wiele przedsiębiorstw na świecie przeniosło działalność do trybu zdalnego i intensywnie inwestowało w rozwiązania IT, co utrzymało popyt na usługi informatyczne z Polski. Rzeczywiście, podczas gdy np. eksport usług turystycznych załamał się w 2020 r., eksport usług IT wciąż wzrósł o ok. 11%. Było to wolniej niż przed pandemią, ale świadczy o odporności branży. Już rok później nastąpiło odbicie – globalna koniunktura IT była bardzo korzystna w latach 2021–2022 z powodu masowych wdrożeń rozwiązań chmurowych, e-commerce, zdalnej pracy czy automatyzacji. Polskie firmy IT, często wyspecjalizowane w tych obszarach, mogły zwiększyć sprzedaż za granicę o wspomniane 22% w 2021 i aż 34% w 2022. Kursy walut odegrały również istotną rolę. Osłabienie złotego wobec dolara i euro w 2022 r. sprawiło, że usługi świadczone w Polsce stały się bardziej konkurencyjne cenowo, a jednocześnie wartość przychodów liczona w złotych wyraźnie wzrosła. Dla przykładu, według NBP eksport usług IT i telekomunikacyjnych w 2022 r. wyniósł 13,4 mld USD (wzrost o ponad 15% r/r w USD), ale po przeliczeniu na złote dynamika przekraczała 30% r/r. Słabszy złoty oznaczał, że za każdego zarobionego dolara firmy otrzymywały więcej PLN, co częściowo tłumaczy rekordowy skok wartości eksportu w tym roku. Z kolei w 2023 r. polska waluta nieco się umocniła i globalny popyt na usługi IT nie rósł już tak gwałtownie, stąd też tempo wzrostu eksportu w PLN ustabilizowało się na niższym poziomie (~17,5% r/r zamiast 34% rok wcześniej).

Warto wspomnieć, że w skali globalnej rok 2023 był trudniejszy dla branży technologicznej – wzrost stóp procentowych i obawy przed recesją skłoniły wiele firm do cięcia wydatków IT, zaś giganty technologiczne notowały spadki wycen i redukcje zatrudnienia. Ta dekoniunktura odbiła się także na polskich firmach usługowych. Jak zauważa raport PKO BP, w 2023 (a dla wielu firm także 2024) nastąpiło spowolnienie przyrostu sprzedaży, eksportu i zatrudnienia w sektorze IT w Polsce. Rosnące koszty, zwłaszcza płacowe, dodatkowo obniżyły rentowność firm. Mimo tych wyzwań polski eksport IT nadal odnotował solidny wzrost w 2023 r., przewyższając dynamikę większości innych branż – świadczy to o trwałym, strukturalnym zapotrzebowaniu na usługi cyfrowe. Dla porównania, u naszego sąsiada – Ukrainy – eksport usług IT spadł w 2023 o 8,4% wskutek wojny i zawirowań gospodarczych. Polska uniknęła spadku, co po części wynika z bezpieczniejszego otoczenia biznesowego, ale też z dywersyfikacji klientów i specjalizacji w usługach wysokiej jakości.

Rola outsourcingu i kapitału zagranicznego

Sukces eksportowy polskiej branży IT jest ściśle powiązany z rolą centrów outsourcingowych oraz inwestycji zagranicznych. Polska od lat jest postrzegana jako atrakcyjna lokalizacja dla outsourcingu IT i usług biznesowych – przyciąga wykwalifikowaną kadrą inżynierską, relatywnie niższymi kosztami pracy w porównaniu z Europą Zachodnią oraz obecnością w UE (co ułatwia kwestie prawne i logistyczne). W praktyce oznacza to, że znaczną część eksportu usług IT generują przedsiębiorstwa powiązane z kapitałem zagranicznym, w tym centra usług wspólnych i oddziały globalnych korporacji technologicznych ulokowane w Polsce. Analizy NBP potwierdzają, że firmy z zagranicznym udziałem kapitałowym dominują w eksporcie większości kategorii usług – w 2022 r. to właśnie podmioty z udziałem inwestorów zagranicznych wypracowały największą nadwyżkę w handlu usługami. Wyjątkiem są nieliczne branże (np. usługi budowlane czy kulturalne) – w sektorze ICT przewaga firm z kapitałem zagranicznym jest wyraźna. Według danych ABSL niemal wszystkie centra usług biznesowych działające w Polsce obsługują klientów zagranicznych. Przykładowo, Capgemini Polska – jeden z największych pracodawców IT – uzyskuje 94% przychodów z obsługi klientów zagranicznych (świadcząc usługi dla odbiorców w 31 krajach), a firma Sii Polska ok. 30% przychodów z eksportu usług. Takie przykłady pokazują, że zagraniczni inwestorzy dostrzegają potencjał Polski i lokują tu zaawansowane procesy. Co istotne, charakter tych inwestycji ewoluuje.

Coraz większą część wzrostu eksportu napędza zjawisko reshoringu, czyli przenoszenia operacji z powrotem do Europy z bardziej odległych lokalizacji. W ostatnich latach obserwujemy, że nowe centra otwierane w Polsce od początku realizują zaawansowane, wysoko wyspecjalizowane zadania, podczas gdy prostsze procesy są automatyzowane lub przekierowywane do tańszych krajów (np. Indie). Świadczy to o rosnącej wartości dodanej polskich usług – nie są to już tylko proste usługi programistyczne, ale często złożone projekty R&D, konsulting IT, usługi chmurowe, cyberbezpieczeństwo itp. Polski sektor IT staje się zatem integralną częścią globalnych łańcuchów wartości. Z jednej strony obecność kapitału zagranicznego gwarantuje dopływ projektów, know-how i stabilne finansowanie, z drugiej – wyzwaniem może być utrzymanie jak największej części zysków i własności intelektualnej w kraju. Niemniej jednak, obecny model wydaje się korzystny dla polskiej gospodarki: zapewnia miejsca pracy (centra IT zatrudniają w Polsce dziesiątki tysięcy specjalistów) oraz stymuluje transfer wiedzy i najlepszych praktyk. Polska umacnia dzięki temu swoją pozycję na globalnym rynku usług IT, czego dowodem są wysokie miejsca w rankingach atrakcyjności lokalizacji dla outsourcingu oraz rosnąca liczba międzynarodowych kontraktów realizowanych nad Wisłą

Polski eksport usług IT w latach 2019–2023 cechował się imponującym wzrostem i odpornością na kryzysy, co potwierdza dojrzałość i konkurencyjność tej branży. Trend jest jednoznacznie wzrostowy – sektor korzysta z globalnej transformacji cyfrowej, a jednocześnie sam napędza krajową gospodarkę, zapewniając rosnące wpływy dewizowe i dodatnie saldo obrotów usługowych. Perspektywy na najbliższe lata są ostrożnie optymistyczne. Po przejściowym spowolnieniu w 2023–2024, wielu analityków oczekuje stopniowej poprawy koniunktury. Prognozy makroekonomiczne wskazują, że w 2025 r. tempo wzrostu PKB w kluczowych dla nas gospodarkach (Niemcy, USA, UK) może być wyższe niż w 2023, co przełoży się na większy popyt na usługi IT. Jednocześnie presja płacowa w Polsce ma nieco zelżeć, a kurs złotego powinien utrzymywać się na poziomie sprzyjającym eksporterom. To wszystko tworzy warunki do utrzymania solidnej dynamiki wzrostu, choć zapewne bliższej kilkunastu niż kilkudziesięciu procent rocznie. Potencjał branży pozostaje duży – rosnąca rola sztucznej inteligencji, chmury obliczeniowej, automatyzacji czy cyberbezpieczeństwa generuje nowe nisze, w których polskie firmy już teraz zdobywają kompetencje.

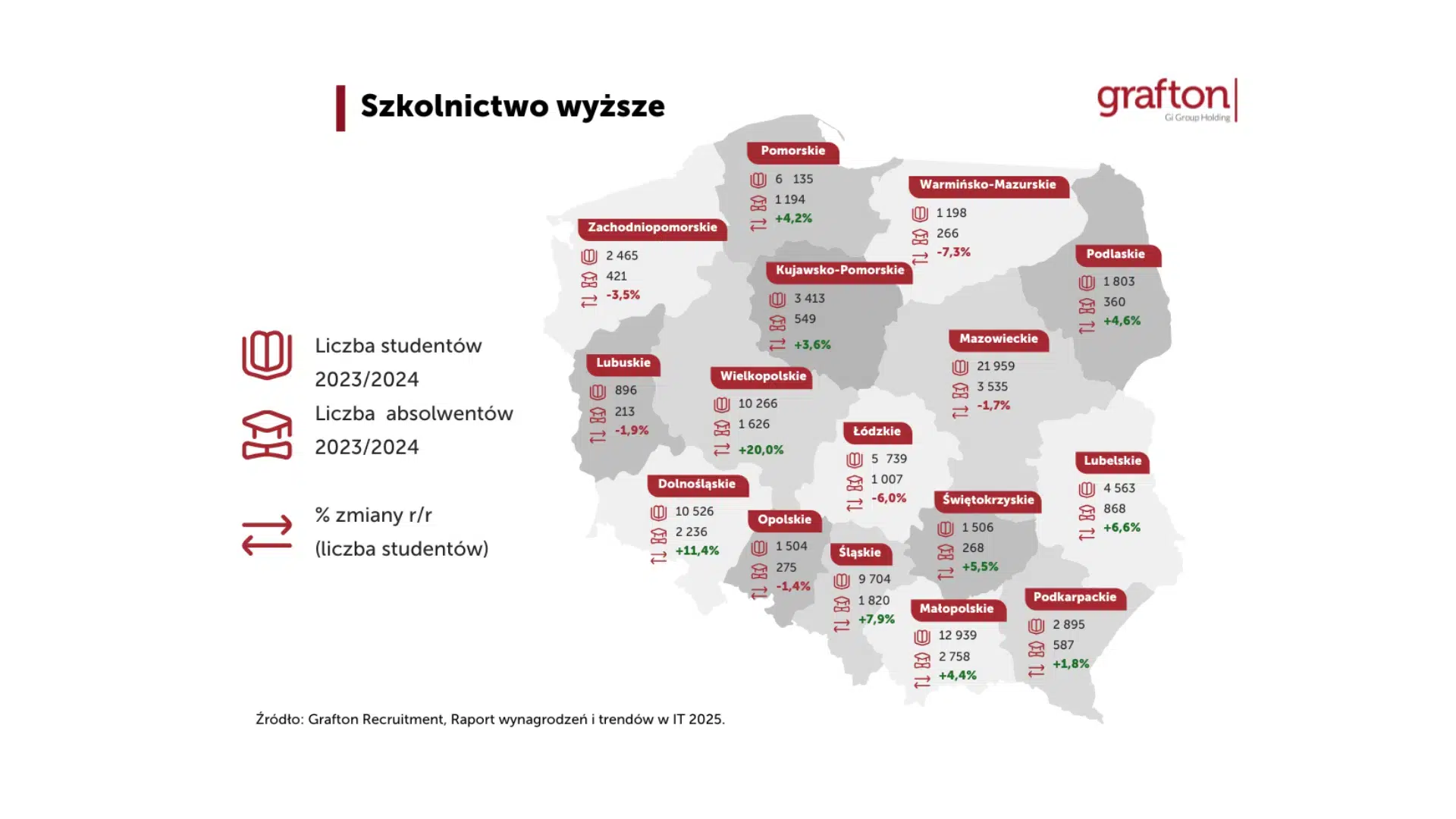

Według szacunków Polskiego Funduszu Rozwoju wartość polskiego sektora ICT (wliczając usługi informatyczne, telekomunikacyjne i usługi z zakresu bezpieczeństwa IT) może wzrosnąć do 25,2 mld EUR do 2026 roku, co wskazuje na kontynuację pozytywnego trendu. Należy jednak pamiętać o czynnikach ryzyka. Ewentualne pogłębienie dekoniunktury w Europie lub USA, nasilona konkurencja ze strony innych centrów outsourcingowych (np. w Azji czy Ameryce Łacińskiej), czy też trudności z dostępem do talentów IT w kraju – to wszystko może ograniczać tempo wzrostu. Dlatego kluczowe będzie inwestowanie w kapitał ludzki (kształcenie i przyciąganie specjalistów) oraz wspieranie innowacji i własnych produktów IT, aby stopniowo przechodzić od modelu czysto usługowego do modelu opartego również na własnej myśli technologicznej. Na chwilę obecną umiarkowane prognozy zakładają utrzymanie się trendów wzrostowych, choć już nie tak spektakularnych jak w szczycie boomu postpandemicznego. Mimo to, biorąc pod uwagę dotychczasowe osiągnięcia, polski sektor usług IT pozostaje jednym z filarów eksportu o strategicznym znaczeniu dla gospodarki. Jeśli uda się zachować konkurencyjność i dalsze zaufanie zagranicznych zleceniodawców, eksport usług IT powinien nadal rosnąć, umacniając pozycję Polski jako europejskiego lidera w branży technologicznej. Z pewnością będzie to obszar warty uważnego obserwowania w kolejnych latach.