Narracja o postępie technologicznym przyzwyczaiła świat do operowania metaforami lekkości. Słowa takie jak „chmura”, „przepływ danych” czy „wirtualna inteligencja” sugerują istnienie sfery niemalże eterycznej, oderwanej od ciężaru materii i brutalnych praw fizyki. Jednak u progu 2026 roku ta cyfrowa iluzja boleśnie zderza się z rzeczywistością hal maszynowych. Okazuje się bowiem, że największą barierą dla rozwoju cywilizacji opartej na algorytmach nie jest brak genialnego kodu, lecz nieubłagana konieczność odprowadzania ciepła. W czasach hiperskalowych data center i procesorów o gęstości mocy wykraczającej poza dotychczasowe standardy, termodynamika staje się kluczowym elementem strategii finansowej oraz nową walutą w globalnym wyścigu o prymat w sektorze AI.

Paradoks cyfrowego żaru

Rynek chłodzenia infrastruktury krytycznej przechodzi obecnie transformację, której skala znajduje odzwierciedlenie w twardych danych ekonomicznych. Przewidywany wzrost wartości tego sektora z poziomu 19,5 miliarda dolarów w 2025 roku do niemal 23 miliardów w roku bieżącym, przy utrzymującym się złożonym rocznym tempie wzrostu wynoszącym 17 procent, stanowi czytelny sygnał dla inwestorów. To gwałtowny przypływ wywołany ewolucją sprzętową. Tradycyjne metody oparte na wymuszonym obiegu powietrza, które przez dekady stanowiły fundament klimatyzacji precyzyjnej, zaczynają przypominać próbę chłodzenia silnika odrzutowego za pomocą papierowego wachlarza.

Przyczyna tego stanu rzeczy jest prozaiczna, a zarazem technologicznie fundamentalna. Nowoczesne akceleratory graficzne i jednostki przetwarzania neuronowego, stanowiące kręgosłup dużych modeli językowych, generują temperatury, przy których powietrze przestaje być efektywnym medium transportującym energię termiczną. W efekcie, branża staje przed koniecznością redefinicji samej architektury obiektu IT. Wyzwanie to dotyczy przede wszystkim ekonomicznej zasadności eksploatacji sprzętu, którego cena nierzadko dorównuje wartości luksusowych nieruchomości.

Nowa geografia chłodu: Perspektywa europejska i imperatyw ESG

W europejskim kontekście gospodarczym kwestia zarządzania ciepłem nabiera dodatkowego, regulacyjnego wymiaru. Podczas gdy w innych regionach świata priorytetem pozostaje czysta moc obliczeniowa, Europa buduje swoją przewagę w oparciu o efektywność i odpowiedzialność. Dyrektywa w sprawie efektywności energetycznej (EED) oraz coraz surowsze wymogi dotyczące raportowania ESG sprawiają, że wskaźnik PUE) staje się dla zarządów korporacji niewiele mniej istotny, co wyniki kwartalne. Rok 2024, zapisany w kronikach jako najcieplejszy w historii obserwacji, uświadomił decydentom, że odporność termiczna data center jest integralnym elementem zarządzania ryzykiem operacyjnym.

Obserwuje się fascynujące zjawisko zmiany postrzegania centrum danych w tkance miejskiej. Zamiast izolowanych, energochłonnych monolitów, powstają obiekty pełniące funkcję „cyfrowych ciepłowni”. W krajach nordyckich czy we Francji, za sprawą innowacji wprowadzanych przez liderów, ciepło odpadowe z serwerów nie jest już traktowane jako uciążliwy produkt uboczny, lecz jako cenny towar. Integracja infrastruktury IT z miejskimi sieciami grzewczymi pozwala na odzyskiwanie energii i zasilanie tysięcy gospodarstw domowych. Taka symbioza przemysłowa nie tylko poprawia profil ekologiczny przedsiębiorstwa, ale generuje wymierne korzyści ekonomiczne, zmieniając strukturę kosztów chłodzenia z pozycji czysto pasywnej na potencjalnie przychodową.

Przemysłowa konwergencja i zmierzch wentylatorów

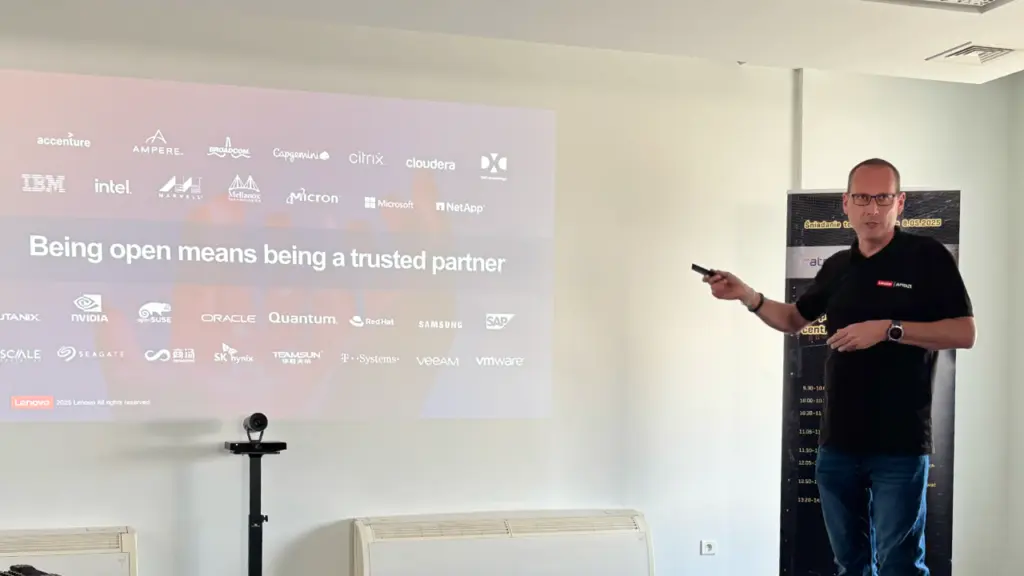

Jednym z najbardziej znamiennych dowodów na dojrzałość i strategiczne znaczenie rynku chłodzenia jest wejście do gry podmiotów tradycyjnie kojarzonych z sektorem wydobywczym i petrochemicznym. Fakt, że ExxonMobil Corporation wprowadza na rynek zaawansowane płyny dielektryczne do chłodzenia zanurzeniowego, świadczy o głębokiej konwergencji branż. Kiedy gigant energetyczny zaczyna projektować chłodziwa dla procesorów, staje się jasne, że chłodzenie cieczą stało się nowym paradygmatem korporacyjnym.

Technologia chłodzenia immersyjnego, polegająca na całkowitym zanurzeniu elektroniki w chemicznie obojętnym płynie, oferuje korzyści, obok których żaden dyrektor finansowy nie może przejść obojętnie. Możliwość redukcji całkowitego kosztu posiadania o blisko 40 procent wynika z radykalnego uproszczenia infrastruktury. Rezygnacja z ogromnych agregatów chłodniczych, skomplikowanych systemów nawiewnych i kosztownego utrzymywania czystości powietrza pozwala na drastyczne zwiększenie gęstości upakowania serwerów. W tej nowej rzeczywistości mniejsza powierzchnia serwerowni może oferować wielokrotnie większą moc obliczeniową, co wobec rosnących cen gruntów i ograniczonych przydziałów mocy energetycznej w hubach takich jak Frankfurt czy Londyn, stanowi o „być albo nie być” wielu inwestycji.

Konsolidacja rynku, przejawiająca się chociażby w przejęciu CoolTera przez Vertiv, potwierdza trend dążenia do kompleksowości. Współczesny biznes poszukuje zintegrowanych systemów zarządzania ciepłem, które są w stanie adaptować się do zmiennego obciążenia generowanego przez AI w czasie rzeczywistym. Inteligentne monitorowanie termiczne pozwala na dynamiczne przesuwanie zasobów i zapobieganie awariom zanim systemy bezpieczeństwa odnotują przekroczenie krytycznych parametrów.

Chłodna kalkulacja: ROI ukryte w przepływach

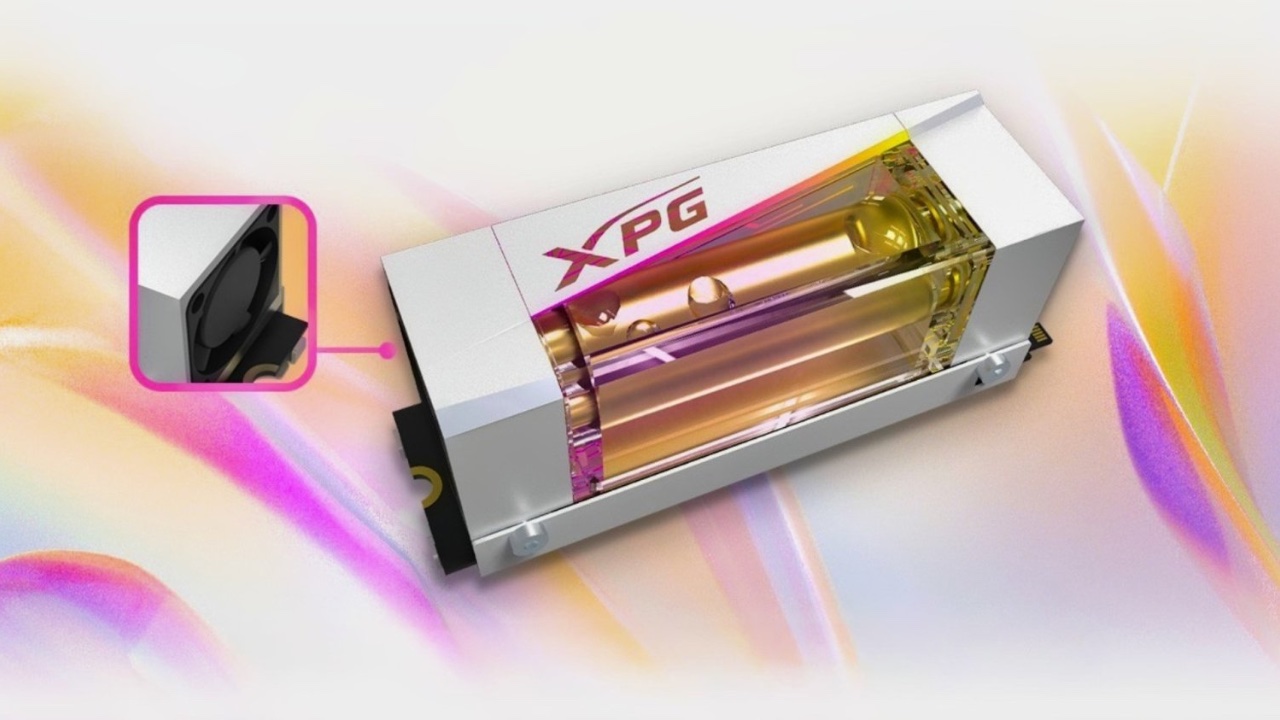

Analiza zwrotu z inwestycji w nowoczesne systemy chłodzenia wymaga wyjścia poza prosty horyzont czasowy jednego roku podatkowego. Choć nakłady kapitałowe na technologie cieczowe mogą wydawać się wyższe od tradycyjnych rozwiązań, ich wpływ na żywotność sprzętu IT jest nie do przecenienia. Brak wibracji generowanych przez tysiące wentylatorów, eliminacja korozji wywołanej wilgotnością powietrza oraz stabilność temperaturowa sprawiają, że kosztowne układy krzemowe mogą pracować dłużej i wydajniej. Przedłużenie cyklu życia infrastruktury staje się istotnym atutem strategicznym zwłaszcza, gdy dostępność najnowszych chipów jest ograniczona przez łańcuchy dostaw.

Należy również zwrócić uwagę na aspekt operacyjny związany z samą gęstością obliczeniową. Nowoczesne centra danych projektowane pod kątem AI muszą być gotowe na obsługę szaf serwerowych pobierających nawet 100 kW mocy. Przy takich parametrach tradycyjne chłodzenie powietrzem po prostu fizycznie nie mieści się w hali maszynowej – wymagałoby ono kanałów wentylacyjnych o przekrojach uniemożliwiających efektywne zagospodarowanie przestrzeni. Chłodzenie cieczą pozwala zatem na realizację projektów, które w starym modelu byłyby technicznie niewykonalne.

Intelekt potrzebuje spokoju

Można zaryzykować stwierdzenie, że przyszłość sztucznej inteligencji wykuwa się nie tylko w laboratoriach programistycznych, ale przede wszystkim w ciszy zanurzonych w cieczy serwerowni. Rynek, który do 2030 roku ma osiągnąć wartość blisko 43 miliardów dolarów, nie jest już tylko zapleczem dla branży IT, lecz jej istotnym akceleratorem.

Płynie stąd lekcja o konieczności przewartościowania fundamentów infrastrukturalnych z perspektywy liderów biznesu. Najpotężniejszy cyfrowy intelekt potrzebuje do pracy warunków, jakie zapewnia mu jedynie zaawansowana inżynieria cieplna. Chłodny spokój procesorów staje się gwarantem ciągłości biznesowej i kluczem do rentowności.

Pozostaje zatem pytanie o stopień przygotowania obecnych strategii infrastrukturalnych na nadchodzące lata. Czy uwzględniają one fakt, że w cyfrowym świecie najwyższą formą wyrafinowania staje się obecnie umiejętność zachowania niskiej temperatury w najbardziej gorących momentach technologicznej rewolucji? Odpowiedź na to pytanie zdefiniuje układ sił w gospodarce nadchodzącej dekady.