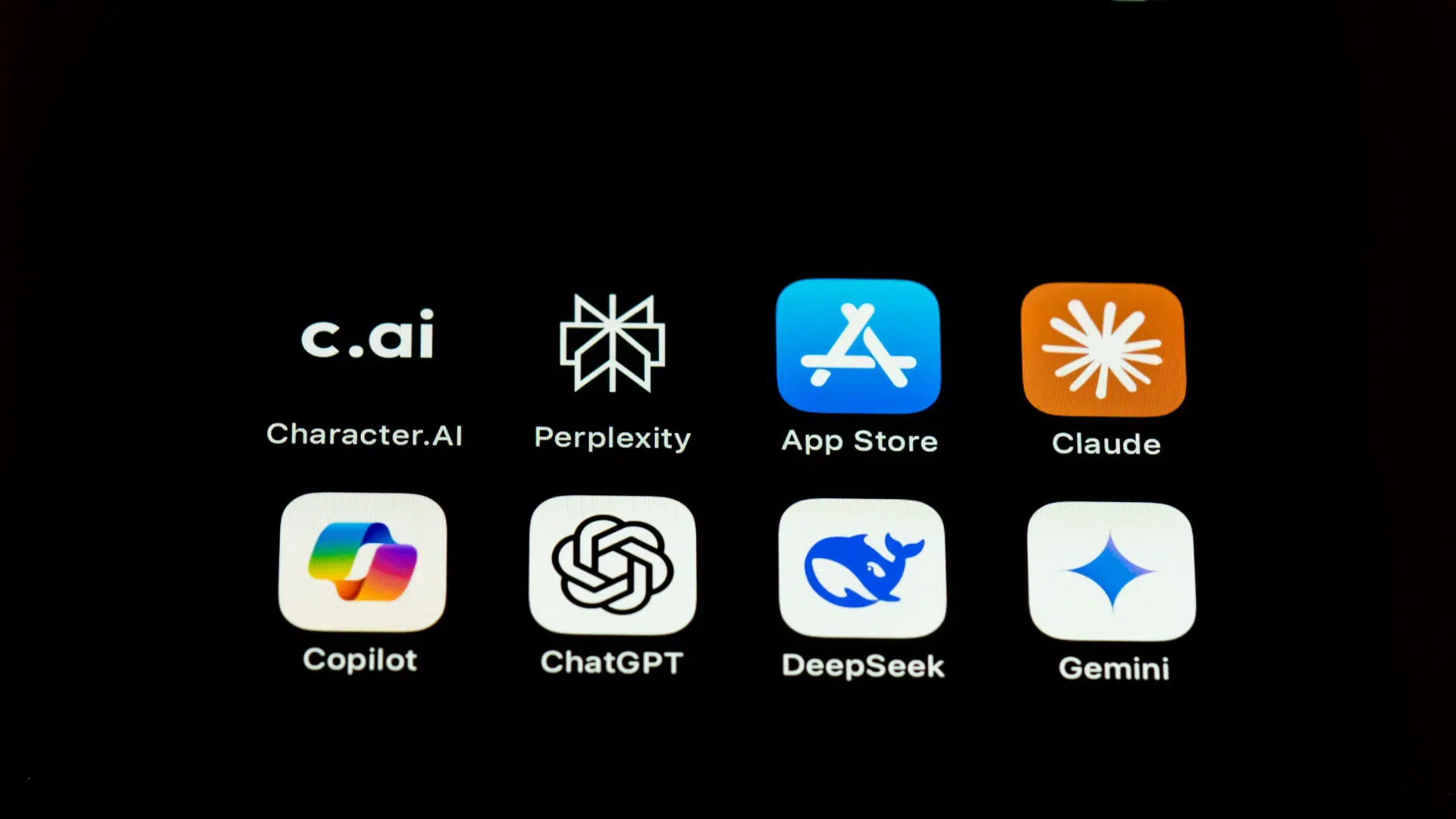

Wprowadzenie DeepSeek na rynek sztucznej inteligencji wywołało poruszenie nie tylko w kręgach technologicznych, ale również geopolitycznych. OpenAI, które od lat dominowało w sektorze generatywnej AI dzięki takim narzędziom jak ChatGPT i DALL-E, musi teraz zmierzyć się z nowym rywalem, który nie tylko osiągnął porównywalne wyniki, ale także postawił na pełną transparentność poprzez udostępnienie kodu źródłowego na licencji MIT.

Nowy gracz z Azji zmienia zasady gry

DeepSeek, będący flagowym produktem chińskich inżynierów, stał się symbolem rosnących ambicji Państwa Środka w dziedzinie nowoczesnych technologii. Model ten, dzięki swojej otwartości, zyskał ogromne wsparcie ze strony społeczności developerów na całym świecie. W przeciwieństwie do zamkniętej struktury OpenAI, DeepSeek stawia na współpracę i otwartość, co może przyciągnąć talenty oraz inwestycje, które wcześniej były zarezerwowane dla amerykańskich gigantów.

Geopolityczne implikacje rywalizacji

Pojawienie się DeepSeek ma nie tylko wymiar technologiczny, ale również geostrategiczny. Sukces chińskiego modelu może wskazywać na wzrastającą zdolność Chin do konkurowania z USA w kluczowych dziedzinach technologii. W kontekście narastającej rywalizacji między supermocarstwami, rozwój sztucznej inteligencji staje się kolejnym polem bitwy, w którym nie chodzi jedynie o innowacje, ale również o wpływy globalne i narodowe bezpieczeństwo.

Reakcja OpenAI na nowe wyzwania

Podczas sesji AMA na Reddicie, dyrektor generalny OpenAI, Sam Altman, nie unikał trudnych pytań. Przyznał, że pojawienie się DeepSeek zmusiło firmę do ponownego przemyślenia swojej strategii. Jednym z kluczowych wniosków było zrozumienie, że zamknięta struktura może ograniczać rozwój i adaptację technologii. Altman zaznaczył, że choć OpenAI nadal planuje rozwijać nowe, potężniejsze modele, to przewaga, którą cieszyła się firma w przeszłości, może już nie być tak wyraźna.

Przyszłość rywalizacji na rynku AI

Konkurencja z DeepSeek stawia przed OpenAI dylematy nie tylko technologiczne, ale również etyczne i biznesowe. Czy firma zdecyduje się na większą otwartość, aby sprostać rosnącym wymaganiom rynku i uniknąć utraty zaufania? Jakie będą dalsze kroki w rywalizacji z chińskim gigantem, który już teraz zyskał przychylność międzynarodowej społeczności naukowej? Jedno jest pewne – OpenAI nie może już liczyć na status niekwestionowanego lidera w branży, a przyszłość technologii AI będzie zależała od zdolności adaptacji i otwartości na współpracę.

Kwestia open source – strategiczny zwrot czy konieczność?

Jednym z najbardziej palących tematów w dyskusji na Reddicie była polityka OpenAI wobec otwartego oprogramowania. Od początku swojej działalności firma balansowała między ideą otwartości a koniecznością ochrony własności intelektualnej i bezpieczeństwa swoich modeli. W przeszłości OpenAI udostępniał część swoich technologii, jednak w ostatnich latach skupił się na zamkniętych rozwiązaniach. Wprowadzenie DeepSeek, opartego na otwartym kodzie źródłowym na licencji MIT, ponownie postawiło OpenAI przed trudnym wyborem – kontynuować strategię zamkniętego ekosystemu czy podjąć bardziej otwarte podejście?

DeepSeek wywiera presję

Model DeepSeek wywołał nową falę dyskusji na temat otwartości AI. Jego kod jest dostępny publicznie, co oznacza, że każdy – od startupów po duże firmy technologiczne – może wykorzystać i dostosować jego możliwości do własnych potrzeb. To kontrastuje z modelem OpenAI, który chroni swój kod jako własność intelektualną i udostępnia jedynie API, co oznacza, że użytkownicy nie mają pełnej kontroli nad technologią.

Sam Altman przyznał, że OpenAI mogło popełnić błąd, zamykając swoje modele, i że przyszłość może wymagać bardziej otwartego podejścia. Jednak dodał również, że nie jest to obecnie priorytet firmy. Wskazał, że w OpenAI trwają wewnętrzne dyskusje na ten temat, a opinie w zarządzie są podzielone. Jedną z możliwości rozważanych przez firmę jest udostępnienie starszych modeli, które nie stanowią już technologicznej przewagi, w otwartym kodzie.

Czy AI powinna ujawniać swoje myślenie?

Jednym z najbardziej intrygujących wątków, które pojawiły się podczas sesji AMA z zespołem OpenAI, była kwestia przejrzystości działania modeli AI – w szczególności ujawniania tzw. „łańcucha myśli” (ang. chain of thought). Obecnie większość zaawansowanych modeli sztucznej inteligencji, w tym ChatGPT, działa na zasadzie czarnej skrzynki – użytkownicy widzą tylko efekt końcowy, ale nie mają dostępu do logiki i procesów decyzyjnych, które doprowadziły do danego wyniku. DeepSeek, chiński konkurent OpenAI, zaprezentował innowacyjne podejście – jego model R1 pokazuje pełen proces myślowy, co rodzi pytania o przyszłość przejrzystości w AI.

DeepSeek wprowadził nową jakość do świata sztucznej inteligencji, oferując system, który może ujawniać kolejne etapy swojego rozumowania. W praktyce oznacza to, że użytkownik może śledzić, w jaki sposób model dochodzi do danego wniosku, jakie kroki podejmuje i na jakich przesłankach się opiera. Takie podejście ma kilka kluczowych zalet:

Większa wiarygodność – użytkownicy mogą ocenić, czy odpowiedzi AI są oparte na logicznym wnioskowaniu, czy też zawierają błędy lub uprzedzenia.

Poprawa bezpieczeństwa – jeśli model zaczyna generować niepożądane lub błędne wyniki, można przeanalizować, na jakim etapie popełnił błąd i wprowadzić poprawki.

Lepsze zrozumienie przez ludzi – systemy AI stają się bardziej zrozumiałe, co może ułatwić ich wdrażanie w sektorach wymagających transparentności, takich jak prawo, medycyna czy finanse.

Dlaczego OpenAI ukrywa „proces myślowy” modeli?

Sam Altman oraz Kevin Weil przyznali, że OpenAI również pracuje nad mechanizmami zwiększającymi transparentność modeli, ale podkreślili, że nie jest to priorytet firmy. Obecnie modele OpenAI są zaprojektowane w taki sposób, aby ukrywać szczegóły swojego działania. Taka strategia wynika z kilku powodów:

- Ochrona przed konkurencją – gdyby OpenAI zaczęło ujawniać pełen proces myślowy swoich modeli, mogłoby to ułatwić konkurencji zrozumienie i skopiowanie metod szkolenia. Jest to kluczowe w wyścigu o dominację w branży AI, gdzie przewaga technologiczna może szybko zniknąć.

- Zapobieganie nadużyciom – niektóre firmy obawiają się, że ujawnienie „łańcucha myśli” AI może pozwolić na manipulowanie modelami w niepożądany sposób. Jeśli użytkownicy zobaczą, jak AI podejmuje decyzje, mogą znaleźć sposoby na oszukanie systemu lub wykorzystanie go do nieetycznych celów, np. generowania fałszywych informacji czy oszustw finansowych.

- Brak jednoznacznych korzyści dla użytkowników – OpenAI argumentuje, że większość użytkowników nie potrzebuje wglądu w szczegóły działania modeli AI. W praktyce osoby korzystające z ChatGPT czy DALL-E chcą po prostu uzyskać dobre odpowiedzi, a nie analizować proces ich powstawania.

Mimo że OpenAI na razie nie deklaruje pełnej zmiany podejścia, Altman i Weil przyznali, że firma rozważa wprowadzenie nowych funkcji zwiększających przejrzystość modeli. Możliwe jest, że przyszłe wersje ChatGPT będą oferować opcjonalne wyjaśnienia dla niektórych odpowiedzi, co mogłoby stanowić kompromis między pełnym „łańcuchem myśli” a obecnym, zamkniętym podejściem.

Jednak wciąż otwartym pytaniem pozostaje, jak przejrzystość AI wpłynie na rynek i zaufanie użytkowników. Jeśli DeepSeek odniesie sukces dzięki swojej transparentności, może to wymusić na OpenAI i innych firmach większą otwartość. W przeciwnym razie modele pozostaną „czarnymi skrzynkami”, a użytkownicy będą musieli zaufać, że ich odpowiedzi są poprawne, bez możliwości pełnej weryfikacji procesu ich powstawania.

Bez względu na przyszłe decyzje, jedno jest pewne – konkurencja w sektorze AI nie toczy się już tylko o jakość modeli, ale także o to, na ile powinny one być otwarte i transparentne dla użytkowników.

Kwestia kosztów i przyszłość ChatGPT

ChatGPT, flagowy produkt OpenAI, zdobył ogromną popularność zarówno wśród użytkowników indywidualnych, jak i firm. Jednak coraz częściej pojawiają się pytania o przyszłość modelu – zarówno pod względem kosztów, jak i dalszego rozwoju. Podczas sesji AMA na Reddicie Sam Altman oraz Kevin Weil odnieśli się do tych kwestii, rozwiewając niektóre obawy, ale pozostawiając otwarte pytania dotyczące strategii firmy.

Czy ceny ChatGPT wzrosną?

Jednym z najważniejszych tematów poruszonych w dyskusji były potencjalne podwyżki cen dostępu do ChatGPT. OpenAI oferuje zarówno darmową wersję chatbota, jak i płatne subskrypcje – w tym ChatGPT Plus za 20 dolarów miesięcznie oraz zaawansowany plan Pro, który kosztuje 200 dolarów miesięcznie.

Pojawiły się spekulacje, że ceny mogą wzrosnąć, szczególnie w obliczu rosnących kosztów obliczeniowych i zapotrzebowania na moc obliczeniową. Altman stanowczo zaprzeczył tym doniesieniom, twierdząc, że jego celem jest raczej obniżenie kosztów dla użytkowników, jeśli pozwolą na to warunki finansowe i infrastrukturalne.

„Chciałbym, aby ChatGPT był tańszy z czasem” – powiedział Altman. Jednak jednocześnie dodał, że OpenAI obecnie ponosi straty na najbardziej zaawansowanym planie Pro. Wysokie koszty generowania odpowiedzi przez zaawansowane modele, takie jak GPT-4 Turbo, sprawiają, że użytkownicy korzystający z subskrypcji za 200 dolarów miesięcznie otrzymują produkt poniżej rzeczywistego kosztu dostarczania tej usługi.

Problematyka kosztów obliczeniowych

Kluczowym problemem, który wpływa na ceny usług OpenAI, jest ogromne zapotrzebowanie na moc obliczeniową. Modele językowe, takie jak GPT-4, wymagają setek tysięcy procesorów graficznych (GPU) i serwerów, co generuje gigantyczne koszty operacyjne. Firma inwestuje miliardy dolarów w infrastrukturę, a jej największym projektem w tym zakresie jest Stargate – potężne centrum danych, które ma kosztować nawet 500 miliardów dolarów.

„Obsłużenie rosnącej bazy użytkowników zwiększa również zapotrzebowanie na komputery w ramach OpenAI”, zauważył Weil, odnosząc się do potrzeby budowy kolejnych centrów danych. OpenAI współpracuje z Microsoftem, który dostarcza infrastrukturę chmurową w ramach usługi Azure AI, jednak nawet ten sojusz nie rozwiązuje problemu stale rosnących kosztów.

Konkurencja nie ułatwia sytuacji. Modele takie jak DeepSeek, które są projektowane w sposób bardziej efektywny pod względem obliczeniowym, mogą z czasem okazać się tańszą alternatywą. Chińscy naukowcy optymalizują swoje systemy tak, aby działały sprawniej i zużywały mniej energii – co w dłuższej perspektywie może dać im przewagę nad OpenAI.

Czy OpenAI rozważa nowe modele subskrypcji?

W kontekście rosnących kosztów i potrzeb inwestycyjnych OpenAI może rozważać nowe sposoby monetyzacji. Możliwe, że w przyszłości pojawią się dodatkowe poziomy subskrypcji, dostosowane do różnych grup użytkowników. Spekuluje się również o wprowadzeniu wersji premium dla firm, które pozwoliłyby na lepsze dostosowanie modelu AI do konkretnych potrzeb biznesowych.

Potencjalne opcje monetyzacji obejmują:

- Nowe plany dla firm i deweloperów – bardziej elastyczne pakiety dla korporacji, które wymagają dostępu do dedykowanych modeli i większej ilości zapytań.

- Mikropłatności za dostęp do zaawansowanych funkcji – OpenAI może wprowadzić opłaty za generowanie bardziej złożonych treści, np. kodu programistycznego lub szczegółowych analiz.

- Obniżenie ceny wersji Plus i wprowadzenie tańszej subskrypcji – aby przyciągnąć szerszą bazę klientów i zmonetyzować użytkowników, którzy do tej pory korzystali tylko z darmowej wersji.

Czy darmowa wersja ChatGPT przetrwa?

Jednym z głównych atutów OpenAI jest możliwość korzystania z ChatGPT za darmo, choć w ograniczonym zakresie. Wiele osób obawia się, że w miarę wzrostu kosztów utrzymania infrastruktury, firma może zrezygnować z darmowego dostępu lub wprowadzić większe ograniczenia dla użytkowników niezarejestrowanych.

Na ten moment OpenAI nie zapowiada likwidacji darmowej wersji, ale nie można wykluczyć zmian. Możliwe, że darmowe użytkowanie będzie coraz bardziej ograniczane w czasie (np. mniejsza liczba zapytań dziennie) lub dostępne tylko do starszych wersji modeli, podczas gdy najnowsze rozwiązania pozostaną wyłącznie dla płatnych subskrybentów.

Koszty działania AI rosną, a OpenAI stoi przed dylematem: czy obniżyć ceny i szukać nowych źródeł finansowania, czy też podnieść opłaty i ryzykować odpływ użytkowników? Konkurencja ze strony DeepSeek i innych open-source’owych modeli może dodatkowo wymusić przemyślenie strategii cenowej.

Co dalej? GPT-5 i nowe modele AI

Podczas sesji AMA na Reddicie jednym z najczęściej zadawanych pytań było: „Kiedy zobaczymy GPT-5?” oraz „Co dalej z generatywną sztuczną inteligencją OpenAI?”. Odpowiedzi, choć nieco enigmatyczne, potwierdzają, że firma aktywnie pracuje nad kolejną generacją modeli, ale nie zamierza się spieszyć z ich premierą.

Sam Altman, CEO OpenAI, przyznał, że firma pracuje nad nową wersją swojego flagowego modelu językowego, jednak nie podał żadnych szczegółowych dat premiery. W kontekście tego, że GPT-4 pojawił się w marcu 2023 roku, a jego ulepszona wersja, GPT-4 Turbo, została ogłoszona w listopadzie 2023, wielu użytkowników liczyło na zapowiedź GPT-5 na początku 2024 roku. Jednak w obliczu rosnącej konkurencji oraz pojawienia się DeepSeek, strategia OpenAI może ulec zmianie.

Altman zapowiedział, że „warto czekać”, co sugeruje, że kolejna iteracja modelu może być znaczącym krokiem naprzód, a nie jedynie ulepszeniem obecnej technologii. Możliwe scenariusze dla GPT-5 obejmują:

- Znaczącą poprawę zdolności rozumowania i „myślenia” – obecne modele wciąż mają ograniczenia w zakresie długoterminowej koherencji, logicznego wnioskowania i głębszego rozumienia kontekstu. OpenAI prawdopodobnie dąży do rozwiązania tych problemów.

- Większą efektywność obliczeniową – rosnące koszty utrzymania modeli sprawiają, że firma będzie starała się zoptymalizować ich działanie, tak aby były szybsze i mniej wymagające pod względem zasobów sprzętowych.

- Lepszą pamięć długoterminową – obecne modele często „zapominają” kontekst rozmowy po określonej liczbie tokenów. GPT-5 może wprowadzić mechanizmy pozwalające na bardziej zaawansowane zapamiętywanie informacji przez dłuższy czas.

- Większą personalizację – OpenAI eksperymentuje z opcjami dostosowania modeli do indywidualnych potrzeb użytkowników, co może stać się kluczową funkcją w przyszłych wersjach.

Co z DALL·E i innymi modelami OpenAI?

Obok GPT-5, OpenAI rozwija również swoje modele do generowania obrazów. DALL·E 3, obecnie dostępny w ChatGPT Plus, jest już wykorzystywany przez miliony użytkowników, ale pozostaje w tyle za niektórymi konkurencyjnymi rozwiązaniami, takimi jak Midjourney czy Stability AI.

Podczas sesji AMA pytano, czy OpenAI zamierza przyspieszyć rozwój swojego modelu do generowania obrazów. Altman i Weil potwierdzili, że prace nad kolejną wersją trwają, ale nie podali konkretnej daty premiery. Możliwe, że przyszły model będzie bardziej konkurencyjny dzięki:

- Lepszej rozdzielczości i jakości generowanych obrazów,

- Większej kontroli nad stylami i edycją,

- Integracji z innymi modelami OpenAI, np. połączenie z GPT-5 w celu tworzenia bardziej interaktywnych doświadczeń.

Oprócz tego OpenAI intensywnie pracuje nad modelami audio i wideo, co może wskazywać na plany ekspansji w kierunku bardziej kompleksowej generatywnej sztucznej inteligencji.

Innym istotnym tematem jest rozwój tzw. „modeli rozumowania” (ang. reasoning models). Wprowadzenie DeepSeek R1, który ujawnia swój „łańcuch myśli”, wywołało dyskusję na temat tego, czy przyszłe modele OpenAI powinny robić to samo. Obecnie OpenAI pracuje nad nowymi metodami, które pozwolą lepiej prezentować użytkownikom proces wnioskowania AI, ale bez całkowitego otwarcia modelu.

Kevin Weil zasugerował, że kolejne wersje AI mogą oferować opcję śledzenia niektórych etapów procesu decyzyjnego, co stanowi kompromis między pełną przejrzystością a ochroną technologii OpenAI przed konkurencją.

Czy OpenAI straci prowadzenie?

Obecnie OpenAI jest liderem w branży generatywnej AI, ale presja konkurencji, rosnące koszty i rozwój open-source’owych modeli stawiają przed firmą poważne wyzwania. Jeśli GPT-5 nie przyniesie rewolucyjnych zmian, a DeepSeek i inne modele open-source’owe zyskają popularność, OpenAI może znaleźć się w trudnej sytuacji.

Altman i zespół OpenAI są świadomi tej rywalizacji, dlatego firma inwestuje miliardy dolarów w projekty takie jak Stargate, który ma zapewnić OpenAI wystarczającą moc obliczeniową do dalszego rozwoju. Jednak pytanie pozostaje – czy OpenAI faktycznie utrzyma swoją przewagę, czy też nadchodzące modele konkurencji zmienią układ sił w branży?

Podsumowując, przyszłość OpenAI i ChatGPT będzie zależeć od kilku kluczowych czynników:

- Data premiery i możliwości GPT-5 – jeśli model zaoferuje przełomowe innowacje, OpenAI może utrzymać dominującą pozycję.

- Optymalizacja kosztów i infrastruktury – aby nadal oferować usługi na dużą skalę, firma musi znaleźć sposób na obniżenie kosztów działania AI.

- Kwestia open source i przejrzystości AI – jeśli DeepSeek i inne modele open-source zdobędą popularność, OpenAI może zostać zmuszony do większej otwartości.

- Rywalizacja z chińskimi modelami – coraz lepsze modele z Azji, które są efektywniejsze i bardziej dostępne, mogą stanowić realne zagrożenie dla OpenAI.

Jedno jest pewne – przyszłe miesiące będą kluczowe dla dalszej strategii OpenAI. Firma może albo utrzymać swoją przewagę, inwestując w innowacje i optymalizację kosztów, albo stanąć w obliczu rosnącej konkurencji, która coraz szybciej zbliża się do jej pozycji lidera.