Firmy inwestują w AI z nadzieją, że usprawni ona przeciążone zespoły bezpieczeństwa. I choć widać już pierwsze efekty, zaufanie do autonomii maszyn pozostaje niskie. Raport Splunk State of Security 2025 pokazuje, że AI działa najlepiej jako wsparcie – nie jako dowódca. Co to oznacza dla przyszłości operacji bezpieczeństwa?

Realia przeciążonego SOC

W teorii Centra Operacji Bezpieczeństwa (SOC) mają stać na pierwszej linii obrony przed cyberzagrożeniami. W praktyce coraz częściej przypominają straż pożarną bez wody – przeciążone, niedoinwestowane i zdominowane przez technologię, która zamiast pomagać, zaczyna wymagać opieki.

Z raportu Splunk State of Security 2025 wyłania się wyraźny obraz: zespoły ds. bezpieczeństwa są przeciążone zadaniami, które tylko z pozoru służą ochronie. 46% menedżerów IT przyznaje, że więcej czasu poświęcają na utrzymanie swoich narzędzi niż na realną obronę. Większość pracuje z rozproszonymi, niezintegrowanymi systemami, co skutkuje nie tylko zmęczeniem alarmowym (59% zgłasza zbyt dużą liczbę powiadomień), ale też spadkiem skuteczności całego SOC.

W tym kontekście wiele firm zwraca się ku sztucznej inteligencji, licząc, że odciąży zespoły i usprawni reakcję na incydenty. Ale zaufanie do AI, jak pokazują dane, to zupełnie inna historia.

Obietnice AI w cyberbezpieczeństwie: wydajność, skalowalność, automatyzacja

Wzrost złożoności środowisk IT sprawia, że zespoły bezpieczeństwa operują w stanie permanentnego przeciążenia. W obliczu niedoborów personelu i rozdrobnionych systemów, sztuczna inteligencja pojawia się jako rozwiązanie z obietnicą ulgi: szybciej analizować dane, redukować hałas informacyjny, wspierać w podejmowaniu decyzji.

I rzeczywiście, dane z raportu Splunk Security 2025 potwierdzają, że AI zaczyna działać. 59% badanych firm zauważyło poprawę wydajności po wdrożeniu rozwiązań opartych na sztucznej inteligencji. Ale to nie pełna automatyzacja, tylko przyspieszenie wybranych procesów — głównie tam, gdzie liczy się szybkość korelacji danych, a nie głęboka analiza kontekstu.

Największy potencjał? Tam, gdzie AI może operować na dobrze ustrukturyzowanych danych i powtarzalnych wzorcach:

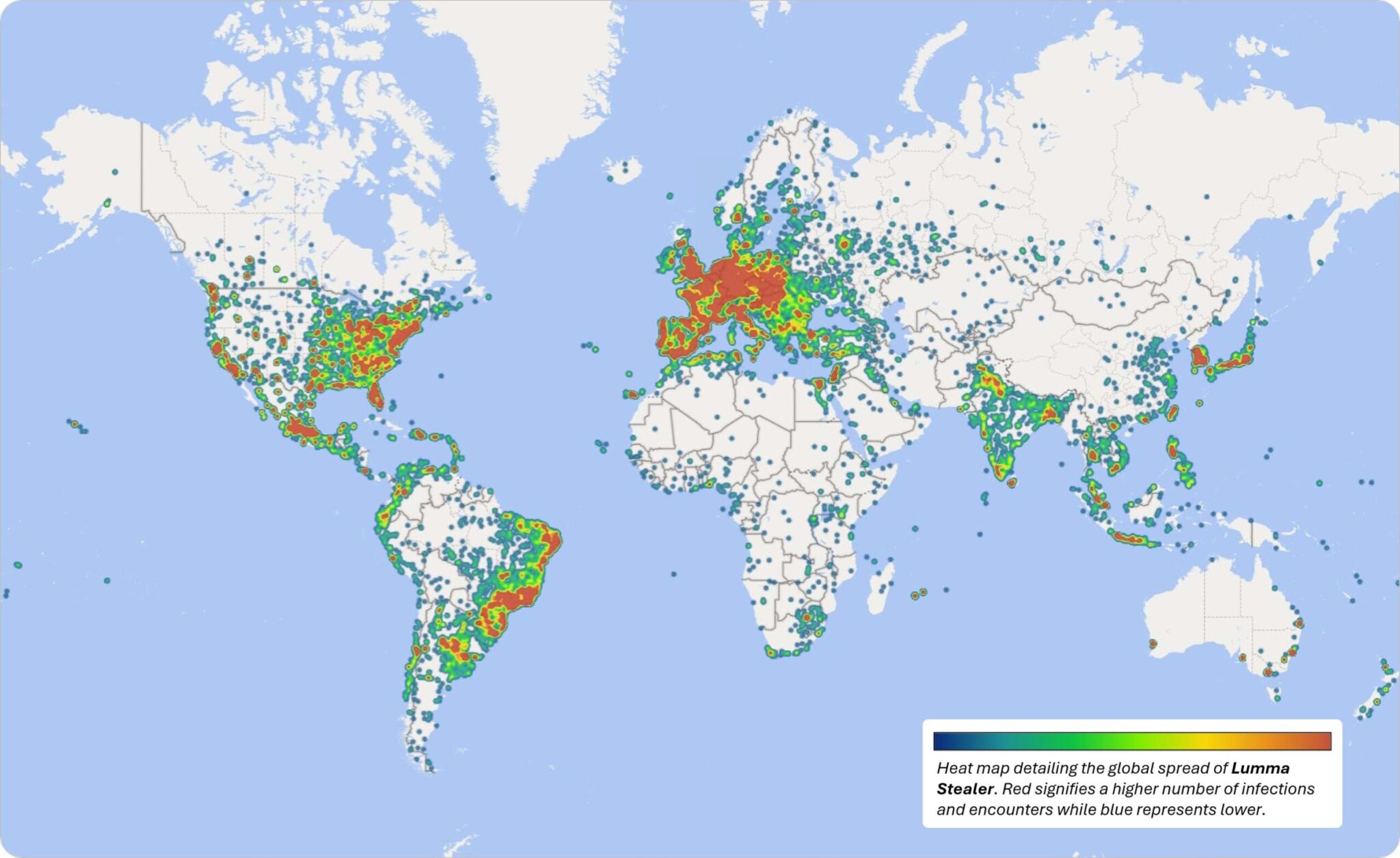

- 33% firm wykorzystuje AI do analizy informacji o zagrożeniach,

- 31% do przetwarzania zapytań dotyczących danych istotnych dla bezpieczeństwa,

- 29% do rozwoju i dostosowywania polityk bezpieczeństwa.

Co istotne, organizacje wyraźnie różnicują skuteczność narzędzi: aż 63% uznaje, że domenowo wyspecjalizowana AI — zaprojektowana z myślą o bezpieczeństwie — daje wyraźnie większe korzyści niż ogólne modele.

Jak pokazują dane, większość firm nie traktuje AI jako niezależnego bytu, lecz jako narzędzie wspierające człowieka — silnik, który przyspiesza, ale nie kieruje. I właśnie w tym tkwi różnica między technologiczną obietnicą a rzeczywistą zmianą operacyjną.

Rzeczywistość: ograniczone zaufanie i ostrożna adopcja

Choć AI poprawia wydajność zespołów bezpieczeństwa, większość firm nie jest gotowa oddać jej pełnej kontroli. Jak wynika z raportu Splunk State of Security 2025, tylko 11% organizacji deklaruje pełne zaufanie do sztucznej inteligencji przy krytycznych zadaniach w SOC.

Główne bariery? Brak przejrzystości modeli, trudność w interpretacji decyzji algorytmów oraz ryzyko automatyzacji błędnych wniosków. AI nadal nie rozumie kontekstu biznesowego i nie posiada zdolności do priorytetyzacji tak, jak robią to doświadczeni analitycy.

Firmy podkreślają też różnicę między AI ogólnego zastosowania a rozwiązaniami stworzonymi z myślą o konkretnych zastosowaniach. 63% respondentów wskazuje, że domenowo wyspecjalizowana AI — trenowana na danych z zakresu bezpieczeństwa — przynosi znacznie lepsze rezultaty.

Wnioski są jasne: AI nie jest dziś alternatywą dla ludzkiej oceny, a jej skuteczność zależy od tego, jak dobrze została osadzona w strukturze operacyjnej. Technologia wspiera — ale nie prowadzi.

Dlaczego AI nie rozwiąże problemów SOC w pojedynkę

Sztuczna inteligencja może przyspieszyć analizę zagrożeń, ale nie zlikwiduje głównych bolączek nowoczesnych SOC: przeciążenia pracowników, chaosu danych i rozproszonej infrastruktury.

Raport wskazuje, że aż 78% zespołów pracuje z niezintegrowanymi narzędziami, a 69% zmaga się z izolowanymi systemami. W takich warunkach nawet najlepsze algorytmy trafiają na ścianę — brak wspólnego kontekstu, niska jakość danych i nadmiar fałszywych alarmów ograniczają ich skuteczność.

AI nie rozwiąże też problemu ludzi na granicy wypalenia. 52% członków zespołów SOC deklaruje przeciążenie, a tyle samo poważnie rozważało odejście z branży z powodu stresu. Braki kadrowe i nierealistyczne oczekiwania (wskazane przez 43% respondentów) są problemem systemowym, który nie zniknie po wdrożeniu nowego modelu językowego.

Innymi słowy: technologia może przyspieszać procesy, ale nie naprawi struktury, która nie działa. SOC potrzebuje nie tylko AI, ale przede wszystkim lepszej architektury, spójnych danych i zespołów, które mają realne wsparcie — nie tylko nowe dashboardy.

Model docelowy: AI jako wsparcie, nie substytut

Z danych Splunk wynika jasno: firmy nie chcą zastąpić ludzi maszynami. Chcą ich odciążyć. Dlatego najbardziej obiecującym kierunkiem pozostaje model hybrydowy — SOC wspierany przez AI, ale zarządzany przez człowieka.

To podejście już przynosi wymierne korzyści. Organizacje, które wdrożyły zintegrowane platformy bezpieczeństwa z komponentami AI, raportują:

- szybsze wykrywanie incydentów (78%),

- sprawniejsze rozwiązywanie problemów (66%),

- mniej „szumu” i większy kontekst w analizach.

Kluczowym czynnikiem sukcesu nie jest jednak sama technologia, lecz jej umiejętne wkomponowanie w procesy i zespoły. AI działa najlepiej, gdy ma dostęp do ujednoliconych danych, jasno zdefiniowanych polityk i ludzi gotowych przejąć kontrolę, gdy sytuacja tego wymaga.