Przez ostatnią dekadę w świecie IT obowiązywała jedna, niemal dogmatyczna zasada, która nakazywała kupowanie rozwiązań najlepszych w swojej klasie. Dyrektorzy do spraw bezpieczeństwa (CISO) budowali swoje cyfrowe fortece, dobierając poszczególne elementy niczym klocki, gdzie firewall pochodził od jednego dostawcy, system EDR od drugiego, a ochrona tożsamości od jeszcze innego.

Ta strategia, znana jako „Best-of-Breed”, doprowadziła do sytuacji, w której w 2025 roku przeciętne duże przedsiębiorstwo zarządzało skomplikowanym ekosystemem składającym się z kilkudziesięciu, a czasem nawet niemal setki różnych narzędzi security.

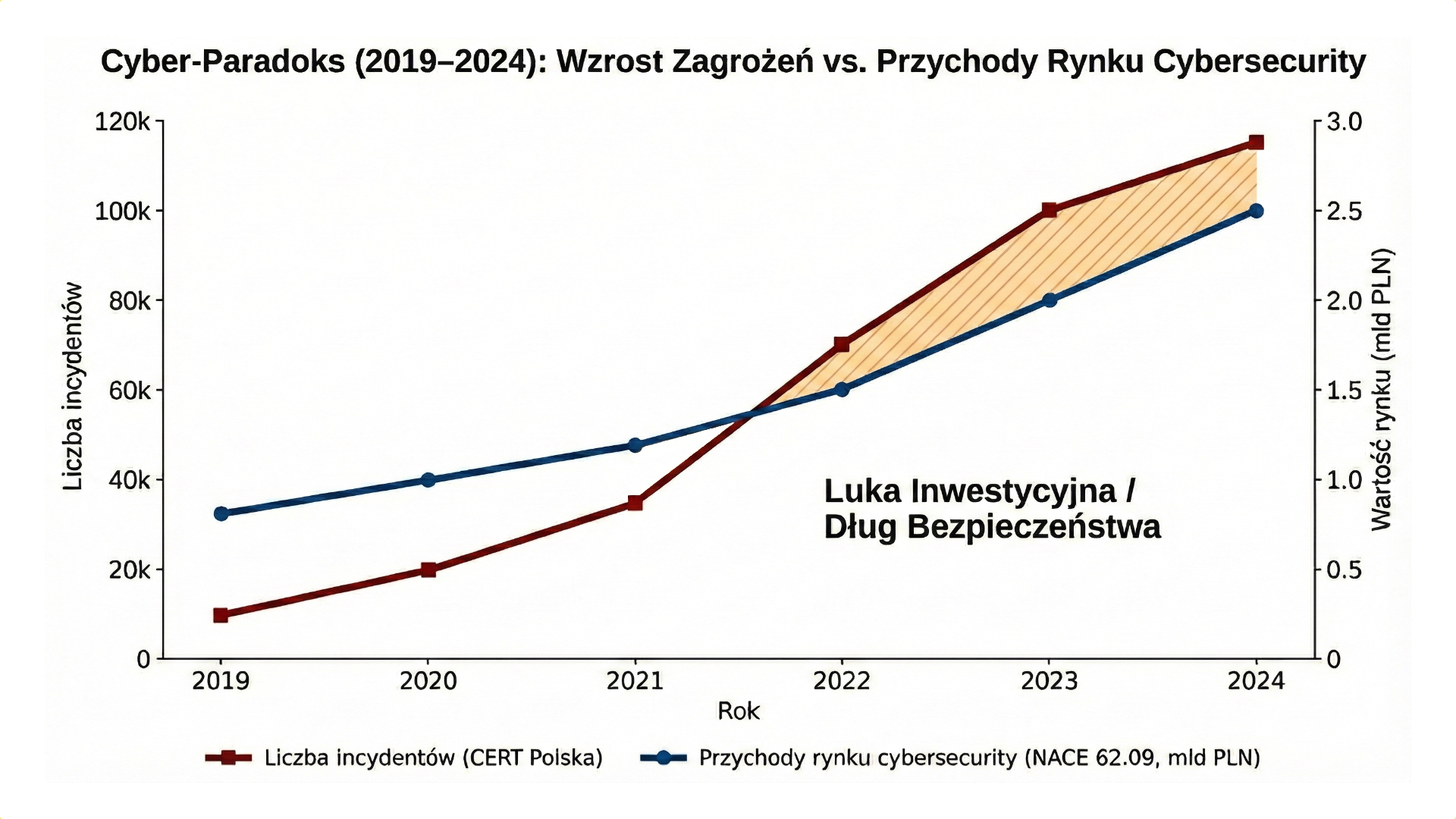

Dziś, na początku 2026 roku, z pełną odpowiedzialnością możemy ogłosić bankructwo tego modelu. Nie zabił go brak skuteczności poszczególnych aplikacji, lecz ich fundamentalna niezdolność do współpracy w tempie narzucanym przez współczesną sztuczną inteligencję. To właśnie platformizacja cyberbezpieczeństwa jest trendem, który redefiniuje nie tylko architekturę IT, ale i bilanse finansowe największych korporacji na świecie.

Odpowiedź na upadek modelu „Best-of-Breed”

Jeszcze dwa lata temu posiadanie wyspecjalizowanych, niszowych narzędzi było powodem do dumy, świadczącym o zaawansowaniu technologicznym firmy. Obecnie stało się to koszmarem operacyjnym, którego symbolem jest zjawisko zmęczenia alertami.

Centra Operacji Bezpieczeństwa toną w szumie informacyjnym, ponieważ odizolowane systemy generują tysiące powiadomień, które nie składają się w jedną logiczną całość. Analityk bezpieczeństwa tracił dotychczas znaczną część swojego czasu pracy na samo przełączanie się między konsolami i próbę ręcznego skorelowania faktów. W starciu z nowoczesnymi atakami wykorzystującymi autonomiczną sztuczną inteligencję, które potrafią przeprowadzić rekonesans i atak w ułamkach sekund, człowiek próbujący łączyć dane w arkuszach kalkulacyjnych jest pozbawiony szans.

Dlatego w 2026 roku nowoczesny lider bezpieczeństwa rozumie, że platformizacja cyberbezpieczeństwa to nie opcja, lecz konieczność operacyjna – szuka on najszczelniejszego i najlepiej zintegrowanego ekosystemu, a nie pojedynczych gadżetów.

Dlaczego platformizacja cyberbezpieczeństwa stała się priorytetem finansowym i technologicznym?

Transformacja ta następuje właśnie teraz z tak wielką gwałtownością, ponieważ zbiegają się trzy kluczowe wektory nacisku, z których najważniejszym jest technologia. Aby wdrożyć obiecywaną przez dostawców autonomiczną obronę opartą na AI, algorytm musi mieć dostęp do pełnego kontekstu zdarzeń. Musi widzieć wszystko, począwszy od laptopa prezesa, przez serwery w chmurze, aż po logi z bramek wejściowych. Jeśli dane są zamknięte w kilkudziesięciu oddzielnych bazach danych, sztuczna inteligencja pozostaje ślepa i bezużyteczna. Platformizacja cyberbezpieczeństwa burzy te mury, tworząc jedno spójne jezioro danych, na którym algorytmy mogą skutecznie identyfikować i neutralizować zagrożenia.

Równie istotnym czynnikiem jest presja finansowa. Koniec ery taniego pieniądza wymusił na firmach brutalną weryfikację kosztów, a utrzymanie relacji z kilkudziesięcioma dostawcami oznacza mnożenie procesów negocjacyjnych, faktur oraz kosztownych integracji API.

Migracja do jednej platformy pozwala zredukować całkowity koszt posiadania technologii nawet o jedną trzecią, co sprawia, że dyrektor finansowy staje się w 2026 roku największym sojusznikiem działu bezpieczeństwa w procesie konsolidacji.

Dodatkowo rynek boryka się z luką kompetencyjną, gdyż znalezienie eksperta znającego głęboko kilkanaście niszowych technologii graniczy z cudem. Znacznie łatwiej i taniej jest pozyskać inżyniera certyfikowanego w jednym ekosystemie, co sprawia, że platformizacja cyberbezpieczeństwa rozwiązuje także problemy kadrowe.

Technologiczny wymiar platformizacji cyberbezpieczeństwa: jeden agent, pełna automatyzacja

Współczesna platforma to coś więcej niż tylko pakiet produktów sprzedawany ze zniżką. To fundamentalna zmiana architektury, której kluczową innowacją jest zunifikowany agent. Pamiętamy czasy, gdy firmowe laptopy traciły wydajność pod ciężarem wielu różnych programów zabezpieczających działających w tle.

Skuteczna platformizacja cyberbezpieczeństwa zakłada instalację jednego lekkiego sensora, który pełni wiele funkcji jednocześnie, od antywirusa po skaner podatności. Drugim filarem jest wbudowana w rdzeń systemu automatyzacja. Platforma zyskuje zdolność samoleczenia, co w praktyce oznacza, że w momencie wykrycia podejrzanego połączenia system potrafi automatycznie odciąć urządzenie od sieci i zresetować uprawnienia użytkownika, nie angażując w ten proces człowieka. Analityk otrzymuje jedynie raport z podjętych działań, co pozwala mu skupić się na bardziej złożonych zadaniach.

Jak platformizacja cyberbezpieczeństwa zmienia rynek dostawców w 2026 roku?

Rynek security w 2026 roku zaczyna przypominać rynek systemów operacyjnych z lat dziewięćdziesiątych, gdzie zwycięzca bierze wszystko. Obserwujemy agresywną walkę głównych obozów, w tym hegemona w postaci Microsoftu oraz pretendentów takich jak Palo Alto Networks czy CrowdStrike. Microsoft wykorzystuje swoją dominację w środowisku biurowym i chmurowym, oferując integrację, z którą trudno konkurować ceną.

Z kolei konkurenci walczą o miano niezależnej alternatywy, dokonując serii przejęć, by wypełnić luki w swoim portfolio i nie odstawać funkcjonalnie od lidera. W tej walce gigantów najbardziej cierpią innowacyjne startupy oferujące punktowe rozwiązania.

Klienci korporacyjni widzą, że platformizacja cyberbezpieczeństwa przynosi większe korzyści długofalowe, dlatego rezygnują z niszowych nowinek, woląc poczekać, aż ich główna platforma wdroży podobną funkcjonalność w ramach standardowej aktualizacji.

Ryzyka operacyjne

Entuzjazm związany z uproszczeniem architektury nie może przesłonić ryzyk systemowych, o których w kuluarach mówi się coraz głośniej. Największym zagrożeniem jest całkowite uzależnienie od jednego dostawcy. Gdy firma wdroży pełną platformizację cyberbezpieczeństwa, staje się zakładnikiem polityki cenowej dostawcy, a wycofanie się z takiej relacji jest procesem wieloletnim i kosztownym.

Widzimy już, że dostawcy, którzy zdobyli dominującą pozycję, zaczynają podnosić ceny subskrypcji. Drugim ryzykiem jest stworzenie pojedynczego punktu awarii. Jeśli aktualizacja platformy zawiera błąd, co zdarzało się w przeszłości, firma może stracić ochronę na każdym froncie jednocześnie.

Istnieje również dylemat jakościowy, ponieważ platformy są zazwyczaj dobre we wszystkim, ale rzadko bywają najlepsze w każdym, pojedynczym aspekcie. Menedżerowie stają przed wyborem, czy zaakceptować moduł, który jest nieznacznie mniej skuteczny od lidera rynku, w zamian za pełną integrację. W 2026 roku odpowiedź coraz częściej brzmi twierdząco, gdyż lepsza widoczność całości rekompensuje ewentualne braki punktowe.

Platformizacja cyberbezpieczeństwa jako fundament nowej strategii

Trend obserwowany w 2026 roku nie jest przejściową modą, lecz logiczną odpowiedzią na ewolucję cyfrowych zagrożeń. W świecie, w którym ataki są zautomatyzowane i wspierane przez algorytmy, systemy obronne muszą działać jak jeden spójny organizm, a nie zbiór luźnych organów.

Dla liderów biznesu płynie z tego jasna lekcja, że platformizacja cyberbezpieczeństwa sprawia, iż prostota staje się nowym wyznacznikiem skutecznej ochrony. Skomplikowana infrastruktura to idealne środowisko dla hakerów, dlatego najwyższy czas uporządkować technologiczny bałagan, skonsolidować zasoby i przygotować się na wojnę algorytmów, w której zwycięży ten, kto posiada lepsze dane i spójniejszy obraz sytuacji, a nie ten, kto zgromadził więcej drogich gadżetów.