W 2025 roku GIGerzy stanowić będą 15 proc. pracowników w skali całego globu i 20 proc. w Polsce. Są jednak i takie kraje, w których już wkrótce GIGerem stanie się niemalże co drugi pracownik. Kim są GIGerzy? Czego oczekują? I… jak wpłynie na nich Polski Ład? Na te pytania odpowiada najnowszy raport EY & GIGLIKE: GIG on. Nowy Ład na rynku pracy.

GIG – trzy litery, za którymi kryje się zmiana

GIGekonomia to system pracy, który wyróżniają elastyczne formy zatrudnienia, ale też elastyczność w zakresie sposobu jej wykonywania. GIGerami są więc z jednej strony osoby pracujące tymczasowo, z drugiej – osoby posiadające specjalistyczne umiejętności, np. konsultanci, specjaliści, profesjonaliści, samozatrudnieni i niezależni kontraktorzy.

EY, światowy lider rynku usług profesjonalnych obejmujących usługi audytorskie, consulting, doradztwo podatkowe i transakcyjne oraz GIGLIKE, platforma biznesowa wspierająca firmy w efektywnej współpracy z niezależnymi talentami (w modelu B2B) zapewniająca dopasowaną ofertę benefitów, narzędzi i usług biznesowych dla GIGerów, przyjrzały się nowemu zjawisku. Efektem wspólnych działań jest raport: „GIG on. Nowy Ład na rynku pracy” opisujący wzrost znaczenia GIGekonomii.

– Jeśli spojrzeć na wskaźniki demograficzne i dane z rynku pracy jedno jest pewne – nie jest to przejściowa moda. Ponieważ niedobór i niedopasowanie talentów osiągnęły już znaczną skalę w wielu branżach, wyzwaniem dla pracodawców będzie budowanie modeli biznesowych i modeli pracy umożliwiających elastyczne i mniej tradycyjne formy zatrudniania dla niezależnych ekspertów. Potwierdza to badanie EY 2021 Work Reimagined. W ankiecie wśród pracowników, na którą odpowiedziało ponad 16 000 respondentów, 9 na 10 osób chce elastyczności miejsca i czasu pracy, a 54% pracowników prawdopodobnie odejdzie jeśli nie zaoferuje się im elastyczności, jakiej oczekują – mówi Artur Miernik, Partner EY Polska, Lider Praktyki Workforce Advisory w ramach People Advisory Services.

– Możliwość pracy zdalnej czy upowszechnienie pracy projektowej sprawiły, że pojawiły się nowe możliwości. Jedną z nich jest GIGekonomia. GIGerzy obecni są na rynku niemalże od zawsze, nigdy nie byli jednak aż tak widoczni. Warto dodać, że to właśnie nowoczesne technologie ułatwiają zatrudnianie GIGerów i współpracę ze specjalistami, którzy oczekują coraz większej elastyczności ze strony pracodawcy – podkreśla Tomasz Miłosz, Founder & CEO GIGLIKE.

Portret GIGera

W oczach Millenialsów i wchodzącej na rynek pracy generacji Z, poczucie niezależności, decyzyjności oraz potrzeba szybkiego zdobywania różnorodnych doświadczeń to jedne z najbardziej istotnych czynników w czasie szukania pracy.

Aż 42% obecnych pracowników z pokolenia Y to freelancerzy, a więc potencjalni GIGerzy. Z kolei przedstawiciele pokolenia Z, którzy w 2030 roku będą stanowić aż 1/5 rynku pracy, będą chcieli działać w sposób jeszcze bardziej niezależny, w myśl zasady connect, communicate, change (dołącz, wymieniaj informacje, zmień). Obie wyżej wymienione grupy stanowią bazę GIGekonomii.

– Również w Polsce społeczność GIGerów tworzą przede wszystkim Millenialsi. Nie zniechęca ich ilość i złożoność obowiązków nakładana na podmioty prowadzące działalność gospodarczą, ani brak jasnych uregulowań prawnych dotyczących GIGekonomii w przepisach prawa. Osobną grupą są natomiast osoby w wieku 40 plus, doświadczeni eksperci szukający nowych i bardziej opłacalnych form współpracy. Spodziewamy się, że w ciągu pięciu najbliższych lat podwoi się liczba GIGersów na polskim rynku pracy z obecnego 10% do 20% – mówi Eliza Skotnicka, Senior Manager w Zespole People Advisory Services w Dziale Doradztwa Podatkowego EY Polska.

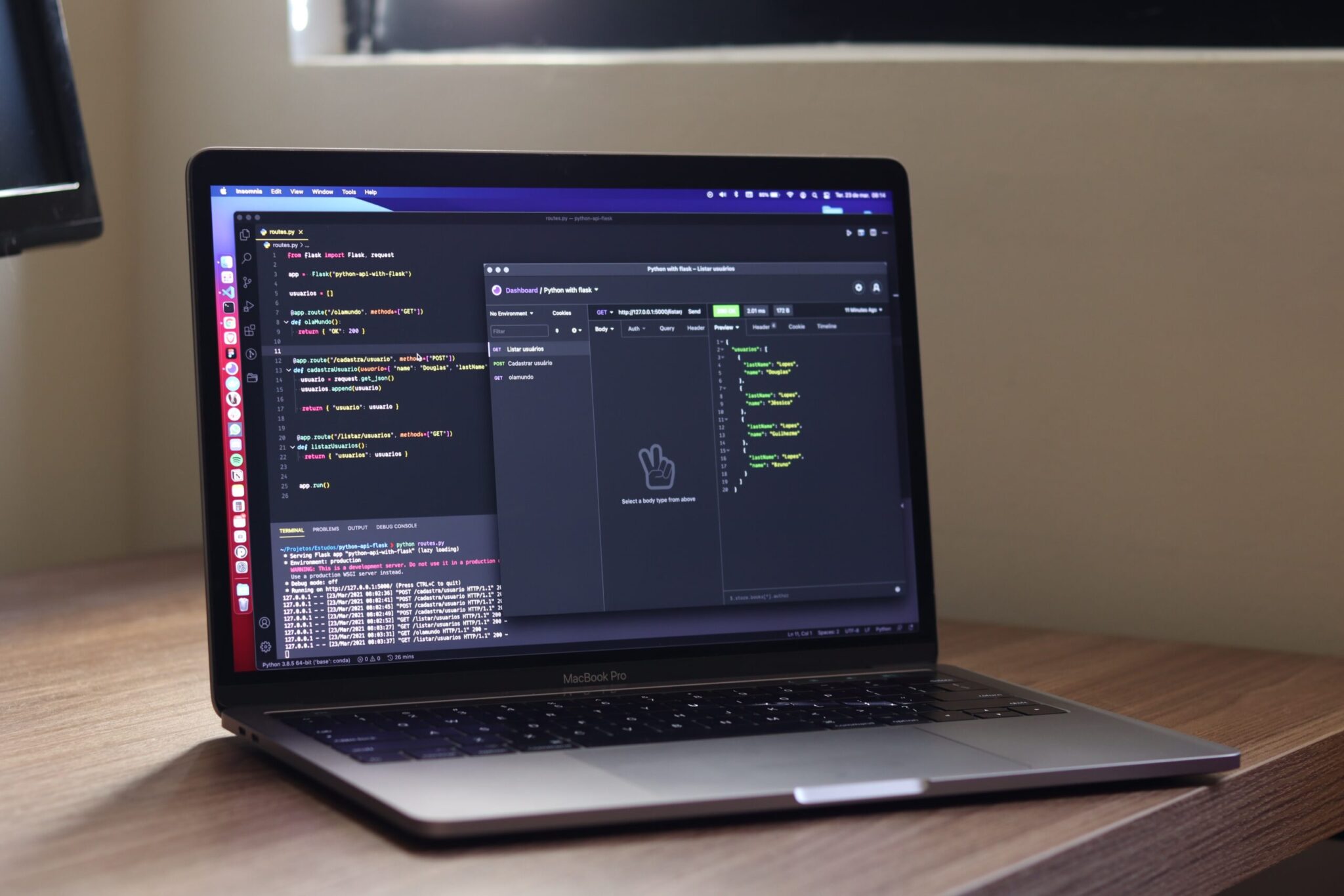

Wśród GIGerów znajdziemy najczęściej pracowników branży kreatywnej: grafików, montażystów, fotografów, copywriterów czy tłumaczy, ale też specjalistów IT i marketingu. Przedstawiciele tych zawodów od zawsze preferowali elastyczne formy zatrudnienia, zmiany które dokonały się ostatnim czasie ułatwiają i upowszechniają to zjawisko.

– Znakomita większość przedsiębiorców przygląda się z zainteresowaniem zmianom na rynku pracy i stopniowo zmienia własne modele biznesowe, uwalniając przestrzeń dla GIGerów. Przedsiębiorcy nie podchodzą do GIG-zjawisk bezkrytycznie czy bezrefleksyjnie, więcej, starają się zrozumieć bariery zmian i ich ewentualne negatywne implikacje. Szefowie kadr, prezesi i właściciele, dobrze rozumiejąc potencjał GIGekonomii, starają się racjonalizować ten trend i wprowadzać go u siebie w życie stopniowo. Sięgają oni do GIGerów, jako remedium na rosnącą rotację pracowniczą i niedobór siły roboczej do wykonywania bieżących działań. Sięgając po ten model funkcjonowania, przedsiębiorcy i menedżerowie chcą mieć pewność bezpieczeństwa i zgodności z prawem z wielu dziedzin: pracy, ubezpieczeń społecznych, podatków czy ochrony własności intelektualnej – mówi Marek Jarocki, Partner EY Polska, Lider zespołu People Advisory Services.

Rzut oka na perspektywę zza Oceanu

Już teraz GIGerzy stanowią ponad 35% pracowników w Stanach Zjednoczonych. Jak wynika z raportu Morgan Stanley, do 2027 roku odsetek ten zwiększy się aż o 15 punktów procentowych. W efekcie co drugi amerykański pracownik będzie GIGerem.

Eksperci zwracają jednak uwagę, że GIGekonomia przynosi korzyści wyłącznie wtedy, gdy jest wynikiem dobrowolnej decyzji pracownika. Kolejnym problemem mogą się okazać przepisy – a raczej ich brak – co pokazuje choćby sytuacja w Stanach Zjednoczonych. W USA trwają jednak prace nad tym, aby GIGer, tak jak każdy inny pracownik, mógł mieć zagwarantowany dostęp na przykład do opieki zdrowotnej czy świadczeń społecznych.

– Życzyłbym sobie i przede wszystkim GIGerom, żeby wybór tej ścieżki zawodowej był świadomy i dobrowolny. Niestety, nie zawsze tak jest. Wystarczy spojrzeć na przykład z rodzimego podwórka. „Jednoosobowe firmy” ratowników medycznych, którzy właśnie rozpoczęli swój protest, to doskonały przykład patologii, nad którymi zbyt łatwo przechodzimy do porządku dziennego. Mam nadzieję, że dyskusja wokół GIGekonomii i GIGerów pomoże nam w tym, aby chronić wszystkie potencjalnie narażone grupy pracowników – dodaje Piotr Palikowski, prezes Polskiego Stowarzyszenia Zarządzania Kadrami.

GIGekonomię już dziś wspierają trendy, takie jak ekonomia współdzielenia czy platformizacja z nastawieniem na modele subskrypcyjne – co potwierdzają globalne sukcesy firm, takich jak Uber czy Netflix.

– Powstają nowe platformy, które proponują specyficzne rozwiązania dla GIGekonomii i uczestników tego procesu. Mowa o platformach biznesowych pozwalających mitygować ryzyko prawno-podatkowe związane ze współpracą z GIGerami i oferujące modele subskrypcyjne odpowiadające na potrzeby GIGerów. Dzięki takim rozwiązaniom możliwe jest zaoferowanie w jednym miejscu wszelkich benefitów oraz narzędzi i usług biznesowych – wskazuje Tomasz Miłosz.

Kiedy to się opłaca?

Trend GIGekonomii zyskuje na popularności także w Polsce. Działający na tzw. „samozatrudnieniu” GIGer może dziś skorzystać z szeregu korzyści, jakie oferuje jednoosobowa działalność gospodarcza, w tym m.in. liniowego podatku PIT czy preferencyjnych składek ZUS w początkowym okresie działalności.

– Pandemia COVID-19 przyspieszyła proces transformacji rynku pracy o około 5-10 lat. Jednym z najbardziej widocznych efektów jest upowszechnienie elastycznego modelu pracy. Menedżerowie w firmach zorientowali się, że mogą mieć zdecydowanie większy dostęp do talentów bez ograniczeń lokalizacyjnych, co zwiększa ich możliwości zatrudniania ekspertów w danej dziedzinie. Nowoczesne technologie ułatwiają zatrudnianie GIGerów i współpracę ze specjalistami, którzy oczekują coraz większej elastyczności ze strony pracodawcy – mówi Eliza Skotnicka.

Istotnym czynnikiem, który wpłynie na popularyzację GIGekonomii może okazać się… Polski Ład. Według szacunków może on bowiem spowodować wzrost rocznego obciążenia spółek zatrudniających specjalistów średnio o 4-10%, za sprawą większych kosztów zatrudnienia spowodowanych presją płacową.

– Spodziewam się, że efektem nowych rozwiązań będzie upowszechnienie usług opartych o elastyczny model zatrudnienia i rozwój GIGekonomii – dodaje ekspertka.

Na korzyść nowego systemu pracy przemawiać będą zmiany w przepisach podatkowych dla jednoosobowych działalności gospodarczych, takie jak niższy ryczałt PIT (podatek od przychodu) dla branży IT na poziomie 12% lub 14% dla osób wykonujących zawody medyczne, podmiotów świadczących usługi architektoniczne i inżynierskie, usługi badań i analiz technicznych oraz w zakresie specjalistycznego projektowania.

Z obniżeniem dochodu netto dla większości będzie się jednak wiązać likwidacja zryczałtowanej składki zdrowotnej oraz możliwości jej odliczenia od PIT. W zależności od dochodu straty z tego tytułu mogą wynieść od kilkudziesięciu do nawet kilkunastu tysięcy złotych.

Trend rozwoju GIGekonomii przyczyni się natomiast do coraz mniejszego strachu przed odejściem z zatrudnienia na podstawie tradycyjnej umowy o pracę, zaś ryzyko niestabilnego dochodu w dużym stopniu kompensowane będzie możliwością współpracy z wieloma podmiotami jednocześnie.

– Uczniowie szkół średnich powinni zastanowić się, w jaki sposób powinni rozwijać swoje umiejętności zawodowe, tak aby byli przygotowani na ten zmieniający się model zatrudnienia. Następne pokolenie musi zrozumieć, że nadchodzi automatyzacja. Musisz stale zadawać sobie pytania: co robisz, czego nie da się zautomatyzować lub czego ktoś inny nie zrobi lepiej od Ciebie? Zastanów się, co naprawdę lubisz, a także, w czym jesteś naprawdę dobry – doradza Jowita Michalska, CEO Digital University.

GIG is on

Do GIGekonomii przekonuje się coraz więcej firm w skali świata. Już jedna na trzy organizacje zrezygnowała z pracowników etatowych na rzecz niezależnych talentów. Ten nowoczesny model współpracy jest coraz szybciej i szerzej adaptowany przede wszystkim w firmach technologicznych i obejmuje coraz większą część społeczeństwa, stanowiąc o przyszłości rynku pracy.