Rozwój technologii pamięci masowych odgrywa kluczową rolę w kształtowaniu przyszłości branży IT, wpływając na wydajność, bezpieczeństwo i energooszczędność systemów informatycznych. O najnowszych innowacjach, trendach oraz wyzwaniach rynkowych rozmawiamy z Maciejem Kamińskim, Dyrektorem dywizji Memory w Samsung Electronics Polska i regionie CEE.

Bartosz Martyka, BrandsIT: Jakie innowacje w technologii pamięci mają największy wpływ na całą branżę IT?

Maciej Kamiński, Samsung: Każde novum dotyczące pamięci masowych napędza rozwój branży IT, wpływając na wydajność, energooszczędność oraz przetwarzanie i przechowywanie danych. W ostatnich latach kilka przełomowych technologii znacząco ukształtowało przyszłość centrów danych, urządzeń konsumenckich i AI.

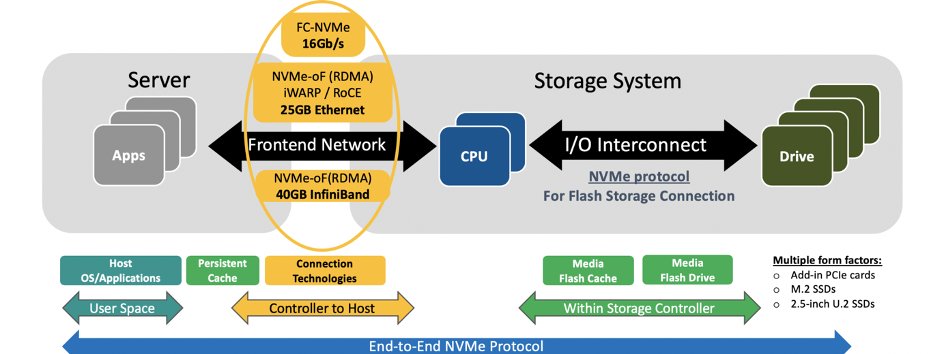

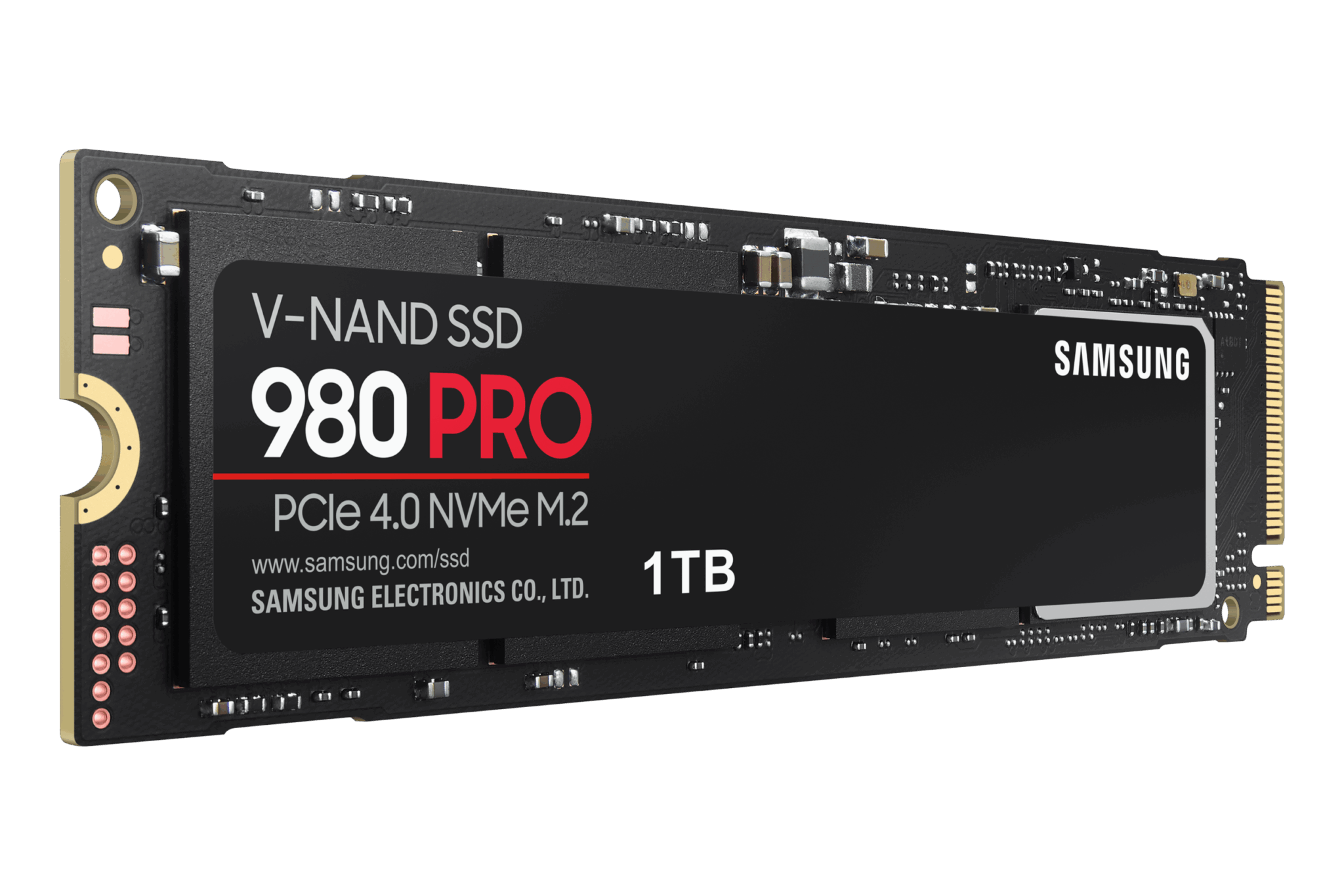

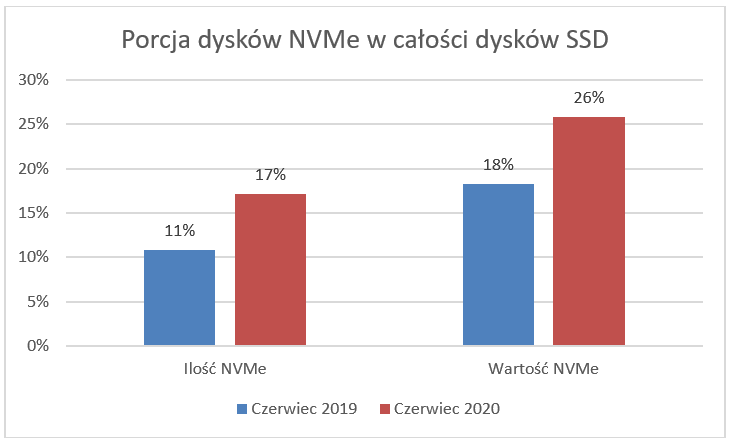

Jednym z największych postępów jest pamięć NVMe, która zastąpiła starsze interfejsy SATA. Dyski NVMe oferują wielokrotnie wyższą prędkość odczytu i zapisu, co znacząco skraca czas ładowania systemów, aplikacji i baz danych. Wykorzystanie NVMe w centrach danych, gamingowych PC i AI przyspiesza obliczenia, zwiększa efektywność operacyjną i redukuje opóźnienia. Technologia ta jest kluczowa dla nowoczesnych serwerów, gdzie każda milisekunda ma znaczenie. Firmy mogą przetwarzać ogromne ilości danych w czasie rzeczywistym, co ma istotne znaczenie dla machine learning i chmury. Dzięki wysokiej przepustowości NVMe stopniowo wypiera SSD oparte na SATA, które nie spełniają już współczesnych wymagań wydajnościowych.

Kolejną istotną innowacją jest rozwój pamięci 3D NAND, w której komórki są układane warstwowo, co pozwala na zwiększenie gęstości zapisu i pojemności dysków SSD bez zmiany ich rozmiaru. Producenci mogą dostarczać bardziej wydajne i tańsze nośniki, co ma ogromne znaczenie dla chmury i użytkowników indywidualnych. Wzrost popularności przechowywania danych w chmurze i modelu subskrypcyjnego napędza popyt na szybkie, pojemne pamięci.

Nowoczesne algorytmy zarządzania pamięcią wydłużają jej żywotność, co jest kluczowe dla biznesu i centrów danych. Samsung jako lider w tej dziedzinie stale rozwija 3D NAND, zwiększając liczbę warstw nawet do planowanych 430. Takie innowacje zwiększają pojemność i optymalizują zużycie energii. Jest to istotne dla zrównoważonego rozwoju IT. Technologia Samsung V-NAND poprawia wydajność i trwałość dzięki pionowemu układaniu komórek, redukując zakłócenia między-poziomowe i zwiększając niezawodność pamięci w długim okresie.

B.M.: Jakie są kluczowe elementy skutecznego partnerstwa w sektorze rozwiązań pamięciowych?

M.K.: Efektywna współpraca nie tylko w sektorze pamięci masowych, a w sadzie w każdej branży, opiera się na kilku kluczowych elementach, które umożliwiają długoterminową współpracę i budowanie przewagi konkurencyjnej.

- Wspólna wartość biznesowa

Współpracujące firmy muszą mieć jasno określone cele oraz strategie, które pozwalają na rozwój innowacyjnych rozwiązań odpowiadających na realne potrzeby klientów. W dywizji Memory w Samsung nie stawiamy na wielką liczbę partnerów, a na jakość współpracy – kluczowe jest dla nas budowanie długofalowych relacji, w których partnerzy dostarczają wartość dodaną do sektora technologii pamięciowych. - Elastyczność i adaptacja do zmian rynkowych

Sektor IT charakteryzuje się szybką zmiennością, dlatego elastyczność i zdolność adaptacji do nowych wyzwań jest niezbędna. Współpraca z partnerami musi uwzględniać zmieniające się potrzeby klientów, rozwój sztucznej inteligencji, wzrost znaczenia chmury obliczeniowej oraz potrzeby sektora data center. Samsung, wspierając swoich partnerów, dostarcza nie tylko najnowsze rozwiązania sprzętowe, ale także edukację i wsparcie techniczne, co ułatwia ich skuteczne wdrażanie. - Transparentność i zaufanie

Współpraca w sektorze pamięci masowej wymaga transparentności i partnerstwa opartego na zaufaniu. Kluczowe jest dzielenie się wiedzą, analizowanie trendów rynkowych oraz dostosowywanie strategii sprzedażowych do potrzeb klientów. Realizujemy to m.in. poprzez cykliczne szkolenia dla partnerów oraz współpracę w zakresie tworzenia materiałów case study, które pokazują praktyczne zastosowanie rozwiązań pamięciowych w rzeczywistych projektach. - Wsparcie operacyjne i marketingowe

Skuteczne partnerstwo nie kończy się na dostarczeniu produktu – istotne jest wsparcie operacyjne, po-sprzedażowe, serwisowe oraz marketingowe. Samsung wdraża model 360°, w którym oprócz innowacyjnych produktów oferuje showroomy technologiczne, szkolenia i materiały edukacyjne, które pomagają partnerom w skutecznej promocji i sprzedaży pamięci masowych.

B.M.: Jak współpraca z producentami sprzętu, dystrybutorami oraz dostawcami chmury wpływa na rozwój rozwiązań pamięciowych?

M.K.: Wymiana doświadczeń z firmami tworzącymi sprzęt IT pozwala na optymalizację wydajności, kompatybilności i trwałości produktów. Integracja technologii NVMe z nowoczesnymi urządzeniami przyspiesza przetwarzanie danych. Stanowi to nieocenioną wartośćdla klientów indywidualnych, centrów danych i branży AI.

Współpracujemy z producentami sprzętu, by dostosować firmware i kontrolery pamięci do konkretnych zastosowań. Przykładem jest rozwój dysków SSD zoptymalizowanych pod kątem gier, które minimalizują opóźnienia i zwiększają prędkość ładowania.

Dystrybutorzy natomiast odgrywają kluczową rolę w łańcuchu dostaw, zapewniając dostępność najnowszych technologii pamięciowych. Współpraca z nimi przyspiesza wdrażanie innowacji i zwiększa skalę dystrybucji. Jako dywizja Memory stawiamy na bliskie relacje z partnerami, oferując im nie tylko produkty, ale także szkolenia, które pomagają skutecznie sprzedawać nowoczesne rozwiązania. Dzięki temu możliwe jest dostosowanie oferty do lokalnych rynków – w Europie rośnie zapotrzebowanie na dyski enterprise, podczas gdy w krajach rozwijających się dominują podstawowe nośniki danych.

Dynamiczny rozwój usług chmurowych znacząco wpływa na innowacje w pamięciach masowych. Samsung współpracuje z dostawcami chmury, by tworzyć rozwiązania zoptymalizowane pod kątem centrów danych. W nich to priorytetowymi są szybkość dostępu, energooszczędność i skalowalność. Przykładem jest rosnące zapotrzebowanie na dyski SSD NVMe dla serwerów cloudowych. Samsung inwestuje w rozwój pamięci o dużej gęstości zapisu, co zwiększa efektywność przechowywania i przetwarzania informacji w chmurze.

B.M.: Jakie wyzwania technologiczne i rynkowe przewidujecie, a które mogą zostać złagodzone dzięki strategicznym partnerstwom?

M.K.: Niestabilność łańcucha dostaw półprzewodników, nasilona przez pandemię i napięcia geopolityczne, pokazała, jak duży wpływ na branżę mają niedobory surowców i zakłócenia logistyczne. Producenci pamięci mierzyli się z ograniczoną dostępnością kluczowych komponentów, co wpłynęło na tempo produkcji i terminowość dostaw. Rosnący popyt na elektronikę, napędzany rozwojem AI, big data i chmury, dodatkowo uwypuklił znaczenie niezachwianego łańcucha wartości.

Samsung Memory, dzięki partnerstwom z dystrybutorami i dostawcami surowców, minimalizuje ryzyko braków i optymalizuje logistykę. Długoterminowa współpraca pozwala skuteczniej zarządzać zasobami i przewidywać problemy z dostępnością komponentów. Inwestycje w lokalne centra produkcyjne i magazynowe zmniejszają zależność od odległych dostawców, a globalna współpraca ułatwia monitorowanie sytuacji rynkowej i zapewnia ciągłość produkcji.

W dobie cyfryzacji rosną zagrożenia cybernetyczne. Ataki ransomware i kradzież danych stały się codziennością, a firmy potrzebują zaawansowanych zabezpieczeń. Sektory finansowy, zdrowotny i infrastruktura krytyczna wymagają najwyższego poziomu ochrony, co wymusza stosowanie technologii szyfrowania i odporności na manipulacje.

Samsung wdraża szyfrowanie sprzętowe w pamięciach SSD oraz systemy odporne na ataki. Dzięki temu firmy skuteczniej chronią dane, a użytkownicy indywidualni zyskują większe bezpieczeństwo. Rozwój technologii Hardware-Based Encryption i unikalnych identyfikatorów sprzętowych wzmacnia ochronę informacji. Samsung Memory nie tylko dostarcza sprzęt, ale także edukuje partnerów w zakresie najlepszych praktyk cyberbezpieczeństwa, pomagając firmom skutecznie przeciwdziałać zagrożeniom.

Maciej Kamiński pełni funkcję Dyrektora Dywizji Memory w Samsung Electronics na Polskę i region Europy Środkowo-Wschodniej (CEE). Posiada szerokie doświadczenie w zakresie marketingu, sprzedaży oraz zarządzaniu produktami i usługami technologicznymi. W swojej roli odpowiada za rozwój i skalowanie biznesu pamięci masowych Samsung w regionie, kładąc nacisk na budowanie stabilnych relacji z partnerami oraz wspieranie ich w rozwoju oferty. Pod jego kierownictwem dywizja Memory została zbudowana od podstaw i obecnie dynamicznie rozwija się.