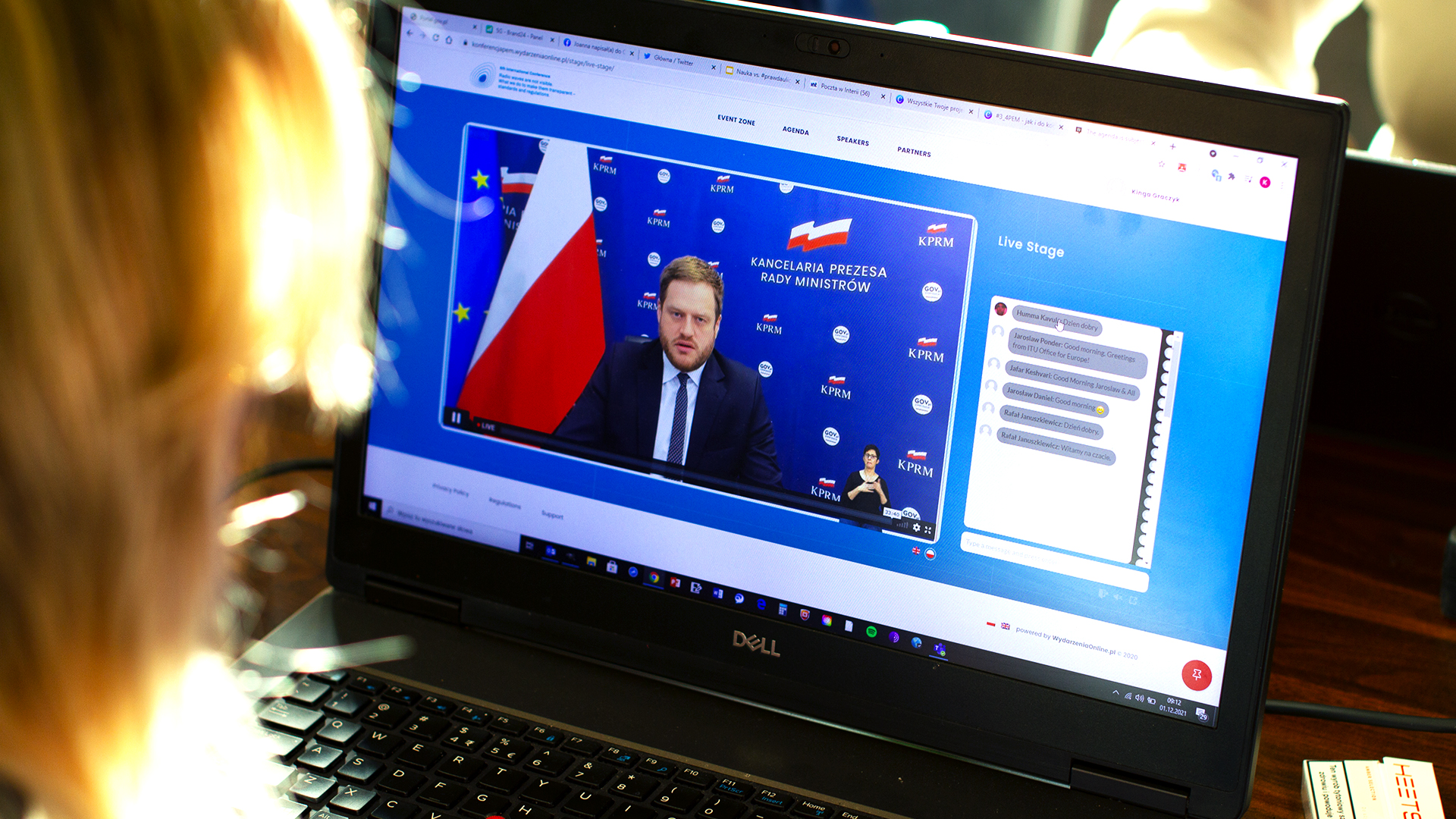

Zakończył się drugi i ostatni dzień Międzynarodowej Konferencji PEM „Fale radiowe są niewidoczne. Co robimy, by były transparentne – normy i regulacje”. Poświęcony był problemom tworzenia i rozpowszechniania fałszywych informacji na temat PEM i roli rzetelnej edukacji w ich zwalczaniu. Konferencję organizują Instytut Łączności i Kancelaria Prezesa Rady Ministrów.

Drugi dzień konferencji otworzyli prof. dr hab. n. med. Karolina Sieroń ze Śląskiego Uniwersytetu Medycznego, wiceprzewodnicząca Rady Programowej wydarzenia oraz dr inż. Jacek Oko, prezes Urzędu Komunikacji Elektronicznej.

– To jedna z najcenniejszych i najważniejszych merytorycznie w branży konferencji dotyczących PEM. Większy nacisk położony na rzetelne informacje dotyczące PEM przez operatorów może być szczepionką na wszelkie fake newsy związane z PEM – powiedział prezes UKE.

Pierwsza część wystąpień prelegentów dotyczyła sposobów skutecznej edukacji w zakresie PEM i 5G. Perspektywę operatorów telekomunikacyjnych przedstawił Piotr Kędzierski z T-mobile, który podczas konferencji wystąpił w imieniu Polskiej Izby Informatyki i Telekomunikacji.

– Edukacja dotycząca PEM i nowoczesnych technologii powinna zaczynać się jak najwcześniej, już w szkole, być może w ramach istniejących już zajęć. Sami nie wiele jesteśmy w stanie zrobić, poszukujemy partnerów, z którymi możemy prowadzić działania edukacyjne w sposób wiarygodny – najsilniejsze są działania instytucji naukowych, które są neutralne – podkreślił Piotr Kędzierski.

Jak z kwestią edukacji mogą radzić sobie krajowi regulatorzy, na przykładzie rozwiązań cypryjskich, mówił Christos Kourtellaris z Departamentu Komunikacji Elektronicznej Wiceministra Nauki, Innowacji i Polityki Cyfrowej Cypru.

– Nasz departament działa na rzecz edukacji o PEM, staramy się, aby procedura i kompetencje były transparentne, zrozumiałe dla wszystkich i łatwo dostępne – zaznaczył.

Działania edukacyjne prowadzone przez australijskiego operatora Telstra omówili reprezentanci tej firmy Debbie Wills i Mike Wood.

– Pokazujemy społeczeństwu zasady działania urządzeń wykorzystujących technologię bezprzewodową – to również element strategii informacyjnej związanej z 5G i PEM – mówił Mike Wood.

– Zmierzone poziomy PEM na australijskiej plaży wynoszące około 0,015 W/m2 postanowiliśmy porównać do PEM pochodzącego od Słońca, które wynosiło 1000 W/m2 – dodał.

Kinga Graczyk i Łukasz Kiwicz z Kancelarii Prezesa Rady Ministrów przybliżyli założenia kampanii edukacyjnej Instytutu Łączności i KPRM dotyczącej komunikacji bezprzewodowej i 5G, która rozpoczęła się w 2021 roku i będzie trwała 3 lata.

– W ramach działań edukacyjnych związanych z PEM będziemy korzystać z narzędzi jak najlepiej dopasowanych do naszych odbiorców – powiedziała Kinga Graczyk.

– Autorytet wykształconych i utytułowanych ekspertów w danej dziedzinie przestaje mieć znaczenie w chwili, kiedy wygłaszają oni swoje stanowisko odmienne niż pasujące do przyjętej tezy – zaznaczył Łukasz Kiwicz.

– Osoby o stosunkowo niskich kwalifikacjach w swojej dziedzinie mają często tendencje do przeceniania swojej wiedzy. Namiastka tego autorytetu powoduje, że często zjednują sobie odbiorców i szerzą informacje niemające pokrycia w rzeczywistości – dodała Kinga Graczyk.

Jaką rolę odgrywają media społecznościowe w rozpowszechnianiu dezinformacji? Zaproszeni eksperci dyskutowali o tym w kolejnej części drugiego dnia konferencji.

Jako pierwszy zabrał głos Tommaso Canetta z fact checkingowej organizacji Pagella Politica, który omówił mechanizm powielania i rozpowszechniania fake newsów i teorii spiskowych w sieciach społecznościowych.

– Błąd potwierdzenia oznacza, że dużo łatwiej jest znaleźć użytkownikowi Internetu informacje potwierdzające jego fake news niż taką, która go obali – zauważył.

O psychologicznych aspektach popularności fałszywych treści w Internecie mówiła dr Magdalena Jabłońska z Uniwersytetu SWPS.

– Celem fake newsów jest celowe wprowadzenie użytkownika w błąd, często są to informacje zmyślone mające za zadanie wywołać określone efekty. Efekt śpiocha polega na tym, że ludzie nie pamiętają o niewiarygodnym źródle informacji, ale pamiętają samą informację, zapominając o nierzetelności źródła, szczególnie jeżeli oddziałuje również na emocje osoby – mówiła dr Jabłońska.

– W nauce musimy zaakceptować obszary niewiedzy. Gdyby wszystko było wiadome nie trzeba by było prowadzić badań naukowych. Jeżeli jesteśmy w stanie i mamy taką możliwość, to pytajmy ekspertów – dodała.

Julian Dobrowolski z NASK przedstawił narzędzia udostępniane przez sieci społecznościowe wspierające zwalczanie dezinformacji.

– Jest kilka okoliczności w jakich Facebook pozwala zgłosić informację, jako nieprawdziwą i uznaje ją za fake news. Francja oraz Niemcy posiadają własne regulacje prawne dotyczące usuwania treści fake newsów z Internetu – zauważył.

W kolejnej części konferencji zaproszeni prelegenci zastanawiali się, jak komunikować wyniki badań medycznych, aby nie zostały wykorzystane do dezinformacji.

Krótki kurs właściwego czytania wyników badań naukowych w swojej prezentacji przedstawiła prof. dr hab. n. med. Karolina Sieroń ze Śląskiego Uniwersytetu Medycznego.

– Aby prawidłowo czytać badania należy być sceptycznym, sprawdzać, czy cytowane badanie rzeczywiście istnieje. Należy pamiętać o hierarchii dowodów naukowych a także sprawdzać renomę czasopisma, w którym badania naukowe zostały opublikowane. Warto także przyjrzeć się konfliktom interesów i źródle finansowania badań oraz zawsze należy zapoznać się z dyskusjami oraz wnioskami dotyczącymi opublikowanych badań.

Jak nauka ma rywalizować z „prawdą ulicy”, gdy do dyspozycji jest tylko 280 znaków postu na Twitterze? Problemem zajęła się w swojej prezentacji Maja Romanowska z WHO.

– Współcześnie mamy do czynienia z infodemią, czyli nadmiarem informacji zarówno tych dobrych jak i, niestety, niewłaściwych. Za szerzenie fake newsów i działanie na szkodę innych powinny być nakładane kary i wyciągane konsekwencje. W 95% za dezinformację w Internecie jest odpowiedzialnych 12 kont w mediach społecznościowych – stwierdziła.

O warsztacie naukowca i kulisach powstawania prac naukowych opowiadał dr hab. Grzegorz Tatoń z Zakładu Biofizyki Wydziału Lekarskiego Collegium Medicum Uniwersytetu Jagiellońskiego.

– Rozmowa telefoniczna powoduje mierzalny wzrost temperatury okolicy ucha, ale nie udało się ustalić czy czynnikiem istotnym w tym przypadku jest oddziaływanie PEM. Na świecie istnieje 54 000 czasopism naukowych. Osoba, która nie dysponuje umiejętnością krytycznej oceny prac naukowych może znaleźć tekst, który będzie uzasadniał dowolny pogląd na dowolny temat. Ani naukowcy, ani lekarze nie dysponują metodami pozwalającymi na stwierdzenie związku przyczynowo-skutkowego pomiędzy objawami, a czynnikami takiego rodzaju, jak PEM – mówił dr. Tatoń.

Thomas Barmüller, dyrektor Mobile & Wireless Forum na Europę, Bliski Wschód i Afrykę, omówił prowadzoną w mediach społecznościowych kampanię #5GFactsNotFear.

– Nadszedł czas na fakty, nie na lęki i obawy. Dezinformacje to informacje, które mają wywołać konkretną szkodę, nie są zwykłymi fałszywymi informacjami. Zdecydowana większość Europejczyków jest niepewna, jeżeli chodzi o mity na temat 5G. Powinniśmy mówić o faktach i liczbach tak, by mieszkańcy mogli podejmować decyzje oparte na prawdziwych danych i nie uginali się pod presją fake newsów – stwierdził Thomas Barmüller.

– Z naszego raportu wynika, że brakuje korelacji pomiędzy częstotliwościami występowania chorób nowotworowych a liczbą użytkowników telefonii komórkowej – dodał.

Ostatnie wystąpienia prelegentów drugiego dnia konferencji dotyczyły fact checkingu – jego roli w zwalczaniu dezinformacji oraz trudnościom i wyzwaniom, przed jakimi stają specjaliści w tej dziedzinie.

Jak, na tle innych krajów, wygląda współpraca administracji z zespołami fact checkingowymi – to temat prezentacji przedstawionej przez Maję Czarnecką, dziennikarkę AFP.

– Powiązanie sieci 5G z pandemią COVID19 to jeden z elementów składających się na większą część, którą są teorie spiskowe związane z pandemią oraz szczepionkami w ramach Nowego Porządku Świata tzw. NWO.

Małgorzata Fraser z serwisu CyberDefence24 w swoim wystąpienia zastanawiała się czy fact checking może być skutecznym lekarstwem na celową, systemową dezinformację.

– Dezinformacja zakorzeniła się w świadomości wszystkich obywateli po wyborach prezydenta USA w 2016 roku, gdy okazało się, że wykorzystanie social mediów w określony i zaplanowany sposób miało wpływ na te wydarzenia. Odbiorcy wiadomości nie mają narzędzi, ani wiedzy, w jaki sposób radzić sobie z otaczającymi nas w sieci fake newsami.

Czy fact checking kiedyś się kończy? Czy jest moment, kiedy możemy przestać weryfikować i uznać dany temat za ostatecznie wyjaśniony? Z tematem zmierzył się Marcel Kiełtyka ze Stowarzyszenia Demagog.

– Jednym z często powtarzanych fake newsów, które można było znaleźć w sieci na początku pandemii był ten twierdzący, że zachorowanie na Sars-Cov-2 to efekt choroby popromiennej spowodowanej wprowadzaniem sieci 5G. Informacja ta doprowadziła do podpalenia 159 masztów telefonii komórkowej. Spowodowało to przestój w pracy tych stacji na 170 tys. godzin. Zatem, kiedy możemy przestać weryfikować informacje? Raczej nie możemy tego zrobić, należy zawsze docierać do ich źródeł i cały czas edukować społeczeństwo.

Konferencję podsumował Jakub Wiech, moderator drugiego dnia wydarzenia:

– Podczas konferencji padło wiele cennych spostrzeżeń. Dowiedzieliśmy się, jak wyglądają fake newsy dotyczące różnych kwestii naszego codziennego życia. Warto pamiętać, że trzeba być zawsze krytycznym wobec informacji, które do nas napływają. Z tyłu głowy warto mieć pytanie: a co, jeśli ktoś próbuje mnie oszukać? Tegoroczna edycja konferencji i dyskusje, które tu odbyliśmy może być formą szczepionki, dawki przykładów, które uwrażliwią nas na fake news i pozwolą nam je rozpoznać.

Z wystąpień prelegentów i dyskusji panelowych podczas drugiego dnia konferencji wynika, że fake newsy, dezinformacja i teorie spiskowe związane z PEM powstają i są rozpowszechniane niezwykle łatwo. Media społecznościowe są znakomitym i niezwykle trudnym do kontrolowania środkiem szybkiego powielania fałszywych informacji. Możemy przeciwstawiać się lawinie dezinformacji: edukując, weryfikując fakty, promując rzetelną wiedzę naukową. Nie mamy tylko pewności, że narzędzia, które mamy do dyspozycji będą skuteczne.