Dostęp do sprawdzonych i rzetelnych informacji to jedno z podstawowych praw każdego obywatela. Gdy jednak trwa wojna prawdziwe informacje stają się dobrem nadrzędnym zarówno dla jednej, jak i drugiej strony konfliktu. Doskonale wiedzą o tym Rosjanie, którzy w wywołanej na Ukrainie wojnie stosują dezinformację, jako jedno z narzędzi służące do przeprowadzenia wojny informacyjnej. W pierwszych dniach wojny podjęli próbę odcięcia Ukrainy od łączności telekomunikacyjnej. Jak do tego doszło? Czy jest możliwe odcięcie od łączności i informacji ponad 44-milionowego kraju?

26 lutego 2022 r., dwa dni po ataku Rosji na Ukrainę, wicepremier Ukrainy – Mykhailo Faedorova – zaapelował do Elona Muska m.in. o wsparcie Ukrainy w kwestii zapewnienia łączności. O dostarczenie Starlinków.

Rosyjskie ministerstwa odpowiedzialne za propagandę mają 70-letnie doświadczenie w pozbawianiu Europejczyków dostępu do wolnych mediów. Już w 1940 roku ZSRR skutecznie zakłócał audycje Radia Watykan prowadzone w języku litewskim. W dobie XXI wieku, kiedy media społecznościowe stają się głównym źródłem informacji dla wielu internautów, mamy okazję obserwować nowe metody manipulacji faktami. Tym razem odbywa się to dzięki zaawansowanym systemom zbudowanym na potrzeby kontrolowania widma fal elektromagnetycznych. Dzięki takim urządzeniom jak legendarna już Krasucha-C4, wojska Władimira Putina podjęły próbę pozbawienia 44-milionowej Ukrainy zasięgu sieci komórkowych. Przekształcenie ponad 600 000 km2 jednego z największych krajów w Europie w tzw. białą plamę zasięgu internetowego ma zapewnić rosyjskiej machinie wojennej przejęcie całkowitej kontroli nad przepływem informacji na terenie ogarniętym wojną. Czy agresja komunikacyjna na taką skalę jest w ogóle możliwa?

Rosyjski dzięcioł z Czarnobyla

Czy rozmiar ma znaczenie? To pytanie od wieków trapiło całe zastępy filozofów. Definitywną odpowiedź na to nurtujące zagadnienie znaleźli, a jakże, sowieccy inżynierowie… przynajmniej w kontekście instalacji radarowych.

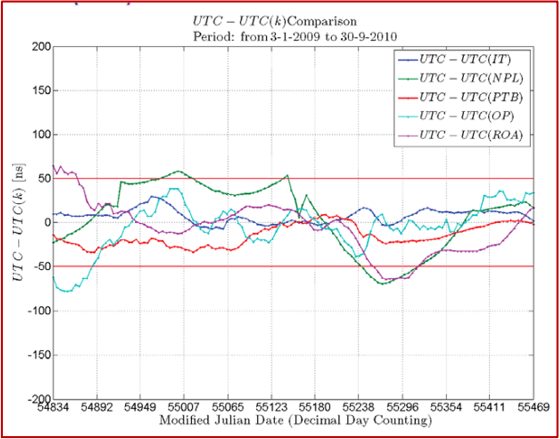

W lipcu 1976 roku w pobliżu miejscowości Czarnobyl (wówczas jeszcze nie owianej złą sławą), włodarze ZSRR uruchomili instalację o nazwie Duga. Duga była strategicznym radarem pozahoryzontalnym (OTH) pracującym w zakresie fal krótkich. Dwubiegunowa konstrukcja składa się z odbiornika o niebagatelnych wymiarach 300 x 135 metrów i nieco tylko mniejszego nadajnika o wymiarach 210 x 85 metrów.

Niebotyczne rozmiary radaru działającego na częstotliwościach 4 – 30 MHz oraz poziomy emitowanych sygnałów sprawiały, że był on w stanie wywoływać zakłócenia odbiorników fal radiowych oddalonych nawet o 3 000 kilometrów. Sygnał Dugi potrafił kompletnie zablokować komunikację radiową prowadzoną z wykorzystaniem radia CB w paśmie 27 MHz nawet w odległej Portugalii. Specjaliści dywagowali, iż transmisje z sowieckiej instalacji mogą mieć moc rzędu kilku megawatów (milionów watów). Spekulacje okazały się jednak niedoszacowane, ponieważ w rzeczywistości moc nadajników radaru wynosiła aż 10 megawatów. Krótkofalowcy nazwali sygnał Dugi rosyjskim dzięciołem z powodu charakterystycznego rytmu przypominającego stukanie tego skrzydlatego cieśli. Mimo, iż 14 listopada 1989 roku instalacja została wycofana z użycia decyzją sowieckiego ministra obrony, stukanie radiowego dzięcioła dalej jest dostępne na portalach zrzeszających fanów radiotechniki.

Radiowa żelazna kurtyna

Mimo swojego potencjału (choć ubocznego) w kontekście wywoływania zakłóceń odbiorników radiowych, głównym zadaniem Dugi było ostrzeganie przed atakiem jądrowym ze strony USA. Aby skutecznie odciąć Europejczyków mieszkających za żelazną kurtyną od nieczystych myśli wywołanych słuchaniem alianckich rozgłośni radiowych, agentura ZSRR zbudowała rozległą siatkę punktów zagłuszających. Od rosyjskiej Bałaszychy, przez litewską Poniewież, aż po polski Lidzbark Warmiński.

Radiowa żelazna kurtyna oparta została na infrastrukturze antenowej połączonej z licznymi nadajnikami i modulatorami zagłuszającymi. Jej głównym zadaniem było zatrzymanie audycji Radia Wolna Europa, Głosu Ameryki, BBC czy Radia France Internationale. Władze sowieckie płaciły niebotyczne kwoty za monopol informacyjny. Według szacunków roczne utrzymanie przemysłu zagłuszającego kosztowało ZSRR 900 milionów dolarów rocznie. Jak walczyć z tak zaawansowanym systemem propagandy?

Inwencja i pomysłowość mieszkańców bloku wschodniego były w tym aspekcie wręcz nieocenione. Jedną z najbardziej skutecznych metod okazały się pętle wykonane z drutu lub innego przewodnika elektrycznego. Owe sławetne metalowe kółka znane są do dziś i można je kupić w pobliskim markecie RTV/AGD. Mowa o niczym innym jak magnetycznych antenach pętlowych. Pozwalały one na odsłuch blokowanych sygnałów radiowych. W gratisie dostarczały szerokie uśmiechy słuchaczom audycji Jana Nowaka-Jeziorańskiego. Wieczorem 29 listopada 1988 roku ZSRR zaprzestał zagłuszania zagranicznych stacji radiowych. Do końca 1988 roku w Związku Radzieckim, Bułgarii i Czechosłowacji wyłączono ponad 1600 nadajników rozmieszczonych w 120 centrach zagłuszania. Był to oficjalny koniec tego kosztownego przedsięwzięcia sowieckiej propagandy. Jednak świadkowie biorący udział w pogrzebie anachronicznego systemu i owoców jego zakłamania nie docenili instynktu samozachowawczego biurokratów upadającej potęgi, jaką było ZSRR. W słynnym cytacie z filmu „Psy”, były funkcjonariusz SB o pseudonimie „Dziadek” mówi do granego przez Bogusława Lindę Franza: „A gdzie ja teraz robotę znajdę, jak ja tylko przesłuchiwać umiem?”. Wydaje się, że podobny dylemat dopadł włodarzy ministerialnych odpowiedzialnych za zagłuszanie zachodnich agencji informacyjnych. Jednak w ich przypadku, parafrazując, pytanie zapewne brzmiało: „A jaką robotę teraz znajdziemy, jak my tylko zagłuszać potrafimy?”. Niestety, nawet (a może zwłaszcza) tak podłe umiejętności okazały się przydatne w nowej rzeczywistości zwanej Federacją Rosyjską.

Krasucha-C4 czyli repeater GSM w wydaniu XXL

Od ponad roku Urząd Komunikacji Elektronicznej ostrzega Polaków przed zakupem i samodzielną instalacją magicznego urządzenia przeznaczonego do dwukierunkowego wzmacniania sygnałów radiowych, zwanego popularnie reapeterem. Mimo systematycznej rozbudowy infrastruktury sieci komórkowych i coraz skuteczniejszego pokrycia obszaru Polski siecią światłowodów, nadal borykamy się z problemem tzw. białych plam zasięgowych. Miejsc, gdzie dostęp do Internetu jest znacznie utrudniony lub wręcz niemożliwy. Wiele sklepów internetowych mami swoich klientów szybkim w zastosowaniu i relatywnie tanim rozwiązaniem tego problemu. Panaceum na kiepski zasięg sieci mają być wspomniane reapetery. Urządzenia te funkcjonują w powszechnej świadomości jako wzmacniacze sygnału sieci komórkowej. Na siłę sygnału komórkowego w miejscu jego odbioru wpływa nie tylko odległość od stacji bazowej, ale także forma ukształtowania terenu, układ budynków, rozkład ścian a nawet rodzaj materiału użytego do ich konstrukcji. Repeatery teoretycznie pozwalają obejść te ograniczenia, ponieważ przechwytują fale radiowe ze stacji bazowej i je powielają, emitując wzmocniony sygnał, który dociera, np. do naszego smartfonu. Identycznie działają także w kierunku do stacji bazowej, z tą różnicą, że wzmacniają sygnał od smartfonu.

Jednak właśnie w związku z tym przechwytywaniem sygnałów, repeatery stwarzają podstawowy problem, jakim jest zakłócanie prawidłowego działania sieci nawet w promieniu 10 kilometrów. Z tego powodu UKE wymaga od użytkowników uzyskania odpowiedniego pozwolenia na instalację wzmacniacza. Ponadto ,taka instalacja powinna być wykonana przez operatora sieci komórkowej. W Polsce za samowolę polegającą na uruchomieniu tego typu urządzenia grozi grzywna do 1000 zł i ograniczenie albo pozbawienie wolności do 2 lat. Dlatego refleksja nad zabawą w domorosłego radio-instalatora jest w tym przypadku wysoce zalecana.

Właśnie kwestia zakłóceń funkcjonowania całej struktury sieci w danej lokalizacji i fakt, że spora część repeaterów sprowadzanych z Chin nie posiada dokumentów potwierdzających zgodność ich wykonania z wymaganiami zasadniczymi dyrektywy 2014/53/UE (tzw. RED) determinuje penalizację takiej ingerencji w integralność infrastruktury sieci komórkowych. Pozostaje zasadnicze pytanie. Co z tą Krasuchą?

Otóż enigmatyczne urządzenie kryjące się pod tym sformułowaniem to rosyjski system o nazwie 1RL257 Krasucha-C4. Szerokopasmowa wielofunkcyjna stacja zagłuszająca produkowana jest od 2010 roku. System został zamontowany na czteroosiowym podwoziu BAZ-6910-022. Krasucha przeciwdziała wykrywaniu stosowanemu przez Statki Powietrzne Wczesnego Ostrzegania (AWACS) i innym powietrznym systemom radarowym. Charakteryzuje się zasięgiem skutecznie zakłócającym działanie satelitów na niskiej orbicie okołoziemskiej (LEO), może również spowodować trwałe uszkodzenie urządzeń radioelektronicznych.

Fot. Rosyjski system o nazwie 1RL257 Krasucha-C4. Szerokopasmowa wielofunkcyjna stacja zagłuszająca. Źródło: mil.ru

Fot. Rosyjski system o nazwie 1RL257 Krasucha-C4. Szerokopasmowa wielofunkcyjna stacja zagłuszająca. Źródło: mil.ru

Rosyjski system jest odpowiedzialny za strącenie co najmniej jednego drona rozpoznawczo-bojowego Bayraktar TB2 w ogarniętej wojną Syrii. Również radary naziemne mogą być zagłuszane przez Krasucha-4. Zakres częstotliwości, na której operuje system, faktycznie jest szeroki, bo rozciąga się od 8,5 GHz do 18 GHz. Zasięg skutecznego działania urządzenia to 300 kilometrów. Być może nie jest to nielegalny repeater sensu stricto, ale jego działanie wywołuje podobne skutki. Rosyjska broń radioelektroniczna ma na celu kontrolowanie widma fal elektromagnetycznych lub użycie ukierunkowanej energii w celu jego kontrolowania. Panowanie nad widmem elektromagnetycznym ułatwia atakowanie wroga, jak również ogranicza jego możliwości ofensywne poprzez odebranie przewagi wynikającej z wykorzystania systemów naprowadzania. Ataki radioelektroniczne mogą odbywać się z powietrza, morza, lądu lub przestrzeni kosmicznej dzięki zastosowaniu systemów załogowych i bezzałogowych. Takie ataki są najczęściej kierowane na komunikację, radary lub inne zasoby wojskowe i cywilne. Krasucha nie tylko zakłóca działanie sieci w promieniu 300 kilometrów.

System wręcz monopolizuje dostęp do niej. To potężne narzędzie do walki radioelektronicznej nie jest jednak jedynym asem w rękawie Rosjan.

Broń radioelektroniczna – czym jest i do czego służy

Armia rosyjska rozmieszcza swoje środki do walki radioelektronicznej na poziomie operacyjnym i taktycznym. Jednostki szczebla operacyjnego są zorganizowane w brygady, bataliony i kompanie. Każda z nich ma odrębne zadania polegające na wspieraniu szeroko pojętych działań wojennych. Brygady radioelektroniczne (WRE) są niezależnymi formacjami wojskowymi zapewniającymi operacyjną i strategiczną ofensywę WRE na przydzielonym rejonie konfliktu zbrojnego. Jednostki te nie tylko wspomagają walkę wojsk lądowych, ale biorą również udział w naziemnej obronie przeciwlotniczej. Wydaje się, że podobną rolę pełnią Samodzielne Bataliony WRE. Taktyczna wojna elektroniczna jest zapewniana dzięki Kompaniom WRE, które odpowiadają za wyposażenie sprzętowe formacji manewrowych armii rosyjskiej. Typowa Samodzielna Brygada WRE jest w stanie prowadzić wojnę elektroniczną na dużej części teatru działań. Zadaniem takich jednostek jest zagłuszanie wrogich radarów powietrznych, sieci telefonii komórkowej i łączności radiowej o wysokiej częstotliwości. Szczegółowy skład systemów radioelektronicznych składających się na Samodzielną Brygadę WRE przedstawiamy w tabeli poniżej:

| Nazwa systemu |

Zastosowanie systemu |

Zakres częstotliwości |

| 1 x Murmańsk-BN |

Rozpoznanie promieniowania elektromagnetycznego (COMINT) Zagłuszanie komunikacji (COMJAM) radiowej opartej na falach krótkich |

3 MHz – 30 MHz |

| 1 x RB-341V Leer -3 |

Rozpoznanie promieniowania elektromagnetycznego (COMINT) i zagłuszanie komunikacji (COMJAM) sieci komórkowych |

30 MHz – 3 GHz |

| 1 x IL269 Krasucha-2.0 |

Zakłócanie radarów powietrznych |

1 GHz – 2 GHz |

| 1 x 1RL257 Krasucha-C4 |

Zakłócanie radarów powietrznych |

8,5 GHz – 18 GHz |

| 1 x 1L267 Moskwa-1 |

System radarów pasywnych odpowiedzialny za rozpoznanie promieniowania elektromagnetycznego (COMINT) |

30 MHz – 18 GHz |

Jednostkom manewrowym armii rosyjskiej, takim jak pułki strzelców zmotoryzowanych, brygady i dywizje zmechanizowane oraz brygady czołgów, często towarzyszą kompanie WRE. Jednak według publicznie dostępnych źródeł informacji nie wszystkie oddziały posiadają w swoim składzie systemy do prowadzenia tego typu działań. W przypadku ich nieobecności formacje te muszą polegać na zapewnieniu wsparcia radioelektronicznego przez Samodzielne Brygady i Bataliony WRE na szczeblu okręgów wojskowych. Kompanie WRE zapewniają takim jednostkom wsparcie na poziomie taktycznym. Ma to pomóc jednostce manewrowej w szybkim osiągnięciu strategicznego celu. Rosyjskie Kompanie WRE wdrażają duże ilości systemów obejmujących różne zakresy fal. Skład typowej kompanii WRE prezentujemy w tabeli poniżej:

| Nazwa systemu |

Zastosowanie systemu |

Zakres częstotliwości |

| 1 x RP-330KPK |

Systemy dowodzenia C2 (Command and control) |

Brak danych |

| 1 x R-330K |

Systemy dowodzenia C2 (Command and control) |

Brak danych |

| 2 x R-325UMV |

COMINT/COMJAM fal krótkich |

1,5 MHz – 30 MHz |

| 2 x R-378B |

COMINT/COMJAM fal krótkich |

1,5 MHz – 30 MHz |

| 2 x R-330B |

COMINT/COMJAM fal metrowych VHF |

30 MHz – 100 MHz |

| 1 x R-330Z |

Zakłócanie systemów nawigacji satelitarnej opartych na GNSS (m.in. GPS) oraz COMINT/COMJAM fal VHF i decymetrowych fal UHF |

100 MHz – 2 GHz |

| 2 x SPR-2/RTUT-B |

Zagłuszanie pracy bezpieczników stosowanych w broni detonowanej drogą radiową |

95 MHz – 420 MHz |

| 21 x RP-377U/UV |

COMJAM fal VHF i fal UHF |

30 MHz – 3 GHz |

| 2 x R-934B |

COMJAM fal VHF w zakresie częstotliwości używanych przez lotnictwo cywilne |

20 MHz – 2 GHz |

Niektóre systemy wykorzystywane przez brygady i kompanie WRE armii rosyjskiej są montowane na pojazdach. Inne, takie jak RP-377U/UV, mieszczą się w zestawie plecakowym. Eksperci uważają, iż poza RP-377U/UV pozostałe systemy radioelektroniczne Rosjan mogą być używane wyłącznie stacjonarnie. Oznacza to, że nie mogą posuwać się wraz z siłami manewrowymi. To istotne ograniczenie zmusiło strategów Władimira Putina do stosowania taktyki tzw. parasoli radioelektronicznych osłaniających postępujące oddziały przed atakami przeciwnika.

Jak widać, szerokie spektrum wykorzystywanych przez Rosjan systemów WRE pozwala ich wojskom na:

• zagłuszanie i przechwytywanie komunikacji opartej na falach krótkich;

• zagłuszanie i przechwytywanie komunikacji opartej na falach VHF i UHF;

• zagłuszanie i przechwytywanie komunikacji opartej na sieciach komórkowych;

• zakłócanie systemów nawigacji satelitarnej, np. GPS;

• zagłuszanie i przechwytywanie komunikacji przeznaczonej dla lotnictwa cywilnego;

• zagłuszanie pracy bezpieczników stosowanych w broni detonowanej drogą radiową.

Według serwisu militarnego Armada International Rosjanie rozmieścili na terenie Ukrainy sześć Niezależnych Brygad WRE, trzy Niezależne Bataliony WRE oraz dwie kompanie WRE. Dzięki zaangażowaniu tak dużych sił oczekują całkowitej dominacji w sferze wojny radioelektronicznej.

Jednak rzeczywistość szybko zweryfikowała imaginacje rosyjskich generałów. Okazało się, że taktyczne spekulacje najeźdźców były jedynie mrzonkami na temat cyfrowej supremacji ich wojsk. Kubeł zimnej wody na ich głowy wylał Elon Musk. Nie odmawiając sobie przy tym charakterystycznej dozy sarkazmu. Cały potencjał radioelektroniczny Rosjan został zniweczony przez komercyjny system telekomunikacyjny Starlink o czym pisaliśmy w zeszłym tygodniu. Dzięki wsparciu szefa SpaceX Ukraina otrzymała dużą ilość terminali Starlink, które pozostają jedynym kanałem komunikacji nie znajdującym się pod kontrolą armii Putina. Mimo prób zagłuszania sygnału, Starlinki w dalszym ciągu zapewniają Ukraińcom kontakt ze światem zewnętrznym.

Obwód Kaliningradzki – strefa wolna od sygnału GPS

W sobotę, 5 marca 2022 roku, w stolicy Finlandii – Helsinkach – doszło do spotkania prezydentów: Joe Bidena i Sauli Niinist. Przywódcy USA i Finlandii mieli rozmawiać na temat zacieśnienia współpracy militarnej i ewentualnego wstąpienia Finlandii w struktury sojuszu NATO. Pełna wzajemnych kurtuazji wizyta nie skupiła zbyt wielkiej uwagi wśród serwisów informacyjnych. Jednak konsekwencje spotkania okazały się dużo dalej idące niż polityczne deklaracje o zacieśnieniu relacji. Wkrótce po zakończeniu spotkania piloci fińskich linii lotniczych Finnair zaczęli informować o zakłóceniach sygnału GPS, które napotkali podczas przelotów w pobliżu Obwodu Kaliningradzkiego.

Według Fińskiej Agencji Transportu i Komunikacji Traficom, 10 lotów rejsowych napotkało utrudnienia spowodowane utratą nawigacji. Według dyrektora Traficom Jari Pöntinena samoloty Finnair są wyposażone w alternatywne systemy nawigacji, które pozwalają na kontynuowanie lotu mimo utraty sygnału GPS. Niestety tyle szczęścia nie mieli klienci litewskich linii lotniczych Transaviabaltika. Litewski przewoźnik był zmuszony do odwołania 18 lotów rejsowych pomiędzy Helsinkami i lotniskiem Savonlinna położonym w południowo-wschodniej Finlandii. Lotnisko w Savonlinna nie jest wyposażone w alternatywny system nawigacji. Według ekspertów próba startu lub lądowania w tak trudnych warunkach może doprowadzić do katastrofalnych konsekwencji. Członek zarządu Tranaviabaltika Rene Must poinformowała, iż przewoźnik 3-krotnie podejmował próbę lotu między Helsinkami i Savonlinna. Wszystkie z nich zakończyły się niepowodzeniem. Mimo licznych próśb o komentarz biuro prasowe Kremla nie udzieliło żadnej odpowiedzi. Według części ekspertów ds. wojny radioelektronicznej utrudnienia jakie napotkali piloci z Finlandii i Litwy mogły być zaledwie częścią szerszej kampanii wymierzonej w Europę. Jak wygląda ingerencja w systemy nawigacyjne oparte na GPS?

Władimir Putin Le Grand Spoofer

Oszustwa na tzw. wnuczka są plagą, która od kilku lat dotyka polskich seniorów. Krętacze podający się za wnuki potencjalnych ofiar wyłudzają od nich oszczędności, niejednokrotnie gromadzone przez całe życie. Ten rodzaj przestępczości jest relatywnie nieskomplikowany, a przy tym skrajnie bezczelny. Zorganizowana grupa oszustów telefonuje (przede wszystkim na telefony stacjonarne) podając się za członka rodziny, który wpadł w konflikt z prawem. Jedynym sposobem na uwolnienie się spod odpowiedzialności karnej jest wpłata dużej kwoty na konto prokuratury lub jednostki Policji. Po omówieniu szczegółów przekazania pieniędzy na miejscu pojawia się tzw. odbierak (osoba odbierająca gotówkę) i znika z kopertą wypełnioną banknotami. Tego typu oszustwa stały się jednak retro. Nową modą w świecie oszustów jest tzw. spoofing.

Spoofer preferuje bardziej wyszukaną metodę kontaktu i wyłudzenia. Spoofing to oszustwo, w którym przestępca podszywa się pod pewną osobę, firmę lub inne zaufane źródło. Cele takiego ataku mogą być różne: kradzież informacji, przekonanie ofiary do zainstalowania złośliwej aplikacji albo wprowadzenie zamieszania i destabilizacji. Bardzo często przestępcy chcą uzyskać dostęp do cudzego konta bankowego. Można wyróżnić wiele rodzajów spoofingu: telefoniczny, e-maila, IP, URL czy danych GPS. Oczywistą oczywistością jest to, że król petrodolarów Władimir Putin nie wysyła linków internetowych na komórki Europejczyków, aby uzyskać dostęp do ich kont bankowych. Jednak w kwestii spoofingu GPS rosyjski dyktator nie ma sobie równych.

Ten rodzaj „naciągania” polega na zmanipulowaniu odbiornika GPS poprzez nadawanie sfałszowanego sygnału. Taki sygnał ma za zadanie imitować standardowy, prawidłowy sygnał GPS. Może również powtórnie nadawać oryginalny sygnał zdobyty w innym miejscu lub o innym czasie. Te sfałszowane sygnały mogą być modyfikowane w taki sposób, by odbiorca błędnie oszacował swoją aktualną pozycję. Jedna z form ataku GPS spoofing, nazywana atakiem carry-off, zaczyna się od nadania sygnału GPS zsynchronizowanego z oryginalnym sygnałem obserwowanym przez cel ataku. Siła sygnału sfałszowanego jest stopniowo zwiększana i zmieniana w stosunku do oryginalnego sygnału.

Taki typ ataku doprowadził do przechwycenia drona Lockheed Martin RQ-170 w północno-wschodnim Iranie w 2011 roku. Grupa studentów mechaniki z Cockrell School of Engineering w University of Texas w Austin przeprowadziła pozorowany atak na luksusowy jacht „Biała Róża” w 2013 roku, aby udowodnić skuteczność spoofingu GPS. Jacht był mylnie nawigowany przy użyciu sfałszowanego sygnału z Monako do wyspy Rodos. Studenci przebywający na pokładzie jachtu wykorzystali urządzenia generujące fałszywy sygnał GPS i dzięki stopniowemu zwiększaniu jego sygnału zdominowali siłę sygnału prawdziwego satelity, doprowadzając w efekcie do zmiany kursu jachtu.

Wracając do Rosjan – od początku 2021 roku w międzynarodowych serwisach informacyjnych pojawiały się materiały na temat kurortu Gelendżyk położonego nad Morzem Czarnym. Według rosyjskiego opozycjonisty Aleksieja Nawalnego, znajduje się tam kompleks budynków zbudowany dla prezydenta Rosji. Nawalny uważa, iż jest to nowy pałac Władimira Putina.

Inwestycja warta około miliarda dolarów jest tajemnicą poliszynela. Nie zmienia to faktu, że rosyjski prezydent nie lubi wścibskich oczu na swoich nieruchomościach. Prawdopodobnie z tego powodu region Morza Czarnego stał się Mekką spoofingu GPS. Jedno z fałszerstw było szczególnie niepokojące. W 2017 roku francuski tankowiec Atria płynący do rosyjskiego portu Noworosyjsk napotkał niespodziewane problemy z nawigacją GPS. Według załogi statku podczas rejsu uruchomiony został alarm nawigacyjny (GPP). Nawigacja tankowca wskazywała, iż znajduje się on nie na wodzie, lecz na lądzie, a do tego na terenie oddalonego o 26 kilometrów lotniska Gelendżyk. Zaniepokojony kapitan skontaktował się z innymi statkami w okolicy. Pozostałe załogi zgłaszały dokładnie ten sam problem. Amerykańska Administracja Morska (MARAD) ostrzegła fregaty znajdujące się w tej części Morza Czarnego o potencjalnym zagrożeniu. Sygnały z Globalnego Systemu Nawigacji Satelitarnej (GNSS, w tym GPS) w pobliżu kurortu wydają się być bardzo często zakłócane lub zniekształcane. Nie był to pierwszy przypadek spoofingu GPS, o który podejrzewa się Władimira Putina.

Wiosną 2019 roku amerykański non-profit Center for Advanced Defense Studies (C4ADS) opublikował raport na temat rosyjskiego spoofingu. Analitycy oparli swój raport na trzech źródłach: danych dostępnych publicznie, danych z systemów automatycznej identyfikacji statków (AIS) oraz odbiornika GPS zainstalowanego na Międzynarodowej Stacji Kosmicznej (ISS). Według analizy Rosja jest „pionierem” w technikach fałszowania, które były wykorzystywane częściej niż dotychczas. Przede wszystkim do ochrony VIP-ów i obiektów strategicznych. Nie jest jasne, czy incydent z tankowcem był bezpośrednio powiązany z domniemanym pałacem Putina. Jednak C4ADS spekuluje, że mógł mieć więcej wspólnego z wizytą rosyjskiego prezydenta w Anapa nad Morzem Czarnym, gdzie obserwował postępy w budowie gazociągu TurkStream. W latach 2016–2018 na tym obszarze odnotowano ponad 4600 przypadków spoofingu, a raport sugerował, że Gelendżyk jest odwiedzany przez funkcjonariuszy służb bezpieczeństwa. Jest to zgodne z popularnymi, ale niepotwierdzonymi doniesieniami, że prezydent Władimir Putin ma prywatną rezydencję na obrzeżach miasta.

Po przeanalizowaniu kilku hipotez analitycy C4DS uważają, że system fałszowania GNSS używany w pobliżu Gelendżyk ma formę instalacji naziemnej. Biorąc pod uwagę częsty charakter podszywania się pod GNSS w pobliżu kurortu i szeroko zakrojony spoofing GPS oddziałujący na przepływające w okolicy statki, wydaje się, że równie istotnym powodem takich działań może być bliskie położenie portu Noworosyjsk. Noworosyjsk jest jednym z największych portów głębinowych w Rosji. Jest to siedziba dużego kontyngentu rosyjskiej Floty Czarnomorskiej. Czy problemy Fińskich i Litewskich linii lotniczych spowodowane były spoofingiem rosyjskich jednostek stacjonujących w Obwodzie Kaliningradzkim? Ciężko jednoznacznie odpowiedzieć na to pytanie. Jednak dotychczasowa ingerencja służb Władimira Putina w systemy GPS uprawdopodabnia taką hipotezę.

Latający BTS

Opisany rodzaj szachrajstwa jest szczególnie niebezpieczny dla statków morskich i powietrznych. Jednak przeciętny Kowalski nie posiada w swoim garażu Boeinga 737 czy kontenerowca przewożącego ropę naftową z Bliskiego Wschodu. Jednym z narzędzi do prowadzenia WRE są drony wyposażone w wyposażenie takie, jak instalowane w stacjach bazowych telefonii komórkowej. Bezzałogowe statki powietrzne jako stacje bazowe (Unmanned Aerial Vehicle as Base Stations, UAV-BS) to obiecująca technologia łagodzenia awarii naziemnych stacji bazowych lub stająca się idealnym tymczasowym rozwiązaniem do odciążenia przeładowanej sieci.

UAV-BS może zostać wdrożony w celu uzupełnienia istniejących systemów komórkowych poprzez zapewnienie dodatkowej pojemności dla obszarów, które tego wymagają. Takie instalacje są w stanie zapewnić zasięg sieci w sytuacjach krytycznych dla bezpieczeństwa publicznego, na przykład podczas zgromadzeń i marszów. Niestety, jak z każdą nową technologią, również w tej sytuacji napotykamy pewien dylemat. Urządzenia tego typu mogą równie dobrze być wykorzystywane do szeroko zakrojonych akcji spoofingowch. UAV-BS dają np. możliwości wysyłania fałszywych SMS-ów czy zbierania informacji, etc.

Już w 2013 roku amerykańska firma Harris Corporation wyprodukowała urządzenie o nazwie Stingray (Płaszczka). Płaszczka to moduł do przechwytywania tożsamości abonentów mobilnych tzw. IMSI-catcher. Płaszczka jest używana do przechwytywania ruchu z telefonów komórkowych i śledzenia danych o lokalizacji ich użytkowników. Moduł pełni rolę „fałszywej” stacji bazowej i staje się pośrednikiem między docelowym telefonem komórkowym, a rzeczywistymi antenami dostawcy usług. Taka procedura nazywana jest atakiem „man-in-the-middle” (MITM). Standard bezprzewodowy 3G i 4G zapewnia pewne ograniczenie ryzyka ze względu na wzajemne uwierzytelnianie wymagane zarówno od telefonu, jak i sieci. Jednak zaawansowane ataki są w stanie obniżyć poziom 3G i 4G do usług sieciowych niewymagających wzajemnego uwierzytelniania. Moduły IMSI-catcher są używane w wielu krajach przez organy ścigania i agencje wywiadowcze. Ich stosowanie wzbudziło poważne obawy dotyczące swobód obywatelskich i prywatności. Dlatego jest ono ściśle regulowane. Gdyby tak potężna technologia została użyta przez wrogie siły na terenie objętym wojną, na przykład w celu wysyłania wiadomości SMS do lokalnej ludności odwołujących alarm bombowy, wówczas skutki mogłyby się okazać tragiczne.

Limity PEM w Rosji. Definicja hipokryzji

Rosja od czasów sowieckich nie zrewidowała przepisów określających dopuszczalne poziomy pól elektromagnetycznych. Jest to frapująca dychotomia. Z jednej strony administracja Władimira Putina wywierała duży nacisk na szybki rozwój rodzimej infrastruktury 5G. Z drugiej strony kurczowo trzyma się anachronicznych przepisów z zamierzchłych czasów. Przepisów, które de facto uniemożliwiają wdrożenie nowej technologii mobilnej. Nie jest to jedyny przejaw hipokryzji Rosjan. Kraj, w którym limit PEM wynosi 0,1 W/m2 nie ma najmniejszego problemu z wytaczaniem infrastruktury WRE, która emituje PEM przekraczający ten limit o rzędy wielkości. Wynika to między innymi z faktu, iż limit dotyczy wyłącznie urządzeń komercyjnych. Licencje wydawane agencjom rządowym i wojsku działają na podstawie innych przepisów.

Rosyjska administracja słynie z moralizowania międzynarodowych agencji takich jak ICNIRP w kontekście opracowanych przez nie limitów PEM. Zarzuca ich naukowcom szachowanie życiem i zdrowiem miliardów ludzi na całym świecie. Tego typu hipotezy wysuwa państwo, które ma długą i bujną historię tworzenia konstrukcji zagłuszających i szpiegowskich, które za nic miało zdrowie i życie ludzkie. Konstrukcji, które nie były ograniczone żadnymi limitami, a cel ich funkcjonowania wynikał z najbardziej prymitywnych pobudek. Nie jest to pierwsza sytuacja moralnej ekwilibrystyki uprawianej przez Władimira Putina. Miejmy jednak nadzieje, że będzie jedną z ostatnich.

O projekcie

Projekt „Sprawna telekomunikacja mobilna jako klucz do rozwoju i bezpieczeństwa” realizowany przez KPRM we współpracy z Instytutem Łączności – Państwowym Instytutem Badawczym w ramach Programu Operacyjnego Polska Cyfrowa Działanie 3.4. Kampania ma na celu zwiększenie świadomości Polaków w zakresie działania, wykorzystania, bezpieczeństwa i znaczenia mobilnych sieci telekomunikacyjnych, a tym samym usług (w tym publicznych) opartych o te sieci. W ramach projektu zrealizowane zostaną działania w następujących obszarach: walka z dezinformacją, edukacja, podstawy prawne procesu inwestycyjnego, bezpieczeństwo i jakość życia.

Autor: Instytut Łączności – Państwowy Instytut Badawczy

Fot. Rosyjski system o nazwie 1RL257 Krasucha-C4. Szerokopasmowa wielofunkcyjna stacja zagłuszająca. Źródło: mil.ru

Fot. Rosyjski system o nazwie 1RL257 Krasucha-C4. Szerokopasmowa wielofunkcyjna stacja zagłuszająca. Źródło: mil.ru