Amazon Web Services to największa na świecie firma świadcząca usługi chmurowe. Jak to się stało? Czym różni się chmura AWS od innych oraz czym jest multicloud i konteneryzacja? Na te pytania odpowiada Tomasz Stachlewski, CEE Solutions Architecture Manager, Amazon Web Services.

Przemysław Kucharzewski, BrandsIT: Na początek może powiesz mi, skąd w ogóle wziął się AWS, ponieważ pewnie większość ludzi kojarzy Amazona jako potentata e-commerce…

Tomasz Stachlewski, CEE Solutions Architecture Manager, Amazon Web Services: AWS, jeśli chodzi o tę część chmurową Amazona, powstał 13 lat temu. Geneza była prosta – Amazon poprzez sklep internetowy amazon.com zbudował swoje know-how, czyli kompetencje i technologię, która była wykorzystywana do tego, żeby rzeczywiście zarządzać, obsługiwać swój sklep internetowy w sposób bezpieczny i skalowalny oraz globalny. W pewnym momencie firma wyszła z założenia, że technologię, którą sama wypracowała, można zacząć udostępniać innym podmiotom jako usługa „Pay as you go”. Można powiedzieć, że te 13 lat temu pojęcie chmury publicznej praktycznie nie istniało, więc produkt i usługi, które zaproponował AWS były czymś wyjątkowo nowym. Początkowo były to usługi storage’owe do przechowywania danych czy też usługi compute czy „serwery na godziny”. Z początku wszyscy byli zaskoczeni, że firma, która zajmuje się paczkami i sklepem internetowym, wchodzi w świat typowo data center. Okazało się, że rzeczywiście ten pomysł wypalił. Na początku klientami były głównie start-upy, dla których było to genialne rozwiązanie, ponieważ nie musiały na początku działalności inwestować we własny sprzęt serwerowy. Nowe firmy mogły skorzystać z usług AWS, uruchomić kilka czy nawet kilka tysięcy serwerów na godziny. Istotnym elementem było również małe ryzyko konsekwencji niepowodzenia – jak to w świecie start-upów, nie każdy osiąga sukces. W przypadku niepowodzenia firma taka mogła po prostu zamknąć wszystkie swoje serwery i skupić się być może na nowych pomysłach. Przykładem takiego podejścia jest np. Rovio – firma, która stworzyła kilkadziesiąt różnego rodzaju gier mobilnych – które jednak nie osiągnęły zamierzonego celu, aż wreszcie – któregoś dnia, Rovio stworzyło Angry Birds – grę która opanowała dziesiątki milionów użytkowników komórek na świecie i stała się hitem. To pokazuje również inny powód, dla którego chmura stała się tak popularnym mechanizmem i sposobem działania start-up – czyli skalowalność: jeśli okazywało się, że pomysł wypalił, to z kilku pojedynczych serwerów można było przejść na 100, 200 czy niemal dowolną ilość, która była potrzebna – i to wszystko w ciągu minut. Dlatego start-upy pokochały chmurę publiczną i AWS. Po pewnym czasie klientami AWS stały się też inne małe, średnie firmy i korporacje, takie jak General Electric, Siemens czy Philips, które zaczęły korzystać z chmury. Czasami były to pełne migracje do chmury, czasami była to tylko pewna część, jakaś aplikacja, procesy np. środowiska SAPowe, disaster recovery. Tak jak wspominałem, na początku, 13 lat temu AWS udostępniał zaledwie kilka rodzajów usług, jak serwery wirtualne i przechowywanie danych, obecnie zaś AWS to platforma z ponad 175 usługami: sztuczna inteligencja, robotyka, IoT, narzędzia do budowania oprogramowania, moc obliczeniowa, konteneryzacja, analityka, bezpieczeństwo i wiele innych. Koncepcję korzystania z chmury można porównać do klocków Lego – gdzie wykorzystujemy i budujemy coś (w tym przypadku aplikacje i systemy) – z tych klocków (czyli usług) – które najlepiej spełniają nasza potrzebę i zbliżają nas do upragnionego celu.

Tomasz Stachlewski, CEE Solutions Architecture Manager, Amazon Web Services: AWS, jeśli chodzi o tę część chmurową Amazona, powstał 13 lat temu. Geneza była prosta – Amazon poprzez sklep internetowy amazon.com zbudował swoje know-how, czyli kompetencje i technologię, która była wykorzystywana do tego, żeby rzeczywiście zarządzać, obsługiwać swój sklep internetowy w sposób bezpieczny i skalowalny oraz globalny. W pewnym momencie firma wyszła z założenia, że technologię, którą sama wypracowała, można zacząć udostępniać innym podmiotom jako usługa „Pay as you go”. Można powiedzieć, że te 13 lat temu pojęcie chmury publicznej praktycznie nie istniało, więc produkt i usługi, które zaproponował AWS były czymś wyjątkowo nowym. Początkowo były to usługi storage’owe do przechowywania danych czy też usługi compute czy „serwery na godziny”. Z początku wszyscy byli zaskoczeni, że firma, która zajmuje się paczkami i sklepem internetowym, wchodzi w świat typowo data center. Okazało się, że rzeczywiście ten pomysł wypalił. Na początku klientami były głównie start-upy, dla których było to genialne rozwiązanie, ponieważ nie musiały na początku działalności inwestować we własny sprzęt serwerowy. Nowe firmy mogły skorzystać z usług AWS, uruchomić kilka czy nawet kilka tysięcy serwerów na godziny. Istotnym elementem było również małe ryzyko konsekwencji niepowodzenia – jak to w świecie start-upów, nie każdy osiąga sukces. W przypadku niepowodzenia firma taka mogła po prostu zamknąć wszystkie swoje serwery i skupić się być może na nowych pomysłach. Przykładem takiego podejścia jest np. Rovio – firma, która stworzyła kilkadziesiąt różnego rodzaju gier mobilnych – które jednak nie osiągnęły zamierzonego celu, aż wreszcie – któregoś dnia, Rovio stworzyło Angry Birds – grę która opanowała dziesiątki milionów użytkowników komórek na świecie i stała się hitem. To pokazuje również inny powód, dla którego chmura stała się tak popularnym mechanizmem i sposobem działania start-up – czyli skalowalność: jeśli okazywało się, że pomysł wypalił, to z kilku pojedynczych serwerów można było przejść na 100, 200 czy niemal dowolną ilość, która była potrzebna – i to wszystko w ciągu minut. Dlatego start-upy pokochały chmurę publiczną i AWS. Po pewnym czasie klientami AWS stały się też inne małe, średnie firmy i korporacje, takie jak General Electric, Siemens czy Philips, które zaczęły korzystać z chmury. Czasami były to pełne migracje do chmury, czasami była to tylko pewna część, jakaś aplikacja, procesy np. środowiska SAPowe, disaster recovery. Tak jak wspominałem, na początku, 13 lat temu AWS udostępniał zaledwie kilka rodzajów usług, jak serwery wirtualne i przechowywanie danych, obecnie zaś AWS to platforma z ponad 175 usługami: sztuczna inteligencja, robotyka, IoT, narzędzia do budowania oprogramowania, moc obliczeniowa, konteneryzacja, analityka, bezpieczeństwo i wiele innych. Koncepcję korzystania z chmury można porównać do klocków Lego – gdzie wykorzystujemy i budujemy coś (w tym przypadku aplikacje i systemy) – z tych klocków (czyli usług) – które najlepiej spełniają nasza potrzebę i zbliżają nas do upragnionego celu.

BrandsIT: Mówisz chmura, data center, ale przecież w naszym kraju można znaleźć lokalnych graczy, którzy oferują podobne usługi. Jaka jest Wasza przewaga nad usługami takich firm?

Tomasz Stachlewski: Pojęcie chmura jest dość popularne w dzisiejszym świecie, ale chmura chmurze nierówna. Gdybym miał porównać podejście między lokalnymi dostawcami chmury a dostawcami globalnymi, to wymieniłbym trzy. Po pierwsze to globalny zasięg, niezależnie od tego czy jesteśmy start-upem czy korporacją, AWS daje możliwość uruchamiania aplikacji na całym świecie przez każdego z klientów czy użytkowników niezależnie od lokalizacji zapewniając odpowiednią dostępność i wydajność. Mogę podać tu taki przykład jak Netflix, który zawsze chciał być jak najbliżej użytkownika. Netfilix ze start-upu stał się gigantyczną firmą. Chmura publiczna pozwoliła takiej firmie na funkcjonowanie w obrębie całego świata. Jednak podobne historie mamy również w Polsce – wystarczy wspomnieć o CodeWise – start-up który wykorzystał globalną infrastrukturę AWS do zawojowania świata swoimi produktami i usługami.

Drugą sprawą jest skalowalność. Kupując usługi u lokalnego gracza często kupujemy po prostu serwery i storage – oczywiście możemy zwiększyć skalę, ale zazwyczaj sam proces zwiększania jest wydłużony i często obarczony zobowiązaniem na dłuższy okres czasu. W przypadku globalnego gracza, jakim jest AWS, skalę możemy zwiększyć w ciągu chwili. W Polsce mamy przykład takiego start-upu jakim jest Brainly, portal edukacyjny skupiający osoby potrzebujące pomocy w nauce i wiąże osoby udzielające pomocy. W tej chwili jest to gigantyczna firma, obsługuje 35 krajów na całym świecie. Początkowo operowali w lokalnym data center, 100 serwerów i 2-3 lata temu zmigrowali właśnie do AWS. To, co zaważyło nad migracją to skalowalność, wiadomo, że weekendy, ferie, święta czy wakacje, to dużo mniejsza potrzeba na usługi edukacyjne. W takich okresach firma skalowała się w dół, więc nie płaciła za niepotrzebną moc. Odwrotnie na koniec semestru czy roku szkolnego firma musi się skalować w górę, ponieważ jest dużo większe zainteresowanie usługami. Firma aktualnie używa około 1300 serwerów. Dzięki skalowalności mogli zoptymalizować koszty nawet o 50% w dół.

Ostatni element, o którym chciałbym wspomnieć to to, że chmura to nie jest tylko data center. To nie jest tylko zewnętrzna serwerownia. Prawdziwa chmura to szereg usług dodatkowych, których w AWS jest już ponad 200. Serwer wirtualny to tylko jedna z nich. Jeśli chcemy budować coś nowego, to w chmurze AWS mamy dostępne usługi np. takie jak analiza zdjęć, analiza tekstu, rozpoznawanie mowy, usługi blockchainowe, robotyka, Internet Rzeczy.

Przykładowo mogę powiedzieć, że jeszcze cztery lata temu było dostępnych około 60 usług w porfolio AWS. Na podstawie analizy potrzeb i informacji od naszych klientów, każdego kwartału dodajemy nowe usługi dostępne dla wszystkich klientów AWS.

Chmura taka jak AWS jest takim wehikułem, który pozwala na szybki i tani dostęp do technologii.

BrandsIT: AWS nie jest jedynym globalnym graczem w zakresie chmury publicznej. Czym więc wyróżnia się AWS względem np. Google Cloud czy Microsoft Azure?

Tomasz Stachlewski: Na świecie jest kilku znaczących graczy chmurowych. Widać też, że z roku na rok rynek chmury coraz bardziej się koncentruje. Rynek chmury publicznej jest gigantyczny. AWS nigdy nie zakładał, że będzie na nim jedyny, ale był pierwszy i jest największy. Raporty firm trzecich zakładają, że AWS jest kilkukrotnie większy od wszystkich pozostałych globalnych graczy, jeśli chodzi o infrastrukturę. AWS wyróżnia się przede wszystkim liczba klientów korzystającą z usług – są ich miliony, co oznacza, że klienci są zadowoleni z usług przez nas oferowanych. To są miliony firm, zaczynając od 1-2 osobowych, skończywszy na największych korporacjach na świecie. Drugą różnicą jest portfolio oferowanych usług. Tak jak wspominałem, wcześniej jedną z nich jest serwer wirtualny – ale AWS ma około 200 różnych typów serwerów wirtualnych – dużo więcej niż inni gracze. Dochodzi do tego elastyczność przy wyborze narzędzi, chociażby sztuczna inteligencja, gdzie mamy kilkanaście różnych usług. Wspieramy 15 typów różnych baz danych, od relacyjnych po nierelacyjne. Konkurencja ma dwa razy mniej. Pracuję w AWS już pięć lat i to co mogę powiedzieć, to że AWS stawia na długoterminową współpracę. Zależy nam na tym, żeby nasi klienci byli zadowoleni nie tylko teraz, ale za rok i za dwa.

BrandsIT: A dlaczego partnerzy współpracują z AWS?

Tomasz Stachlewski: Musimy na początek rozgraniczyć partnerów na dwa rodzaje. Z jednej strony mamy partnerów, którzy są typowymi integratorami czy też firmami deweloperskimi – dla nich chmura publiczna jest wehikułem nowych technologii, dzięki któremu jest to nowe portfolio usług i możliwości, które mogą zaprezentować swoim klientom. Mogą powiedzieć, że zbudują nie tylko sklep internetowy, ale sklep ze wsparciem sztucznej inteligencji, czytającej tekst, rozpoznającej zdjęcia, będzie analizował transakcje w sklepie, korelacje produktów. Jest to dla partnerów budowanie przewagi konkurencyjnej. Nasi partnerzy współpracują z AWS z powodu szybkości budowania aplikacji na bazie usług AWS. Przykładowo, klient chce budować środowisko SAPowe. Zamówienie i realizacja dostawy odpowiedniego sprzętu oznacza kilka tygodni czy nawet trzy miesiące czekania. W przypadku AWS można było zrealizować uruchomienie środowiska w ciągu kilku minut. Dodatkowo, okazało się, że zamówiony sprzęt byłby przeskalowany, więc zbyt duży względem potrzeb.

Drugim rodzajem partnerów są firmy budujące aplikacje i chcące je sprzedawać globalnie. W AWS mamy tzw. AWS Marketplace, czyli miejsce, gdzie oferowane jest oprogramowanie firm trzecich, które może być nabywane przez innych klientów AWS – aktualnie jest to 7000 rozwiązań pochodzących od 1500 niezależnych producentów oprogramowania. Dzięki temu, ISV otrzymują łatwość dotarcia do milionów klientów na całym świecie bez konieczności podpisywania osobnych umów z każdym z klientów, ponieważ dany klient ma po prostu umowę z AWS, zaś rozliczenie między ISV a użytkownikiem aplikacji odbywa się za pośrednictwem AWS.

BrandsIT: Jak jeszcze AWS wspiera start-upy?

Tomasz Stachlewski: AWS oferuje kilka elementów wsparcia młodych firm. Po pierwsze, program AWS Educate, czyli wsparcie finansowe polegające na finansowaniu usług AWS. Wsparcie uzależnione jest od potencjału projektu i oznacza możliwość sfinansowania na poziomie do 100.000$. Żeby uzmysłowić jaki to jest poziom wsparcia, to w ubiegłym roku był to poziom 500M$ w skali globalnej, gdzie wsparliśmy dziesiątki tysięcy firm. Oprócz tego, startupy mają dostęp do wsparcia 24/7, gdzie firmy mają dostęp do szybkiej pomocy w przypadku jakichś trudności czy problemów, których nie potrafią samodzielnie rozwiązać. Dodatkowo, jest to dostęp do naszych oficjalnych szkoleń i obecność na naszych blogach czy uczestnictwo w wydarzeniach, które organizuje AWS, zarówno jako prelegentów jak i uczestników. Mamy dedykowane osoby, Business Development Managerów, które lokalnie wspierają młode firmy we współpracy z AWS. W Polsce z bardzo udanych pomysłów to oprócz Brainly był to CodeWise, Applica.ai

BrandsIT: Ostatnimi czasy dużo mówi się o takich pojęciach jak multicloud i konteneryzacja. Czy mógłbyś przybliżyć naszym Czytelnikom, o co w tym chodzi?

Tomasz Stachlewski: Pojęcie multicloud wiąże się z tym, że część firm chce budować swoje aplikacje w oparciu o wiele różnych środowisk chmurowych. Z naszych obserwacji wynika, że wiele firm o tym mówi, jednak niewiele się na takie rozwiązanie ostatecznie decyduje, ponieważ nie jest to proste. Przede wszystkim dlatego, że każda chmura jest inna – chociażby w AWS jest dwieście różnych usług, mamy różne bazy danych, czy usługi sztucznej inteligencji. Jak popatrzymy na poszczególnych dostawców usług chmurowych, to każdy z nich ma odmienne portfolio usług realizowanych zazwyczaj w różny sposób. Jeśli ktoś chce budować aplikacje w modelu multicloud, to trzeba znaleźć taki wspólny mianownik u wszystkich dostawców chmury, gdzie wybrane usługi będą funkcjonować. Zazwyczaj okazuje się, że tym wspólnym mianownikiem jest jedynie serwer wirtualny. Czyli twórca aplikacji nie może w takim przypadku korzystać z usług dodatkowych oferowanych przez AWS, uzyskując innowacyjność.

Idea kontenerów to technologia, która może wspomóc budowanie środowisk multicloud, ale to nie tylko to. Idea kontenerów dockerowych to możliwość szybszego budowania aplikacji, ponieważ możemy w łatwy sposób przenosić aplikację z własnego laptopa do chmury, albo między jedną chmurą a drugą czy też między własną serwerownią a chmurą. Kontenery mają jeszcze więcej zalet: łatwość budowania aplikacji. Wiele nowych firm budujących aplikacje idzie albo drogą konteneryzacji albo drogą do serverless, która jest taką nirwaną, gdzie skupiamy się jedynie na tej biznesowej części, a zapominamy o serwerach czy kontenerach. Kontenery sa bardzo istotnym elementem w portfolio AWS, dlatego też udostępnia wiele usług, które są dedykowane dla takiego sposobu budowy aplikacji, warto tutaj wspomnieć o tzw. EKS Fargate – czyli możliwości uruchamiania klastrów Kuberneterosywch w modelu serverless – czyli bez potrzeby zarzadzania serwerami.

BrandsIT: Niedawno wróciłeś z Las Vegas z dorocznej konferencji Re:Ivent, na której AWS ogłosił kilka interesujących nowości.

Tomasz Stachlewski: Tak, dokładnie. W tym roku w konferencji wzięło udział 65.000 uczestników, trwała 4 dni, odbyło się 3000 sesji. Warto dodać, że połowa z tych sesji prowadzona jest przez specjalistów z AWS, a połowa prowadzona przez klientów AWS, która przychodzi i chce się pochwalić czy to nowym rozwiązaniem zbudowanym na bazie AWS, czy wykorzystaniem technologii oferowanych przez AWS. W części jest to wydarzenie czysto edukacyjne i networkingowe. W tym roku ogłoszono kilkadziesiąt nowości związanych głównie z zagadnieniem sztucznej inteligencji. Z nowych usług, które zaprezentowano to wykrywacz oszustw w sklepach internetowych (tzw. Amazon Fraud Detector), silnik sztucznej inteligencji potrafiący robić predykcję danych na podstawie informacji, którymi ten silnik został zasilony, czy też nowe środowiska programistyczne dla projektów sztucznej inteligencji.

AWS posiada na świecie w tej chwili 22 regiony. Ale zaczyna wychodzić ze swoich serwerowni w różny sposób. Pierwszym z nich jest możliwość zamówienia sprzętu AWS, który będzie można montować we własnych serwerowniach – czyli tzw. AWS Outposts. Pozwoli to na budowanie systemów hybrydowych. Impulsem do tego stała się również technologia 5G i pierwszymi firmami korzystającymi z takiej możliwości są teleoperatorzy jak Vodafone czy Horizon – w serwerowniach których AWS będzie lokował swój sprzęt za sprawą usługi AWS Wavelength. Takie podejście zostało wymuszone przez konieczność zapewnienia bardzo małych opóźnień między brzegiem sieci a infrastrukturą klienta.

Jako ciekawostkę podam, że AWS każdego roku wypuszcza jakąś zabawkę – gadżet edukacyjny. Dwa lata temu była to kamera z AI – AWS DeepLens, rok temu samochód AWS DeepRacer, który uczył się samemu jeździć, w tym roku natomiast była to klawiatura muzyczna AWS DeepComposer, które na podstawie zagranej melodii na klawiaturze potrafi odpowiednio zagrać całe tło innych instrumentów.

Tomasz Stachlewski, CEE Solutions Architecture Manager, Amazon Web Services: AWS, jeśli chodzi o tę część chmurową Amazona, powstał 13 lat temu. Geneza była prosta – Amazon poprzez sklep internetowy amazon.com zbudował swoje know-how, czyli kompetencje i technologię, która była wykorzystywana do tego, żeby rzeczywiście zarządzać, obsługiwać swój sklep internetowy w sposób bezpieczny i skalowalny oraz globalny. W pewnym momencie firma wyszła z założenia, że technologię, którą sama wypracowała, można zacząć udostępniać innym podmiotom jako usługa „Pay as you go”. Można powiedzieć, że te 13 lat temu pojęcie chmury publicznej praktycznie nie istniało, więc produkt i usługi, które zaproponował AWS były czymś wyjątkowo nowym. Początkowo były to usługi storage’owe do przechowywania danych czy też usługi compute czy „serwery na godziny”. Z początku wszyscy byli zaskoczeni, że firma, która zajmuje się paczkami i sklepem internetowym, wchodzi w świat typowo data center. Okazało się, że rzeczywiście ten pomysł wypalił. Na początku klientami były głównie start-upy, dla których było to genialne rozwiązanie, ponieważ nie musiały na początku działalności inwestować we własny sprzęt serwerowy. Nowe firmy mogły skorzystać z usług AWS, uruchomić kilka czy nawet kilka tysięcy serwerów na godziny. Istotnym elementem było również małe ryzyko konsekwencji niepowodzenia – jak to w świecie start-upów, nie każdy osiąga sukces. W przypadku niepowodzenia firma taka mogła po prostu zamknąć wszystkie swoje serwery i skupić się być może na nowych pomysłach. Przykładem takiego podejścia jest np. Rovio – firma, która stworzyła kilkadziesiąt różnego rodzaju gier mobilnych – które jednak nie osiągnęły zamierzonego celu, aż wreszcie – któregoś dnia, Rovio stworzyło Angry Birds – grę która opanowała dziesiątki milionów użytkowników komórek na świecie i stała się hitem. To pokazuje również inny powód, dla którego chmura stała się tak popularnym mechanizmem i sposobem działania start-up – czyli skalowalność: jeśli okazywało się, że pomysł wypalił, to z kilku pojedynczych serwerów można było przejść na 100, 200 czy niemal dowolną ilość, która była potrzebna – i to wszystko w ciągu minut. Dlatego start-upy pokochały chmurę publiczną i AWS. Po pewnym czasie klientami AWS stały się też inne małe, średnie firmy i korporacje, takie jak General Electric, Siemens czy Philips, które zaczęły korzystać z chmury. Czasami były to pełne migracje do chmury, czasami była to tylko pewna część, jakaś aplikacja, procesy np. środowiska SAPowe, disaster recovery. Tak jak wspominałem, na początku, 13 lat temu AWS udostępniał zaledwie kilka rodzajów usług, jak serwery wirtualne i przechowywanie danych, obecnie zaś AWS to platforma z ponad 175 usługami: sztuczna inteligencja, robotyka, IoT, narzędzia do budowania oprogramowania, moc obliczeniowa, konteneryzacja, analityka, bezpieczeństwo i wiele innych. Koncepcję korzystania z chmury można porównać do klocków Lego – gdzie wykorzystujemy i budujemy coś (w tym przypadku aplikacje i systemy) – z tych klocków (czyli usług) – które najlepiej spełniają nasza potrzebę i zbliżają nas do upragnionego celu.

Tomasz Stachlewski, CEE Solutions Architecture Manager, Amazon Web Services: AWS, jeśli chodzi o tę część chmurową Amazona, powstał 13 lat temu. Geneza była prosta – Amazon poprzez sklep internetowy amazon.com zbudował swoje know-how, czyli kompetencje i technologię, która była wykorzystywana do tego, żeby rzeczywiście zarządzać, obsługiwać swój sklep internetowy w sposób bezpieczny i skalowalny oraz globalny. W pewnym momencie firma wyszła z założenia, że technologię, którą sama wypracowała, można zacząć udostępniać innym podmiotom jako usługa „Pay as you go”. Można powiedzieć, że te 13 lat temu pojęcie chmury publicznej praktycznie nie istniało, więc produkt i usługi, które zaproponował AWS były czymś wyjątkowo nowym. Początkowo były to usługi storage’owe do przechowywania danych czy też usługi compute czy „serwery na godziny”. Z początku wszyscy byli zaskoczeni, że firma, która zajmuje się paczkami i sklepem internetowym, wchodzi w świat typowo data center. Okazało się, że rzeczywiście ten pomysł wypalił. Na początku klientami były głównie start-upy, dla których było to genialne rozwiązanie, ponieważ nie musiały na początku działalności inwestować we własny sprzęt serwerowy. Nowe firmy mogły skorzystać z usług AWS, uruchomić kilka czy nawet kilka tysięcy serwerów na godziny. Istotnym elementem było również małe ryzyko konsekwencji niepowodzenia – jak to w świecie start-upów, nie każdy osiąga sukces. W przypadku niepowodzenia firma taka mogła po prostu zamknąć wszystkie swoje serwery i skupić się być może na nowych pomysłach. Przykładem takiego podejścia jest np. Rovio – firma, która stworzyła kilkadziesiąt różnego rodzaju gier mobilnych – które jednak nie osiągnęły zamierzonego celu, aż wreszcie – któregoś dnia, Rovio stworzyło Angry Birds – grę która opanowała dziesiątki milionów użytkowników komórek na świecie i stała się hitem. To pokazuje również inny powód, dla którego chmura stała się tak popularnym mechanizmem i sposobem działania start-up – czyli skalowalność: jeśli okazywało się, że pomysł wypalił, to z kilku pojedynczych serwerów można było przejść na 100, 200 czy niemal dowolną ilość, która była potrzebna – i to wszystko w ciągu minut. Dlatego start-upy pokochały chmurę publiczną i AWS. Po pewnym czasie klientami AWS stały się też inne małe, średnie firmy i korporacje, takie jak General Electric, Siemens czy Philips, które zaczęły korzystać z chmury. Czasami były to pełne migracje do chmury, czasami była to tylko pewna część, jakaś aplikacja, procesy np. środowiska SAPowe, disaster recovery. Tak jak wspominałem, na początku, 13 lat temu AWS udostępniał zaledwie kilka rodzajów usług, jak serwery wirtualne i przechowywanie danych, obecnie zaś AWS to platforma z ponad 175 usługami: sztuczna inteligencja, robotyka, IoT, narzędzia do budowania oprogramowania, moc obliczeniowa, konteneryzacja, analityka, bezpieczeństwo i wiele innych. Koncepcję korzystania z chmury można porównać do klocków Lego – gdzie wykorzystujemy i budujemy coś (w tym przypadku aplikacje i systemy) – z tych klocków (czyli usług) – które najlepiej spełniają nasza potrzebę i zbliżają nas do upragnionego celu.

Agnieszka Rynkowska ma ponad 20-letnie doświadczenie w międzynarodowym biznesie. Przez ostatnie 5 lat związana była z Microsoft Sp. z o.o., gdzie pełniła funkcję Dyrektora Marketingu & Operacji i Członka Zarządu spółki, a wcześniej – Dyrektora ds. Strategii Biznesowej. Była również zatrudniona w Philips Lighting S.A. jako Dyrektor Marketingu w rejonie Europie Środkowo-Wschodniej, gdzie odpowiadała za działalność na 17 rynkach. Wcześniej pracowała na różnych stanowiskach kierowniczych w Microsoft Sp. z o.o., Orange / PTK Centertel Sp. z o.o. i Ericsson Sp. z o.o.. Agnieszka Rynkowska posiada wykształcenie i doświadczenie zarówno w obszarze technologii, jak i zarządzania i marketingu. Ukończyła Politechnikę Warszawską, a także studia podyplomowe w WSZiM oraz The Chartered Institute of Marketing.

Agnieszka Rynkowska ma ponad 20-letnie doświadczenie w międzynarodowym biznesie. Przez ostatnie 5 lat związana była z Microsoft Sp. z o.o., gdzie pełniła funkcję Dyrektora Marketingu & Operacji i Członka Zarządu spółki, a wcześniej – Dyrektora ds. Strategii Biznesowej. Była również zatrudniona w Philips Lighting S.A. jako Dyrektor Marketingu w rejonie Europie Środkowo-Wschodniej, gdzie odpowiadała za działalność na 17 rynkach. Wcześniej pracowała na różnych stanowiskach kierowniczych w Microsoft Sp. z o.o., Orange / PTK Centertel Sp. z o.o. i Ericsson Sp. z o.o.. Agnieszka Rynkowska posiada wykształcenie i doświadczenie zarówno w obszarze technologii, jak i zarządzania i marketingu. Ukończyła Politechnikę Warszawską, a także studia podyplomowe w WSZiM oraz The Chartered Institute of Marketing. Od 9 miesięcy działalnością segmentu biznesowego T‑Mobile kieruje Dyrektor Pionu B2B Piotr Markowski, który będzie pełnił tę rolę do 31 marca, jednocześnie wspierając Agnieszkę Rynkowską w ciągu pierwszych trzech miesięcy jej obecności w spółce. Po 1 kwietnia Piotr Markowski obejmie nowoutworzone stanowisko Transformation Officera, odpowiedzialnego za budowę doskonałości operacyjnej firmy oraz uproszczenie jej procesów, co w konsekwencji umożliwi stały wzrost satysfakcji klientów z usług i jakości obsługi. Transformation Officer będzie raportował bezpośrednio do Prezesa Zarządu T‑Mobile Polska.

Od 9 miesięcy działalnością segmentu biznesowego T‑Mobile kieruje Dyrektor Pionu B2B Piotr Markowski, który będzie pełnił tę rolę do 31 marca, jednocześnie wspierając Agnieszkę Rynkowską w ciągu pierwszych trzech miesięcy jej obecności w spółce. Po 1 kwietnia Piotr Markowski obejmie nowoutworzone stanowisko Transformation Officera, odpowiedzialnego za budowę doskonałości operacyjnej firmy oraz uproszczenie jej procesów, co w konsekwencji umożliwi stały wzrost satysfakcji klientów z usług i jakości obsługi. Transformation Officer będzie raportował bezpośrednio do Prezesa Zarządu T‑Mobile Polska.

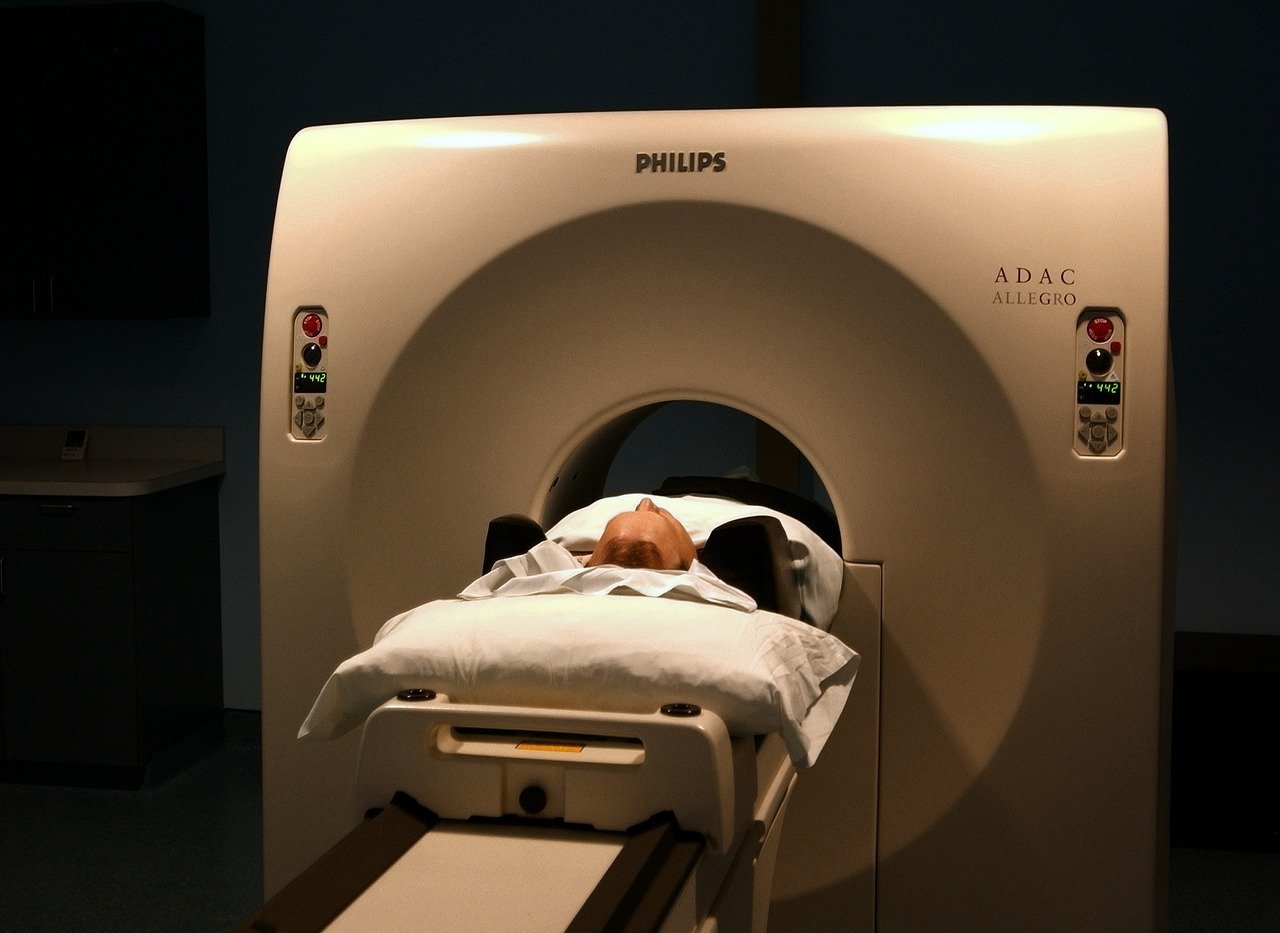

Czym różni się rezonans magnetyczny od tomografu komputerowego?

Czym różni się rezonans magnetyczny od tomografu komputerowego?