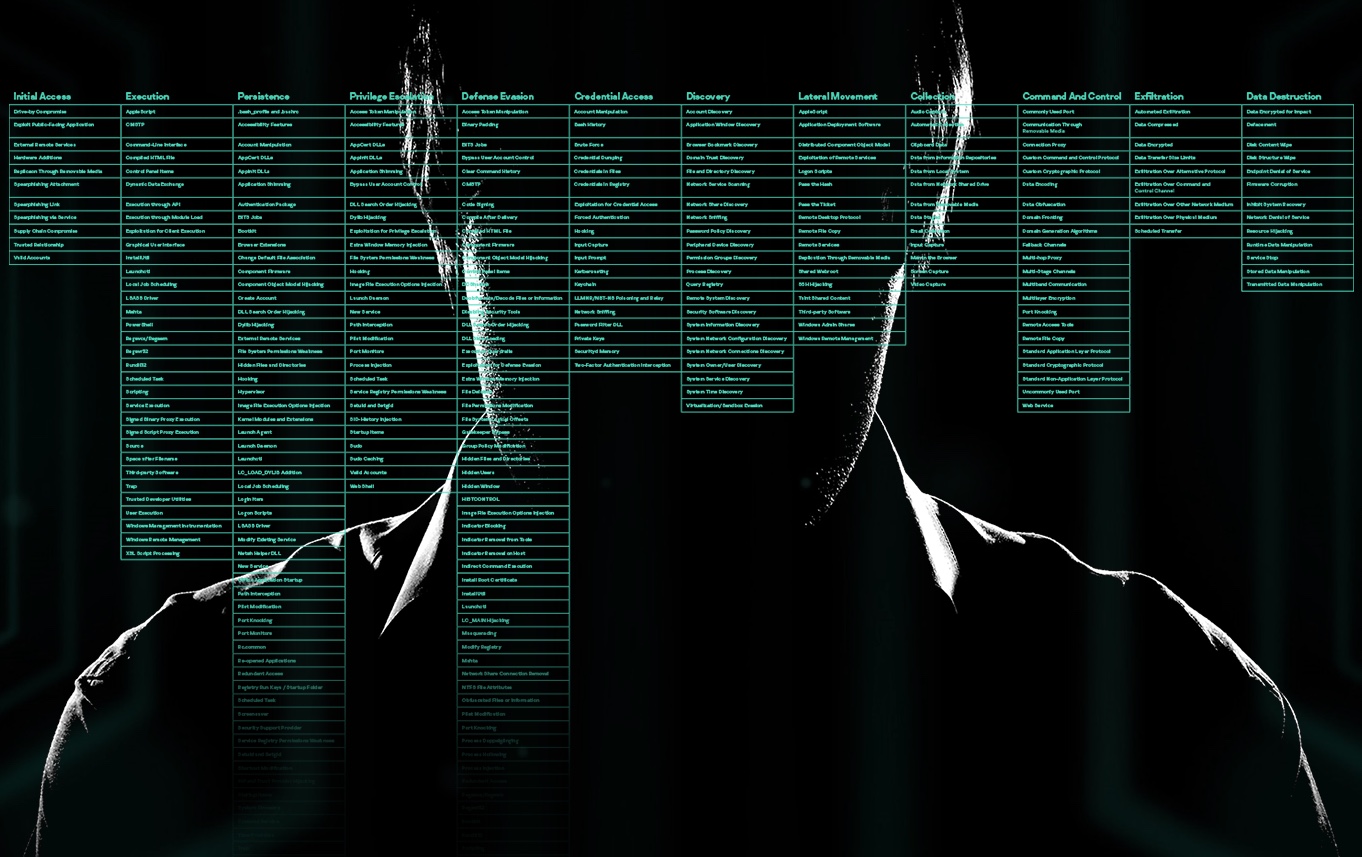

Praktycznie od zawsze bezpieczeństwo było jednym z ważniejszych priorytetów w IT. Jednak ostatnie lata i spektakularne wydarzenia, które odbiły się szerokim echem na całym świecie nadały szczególny sens wysiłkom związanym z zapewnieniem bezpieczeństwa całej infrastruktury IT praktycznie w każdej firmie, bez względu na skalę działalności. Mowa tu chociażby o włamaniach do serwerów Adobe w 2013 roku, Sony Picture w 2014 roku, o atakach na Departament Obrony w USA, sieć hoteli Marriott, na Porsche, Yahoo, czy chociażby na naszym krajowym podwórku – na mBank, BZ WBK, Komisję Nadzoru Finansowego, Allegro. Przykłady można mnożyć.

Wniosek jaki się wyłania z takich zestawień jest jeden – to nieustająca walka dobra ze złem. Ofiarami bywają firmy mikro, średnie, duże, ale i pojedyncze osoby. Nikt nie może się czuć w pełni bezpieczny. Ofiarami padają także największe firmy, które zdawałoby się, mają dość środków finansowych i technicznych, aby zapewnić sobie bezpieczeństwo.

Strona atakująca jest najczęściej bardzo zmotywowana finansowo, czasami są to zlecenia rządowe, czasami po prostu walka o idee. Bez względu na motywację – straty bywają bardzo duże, zarówno w wymiarze finansowym, jak i wizerunkowym.

Niestety, taki stan rzeczy potwierdza także najnowszy raport IBM z badania kosztów naruszeń ochrony danych (Cost of Data Breach 2020) (1) bazujący na wywiadach przeprowadzonych w 524 firmach w 17 krajach i regionach, a także na rozmowach z blisko 3 200 osobami, które miały kontakt z sytuacjami naruszenia bezpieczeństwa danych.

Suche fakty są takie: 53% ataków miało podłoże finansowe, były to celowe działania mające wyrządzić szkody, w 13% włamań siłą sprawczą były obce służby, 13% – to haktywiści , a 21% – sprawcy nieznani. W 80% przypadków utracono dane, które umożliwiały identyfikację klientów. Średni koszt naruszenia ochrony danych w roku 2020 nieznacznie spadł o 1,5% do kwoty 3,86 mln USD rok do roku. Najbardziej ucierpiała ochrona zdrowia ze średnim kosztem 7,3 mln USD.

Wśród wielu liczb i danych najsmutniejsza jest chyba liczba 280, bo firmy ujęte w badaniu potrzebowały średnio 207 dni na rozpoznanie i 73 dni na powstrzymanie naruszenia, co daje właśnie średni “cykl życia” naruszenia o długości 280 dni. W ochronie zdrowia ten czas wynosi 329 dni, a w sektorze finansowym jest o 96 dni krótszy. Jedyne światełko w tunelu to: „Pełne zautomatyzowanie zabezpieczeń pomaga firmom skrócić czas życia naruszenia o 74 dni w porównaniu z firmami bez automatyzacji zabezpieczeń – z 308 do 234 dni”.

Na szczęście jest też nieco optymistycznych danych, które dają wskazówki na przyszłość. „Różnica w średnim łącznym koszcie naruszenia ochrony danych między organizacjami bez wdrożonej automatyzacji zabezpieczeń a organizacjami z wdrożoną w pełni automatyzacją zabezpieczeń wynosi 3,58 mln USD”.

Finansowe skutki naruszenia ochrony danych mogą być odczuwalne jeszcze przez wiele lat po zdarzeniu. Składa się na to wiele elementów, takich jak działania związane z wykryciem i łagodzeniem skutków ataku, czy utrata przychodów z działalności. Do tego należy doliczyć straty wizerunkowe, utratę reputacji, odpływ klientów. Analiza długoterminowych kosztów wykazała, że średnio 61% kosztu naruszenia ochrony danych było ponoszonych w trakcie pierwszego roku, 24% w trakcie drugiego roku, a 15% po upływie dwóch lat. Widać też, że im szybciej udaje się rozpoznać i powstrzymać naruszenie ochrony danych, tym mniejsze są związane z nim koszty.

Z drugie strony, przyglądając się chociażby ostatnim atakom na takie firmy jak Garmin, Diebold Nixdorf, czy nawet prywatne uczelnie SWPS i Collegium Da Vinci (2) i po lekturze niektórych forów, nawet tych bardzo profesjonalnych, nieodparcie nasuwa się pytanie o backup. Gdzie były kopie zapasowe? Dlaczego ich odtworzenie było problemem?

Wydawałoby się, że zagadnienie tworzenia kopii zapasowych jest już dogłębnie omówione, dobrze znane, zbadane na wszystkie sposoby, żeby nie powiedzieć jest to temat tchnący banalnością. Trudno sobie wyobrazić kogoś, kto przeoczy tak ważny aspekt ciągłości działania infrastruktury IT.

We wspomnianym raporcie IBM można przeczytać, że „złożoność systemu zabezpieczeń miała największy udział w kosztach spośród wszystkich 25 badanych czynników – zwiększała średni łączny koszt naruszenia o 292 000 USD […]. Trwająca w momencie naruszenia szeroko zakrojona migracja do chmury zwiększała koszt o ponad 267 000 USD do skorygowanego kosztu łącznego na poziomie 4,13 mln USD”.

To może przewrotnie warto postawić pytanie, co się bardziej opłaca? Zapłacić okup, aby uzyskać klucz do zaszyfrowanych danych, czy inwestować w narzędzia do robienia np. kopii zapasowych?

A jeśli backup nie był aktualny? Może zaatakowane systemy nie były objęte mechanizmami tworzenia kopii zapasowych? Może same kopie zostały zaszyfrowane? Tu prostych odpowiedzi nie ma. Backup jest jednym z elementów całego systemu cyberbezpieczeństwa i tego tematu lekceważyć nie można. Tym bardziej, że widać silny trend do integracji narzędzi klasy Backup&Recovery z rozwiązaniami z zakresu bezpieczeństwa IT.

Choć wdrażanie takich funkcjonalności w działającej infrastrukturze jest zadaniem trudnym i czasochłonnym, to programiści i projektanci z IBM, dysponujący największym potencjałem wiedzy, doświadczenia i kreatywności, postarali się o stworzenie narzędzia, które rzeczywiście może te procesy uczynić prostymi i przyjaznymi – a przede wszystkim bezpiecznymi. Mam tu na myśli system IBM Spectrum Protect. Trzeba przyznać, że jego funkcjonalność i możliwości robią wrażenie. Big Blue nie zawiódł pokładanych w nim nadziei.

Po serii nieprzyjemnych wniosków płynących z raportu Cost of Data Breach 2020 miło zobaczyć, że IBM Spectrum Protect to sposób na w pełni bezpieczne i ekonomiczne tworzenie kopii zapasowych nie tylko lokalnie, ale także do środowisk chmurowych. Jest to szczególnie ważne w przypadku środowisk testowo-deweloperskich, które nigdy nie jest krytyczne dopóki są one dostępne. W przypadku całkowitej utraty takich danych na skutek cyberataku lub katastrofy typu pożar, powódź albo np. wybuch gazu gaśniczego, może się okazać, że trzeba ponownie ponieść znaczne koszty osobowe zespołów deweloperskich albo przygotować nowe wersje aplikacji.

Wykorzystanie funkcjonalności chmury hybrydowej, czyli wykonywanie kopii bezpieczeństwa środowiska testowo-deweloperskiego bezpośrednio do chmury publicznej, może pozwolić na uniknięcie wielu dodatkowych kosztów. Mechanizm ten współpracuje z popularnymi środowiskami chmury, jak IBM Cloud, IBM Cloud Object Storage, Amazon S3 czy Microsoft Azure Blob. IBM Spectrum Protect wykorzystuje deduplikację danych podczas zapisu w celu efektywnego wykorzystania przestrzeni i przepustowości, a także mechanizmy szyfrowania służące do zabezpieczania danych.

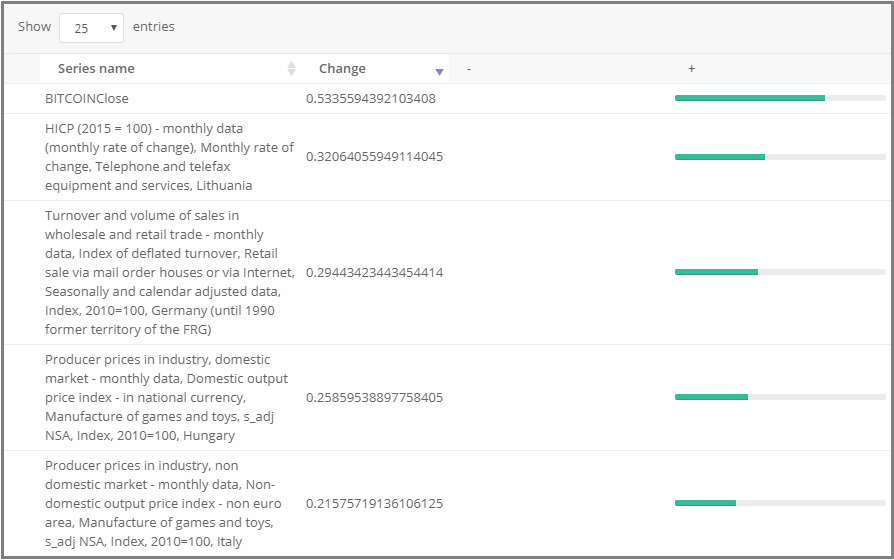

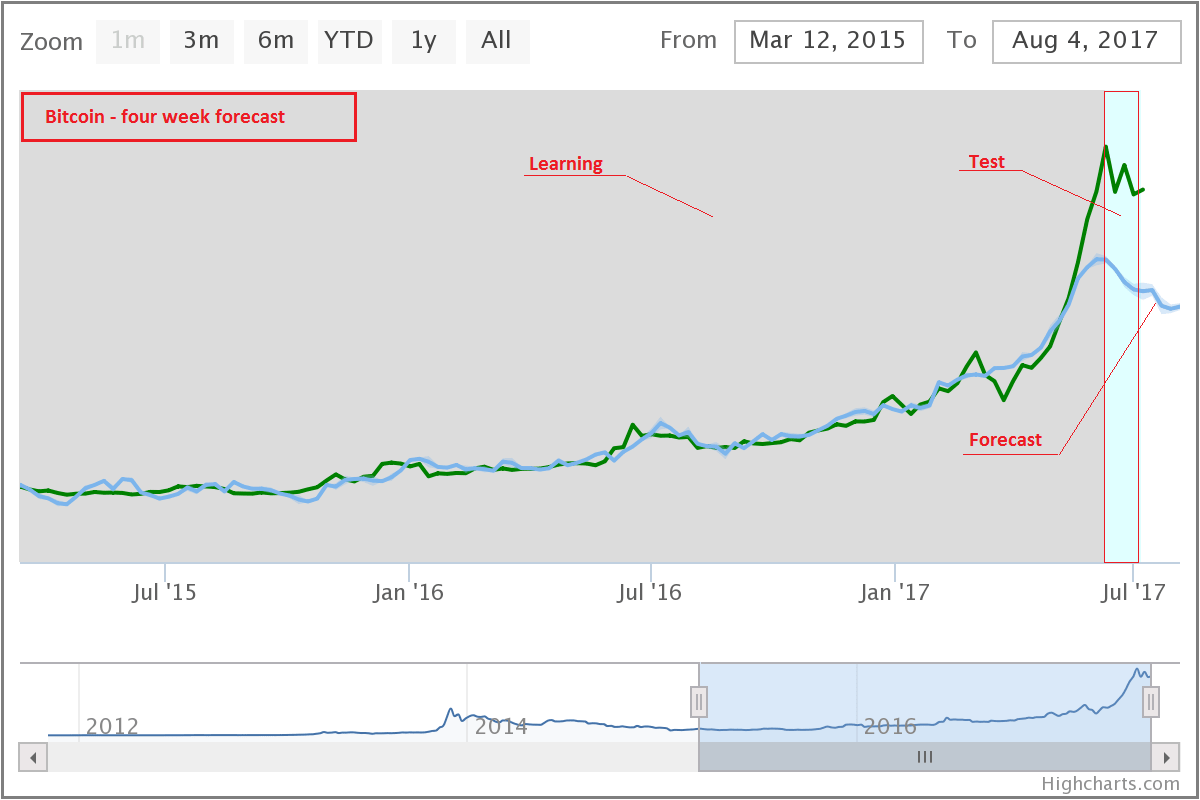

Dla wielu osób na pewno atrakcyjna okaże się funkcja automatyzacji wykrywania oprogramowania typu ransomware. Doświadczenia IBM związane z technologiami sztucznej inteligencji (AI), uczenia maszynowego (ML), analityki, czy zautomatyzowanej orkiestrację działań (SOAR) pozwoliły na realizację bardzo intrygującego pomysłu. IBM Spectrum Protect, po wykonaniu operacji tworzenia kopii zapasowych, rozpoczyna analizę statystyk pod kątem zainfekowania oprogramowaniem wymuszającym okup. W razie wystąpienia anomalii alarmuje administratora, dzięki czemu można szybko rozpoznać cyberatak typu ransomware. Pozwala to na uniknięcie niezwykle niebezpiecznej sytuacji, w której, nieświadomie wykonujemy kopię zapasową już zainfekowanych lub wręcz zaszyfrowanych danych. Podniesienie się po takim ataku jest niezwykle trudne i czasochłonne, a czasami nawet niemożliwe. To praktycznie nokaut dla działu IT.

We wspomnianym raporcie można przeczytać: „Naruszenia, które spowodowały zniszczenie danych wskutek destrukcyjnego ataku […](średni koszt 4,52 mln USD), i ataki szantażujące (4,44 mln USD) okazały się bardziej kosztowne w skutkach niż przeciętne naruszenie spowodowane atakiem z użyciem szkodliwego oprogramowania (4,27 mln USD) lub przeciętne naruszenie ochrony danych (3,86 mln USD )”. Jest się zatem o co bić.

Funkcjonalność automatyzacji zadań związanych z replikacją danych do bezpiecznych, zdalnych ośrodków odtwarzania zapewnia kompleksową ochronę danych. IBM Spectrum Protect umożliwia ich odzyskiwanie w sposób szybki i elastyczny z głównych i zdalnych ośrodków, co pomaga przywracać pojedyncze elementy, złożone systemy bądź całe centra przetwarzania danych.

Oczywiście IBM Spectrum Protect nie jest żadnym panaceum, nie uzdrowi zawsze i wszędzie każdej firmy. Stan zdrowia cyberbezpieczeństwa w raporcie IBM, pokazany jest jak na dłoni. Widać, że zabezpieczanie danych nie jest zadaniem łatwym i prostym. Powtarzające się ataki na największe i najzasobniejsze firmy tylko to potwierdzają.

Dlatego wybierając rozwiązania z do ochrony i odtwarzania danych warto również zwrócić uwagę na wszelkie dodatkowe funkcjonalności pozwalające zabezpieczyć jeden z najcenniejszych zasobów każdej firmy, jakim są dane jej i klientów. Dzięki nowemu i innowacyjnemu podejściu takich firm, jak IBM, możemy być nieco spokojniejsi, że zadbamy o ich bezpieczeństwo na najwyższym możliwym poziomie.

Źródła:

(1) https://www.ibm.com/security/digital-assets/cost-data-breach-report/#/

(2) https://niebezpiecznik.pl/tag/ransomware/

Piotr Sękowski – IBM Polska

Absolwent Akademii Ekonomicznej w Krakowie oraz studiów podyplomowych na kierunku telekomunikacja na Akademii Górniczo-Hutniczej w Krakowie.

Posiada ponad 13 letnie doświadczenie w branży IT. Od 5 lat kieruje działem sprzedaży pamięci masowych w IBM.

Daniel Wysocki – Advatech Sp. z o.o.

Daniel Wysocki ukończył studia na wydziale Inżynierii Mechanicznej i Robotyki na Akademii Górniczo-Hutniczej w Krakowie. Posiada 19 letnie doświadczenie w branży IT. Obecnie pracuje w firmie Advatech jako Security Specialist . Odpowiedzialny jest za dobór innowacyjnych rozwiązań z zakresu bezpieczeństwa IT, ze szczególnym naciskiem na możliwości wykorzystania sztucznej inteligencji i uczenia maszynowego.